أصبح الذكاء الاصطناعي في الفترات القريبة ينتج محتوى يفوق في جودته وسرعته أي قدرة بشرية تقليدية. لكن المشكلة الجوهرية لم تكن يومًا في القدرة على التوليد، بل في الثقة.

الهلاوس (Hallucinations)، التحيّزات، وعدم قابلية التفسير… كلها تحديات تجعل من الصعب الاعتماد على أنظمة الذكاء الاصطناعي في البيئات الحساسة مثل التمويل، الأمن السيبراني، الطب، أو الأنظمة الذاتية التشغيل.

هنا يأتي دور Mira، ليس كنموذج ذكاء اصطناعي جديد، بل كبروتوكول تحقق لامركزي يعيد تعريف مفهوم الثقة في مخرجات الذكاء الاصطناعي.

المشكلة التقنية: لماذا لا يكفي الذكاء الاصطناعي وحده؟

نماذج الذكاء الاصطناعي الحديثة – خصوصًا النماذج التوليدية – تعتمد على الاحتمالات الإحصائية، وليس على “الحقيقة” بمعناها المطلق.

هذا يعني أن النموذج قد ينتج إجابة تبدو صحيحة ومقنعة، لكنها خاطئة منطقيًا أو واقعيًا.

في الأنظمة المركزية، يتم حل هذه المشكلة عبر:

فرق مراجعة بشرية

طبقات تحقق داخلية

أو نماذج تحقق مملوكة للشركة نفسها

لكن هذه الحلول تعاني من:

مركزية الثقة

صعوبة التوسع

ضعف الشفافية

تضارب المصالح

الفكرة الجوهرية في Mira

يعتمد بروتوكول Mira على مبدأ بسيط لكن عميق:

تحويل مخرجات الذكاء الاصطناعي إلى مطالبات (Claims) قابلة للتحقق تشفيريًا عبر شبكة لامركزية.

بدل أن نسأل:

“هل هذه الإجابة صحيحة؟”

يتم تفكيك الإجابة إلى وحدات تحقق دقيقة يمكن اختبارها بشكل مستقل.

كيف يعمل البروتوكول تقنيًا؟

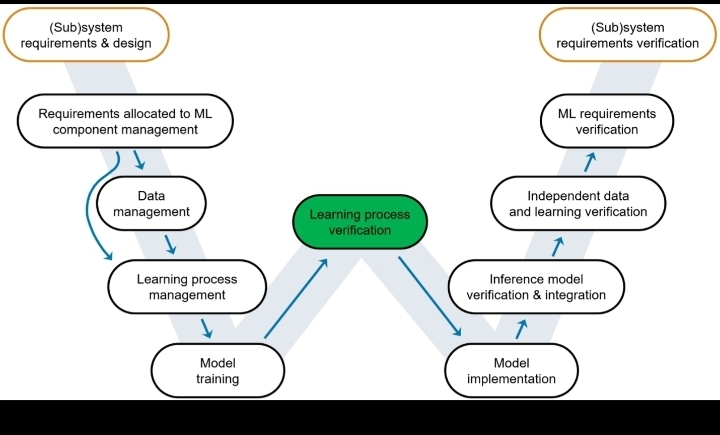

1️⃣ تفكيك المخرجات (Decomposition Layer)

المحتوى المعقد يُقسّم إلى مطالبات منطقية صغيرة.

على سبيل المثال:

حقائق رقمية

علاقات سببية

استنتاجات منطقية

مصادر بيانات

هذا التفكيك يسمح بتحويل إجابة عامة إلى مجموعة من نقاط تحقق منفصلة.

2️⃣ التحقق الموزع (Distributed Verification)

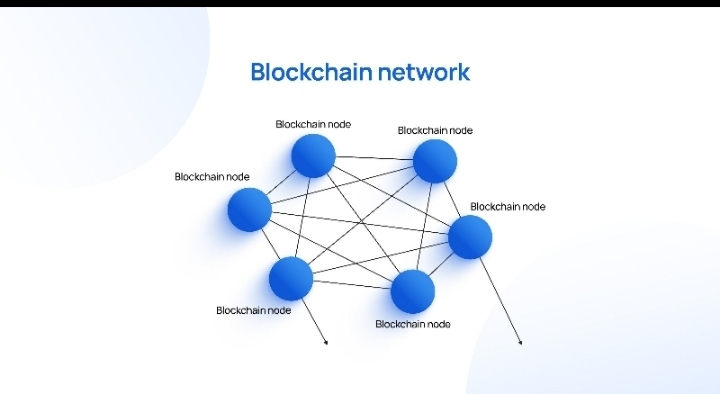

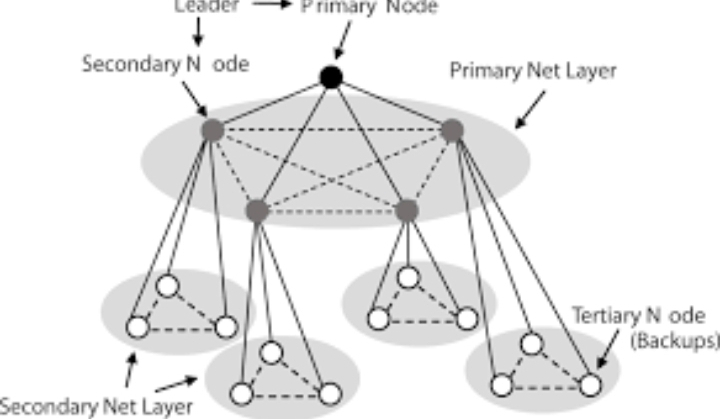

كل مطالبة يتم إرسالها إلى شبكة من نماذج ذكاء اصطناعي مستقلة (Verifiers).

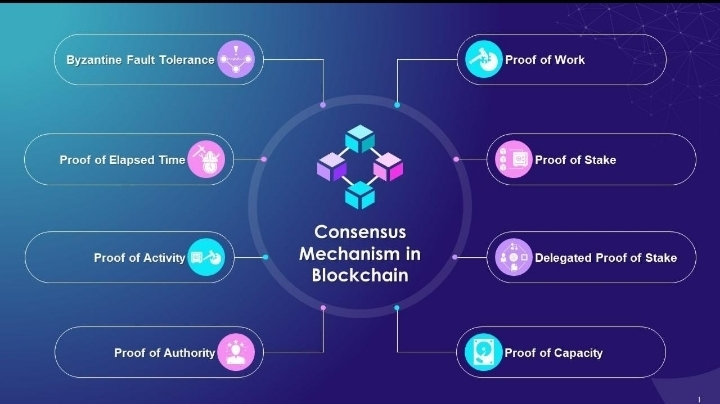

هذه النماذج ليست تحت سيطرة جهة واحدة، بل تعمل ضمن آلية إجماع مشابهة لما يحدث في شبكات البلوكشين.

كل مدقق:

يعيد تقييم المطالبة

يوقّع نتيجته تشفيريًا

يضع رهانًا اقتصاديًا على صحة حكمه

3️⃣ آلية الإجماع والحوافز الاقتصادية

هنا يكمن الابتكار الحقيقي.

المدقق الذي يصوت بشكل متكرر ضد الإجماع الصحيح يتعرض لخسارة اقتصادية.

المدقق الذي يساهم في أحكام دقيقة يحصل على مكافآت.

هذه الآلية تجعل التلاعب مكلفًا اقتصاديًا، تمامًا كما في أنظمة إثبات الحصة (PoS).

بمعنى آخر:

الحقيقة تصبح مرتبطة بالحافز الاقتصادي.

الفرق بين Mira وأنظمة التحقق التقليدية

الجانب

الأنظمة المركزية

مصدر الثقة

شركة واحدة

شبكة لامركزية

الشفافية

محدودة

قابلة للتدقيق

مقاومة التلاعب

ضعيفة نسبيًا

مدعومة بحوافز اقتصادية

القابلية للتوسع

مقيدة بالبنية الداخلية

قابلة للتوسع أفقيًا

البعد التشفيري: تحويل الذكاء الاصطناعي إلى “معلومة قابلة للإثبات”

من أهم الجوانب العلمية في المشروع هو ربط نتائج الذكاء الاصطناعي بطبقة تشفيرية.

بمجرد التوصل إلى إجماع:

يتم تسجيل النتيجة على البلوكشين

تُرفق بتوقيعات المدققين

تصبح قابلة للتحقق لاحقًا دون الحاجة لإعادة الحساب

هذا يفتح الباب أمام مفهوم جديد يمكن تسميته:

Verifiable AI Output

أي مخرجات ذكاء اصطناعي قابلة للإثبات، وليس فقط قابلة للتوليد.

التطبيقات المحتملة

الأنظمة المالية اللامركزية (DeFi)

الوكلاء المستقلون (AI Agents)

أنظمة اتخاذ القرار المؤسسية

الأبحاث العلمية المؤتمتة

التصويت الذكي والتحليل القانوني

كل مجال يحتاج إلى ثقة قابلة للقياس، وليس مجرد دقة احتمالية.

لماذا أرى أن Mira يمثل تحولًا هيكليًا؟

لأننا ننتقل من مرحلة:

“ثق بالنموذج لأنه قوي”

إلى مرحلة:

“ثق بالنتيجة لأنها خضعت لإجماع اقتصادي لامركزي.”

وهذا فرق فلسفي وتقني عميق.

Mira لا يحاول جعل الذكاء الاصطناعي مثاليًا،

بل يبني طبقة تحقق فوقه تجعله قابلاً للاعتماد في البيئات الحرجة.

الخلاصة

إذا كان البلوكشين قد حل مشكلة الثقة في المعاملات الرقمية،

فإن Mira يحاول حل مشكلة الثقة في المعرفة الرقمية نفسها.

نحن أمام مفهوم جديد:

ذكاء اصطناعي لا يُصدَّق لأنه ذكي…

بل لأنه خضع لإجماع يمكن التحقق منه.

وهنا تكمن القيمة الحقيقية للمشروع.

@Mira - Trust Layer of AI #Mira $MIRA