Ist selektive Offenlegung wahre Dezentralisierung — oder juristische Zugangskontrolle, die auf Protokollebene kodiert ist?

Ich habe gelernt, was "Privatsphäre" wirklich kostet, als meine Bank mich bat, Unschuld zu beweisen, von der ich nicht wusste, dass ich beschuldigt wurde.

Ich stand an einem Service-Schalter und machte nichts Exotisches — versuchte nur, Geld zu bewegen, das bereits mir gehörte. Die Angestellte beschuldigte mich nicht direkt. Stattdessen schob sie ein Formular über den Tisch und bat um "unterstützende Dokumente." Nicht, weil ich etwas falsch gemacht hätte, sondern weil das System nicht erkennen konnte, dass ich es nicht getan hatte. Gehaltsabrechnungen, Transaktionshistorie, Verwendungszweck-Erklärungen — jede Seite fühlte sich weniger wie eine Verifizierung und mehr wie ein Geständnis an. Was mir im Gedächtnis blieb, war nicht die Verzögerung. Es war die Asymmetrie. Ich musste alles offenlegen. Die Institution offenbarte nichts über ihre Kriterien, Schwellenwerte oder internen Flaggen. Vertrauen floss nur in eine Richtung.

Dieser Moment offenbarte etwas Kaputtes, nicht nur Ineffizientes. Das System geht von Undurchsichtigkeit auf der einen Seite und radikaler Transparenz auf der anderen aus. Wenn du ein Nutzer bist, legst du standardmäßig offen. Wenn du eine Institution bist, betreibst du Gatekeeping von Design. Privatsphäre, so wurde mir klar, fehlt nicht – sie wird rationiert.

Ich begann, darüber weniger wie über ein technisches Problem und mehr wie über einen Grenzübertritt nachzudenken. Nicht über eine physische Grenze, sondern über eine bürokratische. Du überquerst nicht, indem du beweist, wer du bist; du überquerst, indem du beweist, wer du nicht bist. Nicht gewaschen. Nicht sanktioniert. Nicht verdächtig. Der Reisepass ist endlose Offenlegung, und der Visabeamte ist ein Algorithmus, den du niemals siehst. Das ist die Linse, die bei mir haften blieb: Moderne Finanzen basieren nicht nur auf Vertrauen oder Recht – sie basieren auf präventivem Verdacht, der in Arbeitsabläufe codiert ist.

So gesehen ist das Problem nicht, dass Systeme Daten sammeln. Es ist, dass sie zu viel, zu früh und zu lange sammeln, weil sie keinen Mechanismus haben, um engere Fragen zu stellen. Wenn ein System nur fragen kann: „Zeig mir alles“, dann wird jeder überexponiert. Privatsphäre stirbt nicht durch Bosheit, sondern durch stumpfe Instrumente.

Deshalb wächst die Compliance weiter, während das Vertrauen schrumpft. Vorschriften wie KYC und AML sollten das systemische Risiko reduzieren, haben in der Praxis jedoch dazu geführt, dass Institutionen Daten als rechtliche Isolierung horten. Wenn etwas schiefgeht, können sie sagen: Wir haben alles gesammelt. Die Nutzer internalisieren die Kosten – Datenverletzungen, Profiling, Kontosperrungen – während die Institutionen das Risiko externalisieren. Das Ergebnis ist ein Compliance-Theater, in dem Offenlegung Urteil ersetzt.

Wir haben gesehen, wo das scheitert. Massive Datenlecks aus zentralisierten Datenbanken. Konten ohne Erklärung eingefroren, weil eine automatisierte Regel ausgelöst wurde. Ganze Regionen ausgeschlossen, weil Risikomodelle den lokalen Kontext nicht verstehen. Nichts davon ist illegal. Das ist der unangenehme Teil. Das System ist compliant, aber unfair. Effizient, aber fragil.

Wenn Menschen über „Dezentralisierung“ sprechen, springen sie normalerweise sofort zu Schlagwörtern. Ich denke, das ist ein Fehler. Die tiefere Frage ist, ob ein System die Offenlegung minimieren kann, ohne die Rechenschaftspflicht zu brechen. Die meisten Systeme können das nicht. Sie zwingen zu einer binären Entscheidung: totale Undurchsichtigkeit (die von den Regulierungsbehörden abgelehnt wird) oder totale Transparenz (unter der die Nutzer leiden). Es gibt sehr wenig Spielraum.

Hier kommt die selektive Offenlegung ins Spiel – nicht als Funktion, sondern als philosophische Herausforderung. Kann ein System jemandem erlauben, eine Aussage zu beweisen, ohne die zugrunde liegenden Daten offen zu legen? Kann es „ja“ oder „nein“ antworten, anstatt die ganze Geschichte zu verlangen? Wichtiger noch: Wer entscheidet, welche Aussagen akzeptabel sind? Dort wird es unangenehm.

Projekte wie das Dusk Network existieren genau in dieser Spannung. Nicht als Retter, sondern als Experimente. Die Kernidee ist nicht Anonymität um ihrer selbst willen. Es geht um kompositorische Vertraulichkeit – Systeme zu bauen, bei denen die Offenlegung granular, kontextuell und widerrufbar ist. In der Theorie ermöglicht dies einem Nutzer, Compliance zu beweisen, ohne seine gesamte finanzielle Identität preiszugeben.

Aber hier ist der Teil, den die Leute übersehen: Selektive Offenlegung beseitigt das Gatekeeping nicht. Es verlagert es. Jemand definiert immer noch die Regeln, was bewiesen werden muss. Jemand kodiert immer noch juristische Logik in das Protokoll. Wenn ein Smart Contract regulatorische Bedingungen durchsetzt, dann ist die Regulierung nicht verschwunden – sie wurde kompiliert.

Die Architektur von Dusk nimmt diese Realität an, anstatt sie zu leugnen. Durch die Unterstützung von Zero-Knowledge-Tests und datenschutzfreundlichen Smart Contracts ermöglicht sie Anwendungen, bei denen Vermögenswerte und Identitäten vertraulich bleiben können, während sie dennoch externe Einschränkungen erfüllen. Der DUSK-Token koordiniert diese Umgebung – Staking, Konsens und wirtschaftliche Sicherheit – ohne der Punkt des Systems selbst zu sein. Diese Einschränkung ist wichtig. Wenn Tokens zur Geschichte werden, verrotten Systeme.

Doch hier gibt es echte Widersprüche. Selektive Offenlegung geht davon aus, dass die Fragen des Prüfers legitim sind. Was passiert, wenn sie es nicht sind? Wenn eine Gerichtsbarkeit Nachweise verlangt, die politische oder wirtschaftliche Vorurteile einbetten, widersteht die Privatsphäre-Technologie nicht – sie fügt sich elegant ein. Ein Protokoll kann in der Infrastruktur dezentralisiert sein und dennoch zentralisierte Werte durchsetzen. Das ist die unangenehme Kante, die kein Whitepaper löst.

Ein weiteres Risiko ist die Komplexität. Datenschutzfreundliche Systeme sind schwieriger zu verstehen, zu prüfen und zu steuern. Wenn etwas kaputt geht, verstehen weniger Menschen, warum. Das verschiebt die Macht zu Spezialisten – Kryptographen, Prüfern, Protokolldesignern. Die Dezentralisierung des Zugangs kann mit der Zentralisierung des Verständnisses koexistieren. Das ist kein moralisches Versagen, aber es ist ein strukturelles.

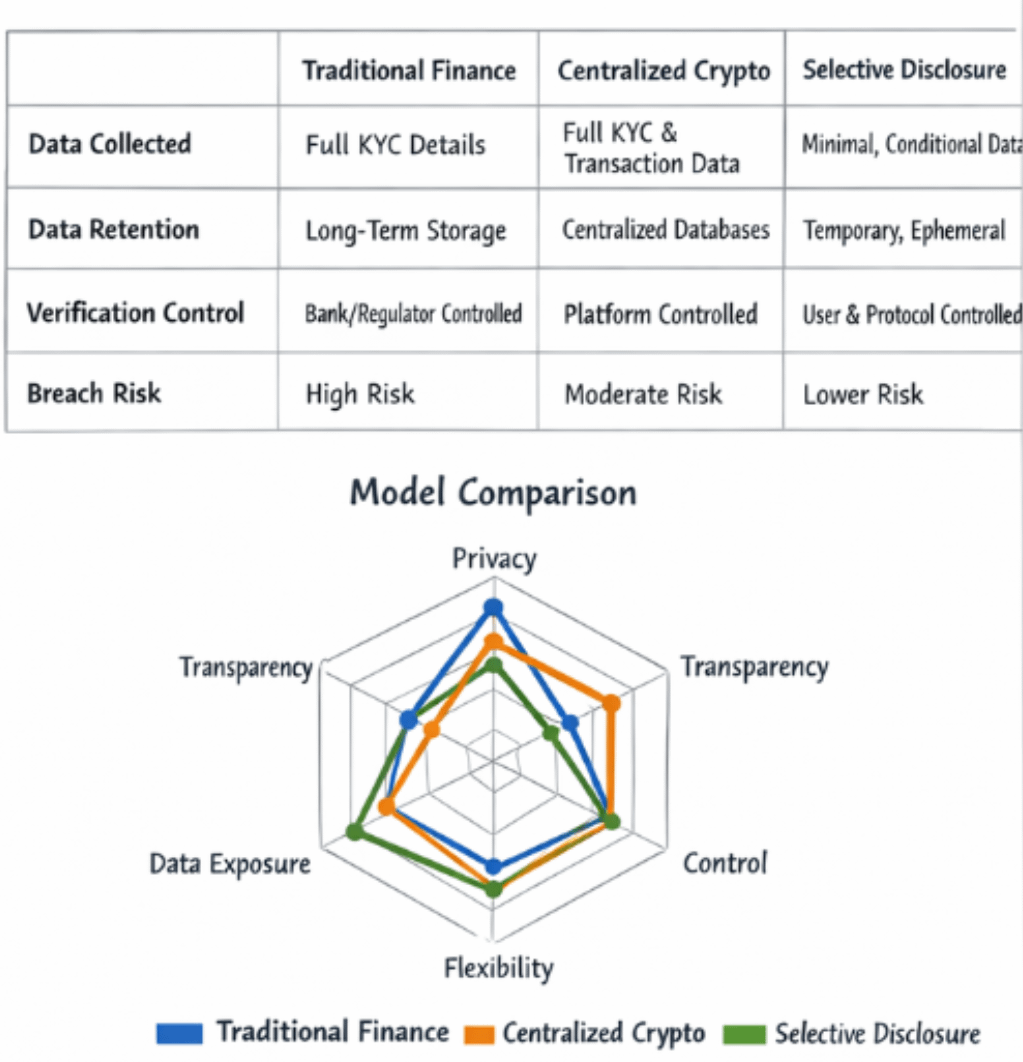

Eine visuelle Darstellung, die mir geholfen hat, darüber nachzudenken, ist eine einfache Tabelle, die Offenlegungsmodelle vergleicht. Spalten: traditionelle Finanzen, zentralisierte Krypto-Plattformen und selektive Offenlegungsprotokolle. Zeilen: gesammelte Daten, behaltene Daten, wer die Verifizierung kontrolliert und wer das Risiko eines Verstoßes trägt. Was sie klar zeigt, ist, dass selektive Offenlegung die Oberfläche der Exposition reduziert, aber die Kontrollasymmetrie nicht beseitigt – sie verengt sie nur.

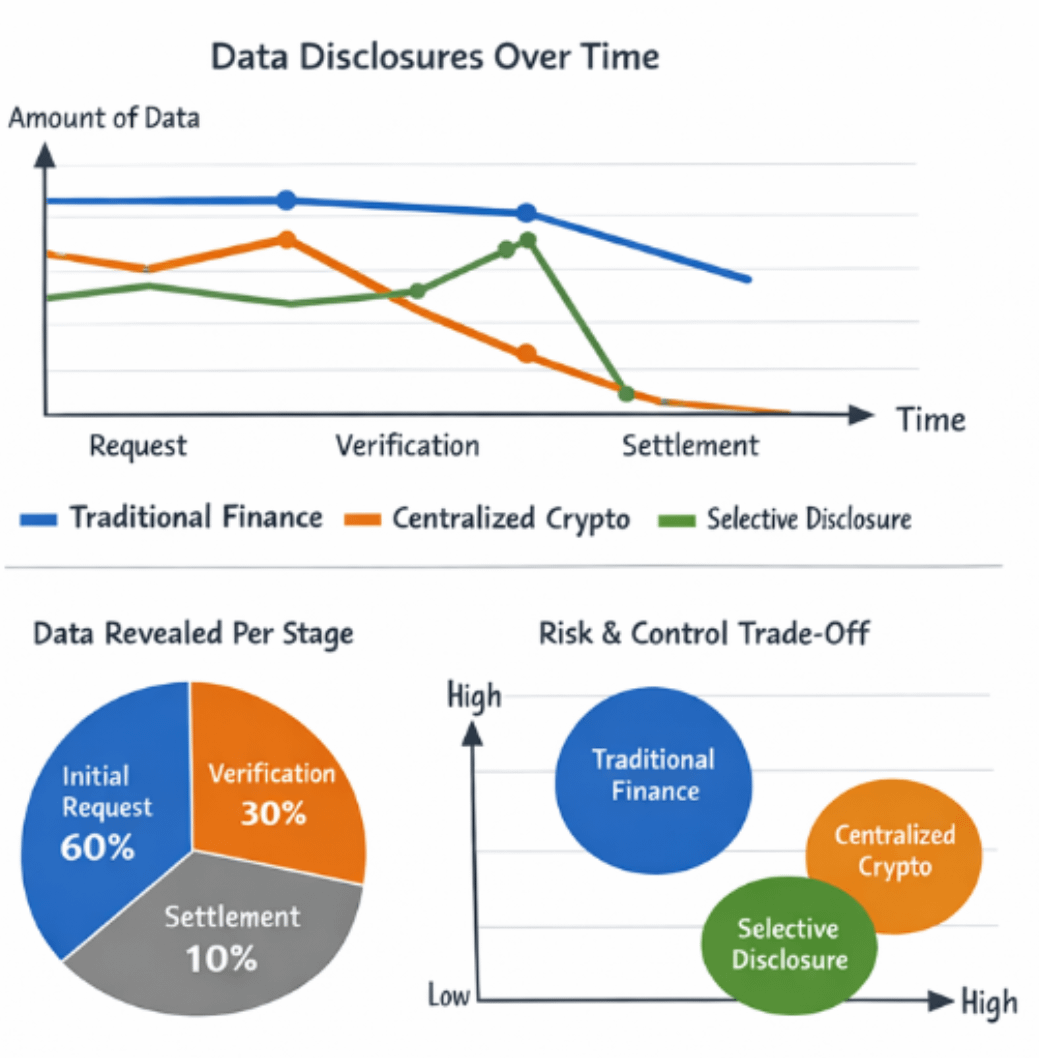

Eine weitere nützliche visuelle Darstellung ist eine Zeitleiste einer Compliance-Interaktion. Schritt für Schritt: Nutzeranfrage, Systemabfrage, Beweisgenerierung, Verifizierung, Abwicklung. Hebe hervor, wo in jedem Modell Daten offenbart werden. In Legacy-Systemen erfolgt die Offenlegung sofort und dauerhaft. In selektiven Systemen erfolgt sie bedingt und vorübergehend. Dieser Unterschied ist nicht nur kosmetisch; er verändert, wer für Fehler zahlt.

Ich sehe das nicht als eine klare Geschichte des Fortschritts. Es ist mehr wie ein Tausch. Wir tauschen indiscriminante Transparenz gegen programmierbare Offenlegung. Das ist eine Verbesserung – aber es kodiert auch die Annahmen von heute in die Gleise von morgen. Einmal kodiert, wird es ein Governance-Problem, sie zu ändern, nicht eine Benutzerwahl.

Die Erfahrung an diesem Banktresen stört mich immer noch, weil es nicht um Betrug oder Sicherheit ging. Es ging um Macht. Wer darf Fragen stellen? Wer muss antworten? Selektive Offenlegung verspricht eine bessere Balance, verlangt aber auch von uns zu akzeptieren, dass eine Art von Gatekeeping unvermeidlich ist. Die einzige Frage ist, ob wir es sehen, prüfen und anfechten können.

Hier ist also die Spannung, die ich nicht auflösen kann: Wenn Protokolle beginnen, juristische Logik direkt zu kodieren – zu entscheiden, was bewiesen werden kann, wem und unter welchen Annahmen – dezentralisieren wir Vertrauen oder machen wir das Gatekeeping einfach effizienter und schwieriger herauszufordern?