Künstliche Intelligenz ist jetzt Teil des täglichen Lebens. Sie hilft beim Schreiben von E-Mails, Beantworten von Fragen, Zusammenfassen von Forschungen und sogar beim Leiten finanzieller Entscheidungen. Aber es gibt ein großes Problem.

KI kann Fehler machen, und sie klingt oft sehr sicher, selbst wenn sie falsch liegt.

Manchmal liefert eine KI eine Antwort, die genau erscheint, aber nicht ganz korrekt ist. Tatsächlich haben Studien gezeigt, dass große Sprachmodelle in bis zu 15% der Fälle falsche oder irreführende Informationen generieren können, abhängig von der Komplexität der Aufgabe.

Das geschieht, weil KI-Modelle Antworten basierend auf Mustern vorhersagen, anstatt ein echtes Verständnis zu haben. In einfachen Anwendungsfällen mag das nicht viel ausmachen. Aber in ernsthafteren Umgebungen wird Zuverlässigkeit wichtig.

Da kommt @Mira - Trust Layer of AI ins Spiel.

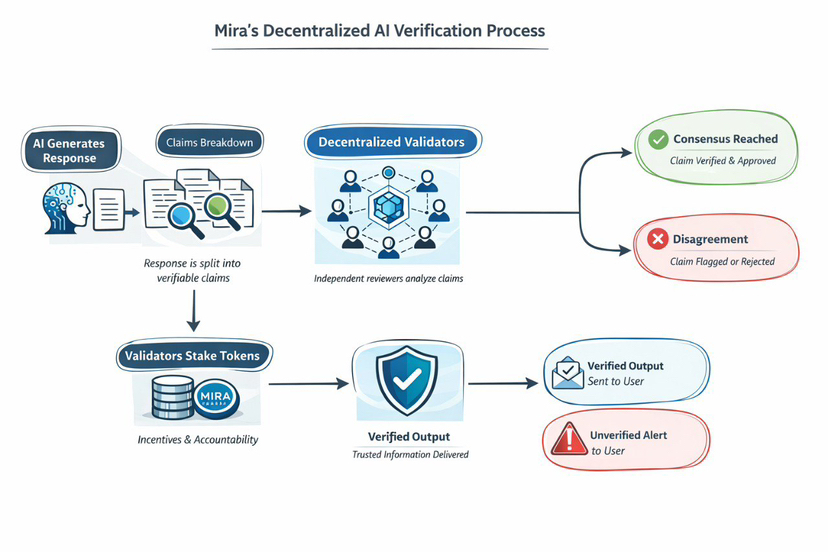

Mira Network baut ein System auf, das KI-Ausgaben überprüft, bevor sie vertrauenswürdig sind. Anstatt sich auf ein Modell zu verlassen, um die endgültige Antwort zu geben, verwendet Mira mehrere unabhängige Validatoren, um die Antwort zu überprüfen.

So funktioniert es einfach ausgedrückt.

Zuerst generiert eine KI eine Antwort. Mira zerlegt diese Antwort dann in kleinere Aussagen. Diese Aussagen werden an verschiedene Validatoren im Netzwerk gesendet. Jeder Validator überprüft, ob die Aussagen genau erscheinen oder nicht. Danach schaut das System auf die allgemeine Übereinstimmung zwischen ihnen.

Wenn die meisten Validatoren zustimmen, dass die Antwort korrekt ist, besteht sie die Verifizierung. Wenn es Uneinigkeit gibt, kann die Ausgabe markiert oder abgelehnt werden.

Die Idee ist einfach: Statt einer Quelle zu vertrauen, vertraue dem Konsens zwischen vielen.

Dieser Ansatz ist inspiriert von der Funktionsweise dezentraler Systeme. In Blockchain-Netzwerken werden Transaktionen nicht von einer Autorität bestätigt. Sie werden von vielen Teilnehmern validiert. Mira wendet eine ähnliche Idee auf KI-Antworten an.

Das Netzwerk nutzt auch Anreize, um ehrliche Teilnahme zu fördern. Validatoren müssen $MIRA Token einsetzen, um Teil des Systems zu sein.

Wenn sie ehrlich handeln und genaue Überprüfungen bereitstellen, verdienen sie Belohnungen. Wenn sie nachlässig handeln oder versuchen, Ergebnisse zu manipulieren, riskieren sie, einen Teil ihres Einsatzes zu verlieren.

Das schafft Verantwortlichkeit. Validatoren haben etwas auf dem Spiel, also sind sie motiviert, genau zu sein.

Es ist wichtig zu verstehen, dass Mira nicht versucht, ein besseres KI-Modell zu entwickeln. Es konkurriert nicht mit großen KI-Unternehmen. Stattdessen konzentriert es sich darauf, eine Verifizierungsschicht über bestehende KI-Systeme zu legen.

Denke an es als ein Bewertungssystem für KI-Ausgaben. Das Ziel ist nicht Perfektion. Das Ziel ist es, Fehler zu reduzieren und eine zusätzliche Vertrauensschicht hinzuzufügen, bevor Entscheidungen auf der Grundlage von KI-Antworten getroffen werden.

Da KI in verschiedenen Branchen immer häufiger wird, steigt der Bedarf an Zuverlässigkeit. Mira Network konzentriert sich darauf, dieses spezifische Problem zu lösen, wie man KI-Ausgaben zuverlässiger macht, ohne sich auf eine einzige zentralisierte Quelle zu verlassen.

Einfach ausgedrückt, Mira baut ein System auf, das KI überprüft, bevor du dich darauf verlässt.

#Mira #AI #MiraNetwork #ArtificialInteligence #DecentralisedAI