Mira Network ist eines dieser Projekte, das ich nicht aufgrund von Hype studiert habe, sondern wegen einer praktischen Frage: Wie überprüfen wir tatsächlich KI-generierte Informationen auf eine Weise, die nicht davon abhängt, ein einzelnes Unternehmen zu vertrauen?

Nachdem ich das Protokolldesign durchgelesen und die Aktualisierungen von @Mira - Trust Layer of AI verfolgt habe, wurde klar, dass Mira Network auf etwas sehr Spezifisches fokussiert ist. Es versucht nicht, ein weiteres großes Sprachmodell zu erstellen. Es baut eine dezentrale Überprüfungsschicht für KI-Systeme auf.

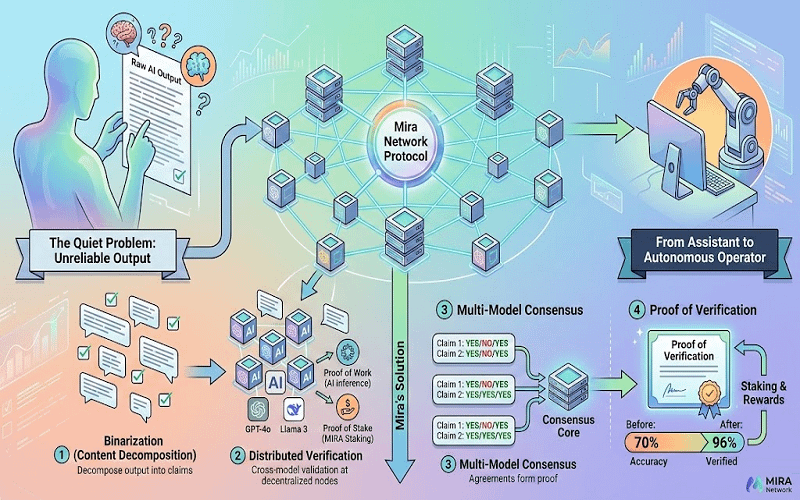

Die zentrale Idee hinter #MiraNetwork ist einfach, aber wichtig. KI-Modelle erzeugen Ausgaben, die oft selbstbewusst klingen, auch wenn sie falsch sind. Halluzinationen, subtile Vorurteile, fabrizierte Zitationen, das sind keine seltenen Ausnahmefälle. Sie sind strukturelle Schwächen in der Art und Weise, wie große Modelle Text vorhersagen.

Mira geht dies an, indem sie KI-Ausgaben als Ansprüche betrachtet, anstatt als einen einzigen Block von Text.

Anstatt zu fragen: „Ist diese gesamte Antwort korrekt?“, zerlegt das Protokoll die Ausgabe in kleinere, überprüfbare Aussagen. Jeder Anspruch kann dann unabhängig von anderen KI-Modellen bewertet werden, die als Prüfer fungieren.

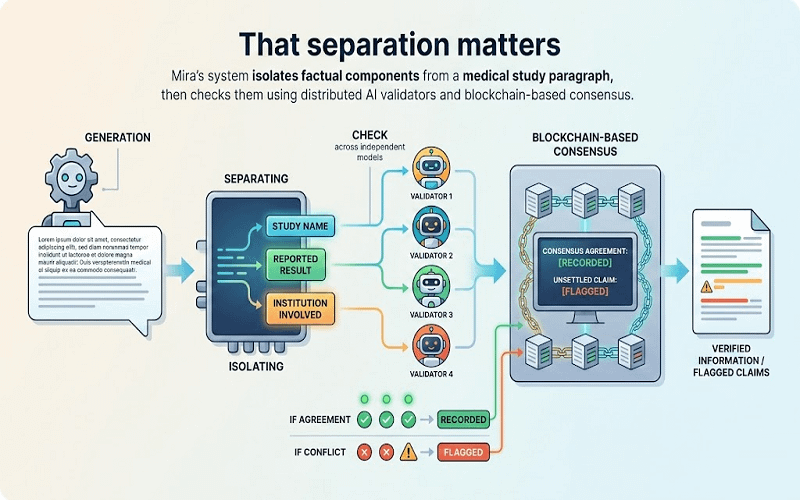

Diese Trennung ist wichtig.

Wenn ein Modell einen Absatz über eine medizinische Studie generiert, isoliert Miras System die faktischen Komponenten. Zum Beispiel den Namen der Studie, das berichtete Ergebnis, die beteiligte Institution. Diese Teile werden dann über unabhängige Modelle überprüft. Wenn mehrere Modelle übereinstimmen, wird diese Übereinstimmung aufgezeichnet. Wenn sie widersprüchlich sind, wird der Anspruch markiert.

Es erinnert mich daran, wie Faktenprüfungsnetzwerke im Journalismus funktionieren. Ein Reporter schreibt die Geschichte, aber Redakteure und externe Prüfer überprüfen einzelne Fakten. Der Unterschied hier ist, dass die „Redakteure“ verteilte KI-Validatoren sind, die durch blockchain-basierte Konsensmechanismen koordiniert werden.

Hier wird die Blockchain-Schicht relevant.

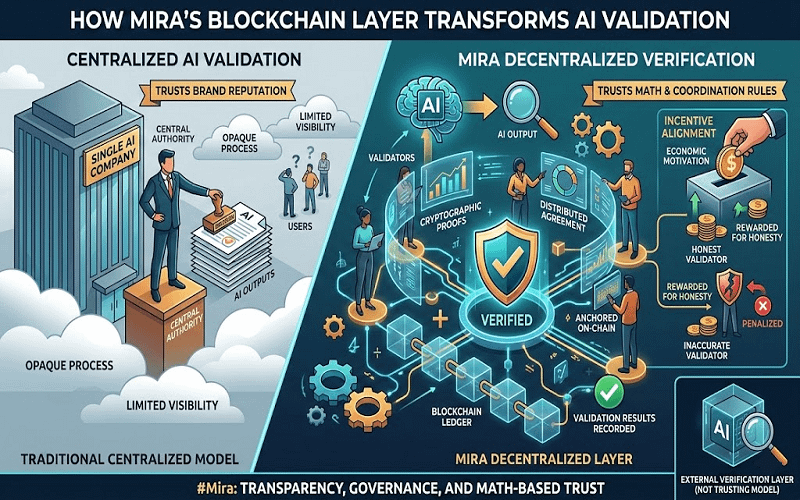

Anstatt sich auf eine zentrale Autorität zu verlassen, um etwas als verifiziert zu erklären, verwendet Mira kryptografische Beweise und verteilte Konsensmechanismen, um Validierungsergebnisse aufzuzeichnen. Sobald ein Anspruch bewertet und Konsens erzielt wurde, wird dieses Ergebnis on-chain verankert. Das Vertrauen kommt aus Mathematik und Koordinationsregeln, nicht aus der Markenreputation.

Der Token $MIRA spielt eine Rolle bei der Angleichung der Anreize innerhalb dieses Systems. Validatoren sind wirtschaftlich motiviert, ehrlich zu handeln, da ungenaue Verifizierung bestraft werden kann. Theoretisch verringert dies das Risiko von Kollusion oder nachlässiger Validierung.

Was dies von zentralisierter KI-Validierung unterscheidet, ist Governance und Transparenz. In einem typischen Setup entscheidet ein einzelnes Unternehmen, wie Ausgaben getestet werden, was als genau gilt und wie Korrekturen gehandhabt werden. Die Benutzer haben begrenzte Einblicke in diesen Prozess.

Mit #Mira ist die Verifizierungsschicht extern zum Modell selbst. Sie geht nicht davon aus, dass das Modell vertrauenswürdig ist. Sie geht vom Gegenteil aus und baut einen Mechanismus auf, um es kontinuierlich zu testen.

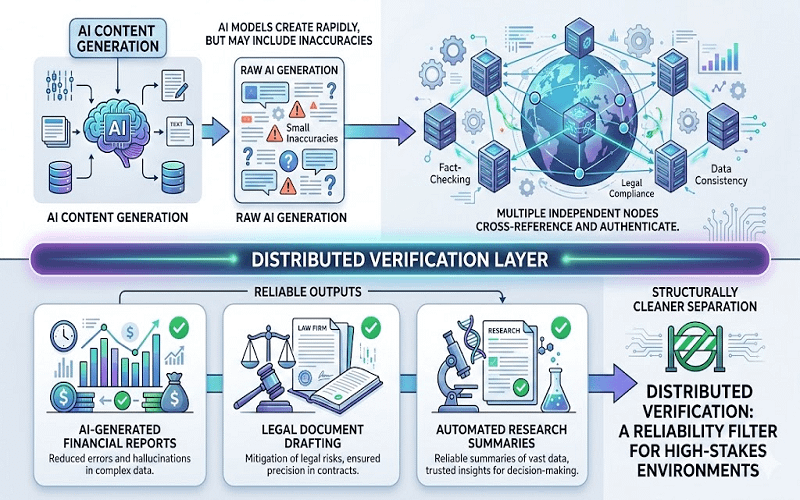

Diese Trennung fühlt sich strukturell sauberer an.

Es eröffnet auch praktische Anwendungsfälle. Denken Sie an von KI generierte Finanzberichte, die Erstellung juristischer Dokumente oder automatisierte Forschungszusammenfassungen. In diesen Bereichen können selbst kleine Ungenauigkeiten echte Probleme verursachen. Eine verteilte Verifizierungsschicht könnte als Zuverlässigkeitsfilter fungieren, bevor Informationen in kritischen Umgebungen verwendet werden.

Natürlich ist dieses Design nicht ohne Kompromisse.

Das Ausführen mehrerer KI-Modelle zur Überprüfung der Ausgaben erhöht die Rechenkosten. Die Koordination zwischen verteilten Validatoren führt zu Latenz. Und dezentrale KI-Infrastruktur wird überfüllt, da mehrere Protokolle ähnliches Terrain erkunden. Das Mira-Netzwerk ist in Bezug auf die Reifung des Ökosystems noch früh, und die weitverbreitete Akzeptanz wird davon abhängen, wie effizient es die Verifizierung skalieren kann, ohne sie prohibitiv teuer zu machen.

Es gibt auch eine tiefere Frage zur Erkenntnistheorie. Wenn mehrere KI-Systeme in etwas Falsches übereinstimmen, garantiert der Konsens allein nicht die Wahrheit. Miras Design reduziert den Fehler des einzelnen Modells, beseitigt jedoch nicht die systematische Voreingenommenheit bei Modellen, die auf ähnlichen Daten trainiert wurden.

Dennoch finde ich den Fokus diszipliniert.

Anstatt zu versuchen, das intelligenteste Modell zu bauen, baut das Mira-Netzwerk eine Schicht auf, die annimmt, dass Intelligenz unvollkommen ist und Verifizierung benötigt. Dieser Perspektivwechsel fühlt sich praktisch an.

Wenn ich auf die breitere Schnittstelle von KI und Blockchain schaue, verfolgen viele Projekte Leistungskennzahlen. Mira scheint mehr an der Zuverlässigkeitsinfrastruktur interessiert zu sein. Es behandelt die Verifizierung als ein Problem erster Klasse, anstatt als Nachgedanken.

Und in einer Welt, in der KI-Ausgaben zunehmend Entscheidungen beeinflussen, könnte diese stille Schicht der Validierung wichtiger sein als eine weitere marginale Verbesserung der Modellgröße.