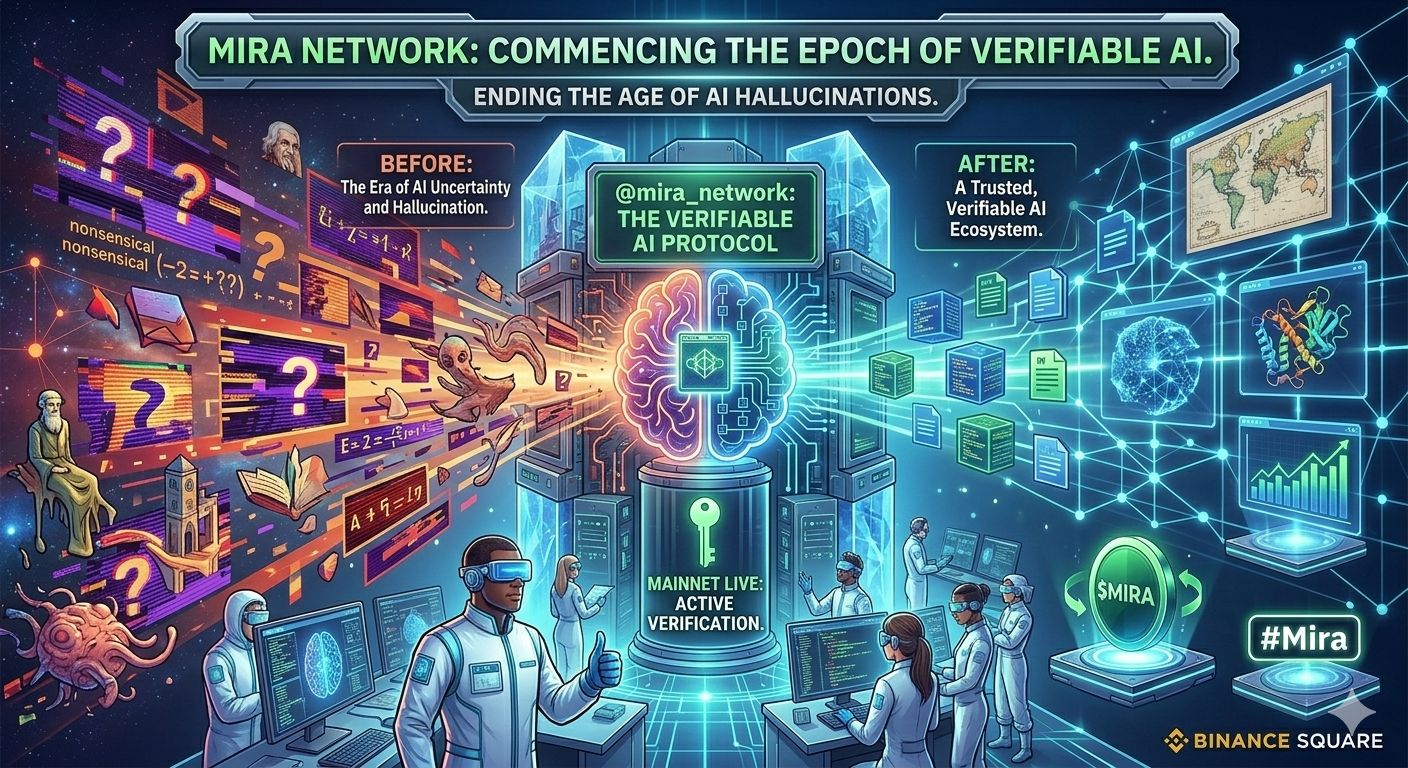

Künstliche Intelligenz hat bereits verändert, wie wir arbeiten, kreieren und kommunizieren. Allerdings ist mit der zunehmenden Leistungsfähigkeit und Autonomie von KI-Modellen ein grundlegender Fehler aufgetreten: das Problem der "Halluzinationen." KI-Modelle erzeugen häufig falsche, voreingenommene oder vollständig erfundene Informationen mit hoher Überzeugung. Während diese Fehler im alltäglichen Gebrauch ärgerlich sind, sind sie gefährlich, wenn KI in kritischen Sektoren wie Finanzen, Gesundheitswesen und Rechtssystemen eingesetzt wird.

Betreten Sie Mira Network, ein dezentrales Infrastrukturprotokoll, das darauf abzielt, eine grundlegende "Vertrauensebene" für KI zu schaffen. Seine Mission ist es, die Ergebnisse von KI überprüfbar, prüfbar und zuverlässig zu machen und die "Zuverlässigkeitslücke" zu schließen, die derzeit die vollständige Autonomie von KI behindert.

Wie das Mira-Netzwerk funktioniert: Verifikation durch Konsens

Der aktuelle Ansatz zur Zuverlässigkeit von KI umfasst oft kostspielige menschliche Aufsicht. Mira löst dies durch einen dezentralen, kryptografischen Ansatz. Das Netzwerk wechselt vom riskanten Paradigma "Vertraue der KI" zu einem sicheren Modell "Verifiziere die KI."

Der Prozess folgt einigen wichtigen Schritten:

Anspruchstransformation: Miras Protokoll nimmt ein komplexes Ergebnis aus einem KI-Modell (wie einen Finanzanalysebericht) und zerlegt es in diskrete, kleinere faktische Ansprüche.

Dezentrales Routing: Diese Ansprüche werden über ein globales Netzwerk unabhängiger Validator-Knoten verteilt.

Cross-Model-Verifikation: Entscheidend ist, dass diese Validator-Knoten oft andere, diverse KI-Modelle sind. Sie bewerten die Ansprüche unabhängig anhand ihrer eigenen Wissensbasen.

Konsens: Das Netzwerk verwendet einen kryptowirtschaftlichen Konsensmechanismus, um die Gültigkeit jeder Behauptung zu bestätigen. Wenn die Validatoren einen Konsens erreichen, dass die Informationen wahr sind, wird ein kryptografischer Beweis ausgestellt.

Strafen und Belohnungen: Um Ehrlichkeit zu gewährleisten, müssen Validatoren native Tokens staken, um teilzunehmen. Wenn sie unehrliche oder nachlässige Verifikationen bereitstellen, wird ihr Einsatz gekürzt (verloren). Ehrliche Validatoren verdienen Belohnungen.

Durch die Nutzung von "kollektiver Intelligenz" anstatt einem einzelnen Modell zu vertrauen, kann Mira eine deutlich höhere Genauigkeit erreichen – einige Metriken zeigen, dass die Verifikationsgenauigkeit über 95 % liegt – im Vergleich zur Basislinie der aktuellen eigenständigen Modelle.

Der $MIRA Token-Nutzen

Das Ökosystem wird durch den $MIRA token angetrieben, der als Dienstprogramm und Treibstoff des Netzwerks fungiert:

Staking für Sicherheit: Validator-Knoten binden Mira, um am Konsens teilzunehmen und ihre wirtschaftlichen Interessen mit wahrheitsgemäßer Verifikation in Einklang zu bringen.

Zahlungen: Unternehmen und Entwickler zahlen in Mira, um über APIs auf die Verifizierungsdienste des Netzwerks zuzugreifen.

Governance: Token-Inhaber besitzen Stimmrecht, um die zukünftigen Upgrades des Protokolls, die Belohnungsverteilungen und Parameteränderungen zu gestalten.

Ausblick

Während die Welt sich von isolierten KI-Tools zu vollautonomen KI-Agenten bewegt, die echten Wert schaffen, ist die Notwendigkeit einer Verantwortlichkeitsschicht von größter Bedeutung. Das Mira-Netzwerk positioniert sich als diese essentielle Schicht – der "Prüfer" der KI-Intelligenz. Durch die Etablierung eines dezentralen Wahrheitsstandards könnte Mira Billionen an wirtschaftlichem Wert freisetzen, die derzeit durch Vertrauensprobleme eingeschränkt sind, und das wahre Potenzial der KI-Revolution ermöglichen.

#Mira @Mira - Trust Layer of AI