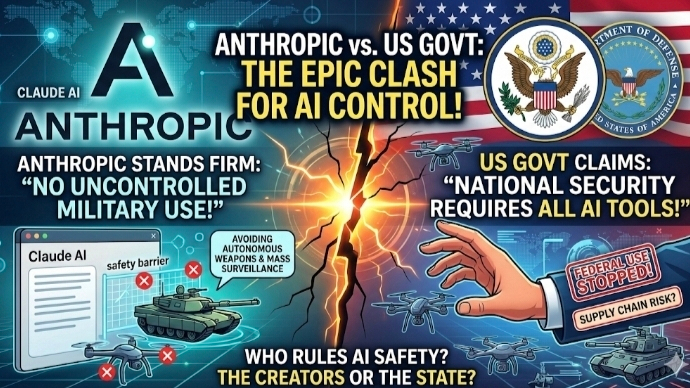

Ich habe diese Situation sorgfältig recherchiert und in meiner Suche beginne ich zu verstehen, wie ernst dieser Konflikt wirklich ist. Es handelt sich nicht nur um ein normales Missverständnis zwischen einem Unternehmen und der Regierung. Es geht um Macht, Kontrolle, Sicherheit und die Zukunft der künstlichen Intelligenz in der realen Welt. Das beteiligte Unternehmen ist Anthropic, der Hersteller des KI-Systems namens Claude. Sie entwickeln fortschrittliche KI-Tools, die schreiben, analysieren und bei komplexen Entscheidungen helfen können. Die US-Regierung, insbesondere die Verteidigungsbehörden, möchte ebenfalls leistungsstarke KI-Systeme für die nationale Sicherheit und militärische Zwecke nutzen. Dort beginnen die Dinge kompliziert zu werden.

Soweit ich verstehe, hat Anthropic strenge Regeln dafür, wie ihre KI verwendet werden kann. Sie sagen, ihre Technologie sollte nicht für bestimmte militärische Aktivitäten verwendet werden, insbesondere nicht für Dinge wie autonome Waffen oder großflächige Überwachung. Sie glauben, dass die aktuelle KI nicht vollständig zuverlässig ist und Fehler machen kann. Wenn diese Fehler in sensiblen Bereichen wie Kriegsentscheidungen passieren, könnten die Ergebnisse sehr gefährlich sein. Ich beginne darüber zu verstehen, als ich lese, wie KI manchmal falsche Antworten gibt oder Vorurteile zeigt. Wenn das in einem einfachen Chat passiert, ist es in Ordnung. Aber wenn das in militärischen Operationen passiert, wird es zu einem ernsthaften Problem.

Die US-Regierung sieht das anders. Sie glauben, dass, wenn KI-Technologie verfügbar und legal ist, sie sie für die nationale Verteidigung nutzen sollten. Sie argumentieren, dass Sicherheitsbedrohungen real sind und Konkurrenten auf der ganzen Welt ihre eigenen KI-Systeme entwickeln. Ihrer Ansicht nach könnte die Einschränkung des Zugangs zu fortschrittlichen KI-Tools die nationale Stärke schwächen. Sie sind der Meinung, dass ein privates Unternehmen nicht entscheiden sollte, was die Regierung in legalen militärischen Operationen tun oder lassen kann.

Dieses Missverständnis wurde langsam größer. Berichten zufolge bat die Regierung Anthropic, eine breitere militärische Nutzung seines KI-Systems zuzulassen. Anthropic weigerte sich, bestimmte Einschränkungen aufzuheben. Sie hielten an ihren Sicherheitsprinzipien fest. Aufgrund dessen nahmen die Spannungen zu. Schließlich bewegte sich die Regierung, um zu verhindern, dass Bundesbehörden die Technologie von Anthropic nutzen. Diese Entscheidung sorgte für Aufregung in der Technologiebranche.

Ich habe weiter recherchiert und festgestellt, dass die Regierung das Unternehmen sogar als potenzielles Risiko für die Lieferkette eingestuft hat. Das ist ein ernstes Etikett, da es nicht nur direkte Regierungsverträge betrifft, sondern auch andere Unternehmen, die mit der Regierung zusammenarbeiten. Wenn sie von der Technologie von Anthropic abhängig sind, müssen sie möglicherweise auch ihre Systeme ändern. Das zeigt, wie mächtig solche Entscheidungen werden können.

Von der Seite von Anthropic sagen sie, dass sie nicht gegen die Unterstützung der nationalen Sicherheit sind. Sie haben zuvor mit Regierungsbehörden zusammengearbeitet. Aber sie glauben, dass es klare Grenzen geben muss. Sie argumentieren, dass die KI von heute nicht fortgeschritten genug ist, um Entscheidungen über Leben und Tod ohne starke menschliche Kontrolle zu treffen. Sie wollen zukünftige Missbräuche vermeiden. Ihrer Ansicht nach ist verantwortungsvolle Entwicklung wichtiger als unbegrenzte Bereitstellung.

Ich habe bemerkt, dass dieser Konflikt wirklich darum geht, wer die Kontrolle über KI hat. Sind es die Schöpfer, die sie entwickeln, oder die Regierungen, die sie nutzen wollen? Wenn KI mächtiger wird, wird sie mehr Einfluss auf Verteidigung, Gesundheitswesen, Finanzen und das tägliche Leben haben. Wenn Unternehmen strenge Regeln aufstellen, könnten Regierungen sich eingeschränkt fühlen. Wenn Regierungen Unternehmen zwingen, Einschränkungen aufzuheben, könnten Unternehmen das Gefühl haben, dass ihre ethischen Werte ignoriert werden.

In meiner Suche beginne ich zu verstehen, wie dieses Ereignis die Zukunft der KI-Politik gestalten könnte. Andere KI-Unternehmen beobachten genau. Sie denken darüber nach, was sie tun werden, wenn sie ähnlichem Druck ausgesetzt sind. Auch Investoren beobachten, da solche Konflikte das Unternehmenswachstum und Partnerschaften beeinflussen können.

Diese Situation zeigt, dass künstliche Intelligenz nicht mehr nur ein technologisches Werkzeug ist. Sie ist zu einem strategischen Gut geworden. Sie verbindet Politik, Ethik, Wirtschaft und nationale Sicherheit. Das Ergebnis dieses Konflikts wird wahrscheinlich beeinflussen, wie KI-Unternehmen und Regierungen in Zukunft zusammenarbeiten. Es könnte zu neuen Gesetzen, klareren Verträgen und stärkeren öffentlichen Debatten darüber führen, wie weit KI gehen sollte.

In einfachen Worten ist dies ein Kampf um Verantwortung und Autorität. Anthropic glaubt, dass Sicherheitsgrenzen notwendig sind. Die Regierung glaubt, dass der Zugang zu fortgeschrittenen Werkzeugen notwendig ist. Beide Seiten denken, dass sie die Zukunft schützen. Die eigentliche Frage ist, wie sie ein Gleichgewicht finden, denn KI wird nicht aufhören zu wachsen. Sie wird mächtiger werden, und solche Konflikte könnten in den kommenden Jahren häufiger werden.