Künstliche Intelligenz ist heute überall. Sie schreibt, berechnet, sagt voraus, fasst zusammen, empfiehlt und gibt sogar Ratschläge. Doch hinter ihren beeindruckenden Fähigkeiten liegt eine stille, aber ernsthafte Sorge: KI kann selbstbewusst klingen, selbst wenn sie falsch ist. Sie kann Antworten generieren, die genau aussehen, aber auf fehlerhaften Annahmen, unvollständigen Daten oder halluzinierten Fakten basieren. In Situationen mit niedrigem Risiko kann dies harmlos sein. In risikoreichen Umgebungen wie Gesundheitswesen, Finanzen, Rechtssystemen oder autonomen Operationen kann es gefährlich sein.

Das Mira-Netzwerk wurde aus genau diesem Spannungsfeld zwischen Intelligenz und Zuverlässigkeit geboren. Seine Vision besteht nicht darin, ein weiteres leistungsstarkes KI-Modell zu schaffen, das um Aufmerksamkeit konkurriert. Vielmehr möchte es ein tiefer liegendes strukturelles Problem lösen – wie machen wir KI-Ausgaben im großen Maßstab vertrauenswürdig?

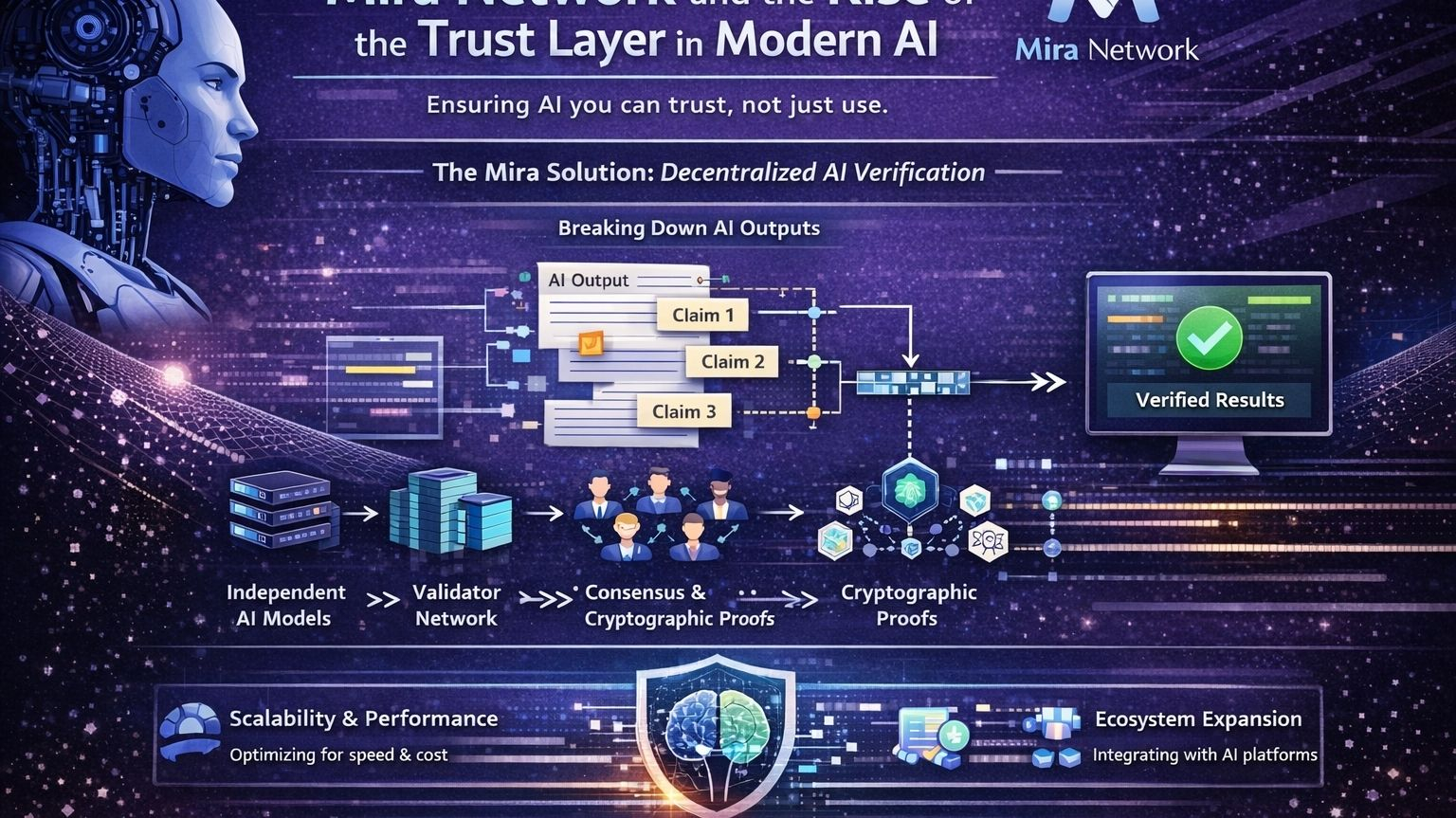

Im Kern sieht Mira eine Welt vor, in der KI-Antworten nicht blind akzeptiert, sondern unabhängig verifiziert werden, bevor sie reale Entscheidungen beeinflussen. Anstatt die Benutzer zu bitten, einem einzigen zentralisierten Anbieter zu vertrauen, stellt sich Mira eine dezentrale Umgebung vor, in der KI-generierte Informationen durch ein Netzwerk von Validatoren gehen. In diesem System kommt Vertrauen nicht von Markenreputation oder Unternehmensautorität. Es kommt von Konsens, kryptographischer Verifizierung und wirtschaftlicher Ausrichtung.

Die Idee ist einfach, aber transformativ. Wenn eine KI eine komplexe Antwort erzeugt, behandelt Mira sie nicht als einen einzigen Textblock. Es zerlegt diese Antwort in kleinere, logische Ansprüche. Jede faktuelle Aussage, jede Schlussfolgerung, jeder statistische Verweis wird zu etwas, das unabhängig geprüft werden kann. Diese Ansprüche werden dann über mehrere KI-Modelle und Validatoren verteilt, die sie separat bewerten. Nur wenn die Übereinstimmung einen definierten Schwellenwert erreicht, finalisiert das System das Ergebnis.

Dieser Ansatz reduziert das Risiko von Single-Model-Bias, systemischer Halluzination oder verborgener Ungenauigkeit erheblich. Anstatt einem “Gehirn” zu vertrauen, verlässt sich das System auf kollektive Intelligenz. Vielfalt wird zum Schutz.

Doch die Mission von Mira geht über das technische Design hinaus. Sie umfasst auch wirtschaftliche Anreize, um ehrliche Teilnahme sicherzustellen. Validatoren im Netzwerk können Tokens als Sicherheit einsetzen, wodurch ihre finanziellen Interessen mit der Genauigkeit ausgerichtet werden. Wenn sie verantwortungsvoll verifizieren, werden sie belohnt. Wenn sie unehrlich oder nachlässig handeln, können Strafen verhängt werden. Dies schafft ein System, in dem Genauigkeit nicht nur gefördert wird – sie ist wirtschaftlich rational.

Stellen Sie sich vor, wie dies in der Praxis funktionieren würde. Eine medizinische KI generiert eine diagnostische Zusammenfassung. Anstatt sofort darauf zu reagieren, wird die Zusammenfassung in einzelne medizinische Ansprüche und Korrelationen zerlegt. Mehrere unabhängige Modelle überprüfen diese Ansprüche. Validatoren vergleichen die Ergebnisse. Konsens wird gebildet. Erst dann wird das Ergebnis bestätigt. Der gleiche Prozess könnte auf Finanzprognosemodelle, automatisierte rechtliche Analysen, industrielle Robotik oder autonome Entscheidungssysteme angewendet werden. In jedem Fall wird die Verifizierung zu einer eingebauten Sicherheitsmaßnahme und nicht zu einem nachträglichen Gedanken.

Was Mira besonders überzeugend macht, ist seine Positionierung. Es versucht nicht, bestehende KI-Anbieter zu ersetzen. Es agiert als Infrastrukturebene – eine Verifizierungsmaschine, die sich mit verschiedenen KI-Systemen integrieren kann. Während traditionelle KI-Prüfungen auf zentralisierten Überprüfungen oder nachträglichen Korrekturen beruhen, führt Mira proaktive, on-chain Validierung ein, bevor die Ergebnisse finalisiert werden.

Natürlich ist der Aufbau eines solchen Systems nicht ohne Herausforderungen. Dezentralisierte Verifizierung führt zu Berechnungskosten. Konsensmechanismen können Latenz erzeugen. Die Zerlegung komplexer Antworten in strukturierte Ansprüche erfordert ein anspruchsvolles Design. Die Balance zwischen Geschwindigkeit und Zuverlässigkeit ist eine fortlaufende technische Herausforderung. Doch die Anerkennung dieser Hürden stärkt die Glaubwürdigkeit der Mission. Innovation auf diesem Niveau erfordert sowohl Ambition als auch Realismus.

Kurzfristig liegt der Fokus von Mira auf der Entwicklung seines Protokolls, der Onboarding von Validatoren und der Pilotierung von Integrationen mit KI-Plattformen. Mittelfristig zielt es darauf ab, sein Ökosystem zu erweitern, sein Wirtschaftsmodell zu verfeinern und die Interoperabilität zu stärken. Langfristig ist die Ambition viel größer – eine grundlegende Vertrauensschicht für künstliche Intelligenz weltweit zu werden.

Die breitere Bedeutung des Mira-Netzwerks liegt in seinem philosophischen Wandel. Jahrelang hat die Gesellschaft KI mit einer Mischung aus Aufregung und Vorsicht betrachtet. Wir bewundern ihre Fähigkeiten, während wir still ihre Genauigkeit in Frage stellen. Mira formuliert die Diskussion neu. Anstatt zu fragen, ob wir KI vertrauen können, fragt es, wie wir Systeme schaffen können, die Vertrauen überflüssig machen – Systeme, in denen die Verifizierung automatisch, transparent und dezentralisiert ist.

Wenn künstliche Intelligenz den Geist unserer digitalen Zukunft repräsentiert, strebt das Mira-Netzwerk danach, sein Immunsystem bereitzustellen – das ständig überprüft, validiert und filtert, bevor Entscheidungen die Realität formen. In einer Welt, die zunehmend von autonomen Systemen beeinflusst wird, könnte eine solche Vertrauensschicht nicht nur die KI verbessern. Sie könnte ihre sichere Evolution definieren.

@Mira - Trust Layer of AI #Mira $MIRA