Die meisten Robotik-Erzählungen konzentrieren sich weiterhin auf Fähigkeitsmeilensteine. Mir geht es mehr um Fehlerökonomie.

In realen Operationen hat jede falsche Handlung eine Kostenoberfläche: direkter Verlust, Wiederherstellungszeit, Schaden am Kundenvertrauen und Governance-Überkopf. Wenn ein System ohne bedeutende Konsequenzen für minderwertiges Verhalten ausfallen kann, werden Zuverlässigkeitsansprüche zur Marketing-Sprache.

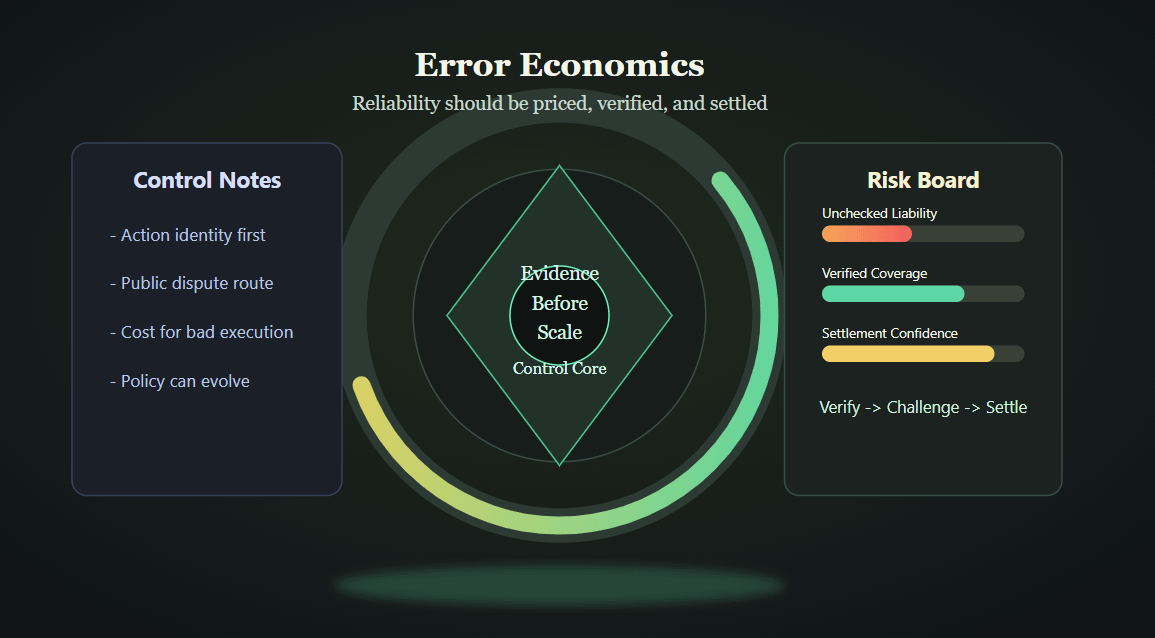

Hier ist die Designthese von Fabric überzeugend. Anstatt Governance als Dokument und Verifizierung als optionale Ergänzung zu behandeln, verbindet das Protokoll Identität, Herausforderungsrechte, Validatorenbeteiligung und wirtschaftliche Konsequenzen in demselben operationellen Loop. In einfachen Worten: Handlungen können überprüft, Streitigkeiten formalisiert und schlechtes Verhalten ist nicht kostenlos.

Dieser mechanismenbasierte Ansatz ist wichtig für Teams, die langlaufende Roboter-Dienste aufbauen. Sie benötigen mehr als Durchsatz. Sie brauchen eine glaubwürdige Kontrollschicht, die Konflikte absorbieren, Beweise ans Licht bringen und Richtlinien weiterentwickeln kann, ohne die Bereitstellung einzufrieren. Andernfalls wird jeder Vorfall zu einem Ad-hoc-Feuergefecht.

Ich denke auch, dass dies der Punkt ist, an dem `$ROBO` strategische Relevanz hat. Nutzen und Governance sind nur dann von Bedeutung, wenn sie an messbares Systemverhalten gebunden sind. Der nützliche Maßstab ist nicht narrative Aufregung. Der Maßstab ist, ob das Netzwerk die Qualität hoch halten kann, während es Druck, Meinungsverschiedenheiten und kontinuierliche Updates bewältigt.

Meine Vorurteile sind klar: Geschwindigkeit ist wertvoll, aber unkontrollierte Geschwindigkeit ist teuer. Das bessere System ist das, das Ergebnisse nachweisen und das Versagen korrekt bewerten kann, bevor sich der Schaden multipliziert.

Würden Sie autonome Roboter-Workflows im großen Maßstab ohne einen öffentlichen Mechanismus zur Anfechtung und Beilegung umstrittener Ergebnisse bereitstellen?

@Fabric Foundation $ROBO #ROBO