Das erste Mal, als ich einen KI-Chatbot benutzt habe, und er mir eine Antwort gab, die sich richtig anfühlte, aber offensichtlich falsch war, habe ich es nicht einfach ignoriert. Es hinterließ einen leisen kleinen Knoten in meinem Gehirn, wie wenn man ein bekanntes Lied hört, das leicht verstimmt gespielt wird. Zu der Zeit wusste ich nicht viel über KI-Verifizierung. Ich wusste nur, dass sich etwas tief unter der Oberfläche ändern musste.

Chatbots sind zum Synonym für konversationelle KI geworden. Sie sind überall in Kundenservice, Vertrieb, Bildung und Unterhaltung. Das Versprechen ist einfach. Sprich mit einer Maschine, wie du mit einer Person sprichst. Doch konversationelle Flüssigkeit und tatsächliche Richtigkeit sind unterschiedliche Dinge. Eine KI kann einfühlsam klingen und dennoch eine Tatsache halluzinieren. Sie kann schön schreiben und dennoch falsch sein. Diese Textur, der Unterschied zwischen richtig klingen und richtig sein, ist das Kernproblem, dem sich MIRA annimmt.

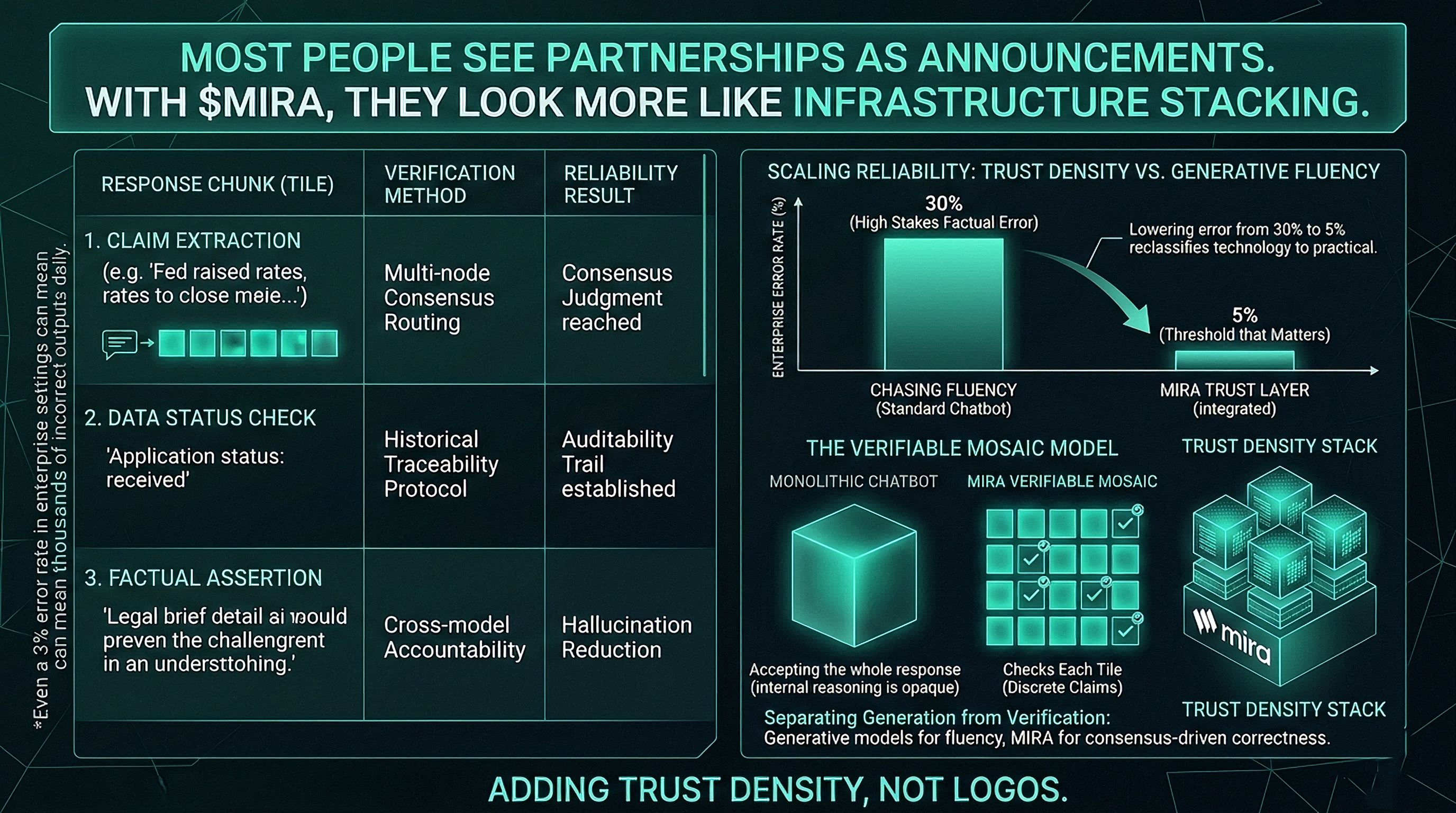

Auf den ersten Blick scheint die Verbesserung von KI-Chatbots ein Leistungsproblem zu sein. Machen Sie Modelle größer, trainieren Sie sie mit mehr Daten, optimieren Sie die Antwortgeschwindigkeit. Viele Projekte verfolgen diesen Weg. Was unter dieser Oberfläche liegt, ist das Vertrauensproblem. Da KI in Arbeitsabläufe eingebettet wird, die wichtig sind, wie rechtliche Dokumente, finanzielle Problemlösung und medizinische Triage, steigen die Kosten für eine falsche Antwort dramatisch. In Unternehmensumgebungen kann selbst eine Fehlerquote von 3 Prozent Tausende von falschen Ausgaben pro Tag bedeuten, was sich in echtem finanziellen, reputativen oder regulatorischen Risiko niederschlägt.

Die Erkenntnis, dass die Grundlage der konversationalen KI Vertrauen und nicht nur Flüssigkeit sein muss, ist Teil dessen, was @mira_network auszeichnet. Die traditionelle Architektur behandelt Chatbots als monolithische Orakel, deren interne Argumentation undurchsichtig ist. MIRA kehrt diese Annahme um. Statt ein Modelloutput für bare Münze zu nehmen, zerlegt es diesen in einzelne Ansprüche, die unabhängig überprüft werden können. Stellen Sie sich die Antwort eines Chatbots als Mosaik vor. Statt das Ganze zu akzeptieren, überprüft MIRA jede Fliese.

Die Aufspaltung einer KI-Antwort in diskrete Teile ist wichtig, weil sie einen amorphen Vertrauensscore in messbare Kontrollpunkte verwandelt. Wenn beispielsweise ein Chatbot sagt: Die Federal Reserve hat die Zinsen im März um 0,25 Prozent erhöht, kann das System diesen Anspruch extrahieren, ihn an mehrere unabhängige Verifizierungs-Knoten weiterleiten und ein Konsensurteil über seine Wahrheit fällen. Dies verwandelt das, was normalerweise eine einzelne, undifferenzierte Antwort ist, in eine Sequenz überprüfbarer Fakten.

Unter diesem Prozess gibt es ein Muster der Fairness, das erwähnenswert ist. KI-Halluzinationen sind nicht zufällig. Sie sind Artefakte statistischer Vorhersage. Das Modell errät das wahrscheinlichste nächste Token basierend auf den Trainingsdaten. Das funktioniert für kreative Prosa. Es versagt in faktischen Kontexten mit hohen Einsätzen. Indem jeder Anspruch durch verschiedene Verifizierungs-Knoten geleitet wird und dann Urteile aggregiert werden, wird eine Schicht der modellübergreifenden Verantwortung eingeführt, die in Standard-Chatbot-Flows nicht typisch ist.

Die Verwendung dieser Methode ändert, wie sich ein Chatbot an der Oberfläche und darunter verhält. An der Oberfläche genießen die Benutzer weiterhin eine konversationelle Schnittstelle. Der Dialog fühlt sich natürlich an und der Kontext wird bewahrt. Darunter trägt jeder Anspruch, der in die Schnittstelle eingebettet ist, nicht nur eine Antwort, sondern auch eine Unterstützung durch dezentralen Konsens. Das verändert die Zuverlässigkeitstextur der Ausgabe.

Unterdessen passt dieser Ansatz zu einem breiteren Trend in der KI, der Generierung von Verifizierung trennt. Generative Modelle sind stark darin, plausible Texte zu erzeugen, aber nicht jeder plausible Text ist wahrheitsgemäß. Verifizierungsnetzwerke wie MIRA füllen diese Lücke, indem sie wirtschaftliche Anreize und Konsensprotokolle einführen, die falsche Ausgaben entmutigen. Dies ist kein technisches Add-on. Es ist ein Wandel in der Architektur von KI-Dialogsystemen.

Ein praktisches Beispiel hilft, dies zu verdeutlichen. Angenommen, Sie verwenden einen KI-Chatbot, der mit #Mira Verifizierung in einen Kundenservice-Workflow integriert ist. Ein Benutzer fragt nach dem Status eines Antrags. Ein typischer Chatbot könnte eine Antwort erzeugen, die selbstbewusst klingt, aber auf veralteten Backend-Daten oder unvollständigem Kontext basiert. Eine von MIRA unterstützte Version zerlegt die Antwort in überprüfbare Elemente wie das Datum, an dem der Antrag eingegangen ist, den aktuellen Statuscode und den nächsten erwarteten Meilenstein, und überprüft dann jedes mit Konsens, bevor sie die endgültige Antwort formuliert. Die Benutzer erhalten nicht nur Antworten, die richtig klingen, sondern auch Antworten, die statistisch und sozial verifiziert sind.

Das bedeutet nicht, dass das System nie irrt. Kein System kann perfekte Genauigkeit beanspruchen. Frühe Anzeichen deuten darauf hin, dass das Schichten von Verifizierung unter konversationaler KI die Rate falscher Behauptungen erheblich senkt. Wenn grundlegende Chatbots im Freien bei messbaren Raten je nach Bereich halluzinieren, kann das Hinzufügen einer Wahrheitprüfungs-Schicht die Fehlerraten näher an die Schwellenwerte bringen, die in geschäftlichen und behördlichen Kontexten wichtig sind. Die Senkung des Fehlers von 30 Prozent auf 5 Prozent ist nicht inkrementell. Es klassifiziert die Technologie von exploratorisch zu praktisch um.

Was mich beeindruckt hat, ist der subtile Wandel darin, wie wir über KI-Interaktionen denken. Traditionell wurden Chatbots danach beurteilt, wie menschlich sie klangen. Heute werden sie zunehmend danach beurteilt, wie zuverlässig sie sind. Dieser Wandel ist leise, aber unmissverständlich. Er spiegelt tiefere Erwartungen von Unternehmens- und Verbraucherbenutzern wider. Die Menschen kümmern sich weniger um Wortfülle und mehr um Überprüfbarkeit. Sie kümmern sich weniger um Stil und mehr um Fundament.

Die Einbeziehung von Verifizierung in die konversationale KI hat auch umfassendere Auswirkungen. Wenn Ausgaben unabhängig auditiert werden können, ermöglicht dies die Überwachung der Einhaltung, die historische Rückverfolgbarkeit und Verantwortlichkeitspfade, die in regulierten Branchen unerlässlich sind. Systeme wie MIRA verbessern nicht nur Chatbots. Sie bauen Vertrauensebenen auf, die auditiert und angefochten werden können. Das stellt ein anderes Reifegrad dar.

Die Märkte reagieren auf diesen Wandel. Token und Protokolle, die an Infrastrukturen gebunden sind, die sich auf zuverlässige Lieferung anstelle von auffälliger Generierung konzentrieren, gewinnen die Aufmerksamkeit von Entwicklern und Institutionen. Die Erzählung rund um Mira spiegelt das wider. Es ist nicht einfach ein weiterer KI-Token. Es ist ein Token, der an ein Netzwerk von Verifizierungsinfrastrukturen gebunden ist, das konversationale KI in die Lage versetzt, Ausgaben zu liefern, die auditiert, herausgefordert und überprüft werden können.

Es gibt offensichtliche Gegenargumente. Einige Entwickler argumentieren, dass dies Latenz oder Komplexität hinzufügt. Die Echtzeitverifizierung kann Überkopf verursachen, insbesondere in zeitkritischen Anwendungen. Das ist gültig und bleibt eine technische Herausforderung. Ob die Verifizierung ohne Kompromisse bei der Reaktionsfähigkeit auf jeden Anwendungsfall skaliert werden kann, bleibt abzuwarten. Die grundlegende Idee, dass Vertrauen der neue Leistungsengpass ist, fühlt sich verdient an.

Im weiteren Muster der Technologie folgen Zuverlässigkeitsschichten normalerweise generativen Schichten. Frühe Internetprotokolle konzentrierten sich auf Konnektivität. Spätere Schichten fügten Verschlüsselung, Identität und Verifizierung hinzu. Was MIRA mit Chatbots tut, ähnelt dem Hinzufügen von SSL zum Web. An der Oberfläche surfen Sie weiterhin. Darunter ist die Verbindung sicher. Im KI-Chat ist die Oberfläche der Dialog. Darunter wird die Wahrheit überprüft.

Chatbots wurden früher danach beurteilt, wie gut sie Menschen nachahmen. Jetzt werden sie danach beurteilt, wie gut sie überprüft werden können. In einer Welt, in der KI in finanzielle, rechtliche und persönliche Entscheidungen eingebettet ist, zählt dieses zweite Maß mehr als Flüssigkeit. Wenn Vertrauen in den Dialog eintritt, verändert sich das Gespräch grundlegend.