Eine Analyse aus der Ich-Perspektive, warum die KI-Verifizierung eine der wichtigsten Infrastruktur-Ebenen in der nächsten Phase autonomer Systeme werden könnte.

Kernidee

Ich denke, Mira wird interessant, in dem Moment, in dem wir die Zuverlässigkeit von KI nicht mehr als UX-Problem betrachten und anfangen, sie als wirtschaftliche Infrastruktur zu behandeln.

Vorbereitet als eine persönliche Langform-Analyse mit Fokus auf KI-Verifizierung, Token-Nutzen, Ökosystem-Richtung und der umfassenderen Investitionsthese rund um vertrauenswürdige autonome Systeme.

Mira auf einen Blick

Was ich in Mira sehe, ist eine These zur verifiziertem Intelligenz: KI sollte nicht nur Ausgaben generieren, sondern auch beweisen, dass diese Ausgaben zuverlässig sind, bevor echte Systeme auf ihnen basieren. Das ist die Linse, die ich für diesen Bericht verwendet habe.

Positionierung

Mira beschreibt sich selbst als Vertrauensschicht für KI, die sich darauf konzentriert, Ausgaben und Handlungen durch kollektive Intelligenz zuverlässig zu machen.

Überprüfungsmodell

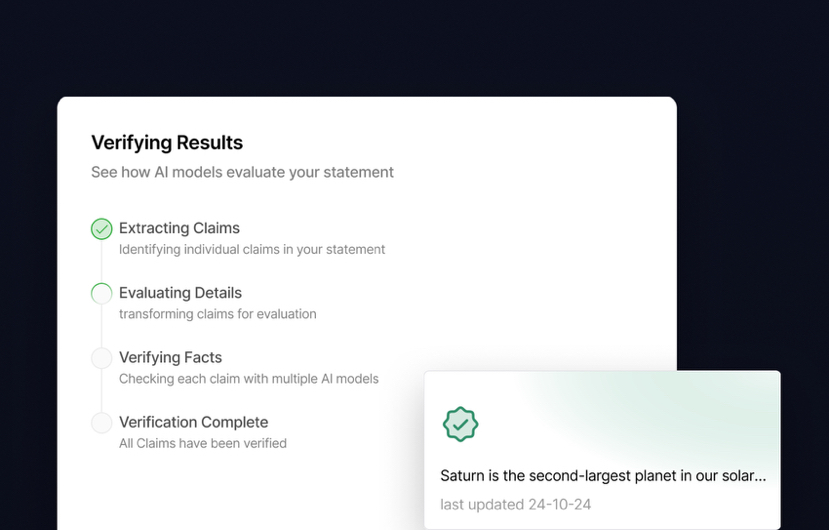

Das Protokoll zerlegt Inhalte in unabhängig überprüfbare Ansprüche und schickt diese Ansprüche durch verteilten Konsens über mehrere Modelle und Validatoren.

Ökonomisches Design

Validatoren setzen Werte ein, verdienen Belohnungen für ehrliche Teilnahme und können für Manipulation oder konstant schlechte Überprüfung bestraft werden.

Produktstrategie

Das Ökosystem umfasst Überprüfungs-APIs, auditable Zertifikate und Anwendungserlebnisse auf Anwendungsebene wie Klok.

Token-Rolle

Das $MIRA Asset ist an Staking, Governance, Belohnungen und Zahlungen für API-Zugang gebunden, anstatt von der Netzwerkfunktion getrennt zu sein.

Der praktische Reiz, meiner Meinung nach, besteht darin, dass Mira versucht, die Überprüfung als benutzbare Infrastruktur zu verpacken, anstatt als rein akademisches Konzept.

Das eigentliche Problem ist nicht die KI-Power, sondern das Vertrauen in die KI.

Ich denke, der Markt hat zu viel Zeit damit verbracht, zu feiern, was KI erzeugen kann, und nicht genug Zeit damit, zu hinterfragen, was KI tatsächlich unterstützen kann. Diese Lücke ist jetzt wichtiger denn je. Wir bewegen uns von KI als Schreibassistentin zu KI als Ausführungsebene. Modelle helfen bereits Menschen, finanzielle Entscheidungen zu treffen, rechtliche Informationen zusammenzufassen, medizinische Daten zu filtern, Arbeitsabläufe zu lenken, Code zu schreiben und zunehmend autonome Agenten zu steuern. In diesem Umfeld ist eine flüssige Antwort nicht dasselbe wie eine zuverlässige Antwort.

Was mir weiterhin auffällt, ist, dass die größte Schwäche der modernen KI nicht Kreativität ist. Es ist Vertrauen ohne Beweis. Ein Modell kann etwas produzieren, das poliert aussieht, intelligent klingt und dennoch auf eine Weise falsch sein kann, die teuer, gefährlich oder unmöglich rechtzeitig zu erkennen ist. Je mehr KI in reale Systeme eingebettet wird, desto mehr hört die Überprüfung auf, ein nettes Add-on zu sein, und beginnt, wie eine Kerninfrastruktur auszusehen.

Genau aus diesem Grund hat Mira meine Aufmerksamkeit erregt. Ich sehe es nicht nur als eine weitere KI-plus-Krypto-Erzählung, die versucht, Hype von beiden Seiten auszuleihen. Ich sehe es als einen Versuch, einen sehr spezifischen Engpass zu lösen: Wie schaffen wir es, KI-Ergebnisse vertrauenswürdig genug zu machen, um in Umgebungen mit höheren Einsätzen verwendet zu werden, ohne Menschen zu zwingen, jedes Ergebnis manuell zu überwachen?

Warum sich Miras Modell für mich anders anfühlt

Die Art und Weise, wie ich Mira verstehe, ist einfach: Es baut eine Überprüfungsebene auf, die zwischen KI-Generierung und realer Handlung sitzt. Anstatt die Benutzer zu bitten, einem Modell, einem Unternehmen oder einem geschlossenen System zu vertrauen, nimmt Mira generierte Inhalte, verwandelt sie in kleinere überprüfbare Ansprüche und sendet diese Ansprüche durch verteilte Überprüfung. Verschiedene Modelle und Validatoren bewerten das Ergebnis, und Konsens wird verwendet, um zu entscheiden, was Bestand hat.

Diese Architektur ist wichtig, weil sie die Quelle des Vertrauens verändert. In den meisten Mainstream-KI-Produkten basiert Vertrauen auf der Marke. Benutzer vertrauen dem Anbieter, oder sie vertrauen der Schnittstelle, oder sie vertrauen dem Ruf der Modellfamilie. Mira drängt das Vertrauen in Richtung Prozess. Wenn eine Antwort zerlegt, überprüft, herausgefordert und durch ein überprüfbares Netzwerk finalisiert werden kann, dann wird das Vertrauen weniger über Marketing und mehr über Beweise definiert.

Ich mag auch, dass dieser Ansatz quellagnostisch ist. Im Whitepaper wird das Protokoll als Möglichkeit beschrieben, KI-generierte Ausgaben zu überprüfen, indem komplexe Inhalte in unabhängig überprüfbare Ansprüche umgewandelt und ein verteiltes Konsens um sie koordiniert wird. Meiner Meinung nach ist das einer der stärksten Teile des Designs. Es verlässt sich nicht auf ein allwissendes Modell, das auf magische Weise perfekt wird. Es akzeptiert, dass einzelne Modelle blinde Flecken haben, und versucht dann, Zuverlässigkeit zu schaffen, indem mehrere Perspektiven gezwungen werden, denselben Anspruch zu prüfen.

Die stärkste Idee innerhalb von Mira ist kollektive Überprüfung

Wenn ich Mira auf eine zentrale Idee reduzieren müsste, wäre es diese: Ein Modell kann beeindruckend sein, aber mehrere Modelle mit übereinstimmenden Anreizen können zuverlässiger sein. Das klingt offensichtlich, hat aber große Auswirkungen. Das Protokoll setzt auf Vielfalt, anstatt vorzugeben, dass ein einzelnes Grenzmodell Halluzinationen, Verzerrungen und Kontextfehler alleine lösen kann.

Hier wird das Projekt interessanter als ein normales Ensemble-Produkt. Miras These ist nicht nur „verwende mehrere Modelle“. Es ist „verwende dezentralen Konsens, damit kein einzelner Akteur die Wahrheit für alle definieren kann.“ Mit anderen Worten, das System ist nicht nur technisch, sondern auch wirtschaftlich und governance-getrieben. Validatoren haben ein persönliches Interesse. Wenn sie unehrlich oder faul handeln, können sie bestraft werden. Wenn sie genau teilnehmen, werden sie belohnt.

Das ist wichtig, weil Vertrauen normalerweise zusammenbricht, wenn die Anreize schwach sind. Ich denke, Mira versteht, dass Zuverlässigkeit nicht nur durch Schnittstellendesign gelöst werden kann. Wenn autonome Systeme Aktionen ausführen sollen, dann braucht das Netzwerk, das diese Aktionen sichert, eine strenge wirtschaftliche Disziplin. In Miras Design ist Überprüfung keine frei schwebende Meinung. Es wird zu einer gesicherten Aktivität mit messbaren Konsequenzen.

„Für KI mit hohen Einsätzen ist die Frage nicht mehr, ob ein Modell antworten kann. Die Frage ist, ob die Antwort die Überprüfung überstehen kann.“

Von Chatbot-Neuheit zu echter Infrastruktur

Was diese Erzählung für mich mächtig macht, ist das Timing. Wir treten in die Phase ein, in der KI nicht mehr nur wertvoll ist, weil sie chatten, entwerfen oder unterhalten kann. Sie wird operationell. Entwickler möchten KI-Tools, die recherchieren, überprüfen, Entscheidungen weiterleiten und mit weniger menschlichem Eingreifen handeln können. Miras eigene Produktstrategie spiegelt diesen Wandel wider. Das Verify-Produkt wird als Möglichkeit präsentiert, autonome KI mit faktischen, zuverlässigen Ergebnissen aufzubauen, während das breitere Ökosystem Anwendungen wie Klok und eine OpenAI-kompatible API umfasst, die Entwicklern Zugang zu mehreren führenden Modellen bietet.

Offizielle Materialien weisen auch auf das Ökosystem-Traktions hin. Mira hat gesagt, dass sein Ökosystem mehr als 4,5 Millionen Benutzer bedient und täglich Milliarden von Token verarbeitet. Ich denke nicht, dass Zahlen allein ein Projekt investierbar machen, aber sie sagen mir etwas Wichtiges: Dies ist nicht nur eine abstrakte Whitepaper-Geschichte. Das Team versucht, die Überprüfung in etwas zu verwandeln, das Entwickler tatsächlich in reale Produkte integrieren können.

Dieser praktische Ansatz ist wichtig für die Akzeptanz. Viele Blockchain-Projekte klingen visionär, bis man fragt, was ein Entwickler heute einfügen kann. Mira scheint zumindest zu verstehen, dass, wenn Überprüfung wichtig sein soll, sie als Infrastruktur verfügbar sein muss und nicht nur als Ideologie. APIs, Integrationen auf Anwendungsebene und auditable Verifizierungszertifikate lassen das Konzept viel näher an benutzbarer Middleware erscheinen als an einem spekulativen Gedankenexperiment.

Wo Blockchain hier wirklich Wert hinzufügt

Ich bin normalerweise vorsichtig, wenn ein Projekt sagt, es kombiniere KI und Blockchain, weil viele Projekte diese beiden Wörter ohne Nachweis, warum beide benötigt werden, zusammenzwingen. Im Fall von Mira denke ich, dass das Blockchain-Element tatsächlich eine klare Rolle hat. Es ist nicht nur für das Branding da. Es dient dazu, Anreize zu sichern, Überprüfungsergebnisse abzuschließen und eine Prüfspur zu erstellen, wie ein Ergebnis erreicht wurde.

Das ist in Sektoren von großer Bedeutung, in denen Erklärbarkeit und Verantwortlichkeit unverhandelbar sind. In den Bereichen Finanzen, rechtliche Werkzeuge, Gesundheitswesen und Unternehmensautomatisierung wollen die Menschen nicht nur eine Antwort. Sie wollen wissen, ob die Antwort überprüft wurde, wer sie überprüft hat, welcher Standard verwendet wurde und ob der Prozess später überprüfbar ist. Miras Design, insbesondere die Idee der kryptografischen Zertifikate und konsensgestützten Ergebnisse, spricht direkt diese Nachfrage an.

Für mich ist das der Unterschied zwischen „KI on-chain“ als Slogan und verifizierter Intelligenz als Infrastruktur. Mira versucht nicht nur, KI irgendwo auf einer Blockchain zu speichern. Es versucht, dezentralen Konsens zu nutzen, um unsichere Ergebnisse in etwas näher an verteidigbare digitale Wahrheit zu verwandeln. Das ist ein viel wertvolleres Angebot, wenn das Ziel darin besteht, autonome Ausführung in Systemen mit hohen Einsätzen zu unterstützen.

Meine Ansicht zum Token und wo der Investitionsfall beginnt

Wenn ich auf die Token-Seite schaue, frage ich nicht nur, ob $MIRA trendet. Ich frage, ob der Token nah genug am wirtschaftlichen Motor des Netzwerks sitzt, um von Bedeutung zu sein, wenn die Nutzung wächst. Basierend auf Projektdokumentationen und Listungsmaterialien hat der Token mehrere Funktionen: Staking für Validatoren, Teilnahme an der Governance, Belohnungen und Zahlungen für API-Zugang. Das ist wichtig, weil es das Asset an Sicherheit und Service-Nachfrage bindet, anstatt es als dekorativen Ticker an eine technische Geschichte zu lassen.

Die Angebotsstruktur ist ebenfalls erwähnenswert. Die Listungsmaterialien von Binance geben die Gesamtmenge mit 1 Milliarde MIRA an, von denen etwa 191,24 Millionen zum Zeitpunkt der Listung im September 2025 im Umlauf waren. Dieses Launch-Profil kann schnell Aufmerksamkeit erzeugen, aber ich denke, die größere Frage ist, was passiert, nachdem der Glanz der Listung verblasst. Für mich hängt der langfristige Fall weniger von den Optiken der Börse ab und mehr davon, ob die Nachfrage nach Überprüfung zu einem realen Markt wird.

Das ist der Teil, zu dem ich immer wieder zurückkomme. Wenn KI-Agenten, Co-Piloten, Unternehmensassistenten und maschinengestützte Arbeitsabläufe alle eine Vertrauensschicht benötigen, bevor sie sicher in großem Maßstab eingesetzt werden können, dann wird die Überprüfung zu einer wiederkehrenden wirtschaftlichen Aktivität. Wenn Mira auch nur einen bedeutenden Teil dieser Schicht erfasst, hört das Projekt auf, eine Nischenidee zu sein, und wird zu Infrastruktur mit Gebührenflüssen, Staking-Nachfrage und Ökosystem-Schwerkraft. Dort wird die Token-Erzählung für mich viel interessanter.

Was ich weiterhin genau beobachte

Obwohl ich die These mag, denke ich nicht, dass dieser Bereich eine kostenlose Durchfahrt erhält. Überprüfung ist schwierig, und es wird schwierig bleiben. Die erste Herausforderung ist die Leistung. Jedes System, das zusätzliche Überprüfungsebenen hinzufügt, muss beweisen, dass der Gewinn an Zuverlässigkeit die Latenz und die Kosten wert ist. Wenn die Überprüfung zu langsam oder zu teuer ist, verwenden Entwickler sie möglicherweise nur in Nischenfällen, anstatt sie zur Norm zu machen.

Die zweite Herausforderung ist die Markterschließung. Viele Benutzer interagieren immer noch lässig mit KI, was bedeutet, dass sie möglicherweise nicht sofort zu schätzen wissen, warum Überprüfung wichtig ist, bis etwas schiefgeht. Mira könnte früh sein, so wie Cybersicherheit früh war – essenziell, aber nicht vollständig geschätzt, bis Misserfolge schmerzhaft genug werden, um Nachfrage zu erzwingen.

Die dritte Herausforderung ist der Wettbewerbsdruck. Sobald der Bedarf an vertrauenswürdiger KI offensichtlich wird, werden mehr Infrastrukturspieler in den Überprüfungsstapel einsteigen. Große KI-Labore könnten versuchen, ähnliche Systeme zu internalisieren. Anbieter von Unternehmensmiddleware könnten ihre eigenen Vertrauensschichten bündeln. Daher ist für mich die Ausführung genauso wichtig wie die Vision. Mira hat ein starkes Konzept, muss jedoch im Laufe der Zeit weiterhin Distribution, Entwicklerakzeptanz und Netzwerkglaubwürdigkeit verteidigen.

Mein Fazit

Meine ehrliche Ansicht ist, dass $MIRA interessant ist, weil es nicht der lautesten Version der KI-Erzählung nachjagt. Es zielt auf die fehlende Schicht darunter ab. Ich denke, dort werden oft die wertvollsten Möglichkeiten gefunden – nicht in der auffälligsten Anwendung, sondern in der Infrastruktur, die die nächste Welle nutzbar macht.

Wenn autonome KI sich wirklich von Assistenten zu Agenten und von Agenten zu Ausführungssystemen entwickelt, dann wird Vertrauen zu einem Markt an sich. In dieser Welt ist der Gewinner nicht nur das Modell, das den meisten Text erzeugen kann. Es könnte das Netzwerk sein, das dem Markt sagen kann, welche Ergebnisse behandelt werden sollen. Daher betrachte ich Mira als mehr als eine Token-Geschichte. Ich sehe es als eine Wette darauf, dass verifizierte Intelligenz zu einer erforderlichen Schicht der digitalen Wirtschaft wird.

„KI kann erzeugen. Aber der nächste echte Schutzwall könnte den Netzwerken gehören, die verifizieren können.“

„In einer Welt, die sich in Richtung autonome Ausführung bewegt, ist Vertrauen kein Merkmal mehr. Es ist Infrastruktur.“

Für mich ist das die klarste Art, das Projekt zu rahmen. Mira versucht, KI nützlich zu machen, nicht nur indem sie es intelligenter macht, sondern indem sie es verantwortlich macht. Und wenn das funktioniert, ist der adressierbare Markt viel größer als eine App, ein Chatbot oder eine zyklusspezifische Erzählung.

Letzte Erkenntnis

Meine Ansicht ist, dass #Mira nicht versucht, zu gewinnen, indem es KI lauter macht. Es versucht, KI zuverlässig genug zu machen, um dort eingesetzt zu werden, wo Fehler tatsächlich von Bedeutung sind. Wenn der Markt beginnt, Überprüfung als wiederkehrende Serviceebene zu schätzen, könnte das eine viel größere Kategorie werden, als die meisten Menschen heute erwarten.