Das nächste KI-Rennen geht nicht nur um Intelligenz

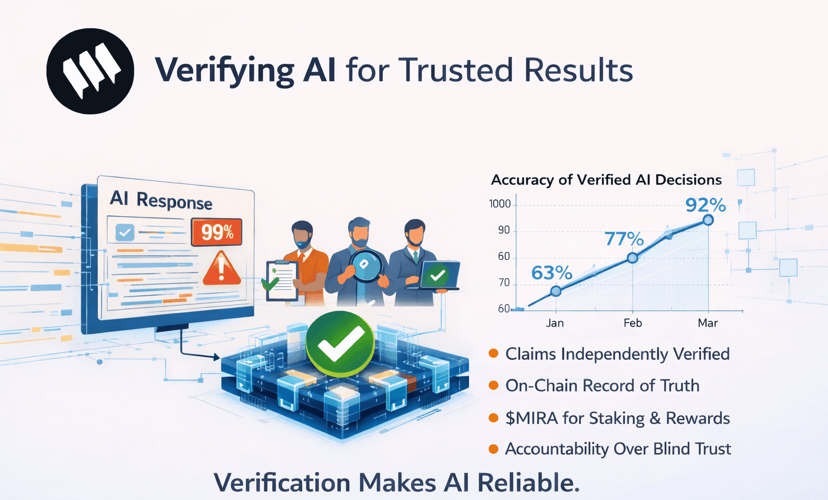

Je mehr ich das Mira-Netzwerk studiere, desto mehr habe ich das Gefühl, dass die echte Chance hier missverstanden wird. Viele Menschen sprechen immer noch über KI, als ob das einzige, was zählt, die Modellqualität, die Geschwindigkeit oder die rohe Denkfähigkeit ist. Aber ich denke nicht, dass der nächste große Engpass nur die Intelligenz ist. Ich denke, es ist Vertrauen. Miras eigene Positionierung basiert auf genau dieser Idee: eine Vertrauenschicht für KI aufzubauen, indem Ausgaben und Aktionen durch kollektive Intelligenz verifiziert werden, anstatt die Benutzer zu bitten, einem einzigen Modell oder Anbieter blind zu vertrauen.

Das ist mir wichtig, weil wir in eine Phase übergehen, in der KI nicht mehr nur Texte entwirft oder allgemeine Fragen beantwortet. Sie wird in Arbeitsabläufe, Produkte, Entscheidungen und schließlich in autonome Agenten eingebettet, die Aktionen in Live-Systemen auslösen können. An diesem Punkt ist eine beeindruckende Antwort nicht genug. Sie muss zuverlässig sein. Miras Whitepaper beschreibt ein dezentrales Verifizierungsprotokoll, das komplexe von KI erzeugte Inhalte in unabhängig überprüfbare Ansprüche umwandelt, diese Ansprüche dann durch verteilten Konsens über verschiedene Modelle und incentivierte Teilnehmer überprüft. Das ist eine viel ernsthaftere Grundlage, als einfach zu hoffen, dass ein leistungsfähiges Modell oft genug die Dinge richtig macht.

Ich denke nicht, dass der größte KI-Gewinner das Modell sein wird, das am klügsten klingt. Ich denke, es wird das System sein, das Intelligenz zuverlässig genug macht, um darauf zu vertrauen.

Was Mira tatsächlich löst

Das zentrale Problem, das Mira angeht, ist einfach zu beschreiben und schwer zu lösen: KI kann selbstbewusst klingen, während sie falsch ist. Das ist nicht nur ein Branding-Problem für die Branche. Es wird zu einem echten Infrastrukturproblem, sobald KI in finanzieller Logik, Entwicklerwerkzeugen, Forschungs-Pipelines, automatisierter Ausführung oder in jeder Umgebung eingesetzt wird, in der Fehler nachgelagerte Kosten verursachen. Mira sagt ausdrücklich, dass es KI zuverlässig macht, indem es Ausgaben und Aktionen bei jedem Schritt mithilfe kollektiver Intelligenz überprüft, und seine Forschungsunterlagen konzentrieren sich darauf, Halluzination und Vorurteile durch verteilte Verifizierung anstelle einer Einzelmodell-Autorität zu reduzieren.

Was ich an diesem Rahmen mag, ist, dass er Vertrauen als ein Protokollproblem und nicht als ein Öffentlichkeitsproblem behandelt. Die meisten zentralisierten KI-Systeme arbeiten immer noch wie Black Boxes. Ein Unternehmen trainiert das Modell, führt die Inferenz durch und verlangt von allen anderen, das Ergebnis zu akzeptieren. Mira kehrt diese Struktur um. Laut dem Whitepaper zerlegt es Ausgaben in kleinere Ansprüche, lässt diese Ansprüche von mehreren unabhängigen Modellen und Validatoren überprüfen und aggregiert dann die Ergebnisse zu einem Konsens-Ergebnis. Mit anderen Worten, es versucht, Verifizierung zur Norm des Systems zu machen, anstatt nachträglich optional.

Warum das in der Ära der KI-Agenten wichtiger ist

Ich denke, Mira wird viel wichtiger, wenn man aufhört, KI als Chatbot-Kategorie zu betrachten und anfängt, sie als Agenten-Kategorie zu sehen. KI-Agenten werden zunehmend so gestaltet, dass sie Informationen abrufen, Werkzeuge aufrufen, Arbeitsabläufe ausführen, Entscheidungen weiterleiten und schließlich Aktionen innerhalb digitaler Wirtschaften verwalten. Sobald das passiert, ist Halluzination nicht mehr nur „schlechte Ausgabe“. Es wird zu einem operationellen Risiko. Miras offizielle Materialien rahmen das Netzwerk wiederholt als Infrastruktur für vertrauenslose KI-Ausführung und verifizierte Intelligenz, einschließlich Partnerschaftsansagen, die es als Verifizierungsschicht für On-Chain- und Ökosystem-KI-Anwendungen positionieren.

Das ist genau der Grund, warum ich denke, dass Mira langfristig eine stärkere Relevanz hat als viele KI-Narrative, die sich nur auf die Generierung konzentrieren. Wenn ein Agent Geld bewegen, Risiken analysieren, eine Governance-Aktion einreichen oder helfen soll, mehrstufige Logik zu koordinieren, dann muss Zuverlässigkeit Teil der Architektur sein. Mira versucht, diese Architektur zu werden. Nicht der Teil, der die Antwort schreibt, sondern der Teil, der überprüft, ob die Antwort es wert ist, vertraut zu werden, bevor sie weiter nach unten bewegt wird.

Das Verifizierungsmodell ist das Kernstück der These

Was mir am meisten auffällt, ist, dass Mira nicht nur behauptet, „KI zu verbessern“. Es schlägt ein spezifisches Design vor, wie Vertrauen erzeugt werden kann. Das Whitepaper besagt, dass das Protokoll Inhalte in unabhängig überprüfbare Ansprüche umwandelt, diese Ansprüche durch verteilten Konsens unter verschiedenen KI-Modellen leitet und wirtschaftliche Anreize plus technische Sicherheitsmaßnahmen nutzt, um ehrliche Überprüfung zu fördern. Diese Struktur ist wichtig, weil sie nicht auf eine dominante Intelligenzquelle angewiesen ist. Sie verlässt sich auf Kreuzprüfungen, Konfliktlösung und Anreizabgleich.

Ich denke, dass der Diversitätsansatz einer der am meisten unterschätzten Teile des Projekts ist. Verschiedene Modelle haben unterschiedliche blinde Flecken, unterschiedliche Vorurteile und unterschiedliche Fehlerarten. Wenn ein System falsch ist, kann ein anderes es erfassen. Wenn ein Modell übergreift, kann ein anderes konservativer sein. Mira versucht, diese Diversität von einer Belästigung in eine Verifizierungsmaschine zu verwandeln. Für mich ist das viel näher daran, wie echtes Vertrauen in komplexen Systemen funktioniert: nicht durch eine einzige Autorität, sondern durch geschichtete Überprüfung und strukturierte Herausforderungen.

In hochriskanter KI ist die Frage nicht nur „Kann das Modell antworten?“ Es ist „Wer hat die Antwort überprüft, bevor es wichtig wurde?“

Warum das Netzwerkdesign praktischer erscheint, als die Leute annehmen

Ein weiterer Grund, warum ich Mira ernst nehme, ist, dass es nicht nur ein theoretisches Papier ist. Das Projekt hat eine aktive entwicklerfreundliche Infrastruktur rund um das Netzwerk. Die Dokumente beschreiben ein SDK, das eine einheitliche Schnittstelle zu mehreren Sprachmodellen mit Routing-, Lastenausgleichs- und Flow-Management-Funktionen bietet. Die Plattform hat auch API-Token-Erstellung, Nutzungstracking und Entwicklerwerkzeuge, was mir sagt, dass Mira versucht, diese Verifizierungsschicht nutzbar zu machen, nicht nur konzeptionell elegant.

Diese praktische Schicht ist sehr wichtig. Viele Projekte in KI x Krypto klingen interessant, bis man die einfache Frage stellt: Kann ein Entwickler das heute tatsächlich in ein Produkt integrieren? Mira scheint zumindest auf eine Antwort hinzuarbeiten, die konkreter ist als die meisten. Die Dokumente zeigen funktionierende Wege für den API-Zugang und die Modelloperationen, während die Hauptseite und das Schreibportal die gleiche These über verifizierte Intelligenz und vertrauenslose KI-Systeme immer wieder verstärken. Diese Konsistenz zwischen Forschung, Messaging und Werkzeugen macht das Projekt für mich kohärenter.

Das Token macht mehr Sinn, wenn ich es als Netzwerk-Infrastruktur betrachte

Ich denke auch, dass $MIRA leichter zu verstehen wird, wenn ich aufhöre, es als typisches KI-Token zu betrachten und anfange, es als ein Vertrauensnetzwerk-Asset zu betrachten. Miras MiCA-Benachrichtigungsdokument besagt, dass das Token für das Staking im Verifizierungsprozess, die Teilnahme an der Governance, Belohnungen und Zahlungen für den API-Zugang zum Netzwerk gedacht ist. Knotenbetreiber, die KI-Modelle zur Verifizierung betreiben, werden erwartet, das Token zu staken, und Entwickler können es als Zahlungsmethode für dezentrale KI-Verifizierungsfähigkeiten nutzen. Das verleiht dem Token eine Infrastrukturrolle anstatt einer rein narrativen.

Dieser Teil ist wichtig, weil ich immer die gleiche Frage bei diesen Projekten stelle: Ist das Token tatsächlich an das Netzwerkverhalten gebunden oder nur an eine Geschichte angehängt? Im Fall von Mira präsentiert die offizielle Dokumentation zumindest einen direkten Zusammenhang zwischen Staking, Validierung, Governance und Nutzung. Das garantiert nicht automatisch langfristigen Erfolg, macht das Design aber glaubwürdiger. Wenn das Netzwerk wächst, soll das Token im zentralen Vertrauenskreislauf sitzen, anstatt außerhalb davon.

Warum der Delegator- und Ökosystemansatz wichtig ist

Eine Sache, die ich an Mira interessant finde, ist, dass es nicht nur mit Modellentwicklern oder Protokolldesignern spricht. Es öffnet auch Teilnahmewege rund um sein Verifizierungsnetzwerk. Miras eigene Schreiben zum Delegatorenprogramm rahmen das Netzwerk als eine grundlegende Verifizierungsschicht für vertrauenslose KI-Systeme und positionieren breitere Gemeinschaftsbeteiligung als Teil der Sicherung und Skalierung dieser Infrastruktur. Selbst ohne einen vollständigen Verifizierungs-Knoten zu betreiben, können Menschen weiterhin wirtschaftlich und sozial mit dem Wachstum des Netzwerks verbunden werden.

Für mich ist das strategisch klug. Eine Vertrauensschicht wird stärker, wenn sie nicht nur technisch fundiert, sondern auch sozial eingebettet ist. Je mehr Entwickler, Validatoren, Delegierte und Ökosystempartner sich auf dieselben Verifizierungsbahnen verlassen, desto verteidigbarer wird das Netzwerk. Miras jüngste Schreiben zu Partnerschaften, Stipendien und Ökosystemkampagnen deuten darauf hin, dass es versucht, dieses breitere Kreislaufsystem zu schaffen, anstatt ein Nischenforschungsprojekt zu bleiben.

Die größere Idee: Mira versucht, den Kontext vertrauenswürdig zu machen

Wenn ich herauszoome, denke ich, dass das Tiefste, was Mira aufbaut, nicht nur das Überprüfen von Ausgaben ist. Es ist vertrauenswürdiger Kontext für autonome Systeme. Die echte Schwäche vieler Agenten besteht nicht darin, dass sie keine Logik ausführen können. Es ist, dass sie Logik auf unzuverlässigen oder schlecht fundierten Informationen ausführen. Wenn Mira eine Schicht werden kann, in der Ansprüche verifiziert, nachvollziehbar und wirtschaftlich gesichert sind, dann hören Agenten auf, im informativen Nebel zu agieren, und beginnen, auf etwas näher am gemeinsamen Wahrheitsgrund zu agieren. Das ist meine Interpretation der Architektur, die im Whitepaper und den Produktmaterialien beschrieben wird.

Dieser Wandel ist viel größer, als er klingt. Er bewegt KI-Systeme von „probabilistischen Werkzeugen, die nützlich sein können“ hin zu „prüfbaren Systemen, die in ernsteren Umgebungen vertraut werden können.“ Ich denke, diese Unterscheidung wird zunehmend wichtig, wenn On-Chain-Agenten, finanzielle Automatisierung und KI-gestützte Anwendungen reifen. Mira positioniert sich genau an dieser Schnittstelle.

Der wahre Vorteil für autonome KI könnte nicht aus mehr Vertrauen kommen. Er könnte aus besserer Verifizierung kommen.

Die Risiken sind weiterhin real

Das gesagt, denke ich nicht, dass diese These unkritisch gelesen werden sollte. Verifizierung in großem Maßstab ist schwierig. Latenz spielt eine Rolle. Kosten sind wichtig. Konsenssysteme können Reibung hinzufügen. Und es gibt immer die Frage, ob Entwickler dezentrale Verifizierung schnelleren, einfacheren zentralisierten Optionen vorziehen. Mira hat eine überzeugende These, aber der Markt wird trotzdem testen, ob Vertrauen wichtig genug ist, damit Bauherren dafür konsequent bezahlen. Das ist meine Schlussfolgerung aus der Natur des Produkts und der Herausforderung bei der Akzeptanz, eher als eine Behauptung, die Mira direkt aufstellt.

Es gibt auch das breitere Kategorierrisiko rund um KI x Krypto. Viele Projekte sprechen über Dezentralisierung, Verifizierbarkeit und Infrastruktur, aber nur eine kleinere Anzahl schafft es, unverzichtbar zu werden. Für Mira besteht die langfristige Frage darin, ob die Verifizierung zu einer Standardschicht wird, in die viele Apps und Agenten integriert werden, oder ob sie eine spezialisierte Funktion bleibt, die nur in bestimmten hochvertrauenswürdigen Umgebungen genutzt wird. Ich denke, das ist die entscheidende Frage zur Akzeptanz von hier an. Das ist eine Schlussfolgerung, die auf der erklärten Rolle des Netzwerks und den aktuellen Entwicklerwerkzeugen basiert.

Mein abschließender Standpunkt zu Mira

Meine ehrliche Meinung ist, dass Mira eines der intellektuell solidesten Projekte in der Kategorie der KI-Infrastruktur ist, weil es sich auf ein Problem konzentriert, das mit der Zeit nur dringlicher wird. Die Branche hat bereits viele Systeme, die generieren können. Was ihr noch fehlt, ist eine robuste, skalierbare Möglichkeit zur Verifizierung, Prüfung und wirtschaftlichen Sicherung dessen, was generiert wird, bevor es in kritischen Abläufen vertraut wird. Mira versucht, genau das aufzubauen.

Deshalb sehe ich $MIRA nicht als einfach ein weiteres KI-Narrativ-Asset. Ich sehe es eher als eine Wette auf die Idee, dass verifizierte Intelligenz eine echte Kategorie von Infrastruktur wird. Wenn das passiert, könnte Miras Rolle viel größer werden, als die Leute heute erwarten. Denn sobald KI-Agenten und KI-gestützte Anwendungen beginnen, echten Wert zu bewegen, wird Vertrauen nicht mehr ein nettes Extra sein. Es wird Teil der Basis-Schicht.

@Mira - Trust Layer of AI #Mira $MIRA