Die wahre Geschichte des Mira-Netzwerks findet sich nicht im Whitepaper. Sie findet sich bei dem Studenten, der eine zuverlässige Testfrage bekam, dem Trader, der kein Geld bei einem schlechten AI-Signal verlor, und dem Forscher, der endlich einen Bericht verstand, den sie wochenlang vermieden hatten.

Die Kluft zwischen Infrastruktur und Erfahrung

Es gibt eine Version der Geschichte des Mira-Netzwerks, die in Krypto-Forschungszirkeln immer wieder erzählt wird, und sie ist so genau, wie sie ist. Sie behandelt das Trainingsdilemma, die Ensemble-Modellarchitektur, die kryptografischen Zertifikate, den Proof of Verification-Konsensmechanismus und die statistische Spieltheorie, die dishonest nodes daran hindert, das System auszutricksen. Diese Version ist wichtig. Sie erklärt, warum das Design strukturell solide ist und warum der Ansatz wirklich anders ist als alles, was die Mainstream-AI-Industrie gebaut hat.

Aber es gibt eine andere Version der Geschichte, die selten im selben Atemzug erzählt wird, und es ist die, die tatsächlich erklärt, wie dieses Protokoll von Millionen von Menschen genutzt wurde, bevor sein Token jemals an einer öffentlichen Börse gestartet wurde. Das ist die Version über echte Anwendungen, echte Nutzer und echte Probleme, die gelöst werden, wenn Sie etwas Praktisches auf einer ehrlichen Infrastruktur aufbauen.

Das Netzwerk unterstützt über vier Millionen Nutzer, die neunzehn Millionen Anfragen pro Woche bearbeiten und täglich drei Milliarden Token über Anwendungen wie Klok, Learnrite, Astro und Creato verarbeiten. Diese Zahlen sind nicht erschienen, weil die Leute auf einem Token spekulierten. Sie erschienen, weil Entwickler Dinge bauten, die die Menschen tatsächlich nutzen wollten, und diese Dinge funktionierten besser als die Alternativen, weil verifizierte KI-Ausgaben einfach zuverlässiger sind als unverifizierte. Ich denke, das ist der ehrlichste Verständnisansatz von Mira — nicht in der Architektur, sondern in der Erfahrung der Menschen, die die Architektur bedient.

Klok: Wenn ein Chatbot tatsächlich seine eigene Arbeit überprüft

Die am weitesten verbreitete Anwendung im Ökosystem von Mira ist Klok, und ihre Designphilosophie erfasst etwas Wichtiges darüber, wie Mira über die Beziehung zwischen KI-Fähigkeit und KI-Zuverlässigkeit denkt. Die meisten KI-Chatbots geben Ihnen ihre beste Vermutung als fertige Antwort. Klok gibt Ihnen eine beste Vermutung, die bereits gegen andere Modelle getestet wurde, bevor sie Sie erreicht.

Nutzer können Fragen stellen und gleichzeitig Antworten von verschiedenen KI-Modellen erhalten. Die App überprüft alle Antworten, um sicherzustellen, dass sie korrekt sind, bevor sie den Nutzern angezeigt werden. Wenn Sie zwanzig Freunde empfehlen, schalten Sie Klok PRO frei, was Ihnen mehr tägliche Verwendungen und zusätzliche Funktionen wie Suche und Bildverarbeitung bietet. Der Empfehlungsmechanismus ist clever, weil er frühe Nutzer in Befürworter verwandelt, aber das interessantere Merkmal ist, was passiert, bevor die Antwort erscheint. Die Nutzererfahrung von Klok ist auf den ersten Blick vertraut. Sie stellen eine Frage, Sie erhalten eine Antwort. Die unsichtbare Schicht darunter trennt es von allem anderen: Diese Antwort hat bereits einen verteilten Test auf Genauigkeit bestanden oder ist durchgefallen, bevor sie angezeigt wird.

Durch die Verwendung mehrerer KI-Modelle, darunter GPT-4o mini, Llama 3.3 und DeepSeek-R1 sowie Miras Konsensmechanismus stellt Klok sicher, dass die Nutzer jedes Mal genaue Antworten erhalten. Über fünfhunderttausend Nutzer vertrauen bereits darauf, dass es zuverlässigen KI-Chat bietet. Fünfhunderttausend Nutzer in einer einzigen Anwendung, bevor der Hauptnetz-Token überhaupt gestartet wurde, deutet darauf hin, dass die Verifizierungsschicht nicht nur ein technisches Nice-to-have ist. Es ist ein echtes Wertversprechen, das die Nutzer erkennen, wenn sie es erleben, auch wenn sie die Architektur dahinter nicht artikulieren können, warum die Antworten vertrauenswürdiger erscheinen.

Klok belohnt Nutzerinteraktionen mit Mira-Punkten, die Teil eines größeren Anreizsystems sind. Nutzer verdienen Punkte für die Interaktion mit verifizierter KI, und dies hat seit dem Start im Februar 2025 zu exponentiellem Wachstum geführt. Klok ist mehr als ein Chatbot; es ist ein Blueprint dafür, wie wir in Zukunft sicher mit KI interagieren werden.

Learnrite: Die Zahlen, die in der Bildung am wichtigsten sind

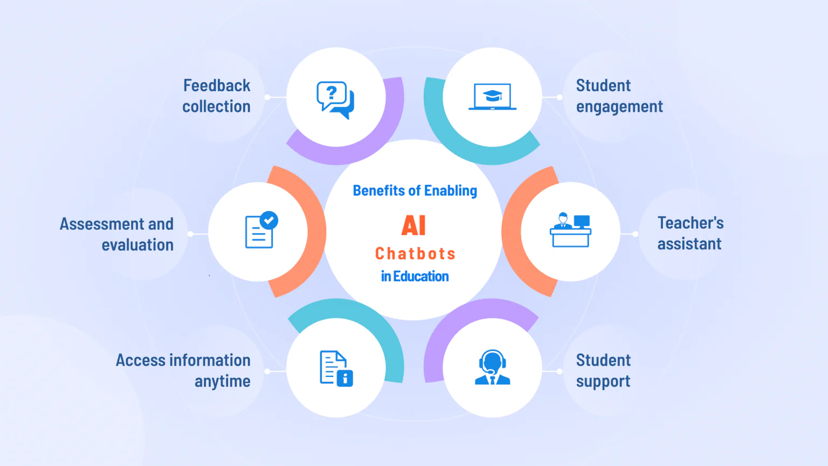

Wenn Klok demonstriert, wie sich verifizierte KI in informellen täglichen Gesprächen anfühlt, demonstriert Learnrite, was es bedeutet, in einer Umgebung zu arbeiten, in der Fehler echte Konsequenzen haben. Bildung ist eines dieser Bereiche, in denen das Halluzinationsproblem der KI kein mildes Ärgernis mehr ist, sondern ein ernstes Anliegen wird. Ein Schüler, der sich auf eine Prüfung mit KI-generierten Übungsfragen vorbereitet, hat keine Möglichkeit zu wissen, ob diese Fragen genau sind, ob die Erklärungen korrekt sind oder ob die Konzepte fair dargestellt wurden. Eine falsche Übungsfrage hilft nicht nur nicht; sie führt aktiv in dem Moment irre, in dem der Schüler am empfänglichsten dafür ist, etwas Neues zu lernen.

LearnRite verwendet KI, um Bildungsinhalte zu generieren, jedoch mit einem Twist. Jede Frage oder Erklärung durchläuft Miras dezentrale Verifizierungsschicht, wo mehrere Modelle die Informationen abgleichen, um die Halluzinationsraten von achtundzwanzig Prozent auf viertel Prozent zu senken.

Lassen Sie diese Reduktion einen Moment lang sacken. Eine Fehlerquote von achtundzwanzig Prozent in KI-generierten Bildungsinhalten bedeutet, dass mehr als jede vierte Frage auf irgendeine bedeutende Weise fehlerhaft ist. Bei viertel Prozent ist die Zahl immer noch nicht null, aber sie stellt eine Transformation dessen dar, was es bedeutet, KI in einem Bildungskontext zu verwenden. Der Inhalt, der die Schüler erreicht, hat einen Filter durchlaufen, den kein einzelnes KI-Modell auf sich selbst anwenden könnte.

Learnrite erreicht eine Genauigkeit von achtundneunzig Prozent mit Miras Konsensmechanismus, wobei mehrere KI-Modelle sich gegenseitig verifizieren und Fehler auffangen, bevor sie die Schüler erreichen. Sie haben die Kosten um neunzig Prozent gesenkt und gleichzeitig sichergestellt, dass die Bildungsinhalte vertrauenswürdig sind. Der Nachweis in der realen Welt, dass verifizierte KI funktioniert. Die Kostenreduzierung neben der Genauigkeitsverbesserung ist das Detail, das die Wirtschaftlichkeit des gesamten Bereichs verändert. Die Verifizierung durch Konsens aus unterschiedlichen Modellen ist nicht nur genauer als die Generierung durch ein einzelnes Modell; in vielen Konfigurationen ist sie erheblich günstiger, weil sie einfachere Anfragen von teuren Grenzmodellen ablenkt und größere Modelle nur dort verwendet, wo die Komplexität wirklich erforderlich ist.

Die Delphi-Orakel-Geschichte: Das Unmögliche in Unentbehrliches verwandeln

Von all den Anwendungen, die auf Miras Infrastruktur aufgebaut sind, ist die Geschichte des Delphi-Orakels diejenige, die am ehrlichsten erfasst, was die Technologie tun kann und wie schwierig es war, dorthin zu gelangen. Die Forschung von Delphi Digital ist einige der respektiertesten institutionellen Analysen in der Krypto-Industrie. Ihre Berichte sind dichte, technische, zitationreiche Dokumente, die Kapital bewegen, wenn sie veröffentlicht werden. Einen KI-Assistenten dazu zu bringen, zuverlässig Fragen zu diesem Inhalt zu beantworten, war kein Nice-to-have-Feature. Es war ein Produkt, das entweder mit echter Genauigkeit funktionierte oder gar nicht existieren konnte, da Delphis Markenreputation vollständig auf intellektueller Ehrlichkeit basierte.

Selbst als das Team versuchte, die zu diesem Zeitpunkt fortschrittlichsten Modelle zu verwenden, waren die wirtschaftlichen Kosten prohibitiv. Jede komplexe Anfrage zu Token-Ökonomien oder DeFi-Mechanismen konnte mehrere Dollar kosten, um sie zu verarbeiten. Nach monatelanger Frustration beendeten sie letztendlich das Projekt. Die Verwirklichung eines KI-Assistenten musste auf fortschrittlichere Technologien warten.

Das Projekt wurde neu gestartet, als die Infrastruktur von Mira verfügbar wurde. Das Team entwickelte drei Innovationen darauf: ein Routingsystem, das einfache Anfragen vollständig von KI-Modellen fernhält, eine Cache-Schicht, die häufig gestellte Fragen und deren verifizierte Antworten speichert, anstatt sie jedes Mal neu zu berechnen, und Miras Verifizierungs-API, die die Genauigkeit überprüft, bevor Antworten den Nutzern angezeigt werden. Das Ergebnis war ein Produkt, das sowohl kostengünstig zu betreiben als auch vertrauenswürdig genug war, um den Namen Delphi zu tragen.

In nur wenigen Wochen nach dem Start wurde Delphi Oracle zu einem unverzichtbaren Werkzeug für den Zugang zu Inhalten über Kryptowährungsforschung. Heute interagiert der durchschnittliche Nutzer mindestens einmal täglich mit dem Oracle, und diese Zahl wächst weiter. Was das Team am meisten überraschte, war, wie es die Lesegewohnheiten der Nutzer veränderte. Zuvor gaben die Nutzer das Lesen auf, wenn sie auf komplexe Teile stießen, aber jetzt stellen sie dem Oracle Fragen, erhalten Erklärungen und lesen weiter, anstatt den Inhalt mitten im Prozess abzubrechen.

Diese Verhaltensänderung ist tatsächlich das interessanteste Ergebnis des gesamten Projekts. Das Oracle half nicht nur bestehenden Lesern, den Inhalt schneller zu verstehen. Es veränderte die Beziehung zwischen Lesern und der Forschung selbst, indem es dichte institutionelle Materialien in etwas Interaktives und Navigierbares verwandelte, anstatt etwas zu sein, das überflogen oder aufgegeben werden sollte. Verifizierte KI machte eine Wissenskategorie zugänglicher, ohne sie weniger rigoros zu machen.

Fere AI, GigabrainGG und die Herausforderungen der finanziellen Verifizierung

Die Anwendungen, bei denen die Verifizierung am wichtigsten ist, sind auch die, bei denen die Konsequenzen eines Fehlers am konkretesten sind. In der Bildung führt ein Fehler zu einer falschen Antwort in einem Test. In persönlichen Gesprächen produziert ein Fehler eine irreführende Antwort. In der Finanzwelt führt ein Fehler zu einem finanziellen Verlust, und je nach Umfang des Handels kann dieser Verlust katastrophal sein, in einer Weise, die durch kein Maß an entschuldigendem Nachfragen rückgängig gemacht werden kann.

Fere AI löst ein großes Problem in der Krypto-Welt: Kann man KI vertrauen, um mit Ihrem Geld umzugehen? Die Auto-Trade-Plattform von GigabrainGG verwendet KI, um Handelsentscheidungen zu treffen, aber mit Miras Verifizierung wissen die Händler, dass die KI keine kostspieligen Fehler machen wird. Smart Trading wurde gerade smarter.

Die Partnerschaft, die am 26. Februar 2025 bekannt gegeben wurde, spielte eine Schlüsselrolle im Wachstum von Mira, indem sie die vertrauenslose Verifizierungstechnologie von Mira mit der KI-Handelsplattform von GigabrainGG integrierte, wodurch die Genauigkeit und Zuverlässigkeit von Handelssignalen verbessert wurde. Dies stärkte Miras Glaubwürdigkeit im KI- und Blockchain-Bereich und erweiterte seine Marktreichweite, indem es die Technologie in einem hochriskanten finanziellen Anwendungsfall validierte.

Hier wird die abstrakte Behauptung, dass verifizierte KI bessere Ergebnisse produziert, auf die direkteste Weise testbar. Ein Handelssignal ist entweder profitabel oder nicht. Das Vertrauen der KI ist irrelevant, wenn die zugrunde liegende Behauptung, auf der sie agiert, halluziniert ist. Miras Verifizierungsschicht, angewendet auf Finanz-KI, beseitigt nicht das Risiko, nichts kann das tun, aber sie beseitigt eine Kategorie von Fehlern, die vollständig vermeidbar sind: die zuversichtlich falsche Antwort, die ein einzelnes Modell ohne das Überprüfen, das den Fehler auffängt, bevor es zu einer Transaktion wird, geliefert hätte.

Magnum Opus: Das Zuschussprogramm, das auf Baumeister setzt

Das Verständnis des Ökosystems, das Mira zusammengestellt hat, erfordert das Verständnis einer der strategisch entscheidenden Entscheidungen, die das Team Anfang 2025 traf. Anstatt alle Anwendungen selbst zu entwickeln, verpflichteten sie sich, zehn Millionen Dollar zu investieren, um die Bauherren zu finanzieren, die auf ihnen aufbauen würden.

Die Magnum Opus-Initiative ist darauf ausgelegt, bahnbrechende Projekte an der Schnittstelle von generativer KI, autonomen Systemen und dezentraler Technologie zu beschleunigen. Mit zehn Millionen Dollar in rückwirkenden Zuschüssen zielt das Programm darauf ab, Gründer zu befähigen, die die Zukunft der KI-Entwicklung gestalten. Teams, die an KI-Agenten, maschinellen Lernmodellen und anderen KI-gestützten Lösungen arbeiten, werden besonders von Miras Infrastruktur und Unterstützung profitieren.

Die rückwirkende Struktur ist hier wichtig. In den meisten Zuschussprogrammen ist die Finanzierung prospektiv: Sie beantragen Geld, um etwas zu bauen, das noch nicht existiert, und erhalten es basierend auf einem Pitch. Rückwirkende Zuschüsse belohnen Dinge, die bereits funktionieren, was die Anreizstruktur grundlegend verändert. Bauherren müssen einem Gremium nicht mehr überzeugen, dass ihre Idee einen Wert hat. Sie müssen nachweisen, dass ihre Implementierung funktioniert. Es ist ein anspruchsvollerer Standard, der ein zuverlässigeres Ökosystem hervorbringt.

Im Gegensatz zu traditionellen Accelerator-Programmen bietet Magnum Opus ein hochgradig individuell angepasstes Erlebnis, das auf die spezifischen Anforderungen jedes Teams zugeschnitten ist. Die Teilnehmer haben Zugang zu erheblichen rückwirkenden Zuschüssen und direkten Einführungen zu Investoren. Sie profitieren auch von Sprechstunden mit Mira-Ingenieuren und Führungskräften im KI-Sektor sowie von technischer Unterstützung und Produktentwicklung.

Frühe Teilnehmer umfassen bereits KI- und Technik-Pioniere von Google, Epic Games, OctoML, MPL, Amazon und Meta, was die Qualität der Talente unterstreicht, die im Projekt erwartet werden. Wir sprechen nicht von krypto-nativen Gründern, die blockchain-first Produkte für blockchain-audiences bauen. Wir sprechen von Ingenieuren, die KI-Systeme im großen Maßstab in einigen der anspruchsvollsten technischen Umgebungen der Welt betrieben haben und sich entschieden haben, auf Miras Infrastruktur aufzubauen, weil sie ein Problem lösen, das sie aus direkter Erfahrung erkennen.

Von 2,5 Millionen auf 4,5 Millionen: Wachstum, das sich kumuliert

Die Wachstumsdynamik von Miras Nutzerbasis im Jahr 2025 erzählt eine Geschichte, die der Tokenpreis allein nicht erfassen kann. Im März 2025 gab das Team einen Meilenstein von 2,5 Millionen Nutzern und zwei Milliarden täglich verarbeiteten Token bekannt. Bis die Hauptnetz gestartet wurde im September und der Token zu handeln begann, hatten sich diese Zahlen erheblich erhöht.

Die Verarbeitung von zwei Milliarden Token täglich entspricht ungefähr der Hälfte des Inhalts von Wikipedia, generiert 7,9 Millionen Bilder oder verarbeitet über 2.100 Stunden Videoinhalte pro Tag. Dieser Meilenstein zeigt die wachsende Marktnachfrage nach KI, die autonom ohne menschliche Aufsicht operieren kann.

Karan Sirdesai, Mitbegründer und CEO von Mira, sagte: „Dieses Wachstum bestätigt, dass wir die kritische Barriere für das transformative Potenzial von KI ansprechen. Die heutige KI bleibt durch die Notwendigkeit der menschlichen Verifizierung eingeschränkt. Wir beseitigen diesen Engpass, um wirklich autonome Intelligenz zu ermöglichen, die in hochriskanten Szenarien unabhängig operieren kann.“

Bis Ende 2025 verarbeitete das Netzwerk täglich drei Milliarden Token über eine Nutzerbasis, die auf über vier Millionen gewachsen war. Dieses Wachstum geschah über Anwendungen, die grundlegend unterschiedliche menschliche Bedürfnisse bedienen: informelle Gespräche über Klok, institutionelle Forschung über Delphi Oracle, Bildungsinhalte über Learnrite, finanzielle Entscheidungen über Fere AI und GigabrainGG, persönliche Beratung über Astro, Beziehungsgesellschaft über Amor, soziale Inhaltserstellung über Creato.

Astro macht KI-Ratschläge sicherer, indem es Spekulation durch validierte Argumentation ersetzt. Egal, ob Sie eine Universität wählen, einen Trennungsprozess durchlaufen oder Ihre Finanzen verwalten, Astro soll Ihr vertrauenswürdiger, verifizierter Berater sein und nicht nur ein cleverer Chatbot. In einer Welt, in der Fehlinformationen und KI-Halluzinationen anfällige Nutzer irreführen können, ist Astro vertrauenswürdig durch Design.

Die Breite dieses Anwendungsportfolios ist selbst eine Form von Beweis. Wenn verifizierte KI nur in engen technischen Bereichen funktionierte, würde das Ökosystem entsprechend eng aussehen. Die Tatsache, dass sie erfolgreich auf alles angewendet wird, von institutioneller Krypto-Forschung bis hin zu persönlicher Lebensberatung, deutet darauf hin, dass das Kernwertangebot, KI, die überprüft wurde, bevor Sie sie sehen, tatsächlich universell ist.

Wie eine echte Wachstumsstory wirklich aussieht

Es gibt eine Tendenz in der Krypto-Welt, Infrastrukturprojekte hauptsächlich durch die Linse ihrer Token-Leistung zu bewerten. Nach dieser Kennzahl sieht die Geschichte von MIRA im Jahr 2025 schwierig aus. MIRA gehört zu den am schlechtesten abschneidenden neuen Token von 2025, die um über neunzig Prozent von ihrer TGE-Bewertung gefallen sind. Die Gemeinschaft ist zwischen einer engagierten Gruppe gefangen, die ihre AI-Verifizierungsthese verteidigt, und der harten Realität, einer der am stärksten abgewerteten Token-Starts von 2025 zu sein.

Aber wenn Sie sich vom Preischart zurückziehen und schauen, was gebaut wurde, sieht das Bild anders aus. In weniger als zwei Jahren nach der Gründung hat das Team ein funktionierendes Hauptnetz, ein Entwickler-SDK, ein Zuschussprogramm, das Talente aus einigen der weltweit führenden KI-Unternehmen anzieht, neun aktive Partneranwendungen in völlig unterschiedlichen Bereichen, vier Millionen aktive Nutzer, drei Milliarden täglich verarbeitete Token und eine technische Genauigkeitsverbesserung von siebzig Prozent auf sechsundneunzig Prozent, die durch Produktionsdaten statt Laborbenchmarks verifiziert wurde, geliefert. Dies geschah vor der institutionellen Akzeptanz, bevor die regulatorische Klarheit, die allmählich um die Anforderungen zur KI-Verifizierung entsteht, und bevor der breitere Markt verstand, warum Verifizierung Infrastruktur und nicht ein Feature ist.

Langfristige Gläubige befürworten ihre grundlegende Rolle als Vertrauensschicht für verifizierbare KI. Analysten sehen echte Grundlagen, warnen jedoch, dass Timing und Token-Entsperrungen entscheidende Wild Cards sind.

Das Timing-Argument hat zwei Seiten. Die Marktbedingungen, die MIRA's Token-Preis Ende 2025 und Anfang 2026 feindlich gegenüber standen, haben keinen Einfluss darauf, ob KI-Systeme zuverlässige Verifizierung benötigen werden, während sie tief in Entscheidungen eingebettet werden, die die Gesundheit, Finanzen, rechtlichen Ergebnisse und Bildung der Menschen betreffen. Die regulatorische Richtung ist klar. Der historische Rekord von KI-Fehlern häuft sich. Die Nachfrage nach auditierbarer, eingebetteter, kontinuierlicher Verifizierung ist keine Frage des Ob, sondern des Wann.

Die Frage, die nur die Zukunft beantworten kann

Wenn Sie Miras Ökosystem als Ganzes betrachten, betrachten Sie eigentlich ein Live-Experiment, ob Vertrauen auf Infrastruktur-Ebene in KI eingebaut werden kann, anstatt es als nachträgliche Überlegung anzubringen. Die neun Anwendungen, die im Netzwerk laufen, sind ein Proof-of-Concept in einem Maßstab, den die meisten Infrastrukturprojekte nie vor ihrem Token-Launch erreichen, geschweige denn vor einem bedeutenden institutionellen Bewusstsein.

Der Student, der eine zuverlässige Übungsfrage von Learnrite erhält, weiß nichts von der Proof of Verification. Der Händler, der ein schlechtes Signal über GigabrainGG vermieden hat, hat das Whitepaper nicht gelesen. Die Person, die Astro nutzt, um über eine schwierige Entscheidung nachzudenken, kam nicht wegen der Krypto-Ökonomie zu Mira. Sie kamen, weil die Ergebnisse vertrauenswürdiger waren als das, was sie anderswo bekamen, und sie blieben, weil diese Vertrauenswürdigkeit über die Zeit hinweg bestand.

So sieht Infrastruktur aus, wenn sie tatsächlich funktioniert. Kein Token-Preischart, kein Discord voller Spekulation, sondern vier Millionen Menschen, die leise Anwendungen verwenden, die besser funktionieren, weil etwas Unsichtbares unter ihnen die Arbeit überprüft, bevor sie auf dem Bildschirm angezeigt wird. Die Frage, die nur die Zukunft beantworten kann, ist, ob die Welt diese unsichtbare Schicht für das erkennen wird, was sie ist, bevor die Kosten dafür, sie nicht zu haben, zu offensichtlich werden, um ignoriert zu werden.

@Mira - Trust Layer of AI $MIRA #Mira