Ich habe nicht begonnen, auf Mira zu achten, weil ich dachte, wir bräuchten ein weiteres KI-Protokoll.

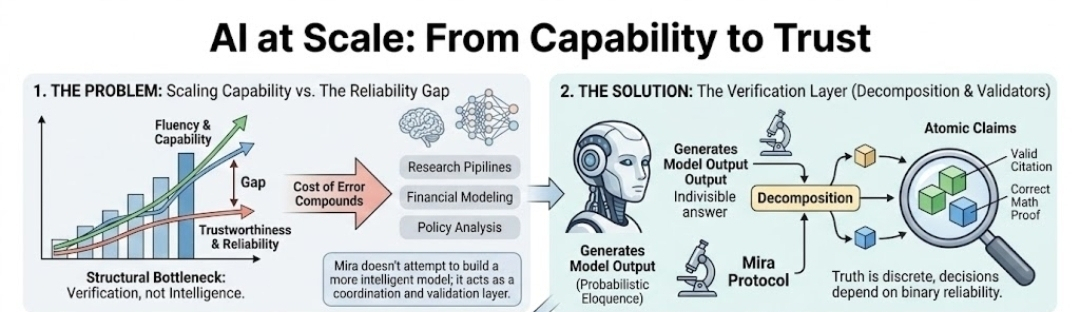

Ich begann, aufmerksam zu werden, weil ich etwas Unbehagliches bemerkte: KI fühlt sich bereits genug intelligent an. Was sie nicht ist, ist zuverlässig genug.

Es gibt einen Unterschied.

Wenn ich heute KI benutze, hinterfrage ich nicht, ob sie Inhalte generieren kann. Das kann sie offensichtlich. Die eigentliche Frage ist, ob ich diesen Inhalt ohne persönliche Überprüfung vertrauen kann. Und im Moment ist die ehrliche Antwort nein.

Hier passt das Mira-Netzwerk hinein.

Mira versucht nicht, mit Modellbauern zu konkurrieren. Es ist kein weiteres LLM. Es ist ein dezentralisiertes Verifikationsprotokoll, das zwischen KI-Ausgaben und Vertrauen sitzt. Diese Positionierung ist subtil, verändert jedoch das gesamte Gespräch.

Anstatt anzunehmen, dass die Antwort eines Modells eine einzelne, unteilbare Wahrheit ist, zerlegt Mira Ausgaben in diskrete Ansprüche. Diese Ansprüche werden dann über ein Netzwerk unabhängiger Validatoren verteilt. Jeder Validator - der selbst ein KI-System sein kann - bewertet den Anspruch separat. Konsens wird durch Blockchain-Koordination und wirtschaftliche Anreize erreicht.

Also verschiebt sich das Vertrauensmodell.

Du verlässt dich nicht mehr auf das Vertrauen eines einzelnen Modells. Du verlässt dich auf verteilte Zustimmung unter stake-backed Bedingungen. Die Validierung wird on-chain aufgezeichnet. Anreize belohnen eine genaue Bewertung und bestrafen nachlässige Genehmigungen.

Wahrheit wird wirtschaftlich durchgesetzt, anstatt reputationsbasiert angenommen zu werden.

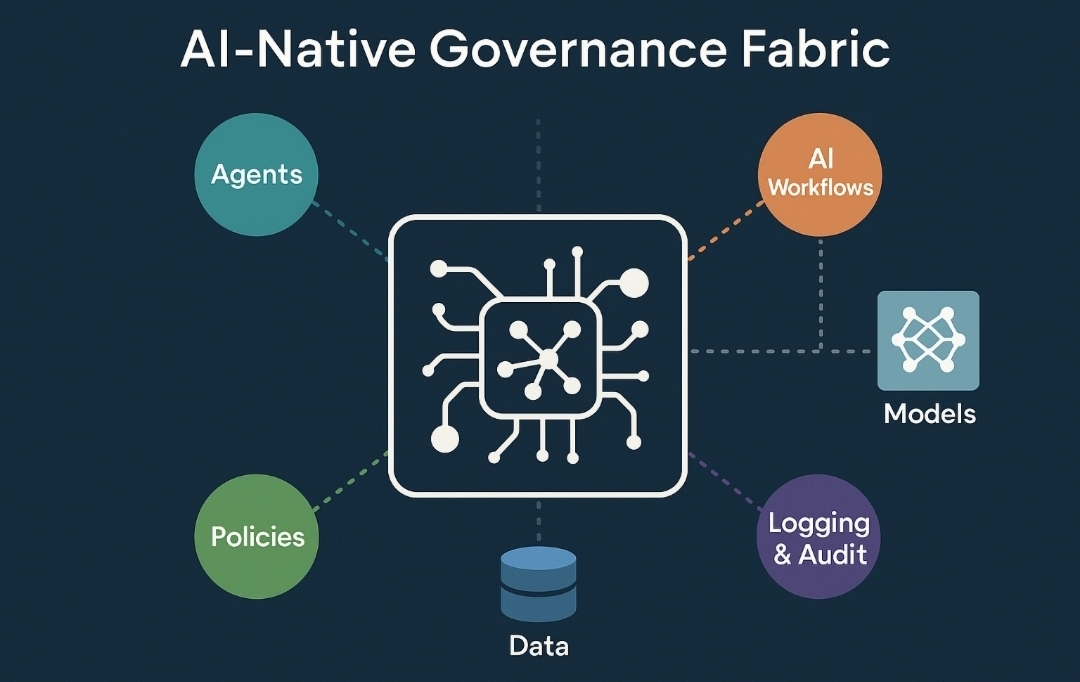

Was dies über Theorie hinaus macht, ist die Richtung, in die sich KI bewegt. Wir sehen bereits frühe Formen autonomer Agenten, die Portfolios verwalten, mit DeFi interagieren, Arbeitsabläufe automatisieren und Forschung generieren. Sobald KI von Vorschlägen zu Ausführungen übergeht, hört „wahrscheinlich korrekt“ auf, ausreichend zu sein.

Mira geht nicht davon aus, dass Halluzinationen mit größeren Modellen verschwinden. Es akzeptiert, dass probabilistische Ausgaben inhärent zu den aktuellen Architekturen sind. Anstatt das auf der Modellebene zu bekämpfen, baut es eine Zuverlässigkeitsschicht darum.

Das fühlt sich realistisch an.

Natürlich bringt diese Architektur Komplexität mit sich. Die Zerlegung von Argumentation in verifizierbare Ansprüche ist nicht trivial. Verifikation fügt Latenz hinzu. Die Vielfalt der Validatoren muss aufrechterhalten werden, um korrelierte Verzerrungen zu verhindern. Kollusionsrisiken müssen sorgfältig gemindert werden.

Aber die zugrunde liegende These ist schwer zu ignorieren:

Intelligenz ohne Verifikation skaliert nicht sicher.

Zentralisierte Moderation wird nicht ausreichen, wenn KI zur Infrastruktur wird. Reputation wird nicht ausreichen, sobald Systeme autonom in finanziellen, rechtlichen und industriellen Bereichen operieren.

Mira positioniert sich als die Vertrauensschicht für KI – indem es probabilistische Modell-Ausgaben in konsensbasierte Informationen umwandelt.

Es ist nicht auffällig. Es jagt nicht nach Modellbenchmarks. Es löst eine strukturelle Schwäche in der aktuellen Bereitstellung von KI.

Und wenn KI weiterhin auf autonome Ausführung zusteuert, werden Verifikationsprotokolle wie Mira nicht optional erscheinen.

Sie werden notwendig erscheinen.