@QuackAI Agent Infrastruktur & Wirtschaft: Reputation als Kern des autonomen Vertrauens

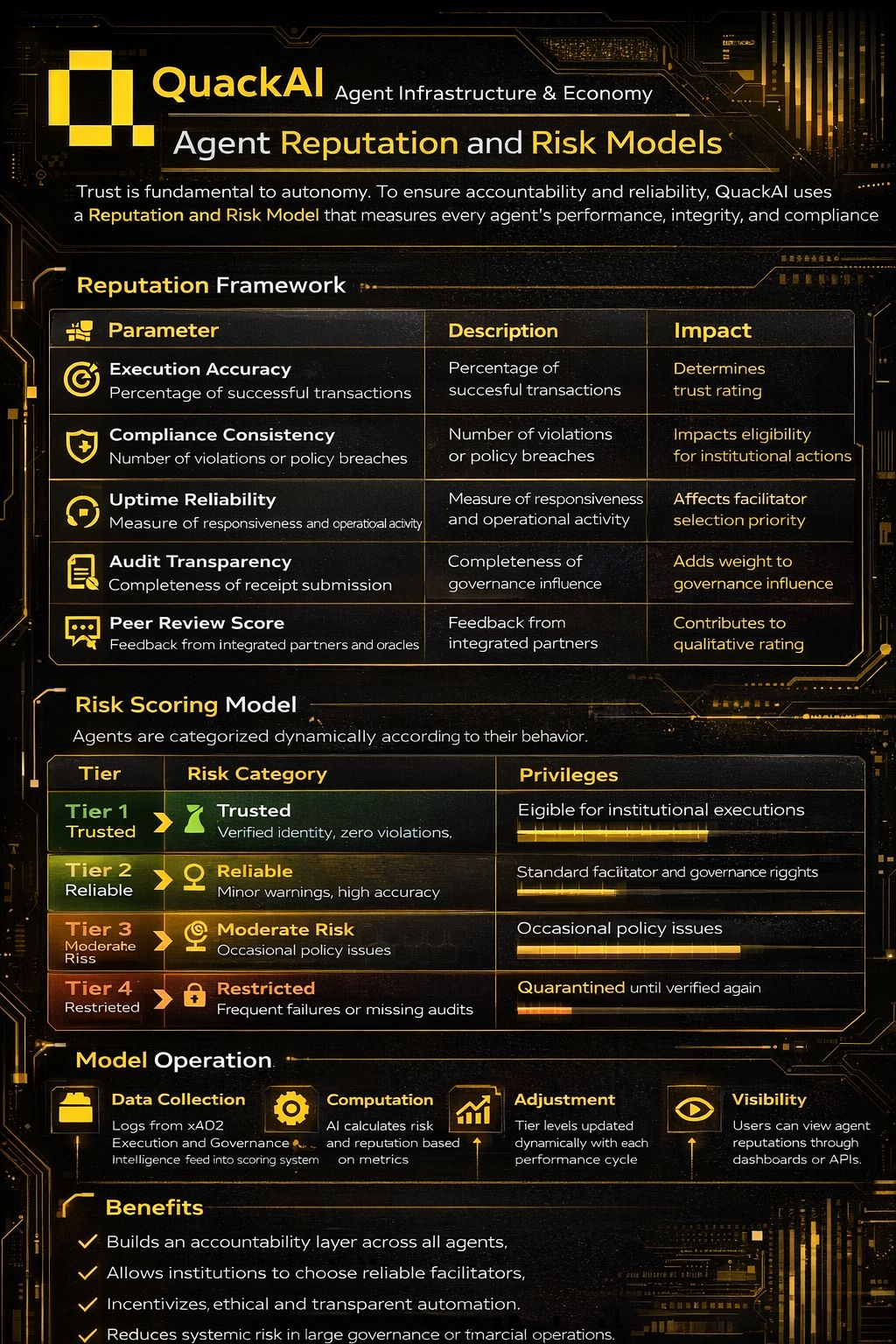

Autonomie ohne Verantwortung ist systemisches Risiko. QuackAI addressiert dies durch ein strukturiertes Agenten-Reputations- und Risikomodell, das kontinuierlich Leistung, Integrität und Compliance misst.

Das Reputation Framework bewertet fünf Kernparameter: Ausführungsgenauigkeit (Transaktions Erfolgsquote), Compliance-Konsistenz (Verstöße gegen Richtlinien), Betriebszeitzuverlässigkeit (operative Reaktionsfähigkeit), Prüftransparenz (Vollständigkeit der Belege) und Peer-Review-Score (Partner- und Oracle-Feedback). Diese Kennzahlen bilden einen quantifizierbaren Vertrauensindex für jeden Agenten.

Basierend auf Verhalten und Leistungsgeschichte werden Agenten dynamisch in vier Stufen kategorisiert:

Tier 1 – Vertrauenswürdig: Verifizierte Identität, null Verstöße, starke Prüfgeschichte. Berechtigt zur institutionellen Ausführung.

Tier 2 – Zuverlässig: Hohe Genauigkeit mit kleinen Warnungen. Volle Teilnahme an Vermittlung und Governance.

Tier 3 – Mäßiges Risiko: Richtlinieninkonsistenzen. Eingeschränkter Zugang zu Belohnungen.

Tier 4 – Eingeschränkt: Wiederholte Fehler oder fehlende Prüfungen. Vorübergehend quarantiniert.

Das Modell funktioniert in Zyklen: Ausführungs- und Governance-Protokolle speisen die Bewertungsmaschine, KI berechnet den Ruf neu, Stufen passen sich automatisch an und Ergebnisse bleiben über Dashboards oder APIs sichtbar.

Das Ergebnis ist strukturelles Vertrauen. Institutionen können Vermittler mit messbarer Zuverlässigkeit auswählen. Agenten werden zu ethischer Automatisierung angeregt. Systemisches Risiko wird im großen Maßstab reduziert.

In QuackAI ist der Ruf nicht symbolisch – er ist rechnerisch, dynamisch und durchsetzbar.

$Q