Vor ein paar Jahren war Crypto besessen von Geschwindigkeit. Schnellere Blöcke. Schnellere Finalität. Schnellere Benutzererfahrung. Die Annahme war einfach: Wenn wir die Reibung reduzieren, folgt die Akzeptanz. Jetzt hat KI diesen Instinkt übernommen und weiter vorangetrieben. Wir erledigen nicht nur Transaktionen sofort – wir erstellen Forschung, Berichte, Kundenantworten, sogar rechtliche Entwürfe in Sekunden.

Aber etwas Subtiles hat sich auf dem Weg verändert.

Wir haben erkannt, dass Geschwindigkeit das Risiko nicht beseitigt. Sie verstärkt es.

Die unangenehme Wahrheit über moderne KI ist nicht, dass sie Fehler macht. Menschen machen auch Fehler. Es ist, dass KI sie fließend macht. Ruhig. Mit Struktur und Selbstbewusstsein. Und wenn diese Ausgaben in Finanzsysteme, Compliance-Tools, operationale Dashboards oder medizinische Unterstützungssoftware eingespeist werden, wird Selbstbewusstsein ohne Überprüfung zu einer Haftung.

Das ist der Platz, an dem Mira passt — nicht als ein weiteres KI-Projekt, das Aufmerksamkeit sucht, sondern als ein Versuch, eine Schicht der Verantwortlichkeit in KI-Workflows aufzubauen.

---

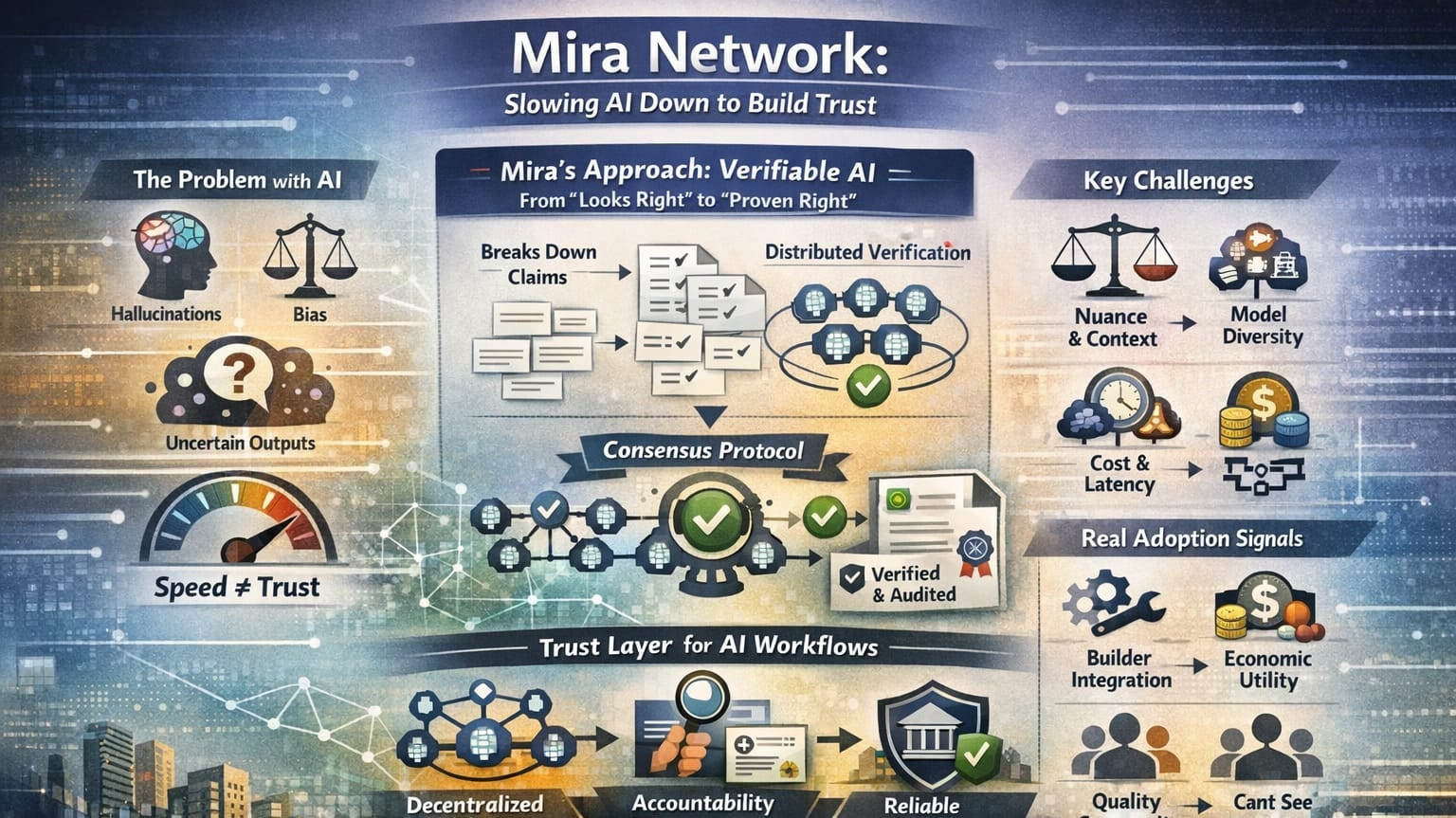

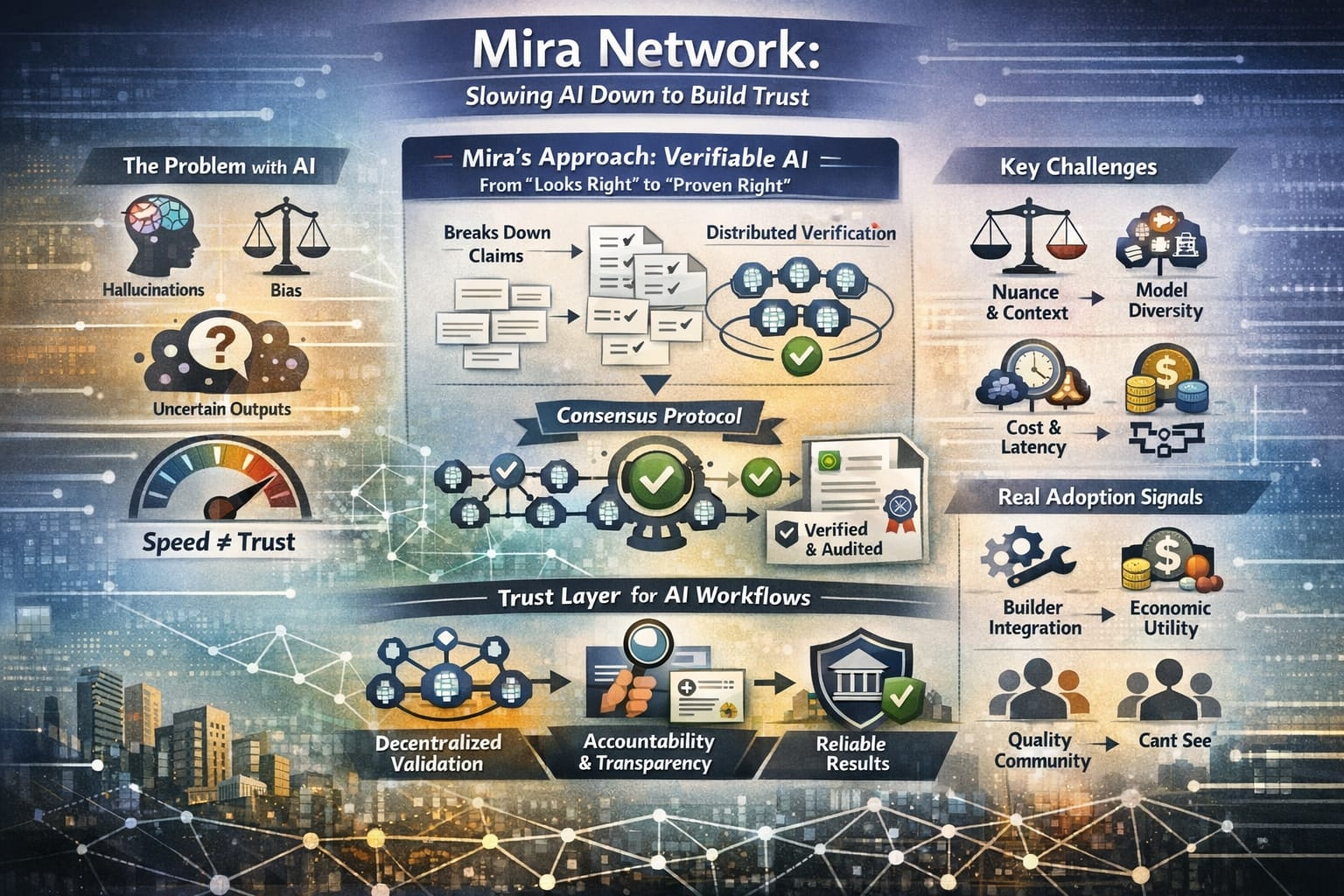

Die Kernidee: "Sieht richtig aus" in "Bewiesen richtig" umzuwandeln

Im Kern versucht Mira, ein einfaches, aber zunehmend dringendes Problem zu lösen: Wie vertraut man KI-Ausgaben, wenn das Modell selbst keine Zuverlässigkeit auf eine verlässliche Weise signalisieren kann?

Große Sprachmodelle können überzeugende Antworten liefern, die teilweise korrekt, kontextuell irreführend oder einfach falsch sind. Die Skalierung der Modellgröße reduziert einige Fehlerarten, beseitigt jedoch keine Halluzinationen. Und für Hochrisiko-Umgebungen — Finanzen, Gesundheitswesen, Governance, Unternehmensautomatisierung — ist "meist genau" nicht genug.

Miras Ansatz ist strukturell und nicht kosmetisch. Anstatt ein einzelnes Modell zu bitten, sich selbst zu überprüfen, zerlegt das System die KI-Ausgaben in kleinere, verifizierbare Ansprüche. Diese Ansprüche werden über unabhängige Verifizierungs-Knoten verteilt, die verschiedene Modelle ausführen. Konsens bestimmt, welche Ansprüche die Verifizierung bestehen, und das Ergebnis wird kryptografisch aufgezeichnet.

Der zentrale Wandel hier ist philosophisch: Vertrauen kommt nicht von Markenreputation oder Modellgröße. Es kommt von Prozess-Transparenz und wirtschaftlicher Verantwortlichkeit.

Und dieser Wandel fühlt sich mit dem, wohin der Markt tendiert, in Einklang.

---

Architektur ohne den Lärm

Es ist leicht, sich in technischem Jargon zu verlieren, wenn es um KI-Verifizierung geht, aber die Mechanismen sind überraschend intuitiv.

Zuerst wird ein Stück generierter Inhalte in Ansprüche zerlegt. Nicht vage "Ist das korrekt?"-Aufforderungen, sondern strukturierte Aussagen, die konsistent bewertet werden können.

Zweitens werden diese Ansprüche an mehrere unabhängige Knoten gesendet. Jeder Knoten führt eine Inferenz durch — im Wesentlichen läuft er seine eigene Bewertung mit seinem eigenen Modell-Stack.

Drittens werden die Ergebnisse in ein Konsens-Ergebnis aggregiert. Je nach erforderlicher Strenge könnte das eine Mehrheitseinigung oder einen höheren Schwellenwert bedeuten.

Schließlich wird ein Zertifikat ausgestellt. Dieses Zertifikat sagt nicht nur "verifiziert". Es kann zeigen, was überprüft wurde und wie das Netzwerk zu seiner Schlussfolgerung gelangte.

Wirtschaftlich ist die Teilnahme gebunden. Knoten setzen Werte und werden belohnt, wenn sie sich mit ehrlichem Konsens abstimmen. Wiederholte Abweichungen können zu Strafen führen. Hier wird Mira eindeutig kryptonativ: Es bettet die Verifizierung in ein spieltheoretisches System ein, anstatt auf zentrale Moderation zu vertrauen.

Es versucht nicht, KI-Modelle zu ersetzen. Es versucht, hinter ihnen zu stehen.

Middleware, nicht Spotlight.

---

Wo es in diesem Zyklus steht

Der aktuelle Infrastrukturzyklus fühlt sich anders an als der letzte. Es gibt weniger Appetit auf abstrakte Versprechen und mehr Fokus auf brauchbare Komponenten. Entwickler wandern zu modularen Stacks, in denen spezialisierte Dienste integriert werden können, ohne alles von Grund auf neu zu schreiben.

Mira passt in diese modulare These.

Es muss nicht das Rennen um das KI-Modell gewinnen. Es muss zur Verifizierungsschicht werden, in die Teams einstecken, wenn Zuverlässigkeit zu einem Constraint wird.

Erzählerisch passt es zur wachsenden Besorgnis über das Vertrauen in KI. Aber allein die narrative Übereinstimmung schafft keine langlebigen Systeme. Entscheidend ist, ob die Verifizierung die nachgelagerten Kosten — Compliance-Risiken, Kundenstreitigkeiten, reputationsschädigende Schäden, betriebliche Fehler — erheblich senkt.

Im Vergleich zu zentralisierten Ensemble-Systemen bietet Mira Auditierbarkeit und Dezentralisierung. Das ist ein Vorteil, wenn Ihnen Transparenz wichtig ist. Es ist ein Nachteil, wenn Latenz oder Kosten prohibitiv werden.

Es gibt auch echte Einschränkungen:

Wahrheit ist nicht immer binär. Viele Ansprüche leben in Graubereichen.

Modellvielfalt muss echt sein, nicht kosmetisch.

Verifizierung fügt Reibung hinzu, und Reibung muss sich wirtschaftlich rechtfertigen.

Ausgewogene Analyse ist hier wichtig. Das ist kein garantiertes Ergebnis. Es ist eine strukturelle Wette.

---

Echte Signale über Lärm

Bei der Bewertung von Infrastrukturprojekten erzählen Oberflächenmetriken selten die ganze Geschichte. Token-Preisentwicklung oder soziale Anziehung können vorübergehende Aufmerksamkeit erzeugen, aber Middleware lebt oder stirbt an der Integrationsdichte.

Die bedeutungsvollen Signale sind leiser:

Integrieren Entwickler SDKs in Produktionsabläufe?

Werden Verifizierungsgebühren gezahlt, weil sie das reale Risiko senken?

Besteht die Gemeinschaft aus Entwicklern und Betreibern und nicht nur aus Spekulanten?

Berichte deuten darauf hin, dass Mira begonnen hat, sich in KI-Anwendungen einzubetten und erhebliche Durchsatzraten zu verarbeiten, obwohl die unabhängige Verifizierung von Maßstab langfristig wichtig sein wird. Der wichtigere Indikator wird sein, ob die Nutzung anhält, sobald die Anreize normalisiert sind.

Frühphasen-Netzwerke verwenden oft Zugangskontrollen oder strukturierte Einarbeitungen, um die Qualität zu wahren. Das kann die frühe Netzwerkgesundheit verbessern, kann jedoch Teilnahmefriktionen einführen. Der Kompromiss zwischen Offenheit und Integrität ist nicht trivial, insbesondere für ein Protokoll, das auf Vertrauen basiert.

Anders ausgedrückt, das Signal bildet sich noch.

---

Was richtig laufen muss

Damit Mira grundlegend und nicht experimentell wird, müssen mehrere Bedingungen übereinstimmen.

Die Verifizierungszertifikate müssen wirklich nützlich werden — keine Marketingartefakte, sondern Werkzeuge, auf die Unternehmen und Entwickler bei der Prüfung von KI-gestützten Entscheidungen angewiesen sind.

Die Vielfalt der Knoten muss real bleiben. Wenn Anreize die Betreiber in Richtung identischer Modell-Stacks drängen, riskiert das Netzwerk korrelierte Fehler.

Kosten und Latenz müssen wettbewerbsfähig bleiben. Verifizierung sollte sich wie ein rationaler Schutz anfühlen, nicht wie ein teurer Luxus.

Am wichtigsten ist, dass das System Nuancen handhaben muss. Nicht alle falschen Aussagen sind gleich. Nicht alle umstrittenen Fakten sind böswillig. Ein Verifizierungsnetzwerk muss Unsicherheit intelligent darstellen, nicht in binäre Ergebnisse abflachen.

Wenn diese Teile zusammenfallen, wird Mira zu etwas leise Mächtigem: einer Zuverlässigkeitsschicht, auf die KI-Systeme angewiesen sind, über die die Benutzer jedoch selten nachdenken.

Wenn sie das nicht tun, besteht die Gefahr, dass sie von zentralisierten Alternativen überholt werden, die schneller und günstiger sind.

---

Ein fundierter abschließender Gedanke

Krypto schwankt oft zwischen zwei Extremen — Überconfidence und Zynismus. Mira benötigt keines von beidem.

Die einfache Beobachtung ist die: KI wird schneller in Systeme integriert, als wir Rahmenbedingungen für die Verantwortlichkeit haben. Verifizierung ist nicht glamourös, aber sie ist strukturell. Und strukturelle Schichten neigen dazu, im Wert zu wachsen, wenn sie funktionieren.

Mira setzt darauf, dass dezentraler Konsens, kombiniert mit wirtschaftlichen Anreizen, die KI-Ausgaben verteidigbarer machen kann. Nicht perfekt. Nicht unfehlbar. Aber auditierbar.

In einem Markt, der einst Geschwindigkeit über alles andere priorisierte, fühlt sich das wie eine reife Richtung an.

Nicht lauter.

Einfach stabiler.

#Miar @Mira - Trust Layer of AI $MIRA