Könnte $MIRA Architektur einen plattformübergreifenden Gedächtnis-Audit-Pfad erstellen, der verfolgt, wie sich KI-Erzählungen im Laufe der Zeit entwickeln und historische Konsistenz als Glaubwürdigkeitsressource monetarisiert?

Letzte Woche scrollte ich durch einen KI-Forschungsthread, den ich vor einigen Monaten als Lesezeichen gesetzt hatte. Die Benutzeroberfläche wurde aktualisiert, einige Antworten haben sich neu angeordnet, und die ursprüngliche Behauptung war subtil bearbeitet worden. Keine Benachrichtigung. Kein Versionsverlauf. Nur eine stille Veränderung. Ich erinnerte mich klar an die frühere Formulierung, aber es gab keinen kanonischen Weg, dies zu beweisen. Die Erzählung hatte sich entwickelt, aber das Gedächtnis daran war nicht erhalten geblieben.

Dieser Moment fühlte sich strukturell falsch an. Wir verlassen uns auf KI-Systeme und Online-Plattformen, um Entscheidungen zu treffen, doch ihre Ausgaben sind flüssig, veränderlich und oft nicht nachvollziehbar. Anreize belohnen Engagement und Iteration, nicht Konsistenz. Modelle aktualisieren sich, Beiträge werden bearbeitet, Benchmarks verschieben sich. Aber das System offenbart selten, wie sich eine Behauptung im Laufe der Zeit verändert hat oder wer für diese Drift verantwortlich ist.

Das tiefere Problem ist nicht Fehlinformation. Es ist Gedächtnis-Asymmetrie. Plattformen erinnern sich intern an alles, stellen aber nach außen fast nichts zur Verfügung. Benutzer sehen den aktuellen Zustand; Betreiber sehen die gesamte Geschichte. Dieses Ungleichgewicht konzentriert Macht in der Schicht, die den archivierten Zugriff kontrolliert. Wenn sich Erzählungen entwickeln - sei es durch Modellanpassung, Datenverschiebungen oder strategische Neupositionierung - gibt es keinen standardisierten Audit-Pfad, der Konsistenz in ein messbares Asset umwandelt.

Ich begann, darüber weniger wie über ein Inhaltsproblem und mehr wie über Versionskontrolle ohne Protokolle nachzudenken. Stellen Sie sich ein gemeinsames Dokument vor, in dem Bearbeitungen frühere Zeilen ohne Commit-Historie überschreiben. Sie könnten den neuesten Absatz sehen, aber nicht den Weg, den er genommen hat, um dorthin zu gelangen. Vertrauen wird in dieser Umgebung anekdotisch. Gedächtnis wird sozial, nicht strukturell.

Ein stärkeres mentales Modell ist ein „narrativer Ledger“. Nicht eine Blockchain im abstrakten Sinne, sondern eine strukturierte Gedächtnisachse, in der jede bedeutungsvolle Zustandsänderung angehängt und nicht ersetzt wird. Jede Behauptung, jedes Modelloutput oder jede veröffentlichte Erzählung würde einen zeitgestempelten Hash erzeugen, der mit seinem Vorgänger verknüpft ist. Im Laufe der Zeit bildet die Kette von Versionen eine messbare Geschichte von Konsistenz, Korrektur oder Widerspruch.

In der Softwareentwicklung haben Versionskontrollsysteme die Zusammenarbeit transformiert, weil sie die Geschichte überprüfbar gemacht haben. In den Finanzmärkten haben Transaktionsbücher die Abwicklung transformiert, weil sie das Eigentum überprüfbar gemacht haben. Aber in KI-gesteuerten Informationssystemen arbeiten wir immer noch weitgehend im Überschreibmodus. Das Fehlen von dauerhaftem Gedächtnis macht Glaubwürdigkeit subjektiv und reaktiv.

Bestehende Ökosysteme deuten auf Teile dieses Puzzles hin. Auf Ethereum ist Unveränderlichkeit ein Kernmerkmal, aber Speicherkosten machen eine granulare narrative Verfolgung teuer. Solana optimiert für Durchsatz, dennoch können schnelle Zustandsänderungen immer noch die Endgültigkeit über die Interpretierbarkeit priorisieren. Avalanche bietet Subnetzflexibilität, aber architektonische Fragmentierung erschwert einheitliche Audit-Pfade über die Domains hinweg. Keines ist speziell darauf ausgelegt, die narrative Entwicklung selbst als Anlageklasse zu behandeln.

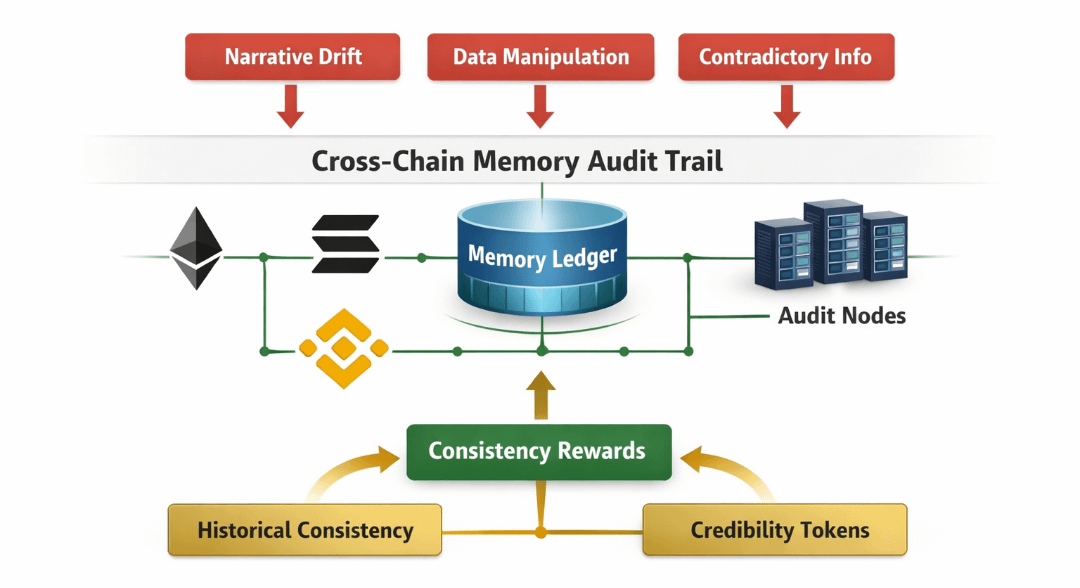

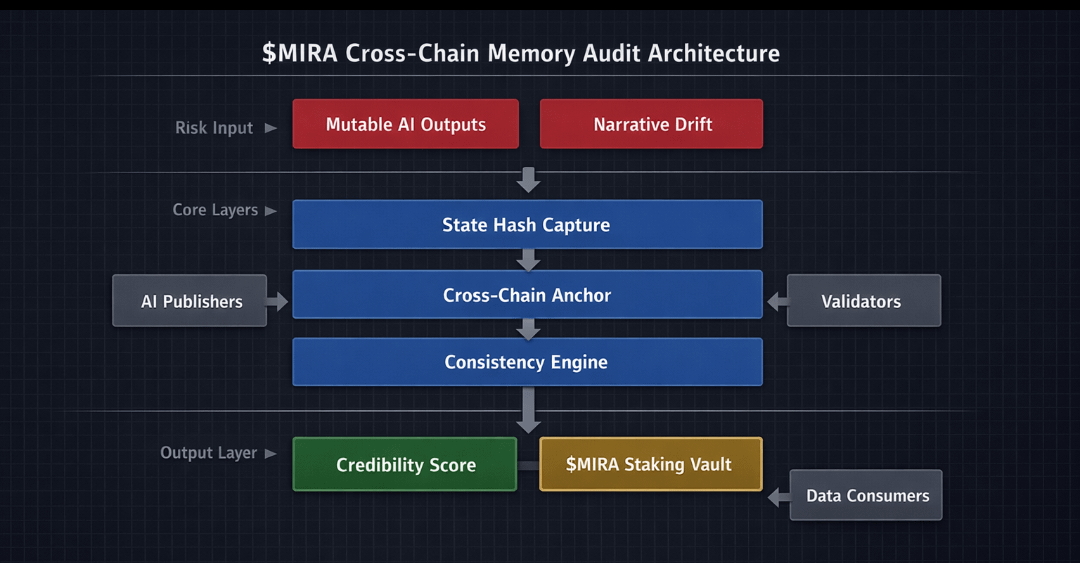

Hier wird die potenzielle Architektur von MIRA strukturell interessant. Ein plattformübergreifender Gedächtnis-Audit-Pfad würde nicht den Rohinhalt auf Dauer speichern. Stattdessen würde er kryptografische Verpflichtungen zu narrativen Zuständen über Ketten hinweg aufzeichnen. Jedes Mal, wenn ein KI-Modell eine Antwort veröffentlicht, Gewichtungen aktualisiert oder ein öffentliches Output überarbeitet, wird ein Hash dieses Zustands in eine gemeinsame Audit-Schicht verankert. Der Inhalt kann außerhalb der Kette leben; der Gedächtnisfingerabdruck lebt in der Kette.

Architektonisch würde dies drei Schichten erfordern. Zuerst eine Erfassungsschicht, die standardisiert, wie KI-Ausgaben oder Dokumente staatliche Verpflichtungen erzeugen. Zweitens eine Verifizierungsschicht, die diese Verpflichtungen über mehrere Ketten hinweg zeitstempelt und sequenziert. Drittens eine Bewertungsschicht, die Konsistenzmetriken über die Zeit berechnet - Rückschläge, Korrekturen oder stabile Trajektorien erkennt.

Der Token, MIRA, würde weniger als spekulativer Vermögenswert und mehr als wirtschaftliches Messgerät für Gedächtnisvalidierung fungieren. Validatoren, die MIRA staken, könnten verantwortlich sein für die Sequenzierung narrativer Verpflichtungen und die Überprüfung plattformübergreifender Referenzen. Belohnungen würden basierend auf erfolgreicher Einbeziehung und Genauigkeit der Zustandsnachweise verteilt, mit Strafen, die an betrügerische Sequenzierungen oder Auslassungen gebunden sind.

Ein einfaches, constraints-basiertes Mechanismus könnte das System verankern. Zum Beispiel, nehmen wir an, die Belohnungen für Validatoren verringern sich logarithmisch über die Zeit, es sei denn, sie nehmen an einem Mindestprozentsatz von plattformübergreifenden Verifizierungsereignissen pro Epoche teil. Dies erzwingt aktive Teilnahme und discouragiert passives Staking. Darüber hinaus würden Projekte oder KI-Anbieter, die ihre Erzählungen verankern möchten, Gebühren in $MIRA zahlen, was eine direkte Nachfrage schafft, die an die Gedächtnisregistrierung und nicht an das Handelsvolumen gekoppelt ist.

Innerhalb des Artikels stelle ich mir eine Visualisierung vor: eine horizontale Zeitachse, die in diskrete Blöcke unterteilt ist. Jeder Block stellt einen narrativen Zustand dar - Version 1, Version 2, Version 3 - verbunden durch Pfeile. Unter jedem Block sitzt ein kleiner Hash-Identifikator und ein Konsistenzscore, der sich im Laufe der Zeit anpasst. An der Seite zeigt ein kreisförmiges Anreizschleifen-Diagramm, wie KI-Verleger Zustands-Hashes einreichen, Validatoren MIRA staken, um sie zu verifizieren, und Benutzer die Geschichte abfragen, um die Glaubwürdigkeit zu bewerten. Die Visualisierung macht eines klar: Gedächtnis wird messbar, nicht anekdotisch.

Wenn ein solches System angenommen würde, würde sich das Verhalten der Entwickler ändern. Die Veröffentlichung einer KI-Ausgabe wäre keine umkehrbare Handlung mehr, die keine Konsequenzen hat. Jede Aktualisierung würde einen dauerhaften Fingerabdruck hinterlassen. Dies könnte vorsichtigeres Iterieren oder zumindest transparente Überarbeitungen anregen. Für die Benutzer würde Glaubwürdigkeit von der Markenreputation zu historischen Konsistenzmetriken übergehen. Ein KI-Modell, das sich häufig selbst widerspricht, ohne formale Überarbeitungsnotizen zu haben, würde eine sichtbare Inkonsistenzspur ansammeln.

Dieses Modell basiert jedoch auf einer fragilen Annahme: dass Akteure langfristige Glaubwürdigkeit mehr schätzen als kurzfristige narrative Flexibilität. Wenn Benutzer Audiodaten ignorieren und weiterhin Neuheiten über Konsistenz belohnen, wird die Gedächtnisschicht ornamental. Es besteht auch das Risiko einer Datenüberlastung. Ein zu granularer Verpflichtungssystem könnte Rauschen erzeugen, was es schwierig macht, bedeutungsvolle Überarbeitungen von trivialen Änderungen zu unterscheiden.

Ein weiterer Fehlermodus liegt in der Governance. Wenn $MIRA Inhaber Parameteranpassungen kontrollieren - wie Belohnungsraten oder Validierungsschwellen - besteht die Möglichkeit einer Übernahme. Große Interessengruppen könnten das System zugunsten bestimmter KI-Anbieter verzerren oder ungünstige Audit-Pfade unterdrücken. Schutzmaßnahmen würden transparente Governance-Mechanismen und möglicherweise quadratische Gewichtung erfordern, um Konzentration zu verhindern.

Dennoch ist die wirtschaftliche Implikation deutlich. Historische Konsistenz wird monetarisierbar. KI-Anbieter mit starken, stabilen Audit-Pfaden könnten Zuverlässigkeit gegenüber Unternehmen signalisieren. Forscher könnten überprüfen, ob sich die Behauptungen eines Modells aufgrund neuer Daten oder stiller Parameterverschiebungen entwickelt haben. Anstatt das neueste Output zu vertrauen, würden die Benutzer die Trajektorie dahinter bewerten.

Ein plattformübergreifender Gedächtnis-Audit-Pfad stellt Glaubwürdigkeit als akkumulierte Struktur dar, nicht als oberflächliche Präsentation. In einer digitalen Umgebung, in der sich Erzählungen schneller verändern, als das Gedächtnis nachverfolgen kann, verwandelt das Verankern der Evolution selbst in eine überprüfbare Schicht Konsistenz von einem moralischen Appell in eine wirtschaftliche Variable.#Mira @Mira - Trust Layer of AI $MIRA