Stärkung der Zuverlässigkeit künstlicher Intelligenz durch verteilte Anspruchsverifizierung: Die Rolle des Mira-Netzwerks

Künstliche Intelligenzsysteme werden zunehmend wichtig für Entscheidungen in Bereichen wie Finanzen, Gesundheitswesen, Forschung und Governance. Es gibt jedoch immer noch ein Problem: Zuverlässigkeit. Selbst die fortschrittlichsten Modelle können zuversichtliche, aber falsche Antworten geben, die oft als Halluzinationen bezeichnet werden. Da künstliche Intelligenzsysteme komplexer und einflussreicher werden, ist es entscheidend, dass ihre Antworten verifizierbar und vertrauenswürdig sind.

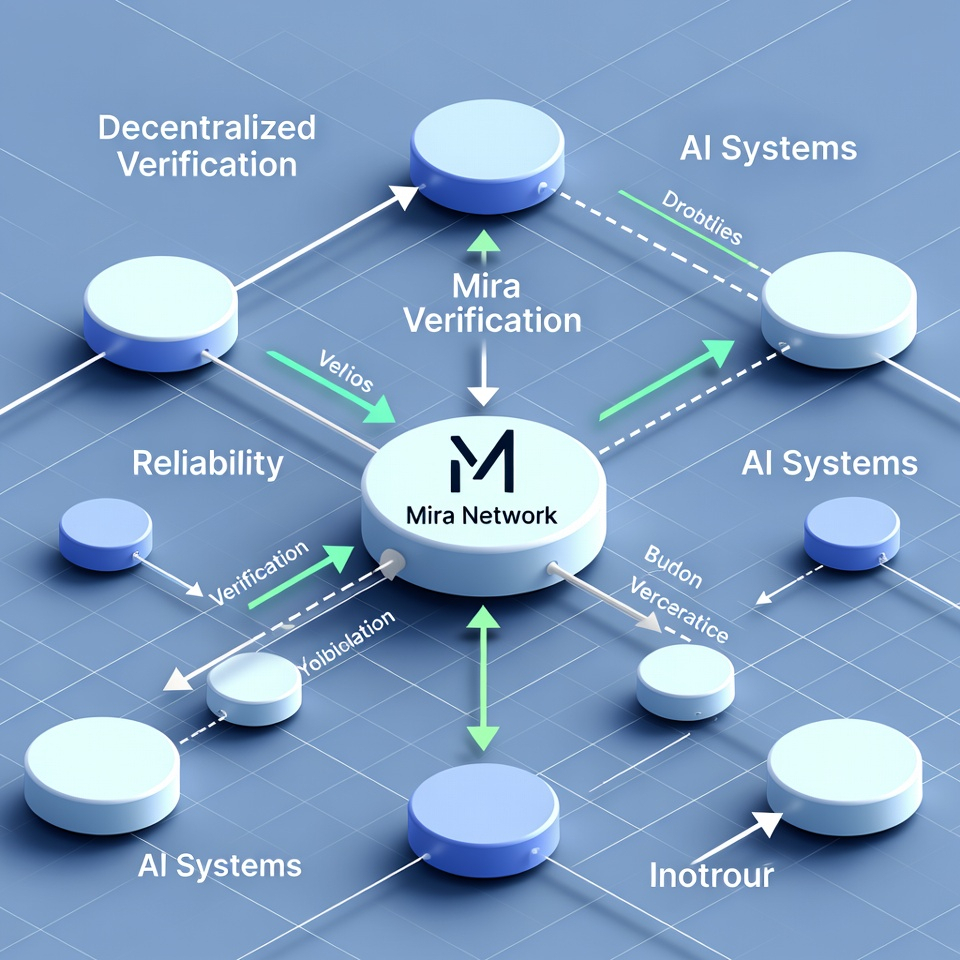

Ein Weg, dieses Problem zu lösen, besteht darin, unabhängige künstliche Intelligenzmodelle zur Validierung von Ansprüchen zu verwenden. Das Mira-Netzwerk ist ein Protokoll, das entwickelt wurde, um diese Herausforderung zu bewältigen, indem es die Art und Weise ändert, wie Antworten der künstlichen Intelligenz validiert und vertraut werden.

---

Das Problem: Zentrale Validierung künstlicher Intelligenz

Künstliche Intelligenzsysteme verlassen sich auf ein einzelnes Modell oder eine Gruppe eng verbundener Modelle, um Antworten zu generieren und zu validieren. Während es Methoden gibt, die Modelle verwenden, werden sie normalerweise von derselben Organisation oder demselben Rahmen kontrolliert. Dies schafft Probleme wie:

* Gemeinsame Trainingsvorurteile

* Ähnliche Datenbeschränkungen

* Einheitliche Fehlerverhalten

* Zentrale Kontrolle über die Bewertung

Wenn ein Modell einen Fehler macht, können ähnliche Modelle, die auf Daten trainiert wurden, denselben Fehler machen. Dies schafft einen Fehlerpunkt.

---

Verteilte Anspruchszersetzung: Eine große Veränderung

Die Verwendung unabhängiger Modelle zur Validierung von Ansprüchen verändert unsere Denkweise über Zuverlässigkeit. Anstatt eine Antwort der künstlichen Intelligenz als eine einzige Antwort zu behandeln, zerlegt das System sie in kleinere verifizierbare Ansprüche. Jeder Anspruch kann dann von Modellen bewertet werden, die unterschiedliche Architekturen, Trainingsdaten oder Validierungslogik verwenden.

Dieser Ansatz macht das System in folgenden Aspekten zuverlässiger:

1. Unabhängigkeit reduziert korrelierte Fehler

Wenn Validierungsmodelle unabhängig entwickelt werden und Anreize haben, sinkt die Wahrscheinlichkeit, dass sie denselben Fehler machen. Die Verwendung von Architekturen und Trainingsmethoden macht das System robuster.

2. Anspruchsgranularität

Anstatt eine gesamte Antwort zu akzeptieren oder abzulehnen, bewertet das System jeden Anspruch separat. Dies isoliert Fehler, ohne Informationen zu verwerfen.

3. Konsensbasierte Validierung

Das System wird zuverlässiger, wenn unabhängige Validierer einem Antwort zustimmen. Verteilter Konsens macht die Validierung zu einem transparenten Prozess, der Parteien einbezieht.

4. Wirtschaftliche Anreize für Genauigkeit

Dezentrale Systeme können tokenbasierte Anreize nutzen, um die Validierer zu ermutigen, genau zu sein. Dies schafft eine Ebene der Verantwortlichkeit, die in künstlichen Intelligenzsystemen fehlt.

---

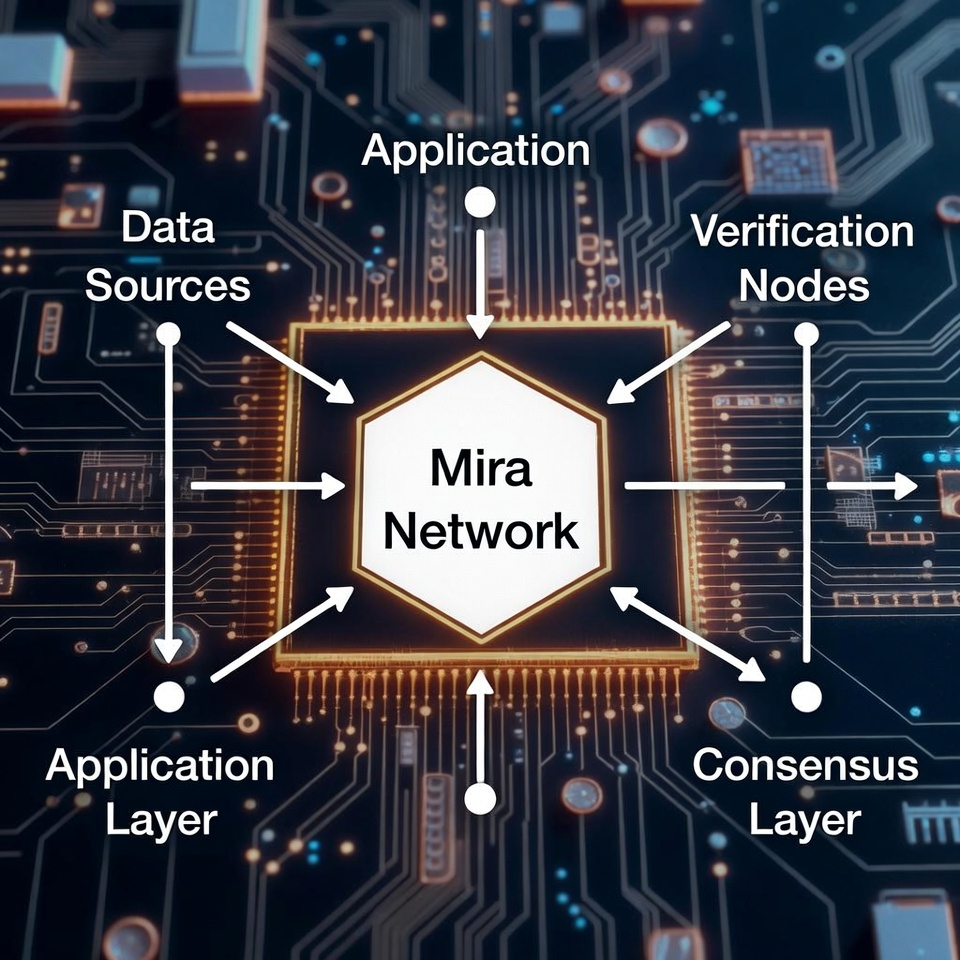

Wie das Mira-Netzwerk verteilte Verifizierung implementiert

Das Mira-Netzwerk nutzt eine Kombination aus Zerlegung von Ansprüchen durch künstliche Intelligenz und dezentralem Konsens, um das System zum Laufen zu bringen. Anstatt sich auf eine zentrale Autorität zu verlassen, verteilt das Protokoll Verifizierungsaufgaben auf unabhängige Teilnehmer.

Der Prozess umfasst typischerweise:

1. Ausgabezerlegung – Antworten der künstlichen Intelligenz werden in Ansprüche zerlegt.

2. Verteilte Bewertung – Unabhängige Modelle bewerten jeden Anspruch.

3. Konsensbildung – Ergebnisse werden durch Konsens kombiniert.

4. On-Chain-Integrität – Verifizierungsergebnisse werden transparent aufgezeichnet.

Durch die Trennung der Generierung von Antworten von der Validierung führt das Mira-Netzwerk eine Sicherheitsmaßnahme ein: Kein einzelnes Modell bestimmt die Wahrheit.

---

Zuverlässigkeit durch Redundanz und Vielfalt

In der Technik steigt die Zuverlässigkeit, wenn Systeme vorhanden sind. In Systemen kommt die Fehlertoleranz aus Vielfalt und Unabhängigkeit. Die Anwendung dieser Prinzipien auf die Validierung von Intelligenz schafft eine widerstandsfähigere Vertrauensschicht.

Anstatt zu fragen: "Kann diesem Modell vertraut werden?" fragt die verteilte Anspruchsvalidierung: "Stimmen unabhängige Systeme der gleichen verifizierten Antwort zu?"

Wenn mehrere autonome Validierer zustimmen, steigt das Vertrauen nicht, weil ein Modell mächtig ist, sondern weil das System widerstandsfähig gegen Fehler ist.

---

Breitere Implikationen

Da künstliche Intelligenzsysteme beginnen, Märkte, Politik und autonome Operationen zu beeinflussen, wachsen die Kosten falscher Antworten schnell. Verteilte Verifikationsprotokolle stellen einen Wandel dar, von der Vertrauenswürdigkeit einzelner Modelle hin zur Vertrauenswürdigkeit des Systems als Ganzes.

Durch das Zerlegen von Antworten in Ansprüche und die Verteilung der Validierung über unabhängige Akteure wird die Zuverlässigkeit messbar, prüfbar und wirtschaftlich verstärkt.

In diesem Paradigma wird Vertrauen nicht angenommen – es wird durch dezentralen Konsens konstruiert.

---

Die Verwendung unabhängiger künstlicher Intelligenzmodelle zur Validierung von Ansprüchen stärkt erheblich die Zuverlässigkeit der Antworten, indem sie korrelierte Fehler reduziert, die eine granulare Validierung ermöglichen und eine konsensbasierte Verifizierung einführt.

Das Mira-Netzwerk ist ein Beispiel für diesen Wandel hin zu dezentraler Integrität der künstlichen Intelligenz. Durch die Transformation der Verifizierung in einen verteilten, anreizeingestellten Prozess bietet es einen Rahmen für den Aufbau von künstlichen Intelligenzsystemen, die nicht nur intelligent, sondern auch vertrauenswürdig sind.

$MIRA #mira @Mira - Trust Layer of AI