Miras Prüfpfade könnten die Antwort sein. In einer Welt, in der Transparenz und Verantwortung in der KI nicht verhandelbar sind, befähigt Mira Organisationen, jede Entscheidung, Handlung und jedes Ergebnis zu verfolgen – was es ermöglicht, Ihre KI-Systeme wie nie zuvor zu überprüfen und zu vertrauen. Stellen Sie sich eine Zukunft vor, in der jede algorithmische Wahl zur Überprüfung und Verbesserung offensteht! Bereit, Ihre KI auf ein Fundament zu bauen, hinter dem Sie stehen können? Entdecken Sie, warum Miras Prüfpfade vielleicht das Rückgrat verifizierbarer KI sein könnten. Welche Fragen haben Sie zur Schaffung wahrer Transparenz in der künstlichen Intelligenz?

Während das Versprechen von verifizierbarer KI weiterhin den Diskurs in der Branche dominiert, bieten nur wenige Lösungen einen praktischen und transparenten Ansatz – hier behauptet Mira Audit, sich abzuheben. Doch während sich Organisationen beeilen, KI-gesteuerte Prozesse zu übernehmen, war der Bedarf an robusten Prüfpfaden noch nie so dringend. Miras Audit Trails positionieren sich als potenzielle Game-Changer, aber ihre Annahme wirft kritische Fragen auf.

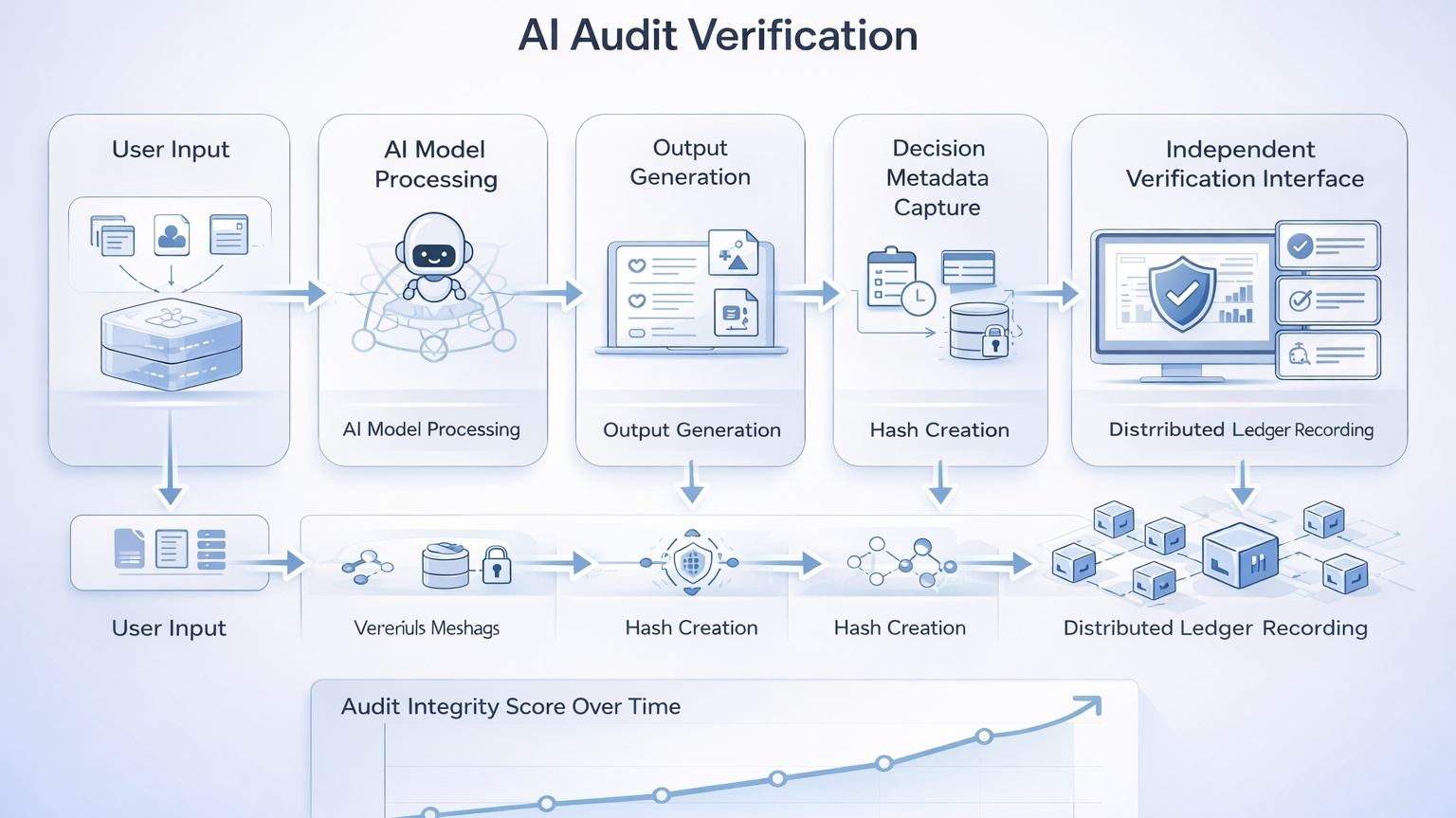

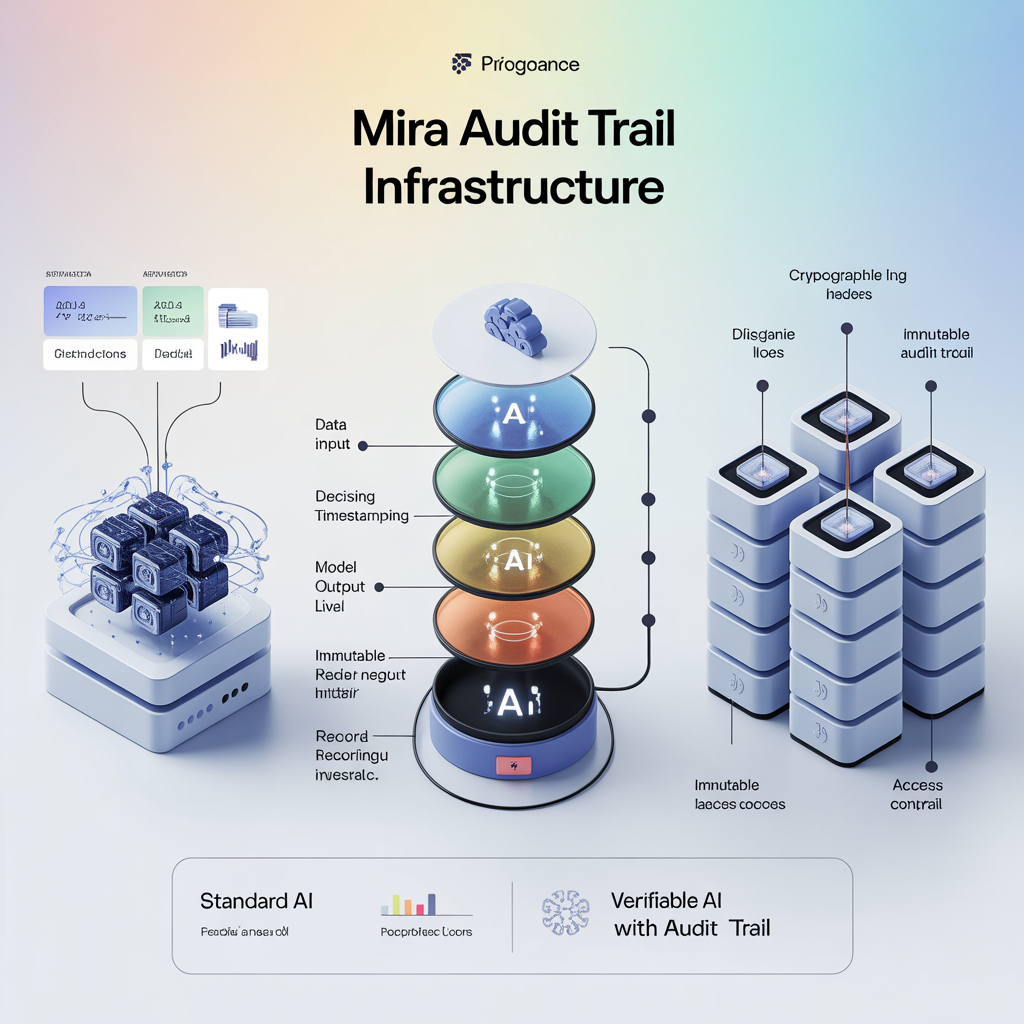

Die Kernstärke von Mira Audit liegt in seiner detaillierten, unveränderlichen Dokumentation: jede Entscheidung eines KI-Systems wird protokolliert, zeitgestempelt und mit relevanten Dateninputs verknüpft. Theoretisch könnte diese Transparenz Vertrauen aufbauen und eine unabhängige Überprüfung ermöglichen. Kritiker argumentieren jedoch, dass allein das Vorhandensein eines Prüfpfades nicht automatisch Verantwortung oder Interpretierbarkeit garantiert. Aufsichtsbehörden und Stakeholder müssen weiterhin komplexe technische Dokumentationen navigieren – eine Last, die die Verantwortung verschieben könnte, anstatt den Zugang wirklich zu demokratisieren.

Darüber hinaus, während Mira Audit die End-to-End-Rückverfolgbarkeit als Rückgrat für verifizierbare KI-Systeme anpreist, gibt es wenig öffentliche Kontrolle darüber, wie diese Audit-Protokolle verwaltet werden oder wer Zugang zu sensiblen Aufzeichnungen hat. Das Risiko besteht, dass zentrale Kontrolle die Objektivität untergraben und neue Datenschutzbedenken aufwerfen könnte.

Letztendlich, wenn verifizierbare KI von vertrauenswürdigen Prüfmechanismen abhängt, wie sie von Mira Audit Trails angeboten werden, muss die Branche nicht nur rigoros hinterfragen, was protokolliert wird – sondern auch, wie Transparenz in eine sinnvolle Verantwortlichkeit für alle beteiligten Parteien übersetzt wird.

#Mira @Mira - Trust Layer of AI $MIRA #MarketSentimentToday #MarketUpdate #UsaAttack #IranIsraelConflict