Kürzlich habe ich das Mira-Netzwerk und den $MIRA Token aus einer technologischen und infrastrukturellen Perspektive untersucht, anstatt mich nur auf den Marktpreis zu konzentrieren. Was mich am meisten interessiert, ist, wie das Netzwerk gestaltet ist, wie seine internen Systeme funktionieren und welche Rolle der Token im breiteren Ökosystem spielt.

Künstliche Intelligenz entwickelt sich in einem unglaublichen Tempo. KI-Systeme können heute beeindruckende Einblicke generieren, Aufgaben automatisieren und komplexe Entscheidungsprozesse unterstützen. Allerdings gibt es neben diesen Fortschritten ein ernstes Problem: Zuverlässigkeit.

KI-Systeme können manchmal Halluzinationen, voreingenommene Ausgaben oder inkonsistente Ergebnisse produzieren. In informellen oder Unterhaltungsanwendungen mag dies keine größeren Schäden verursachen, aber in Umgebungen, in denen Entscheidungen reale Konsequenzen haben, werden die Risiken erheblich. Finanzdienstleistungen, Gesundheitswesen, rechtliche Analysen und politische Entscheidungen erfordern alle ein viel höheres Maß an Sicherheit, als aktuelle KI-Systeme konsistent bieten können.

Diese Herausforderung ist ein Teil des Grundes, warum das Mira-Netzwerk entwickelt wurde. Das Projekt konzentriert sich darauf, die Ausgaben von KI in überprüfbare Informationen zu transformieren, anstatt einfach das Ergebnis eines einzelnen Modells zu akzeptieren.

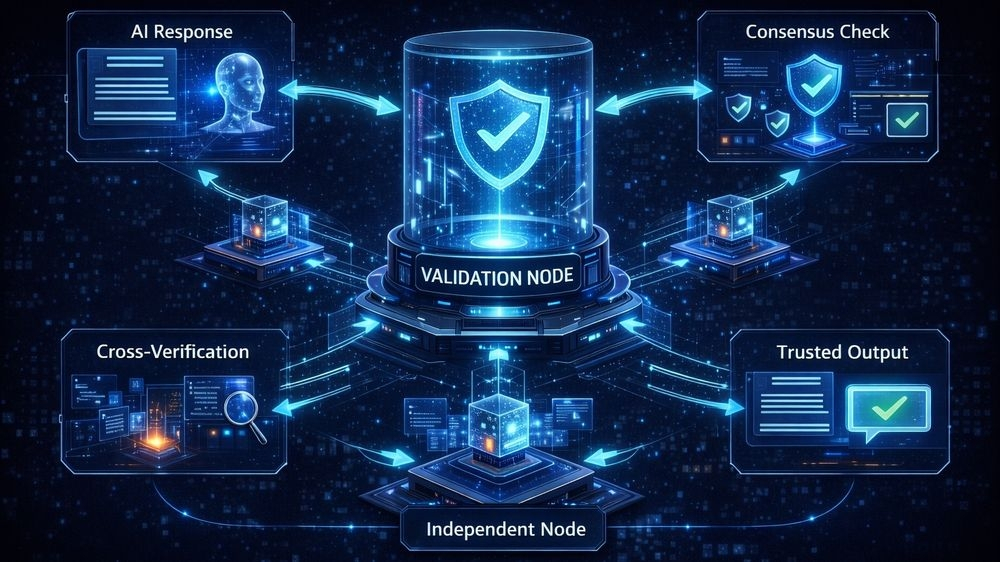

Das Konzept hinter Mira ist relativ einfach, aber mächtig. Anstatt sich auf ein KI-Modell zu verlassen, um eine Antwort zu generieren und zu validieren, zerlegt Mira komplexe KI-Ausgaben in einzelne überprüfbare Ansprüche. Diese Ansprüche werden dann über ein Netzwerk verteilt, in dem mehrere KI-Systeme an der Überprüfung der Genauigkeit der Informationen teilnehmen.

Durch diesen Prozess führt das System eine zusätzliche Überprüfungsebene ein, die in traditionellen KI-Architekturen oft fehlt. Anstatt einem einzigen System zu vertrauen, schafft das Netzwerk einen kollaborativen Validierungsmechanismus.

Einer der Hauptvorteile dieses Ansatzes ist die Transparenz. Die Ergebnisse des Überprüfungsprozesses können auf einer Blockchain aufgezeichnet werden, wodurch ein nachverfolgbarer Datensatz entsteht, wie eine Schlussfolgerung erreicht wurde. Entwickler und Organisationen können diese Aufzeichnungen überprüfen, um den Überprüfungsweg hinter einem KI-generierten Ergebnis zu verstehen.

Dieses Maß an Transparenz ist besonders wichtig in Sektoren, in denen Verantwortlichkeit und Überprüfbarkeit entscheidend sind.

Ein weiterer interessanter Aspekt des Mira-Netzwerks ist sein neutrales Design. Das System ist nicht um einen einzelnen KI-Anbieter oder ein Modell herum gebaut. Stattdessen ist es so konzipiert, dass es mit mehreren KI-Systemen von verschiedenen Entwicklern arbeitet. Indem es verschiedenen Modellen ermöglicht, die Ausgaben des jeweils anderen zu bewerten und zu überprüfen, zielt das Netzwerk darauf ab, die Abhängigkeit von einer einzelnen Informationsquelle zu reduzieren.

Theoretisch könnte diese Struktur die Zuverlässigkeit von KI-generierten Erkenntnissen erheblich verbessern.

Es bleiben jedoch, wie bei jeder aufkommenden Infrastruktur, mehrere wichtige Fragen offen. Überprüfungsnetzwerke müssen starke Anreizmechanismen sicherstellen, damit die Validierer ehrlich teilnehmen. Ohne angemessene Anreize könnte das System Schwierigkeiten haben, eine zuverlässige Teilnahme aufrechtzuerhalten.

Es gibt auch Herausforderungen im Zusammenhang mit Skalierbarkeit und Governance. Während das Netzwerk wächst, muss es die Effizienz aufrechterhalten und gleichzeitig Risiken wie Validierer-Kollusion oder Manipulation verhindern. Governance-Rahmen werden eine wichtige Rolle dabei spielen, wie sich das System im Laufe der Zeit entwickelt und anpasst.

Trotz dieser Herausforderungen stellt das Mira-Netzwerk einen interessanten Wandel in der Diskussion über künstliche Intelligenz dar. Ein Großteil der aktuellen KI-Diskussion konzentriert sich auf die Fähigkeit – wie leistungsstark Modelle werden.

Mira bringt eine andere Perspektive ein: Überprüfung.

Wenn Überprüfungsebenen weit verbreitet angenommen werden, könnten sie eine entscheidende Rolle dabei spielen, wie KI-Systeme in realen Umgebungen bereitgestellt werden. Zuverlässige Überprüfung könnte die fehlende Infrastruktur werden, die es KI ermöglicht, von experimentellen Werkzeugen zu vertrauenswürdigen Entscheidungshilfesystemen zu wechseln.

In diesem Kontext erkunden Projekte wie Mira Network und das $MIRA Ökosystem eine wichtige Frage: nicht nur, was KI tun kann, sondern wie wir dem vertrauen können, was sie produziert.