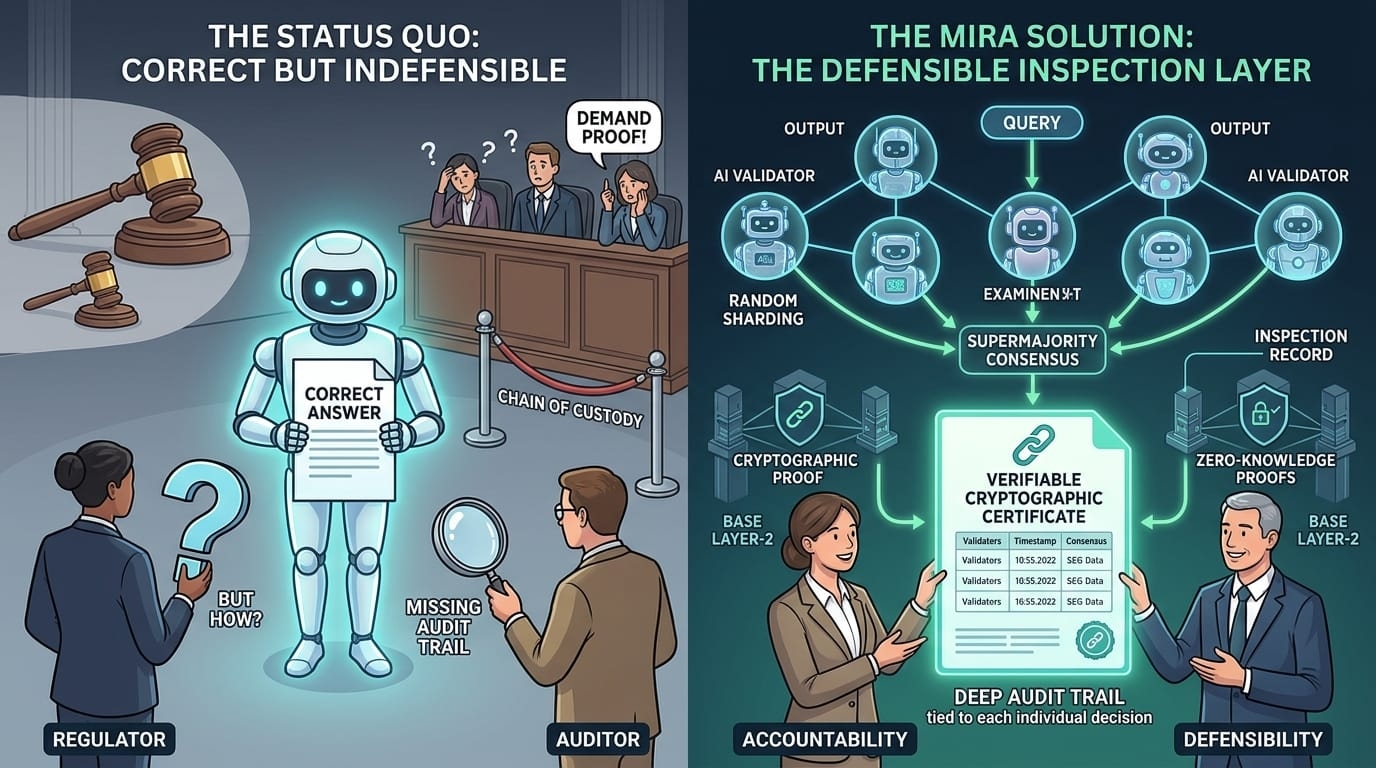

Es gibt einen stillen Fehlermodus in der künstlichen Intelligenz, der selten in Forschungsarbeiten oder Benchmark-Leaderboards erscheint. Es ist nicht die Art von Fehler, bei der ein Modell Unsinn produziert oder Fakten erfindet. In dieser Situation funktioniert das System. Die Antwort ist technisch korrekt. Der Prozess funktioniert wie vorgesehen. Doch die Organisation, die auf das Ergebnis angewiesen war, muss sich immer noch Regulierungsbehörden, Prüfern oder manchmal sogar einem Gericht erklären.

Das Problem ist nicht die Genauigkeit. Das Problem ist die Verantwortlichkeit.

Jahrelang hat sich das Gespräch über KI darauf konzentriert, ob Modelle korrekte Antworten liefern können. Aber Institutionen, die tatsächlich KI-Systeme einsetzen, entdecken, dass Korrektheit allein nicht ausreicht. Eine korrekte Antwort ohne einen verifizierbaren Prozess dahinter ist immer noch schwer zu verteidigen, wenn etwas schiefgeht. Wenn eine Bank, ein Krankenhaus oder eine Regierungsbehörde auf ein KI-Ergebnis angewiesen ist, ist die Frage, die Regulierungsbehörden letztendlich stellen, nicht einfach, ob die Antwort genau war. Sie wollen wissen, was in diesem genauen Moment passiert ist. Wer das Ergebnis überprüft hat. Welche Validierung stattfand. Und ob es einen Nachweis gibt, der belegt, dass der Prozess stattgefunden hat.

Diese Lücke zwischen korrektem Output und verteidigbarer Entscheidung ist der Punkt, an dem Mira Network ins Spiel kommt.

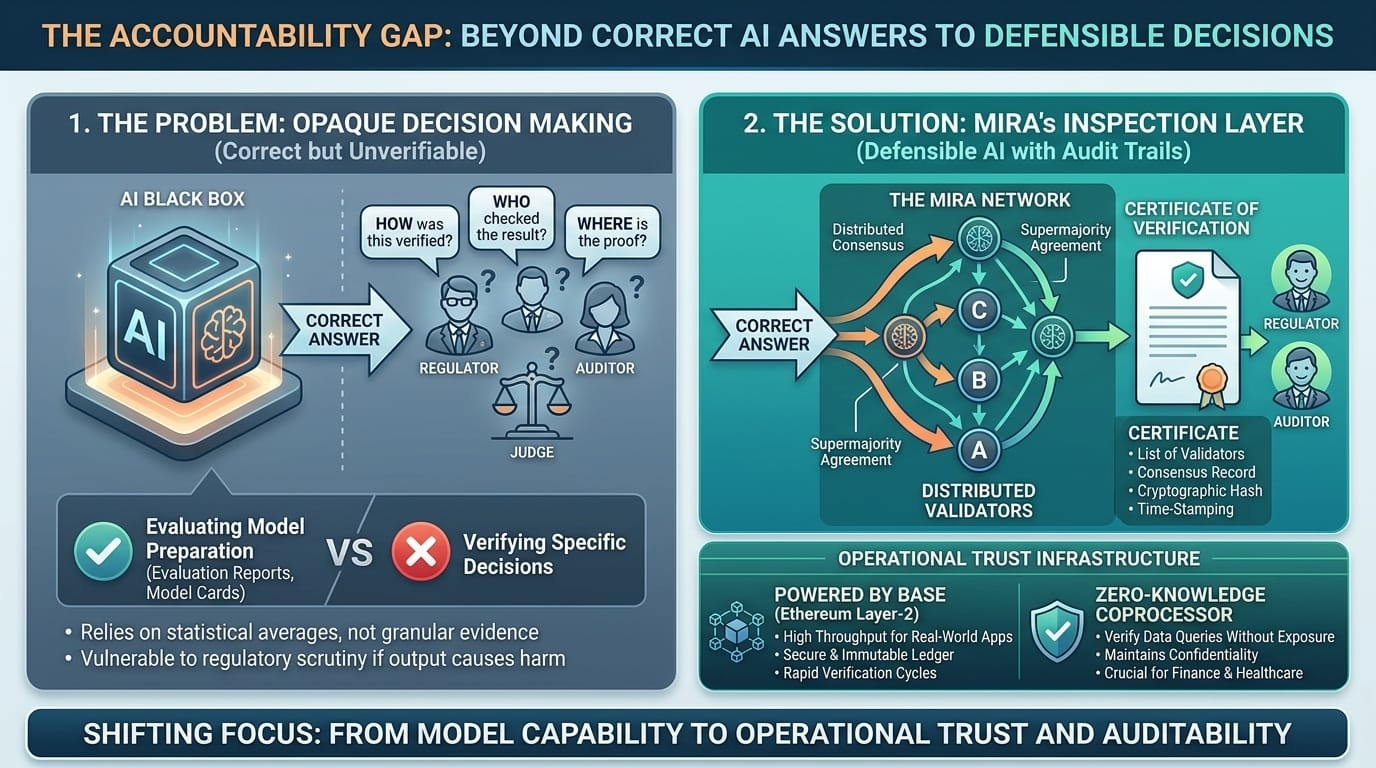

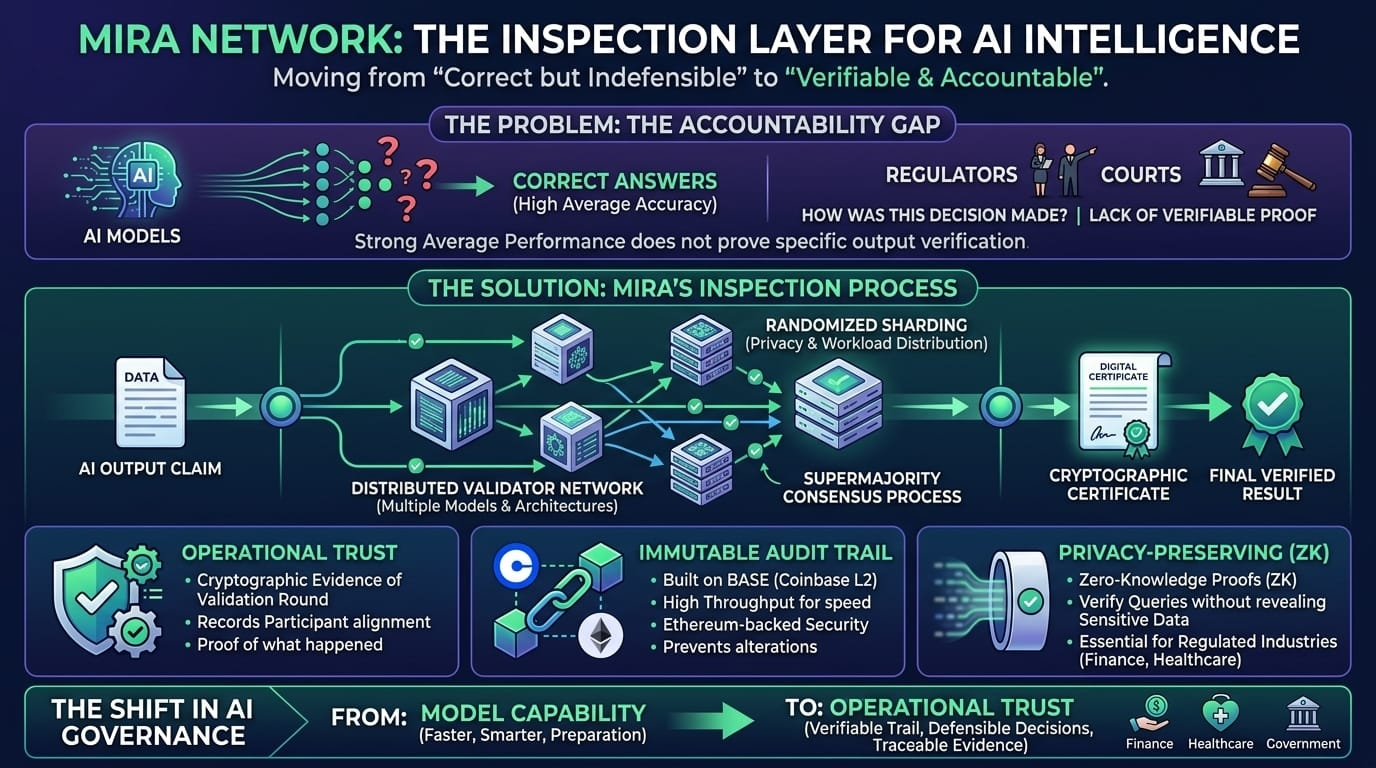

Auf den ersten Blick sieht Mira Network aus wie ein weiteres System, das darauf abzielt, die Zuverlässigkeit der KI zu verbessern. Anstatt das Urteil eines einzelnen Modells zu vertrauen, leitet es Ausgaben durch ein verteiltes Netzwerk von Validatoren. Mehrere Modelle, die oft auf unterschiedlichen Architekturen und Datensätzen trainiert wurden, überprüfen dieselbe Behauptung, bevor ein Ergebnis finalisiert wird. Die Logik ist einfach: Ein Fehler, der einem Modell entgeht, könnte mehreren unabhängigen Bewertungen nicht standhalten. In der Praxis reduziert dies dramatisch Halluzinationen und hebt die Zuverlässigkeit weit über das hinaus, was ein einzelnes Modell allein liefern kann.

Aber Genauigkeit ist nur die oberflächliche Geschichte.

Die tiefere Idee hinter Mira besteht nicht einfach darin, die Antworten der KI zu verbessern. Es geht darum, jede KI-Ausgabe in etwas zu verwandeln, das näher an einem Inspektionsprotokoll liegt.

Um zu verstehen, warum das wichtig ist, hilft es, einen Blick darauf zu werfen, wie andere Branchen Vertrauen handhaben. In der Fertigung verteidigt ein Unternehmen die Produktqualität nicht, indem es sagt, dass seine Maschinen normalerweise richtig kalibriert sind. Stattdessen kann jeder Artikel, der die Produktionslinie verlässt, durch einen dokumentierten Inspektionsprozess nachverfolgt werden. Wenn später ein Defekt auftritt, können Ermittler die Aufzeichnungen überprüfen und genau rekonstruieren, was passiert ist.

Künstliche Intelligenzsysteme arbeiten heute selten so. Wenn ein KI-Modell einen Output generiert, können die meisten Organisationen nur auf allgemeine Beweise verweisen, dass das Modell im Durchschnitt gut funktioniert. Sie haben möglicherweise Evaluierungsberichte, Modellkarten oder Compliance-Dokumentationen, die zeigen, dass das System vor der Bereitstellung getestet wurde. Diese Dokumente beweisen die Vorbereitung, aber sie beweisen nicht, dass ein spezifischer Output verifiziert wurde, bevor jemand darauf handelte.

Dieser Unterschied wird zunehmend wichtiger.

Regulierungsbehörden auf der ganzen Welt beginnen, eine genauere Verantwortung für automatisierte Entscheidungsfindung zu fordern. Gerichte beginnen auch zu fragen, wie Organisationen die Ausgaben von KI überprüfen, bevor sie reale Ergebnisse beeinflussen. In vielen Fällen entdecken Unternehmen, die glaubten, starke durchschnittliche Leistungskennzahlen würden die Aufsichtspflichten erfüllen, dass Regulierungsbehörden etwas viel Konkreteres wollen.

Sie wollen einen Nachweis, der an individuelle Entscheidungen gebunden ist.

Mira Network versucht, diesen Nachweis zu erbringen, indem es die KI-Überprüfung in einen kryptografischen Prozess umwandelt. Jeder Output, der durch das Netzwerk fließt, kann ein Zertifikat erzeugen, das dokumentiert, was während der Validierungsrunde passiert ist. Der Bericht zeigt, welche Validatoren teilgenommen haben, wie ihre Antworten übereinstimmten und welches Ergebnis letztendlich Konsens erreichte. Anstatt sich auf statistische Behauptungen über die Modellleistung zu verlassen, generiert das System ein überprüfbares Artefakt, das an einen bestimmten Moment in der Zeit gebunden ist.

Die architektonischen Entscheidungen hinter Mira spiegeln diesen Fokus auf operationale Vertrauenswürdigkeit wider. Das Netzwerk basiert auf Base, der Ethereum Layer-2-Infrastruktur von Coinbase. Diese Entscheidung betrifft weniger das Branding und mehr die Praktikabilität. Überprüfungssysteme müssen schnell genug arbeiten, um reale Anwendungen zu unterstützen, während sie ihre Aufzeichnungen in einer sicheren Umgebung verankern. Base bietet den Durchsatz, der für schnelle Überprüfungszyklen erforderlich ist, während das Sicherheitsmodell von Ethereum sicherstellt, dass die resultierenden Zertifikate nach ihrer Aufzeichnung nicht leicht verändert werden können.

Ein auf einer fragilen Kette gespeichertes Überprüfungsprotokoll würde den gesamten Zweck zunichte machen. Wenn das zugrunde liegende Hauptbuch reorganisiert oder umgeschrieben werden kann, wird der Bericht zu wenig mehr als einer vorübergehenden Notiz anstelle eines dauerhaften Prüfprotokolls.

Über die Blockchain-Schicht hinweg führt Mira Mechanismen ein, die sowohl Zuverlässigkeit als auch Privatsphäre wahren sollen. Anfragen, die in das System eingehen, werden standardisiert, bevor sie die Validatoren erreichen, sodass kleine kontextuelle Unterschiede den Evaluierungsprozess nicht verzerren. Aufgaben werden dann mithilfe von randomisiertem Sharding auf Knoten verteilt, was verhindert, dass ein einzelner Teilnehmer das gesamte Bild sieht, während die Arbeitslast im Netzwerk verteilt wird.

Wenn Validatoren ihre Bewertungen einreichen, aggregiert das System die Antworten mithilfe eines Supermajoritätskonsensprozesses. Das endgültige Zertifikat repräsentiert Zustimmung im gesamten Netzwerk und nicht nur eine eng gefasste Abstimmung. Effektiv funktioniert das Netzwerk wie ein verteiltes Inspektionsteam, das jede von KI generierte Behauptung untersucht.

Ein weiterer Teil des Systems drängt Mira leise näher an die Unternehmensinfrastruktur. Das Netzwerk enthält einen Zero-Knowledge-Co-Prozessor, der entwickelt wurde, um Datenbankabfragen zu überprüfen, ohne die zugrunde liegenden Daten offenzulegen. Diese Fähigkeit ist für Institutionen weitaus wichtiger als für gelegentliche Entwickler. Organisationen, die unter Datenschutzgesetzen oder strengen Vertraulichkeitsregeln arbeiten, können sensible Datensätze nicht einfach offenlegen, um zu beweisen, dass eine KI-generierte Antwort korrekt war. Zero-Knowledge-Überprüfung ermöglicht es ihnen, Genauigkeit zu demonstrieren, während die ursprünglichen Informationen verborgen bleiben.

Für Sektoren wie Finanzen, Gesundheitswesen und staatliche Verwaltung kann dieser Unterschied bestimmen, ob ein KI-System lediglich ein Experiment oder etwas ist, das in großem Maßstab eingesetzt werden kann.

Dennoch beseitigt Mira Network nicht jede Herausforderung im Zusammenhang mit der KI-Governance. Die Überprüfung fügt dem Entscheidungsprozess einen zusätzlichen Schritt hinzu, und das führt unvermeidlich zu einer gewissen Verzögerung. In Umgebungen, in denen Millisekunden entscheidend sind, muss jedes System, das einen verteilten Konsens erfordert, Geschwindigkeit mit Zuverlässigkeit in Einklang bringen. Es gibt auch ungelöste rechtliche Fragen. Wenn ein Netzwerk von Validatoren einen Output genehmigt, der später Schaden verursacht, verschwindet die Frage der Haftung nicht einfach, weil der Überprüfungsprozess dezentralisiert war.

Technologie kann Transparenz durchsetzen, aber sie kann rechtliche Rahmenbedingungen nicht ersetzen.

Selbst mit diesen Einschränkungen spiegelt die Richtung, die Mira darstellt, einen breiteren Wandel darin wider, wie Institutionen beginnen, künstliche Intelligenz anzugehen. Die frühe Ära der KI-Adoption konzentrierte sich stark auf die Modellfähigkeit. Organisationen wollten Systeme, die intelligenter, schneller und genauer sind als frühere Generationen.

Die nächste Phase handelt von etwas anderem.

Wenn KI-Systeme leistungsfähiger werden, nimmt die Prüfung ihrer Entscheidungen zu. Institutionen, die sich auf automatisierte Intelligenz verlassen wollen, müssen erklären können, nicht nur was ihre Systeme tun, sondern auch wie jede wichtige Ausgabe verifiziert wurde, bevor sie eine Handlung beeinflusste.

In dieser Umgebung werden die Gewinner nicht unbedingt die Unternehmen mit den selbstbewusstesten Modellen sein. Es werden diejenigen sein, die in der Lage sind, eine klare Spur von Beweisen zu produzieren, die zeigen, was überprüft wurde, wann es überprüft wurde und wie die endgültige Entscheidung zustande kam.

Genauigkeit mag das Gespräch über künstliche Intelligenz beginnen.

Aber Verantwortung ist es, was letztendlich bestimmt, ob jemand bereit ist, ihm zu vertrauen.