Etwas Wichtiges entfaltet sich still und leise in der Krypto-Infrastruktur. Viele Menschen betrachten es immer noch als ein zukünftiges Problem, aber es passiert bereits jetzt.

KI-Agenten operieren aktiv in Blockchain-Netzwerken. Sie verwalten Wallets, passen DeFi-Strategien an, führen Trades aus und reallocieren Liquidität zwischen Protokollen. Was einst als theoretische "KI-Ökonomie" beschrieben wurde, beginnt früher als erwartet zu erscheinen.

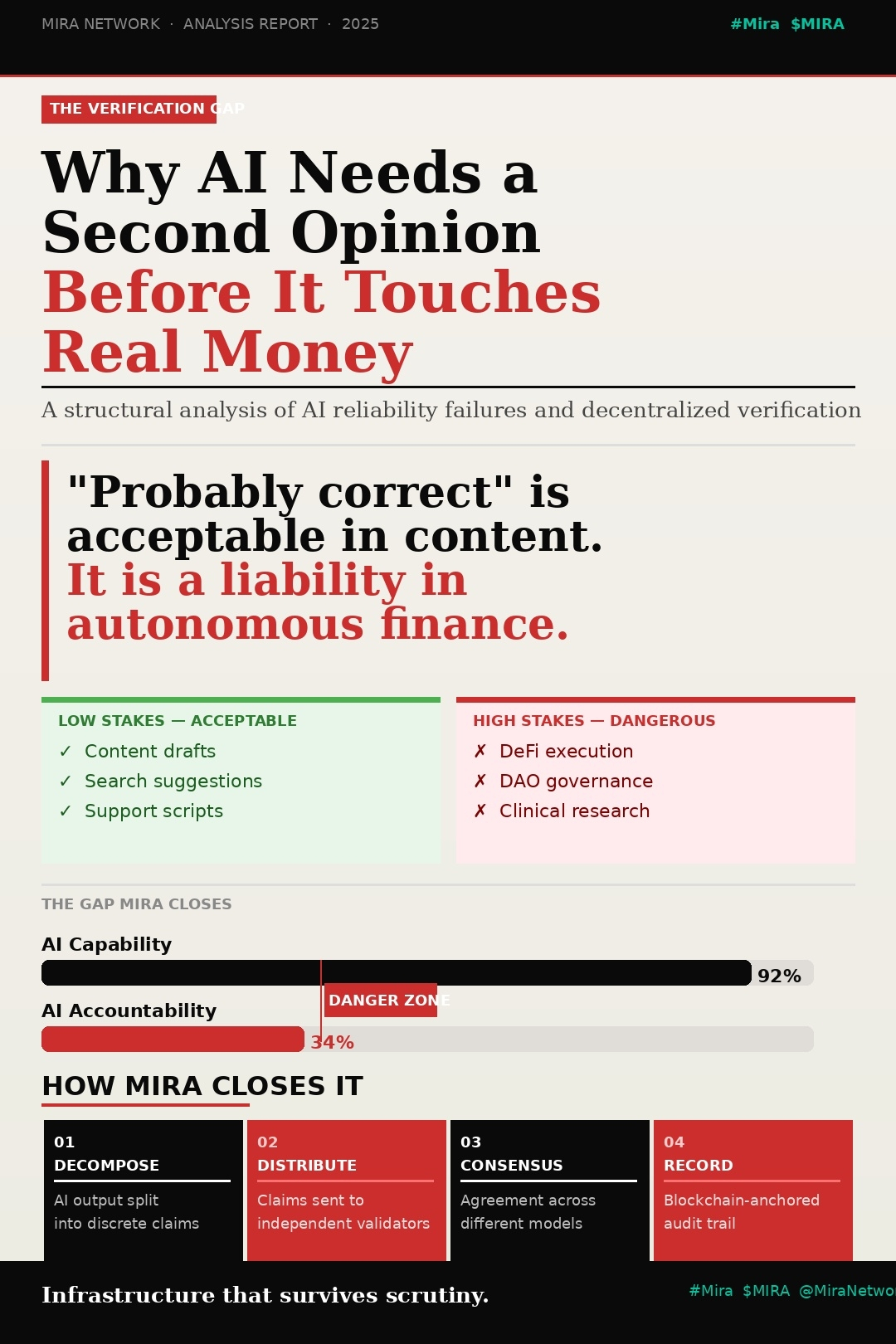

Und dieser Wandel offenbart eine strukturelle Lücke.

Wenn ein Mensch einen Trade durchführt, ist die Verantwortung klar. Eine Wallet signiert die Transaktion und die Entscheidung kann einer Person zurückverfolgt werden.

Wenn ein Smart Contract eine Aktion ausführt, sind die Regeln auf der Kette sichtbar. Jeder kann den Code überprüfen und die Logik verstehen, die die Transaktion ausgelöst hat.

Aber wenn ein KI-Agent Informationen aus einem Sprachmodell verwendet, um zu entscheiden, wann er handeln soll, wie viel Liquidität zu bewegen ist oder welche Position geschlossen werden soll, wird die Rechenschaftsschicht unklar. Die Überlegungen hinter der Entscheidung könnten in Modellausgaben existieren, die wenig überprüfbare Beweise hinterlassen.

Dies ist die Lücke, die Mira Network zu schließen versucht.

Von Roh-KI-Ausgaben zu verifizierten Informationen

Traditionelle Systeme wurden nicht für eine Welt entwickelt, in der autonome Agenten an finanziellen Aktivitäten teilnehmen. Mira führt eine zusätzliche Schicht ein, die zwischen KI-generierten Informationen und der on-chain Ausführung sitzt.

Wenn ein KI-Agent eine Analyse von einem Sprachmodell anfordert, kann die Antwort durch Miras Verifizierungsrahmen geleitet werden. Anstatt die Ausgabe als einen einzigen Block Text zu akzeptieren, strukturiert das System die Informationen in kleinere Ansprüche um, die unabhängig überprüft werden können.

Diese Ansprüche werden dann von verteilten Validierern überprüft. Jeder Validator bewertet die Informationen separat, bevor das Netzwerk zu einer Einigung gelangt, ob der Anspruch akzeptiert werden sollte.

Sobald Konsens erreicht ist, wird das verifizierte Ergebnis on-chain aufgezeichnet, zusammen mit Informationen darüber, wer es validiert hat und wie die Schlussfolgerung erreicht wurde.

Rechenschaftspflicht für KI-gesteuerte Entscheidungen

Der Unterschied zwischen der Verwendung von Roh-Modell-Ausgaben und der Verwendung von verifizierten Informationen besteht nicht nur darin, die Genauigkeit zu verbessern. Die wichtigere Veränderung ist die Rechenschaftspflicht.

Jeder verifizierte Anspruch erzeugt einen Datensatz. Dieser Datensatz zeigt, wann die Informationen generiert wurden, wie sie bewertet wurden und welche Validierer an der Bestätigung beteiligt waren.

Wenn später etwas schiefgeht, können Ermittler den Entscheidungsweg zurückverfolgen, anstatt sich mit einer intransparenten KI-Ausgabe auseinanderzusetzen. Der Datensatz wird zu einem Bezugspunkt, um zu verstehen, welche Informationen die Maßnahme beeinflusst haben.

Diese Art der Nachverfolgbarkeit wird zunehmend wichtig, da Regulierungsbehörden beginnen, Regeln für autonome Systeme zu entwerfen, die in finanziellen Umgebungen operieren.

Warum Regulierungsbehörden sich um Entscheidungswege kümmern

Regulierungsbehörden sind nicht nur daran interessiert, ob KI-Systeme im Durchschnitt gut abschneiden. Sie möchten verstehen, wie spezifische Entscheidungen getroffen werden.

Wenn ein KI-gesteuertes System einen Handel ausführt, der zu Verlusten oder Marktstörungen führt, werden die Behörden den Entscheidungsprozess rekonstruieren wollen. Sie werden fragen, welche Daten verwendet wurden, welche Überlegungen angestellt wurden und ob eine Überprüfung stattfand, bevor die Maßnahme ergriffen wurde.

Miras Architektur schafft einen strukturierten Weg, der diese Fragen beantworten kann. Anstatt sich auf interne Dokumentationen oder fragmentierte Protokolle zu verlassen, bietet der Verifizierungsdatensatz eine transparente Beweiskette, die Compliance-Teams überprüfen können.

Anreize und Reputation für Validierer

Die Zuverlässigkeit des Systems hängt von den Personen oder Entitäten ab, die Informationen verifizieren. Mira versucht, diese Schicht durch wirtschaftliche Anreize und Reputationstracking zu stärken.

Teilnehmer, die konsistent genaue Bewertungen abgeben, können einen Nachweis der Zuverlässigkeit innerhalb des Netzwerks aufbauen. Im Laufe der Zeit entsteht so ein Validierer-Ökosystem, in dem Vertrauen aus der Leistung und nicht aus einer zentralen Autorität erwächst.

Das Ziel ist es, eine Verifizierungsumgebung zu schaffen, die dezentral bleibt und dennoch zuverlässige Ergebnisse liefert.

Cross-Chain-Kompatibilität für ein Multi-Netzwerk-Ökosystem

Eine weitere praktische Funktion des Designs ist die Fähigkeit, mit mehreren Blockchain-Ökosystemen zu interagieren.

KI-Agenten operieren bereits über mehrere Netzwerke, einschließlich Bitcoin, Ethereum und Solana. Die Verifizierungsschicht von Mira ist darauf ausgelegt, sich in Anwendungen in diesen Umgebungen zu integrieren, anstatt die Aktivitäten auf eine einzige Kette zu beschränken.

Diese Flexibilität ermöglicht es Entwicklern, Verifizierungsinfrastrukturen hinzuzufügen, ohne ihren gesamten Stack umzustrukturieren.

Arbeiten mit privaten Daten, ohne sie offenzulegen

Unternehmen stehen vor einer weiteren Herausforderung bei der Integration von KI-Systemen: sensible Daten. Finanzinstitute und Unternehmen können proprietäre Datensätze oder vertrauliche Informationen nicht frei offenlegen.

Miras Architektur versucht, dies zu adressieren, indem sie die Verifizierung von Ergebnissen ermöglicht, ohne die zugrunde liegenden Daten offenzulegen. In der Praxis bedeutet dies, dass KI-Agenten auf Erkenntnisse aus privaten Datensätzen angewiesen sein können, während sie dennoch den Nachweis erbringen, dass die Schlussfolgerungen verifiziert wurden.

Diese Fähigkeit wird besonders wichtig für Organisationen, die unter strengen Datenschutzbestimmungen arbeiten.

Das Kernproblem war nie nur die Genauigkeit

Bedenken hinsichtlich KI konzentrieren sich oft auf Halluzinationen oder falsche Ausgaben. Während Genauigkeit wichtig ist, ist das tiefere Problem die strukturelle Rechenschaftspflicht.

Autonome Systeme sind zunehmend in der Lage, bedeutungsvolle wirtschaftliche Entscheidungen zu treffen. Ohne einen Mechanismus, der aufzeichnet, wie diese Entscheidungen getroffen wurden, wird es schwierig, Verantwortung zuzuweisen oder nachzuweisen, dass die gebotene Sorgfalt stattfand.

Die Herausforderung besteht nicht nur darin, intelligentere Modelle zu erstellen. Es geht darum, Systeme zu entwickeln, die die Überlegungen hinter den Entscheidungen, die diese Modelle beeinflussen, dokumentieren und verifizieren.

Eine Verifizierungsschicht für die KI-Wirtschaft

Das Wachstum von KI-Agenten in Blockchain-Ökosystemen deutet darauf hin, dass autonome Entscheidungsfindung ein normaler Bestandteil der digitalen Infrastruktur werden wird. Mit dieser Beschleunigung wird der Bedarf an verifizierbaren Entscheidungswegen nur zunehmen.

Projekte wie Mira Network versuchen, die Infrastruktur aufzubauen, die diese Entscheidungen aufzeichnet und validiert, bevor sie die finanziellen Systeme beeinflussen.

Wenn die KI-Wirtschaft weiterhin expandiert, könnten die Netzwerke, die Verantwortung übernehmen, ebenso wichtig werden wie die Systeme, die die Intelligenz selbst erzeugen.