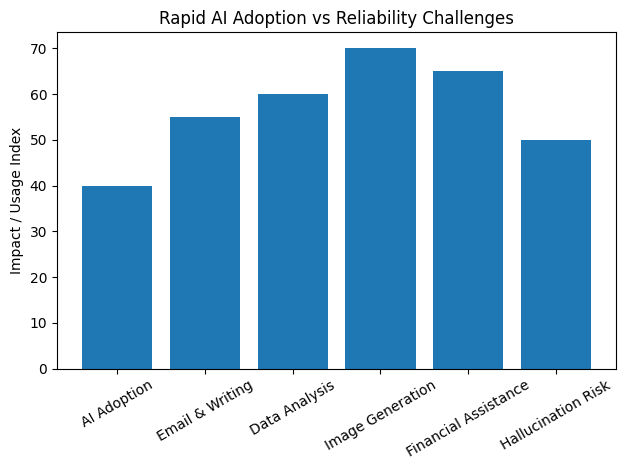

Ich habe viel darüber nachgedacht, wie schnell künstliche Intelligenz Teil des täglichen Lebens wird. Vor nur wenigen Jahren wurde KI hauptsächlich in Forschungslabors oder spezialisierten Unternehmen eingesetzt. Heute schreibt sie E-Mails, analysiert Daten, erstellt Bilder und hilft sogar Menschen bei finanziellen Entscheidungen. Die Geschwindigkeit dieser Transformation ist unglaublich. Aber je leistungsfähiger diese Systeme werden, desto mehr wird eine Frage wichtig: Können wir wirklich vertrauen, was KI produziert?

Die meisten KI-Modelle heute arbeiten mit Wahrscheinlichkeit. Sie analysieren massive Mengen an Daten und sagen die wahrscheinlichste Antwort auf eine Frage voraus. Oft sind die Ergebnisse beeindruckend und genau. Aber manchmal produzieren diese Systeme Informationen, die einfach nicht korrekt sind. Sie könnten Fakten erfinden, Quellen falsch interpretieren oder Aussagen treffen, die überzeugend klingen, aber keine echten Beweise dahinter haben. Dieses Phänomen wird oft Halluzination genannt, und es ist eines der größten Einschränkungen der modernen KI.

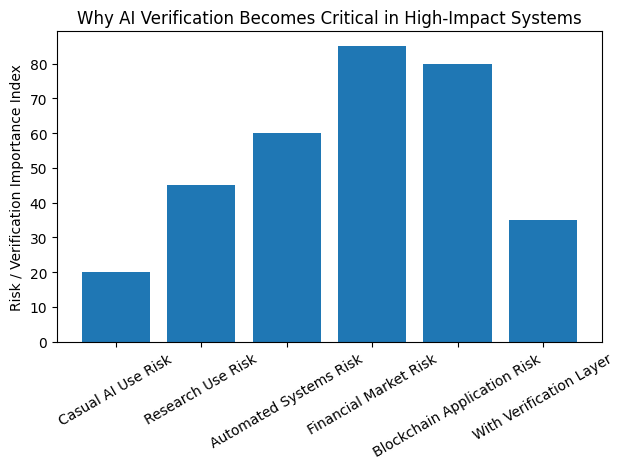

Für zwanglose Gespräche oder einfache Aufgaben können diese Fehler möglicherweise keine ernsthaften Probleme verursachen. Aber wenn KI in Finanzmärkten, automatisierten Systemen, Forschungsumgebungen oder Blockchain-Anwendungen eingesetzt wird, wird Genauigkeit äußerst wichtig. Ein falsches Stück Information könnte zu schlechten Entscheidungen, finanziellen Verlusten oder beschädigtem Vertrauen führen. Aus diesem Grund wird die Verifizierung zu einem der wichtigsten Themen in der Zukunft der künstlichen Intelligenz.

Mira Network geht diese Herausforderung aus einer sehr interessanten Perspektive an. Anstatt im Wettlauf um den Bau größerer oder schnellerer KI-Modelle zu konkurrieren, konzentriert sich das Projekt darauf, KI-Ausgaben zuverlässig und verifizierbar zu machen. Das Ziel ist es, nicht nur Informationen zu generieren, sondern auch zu bestätigen, ob diese Informationen tatsächlich korrekt sind.

Die Kernidee hinter Mira Network besteht darin, komplexe KI-Ausgaben in kleinere, verifizierbare Ansprüche zu transformieren. Wenn ein KI-System eine Antwort generiert, akzeptiert Mira diese nicht einfach als einen Block von Informationen. Stattdessen trennt das System diese Antwort in mehrere einzelne Aussagen. Jede Aussage kann dann unabhängig untersucht und validiert werden.

Diese Ansprüche werden über ein Netzwerk unabhängiger KI-Validatoren verteilt. Jeder Validator überprüft die Ansprüche und prüft ihre Genauigkeit. Da der Validierungsprozess dezentralisiert ist, verlässt sich das System nicht auf ein Modell, ein Unternehmen oder eine Autorität. Stattdessen tragen mehrere Teilnehmer zum Verifizierungsprozess bei und schaffen einen Konsens darüber, was wahr ist und was nicht.

Diese dezentrale Struktur schafft eine stärkere Form des Vertrauens. Anstatt einer einzelnen Quelle zu vertrauen, baut das Netzwerk Vertrauen durch verteilte Vereinbarung auf. Blockchain-Technologie hilft, diesen Prozess zu koordinieren und sicherzustellen, dass die Verifizierungsergebnisse transparent und prüfbar sind.

Ein weiterer wichtiger Teil des Systems ist die Anreizstruktur. Teilnehmer, die genaue Verifizierungen bereitstellen, werden belohnt, während unehrliches oder nachlässiges Verhalten bestraft werden kann. Diese wirtschaftlichen Anreize helfen, die Integrität des Netzwerks aufrechtzuerhalten. Sie ermutigen die Teilnehmer, ehrliche Analysen beizutragen und Manipulation oder falsche Validierung abzuschrecken.

Was ich besonders aufregend finde, ist, wie dieses Modell die Zukunft autonomer Systeme unterstützen könnte. In den kommenden Jahren könnten KI-Agenten direkt im dezentralen Finanzwesen, auf Datenmärkten und in digitaler Infrastruktur tätig sein. Diese Agenten könnten Märkte analysieren, Strategien umsetzen und mit Smart Contracts ohne menschliches Eingreifen interagieren. In einer solchen Umgebung wird zuverlässige Information unerlässlich.

Eine Verifizierungsschicht wie Mira Network kann als Schutzmaßnahme für diese Systeme fungieren. Durch die Bestätigung der Genauigkeit von KI-Ausgaben, bevor sie in kritischen Prozessen verwendet werden, kann das Netzwerk Risiken reduzieren und die Zuverlässigkeit verbessern. Anstatt blindem Vertrauen in KI-Modelle zu vertrauen, erhalten Entwickler und Nutzer Zugang zu verifizierter Intelligenz.

Während die künstliche Intelligenz weiterhin in neue Bereiche der Technologie expandiert, wird Vertrauen eine der wertvollsten Ressourcen werden. Mächtige Modelle allein sind nicht genug. Systeme müssen auch beweisen, dass ihre Ausgaben korrekt und zuverlässig sind. Mira Network stellt einen Versuch dar, diese Vertrauensschicht für die von KI gesteuerte Welt aufzubauen.

Die Zukunft der KI wird wahrscheinlich nicht nur durch Innovationen im Modedesign geprägt sein, sondern auch durch Systeme, die Transparenz und Verantwortlichkeit gewährleisten. Projekte, die künstliche Intelligenz mit dezentraler Verifizierung kombinieren, könnten eine wichtige Rolle in dieser Transformation spielen.

Für mich stellt Mira Network einen frühen Schritt in eine Zukunft dar, in der Intelligenz nicht nur mächtig, sondern auch nachweisbar ist.