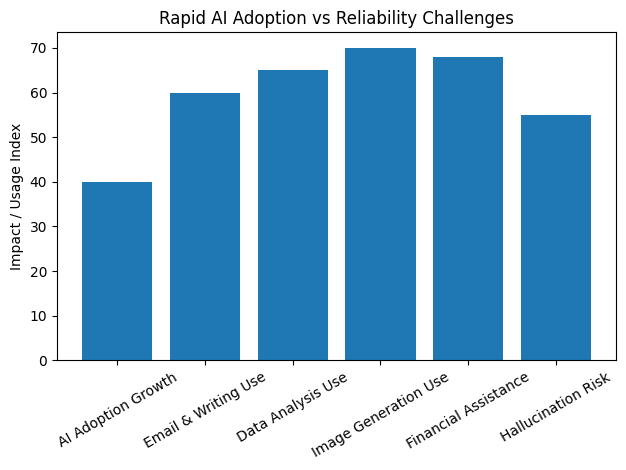

Ich denke oft darüber nach, wie schnell künstliche Intelligenz Teil des täglichen Lebens wird. Noch vor ein paar Jahren hörten die meisten Menschen nur in Forschungslabors oder auf Technologiekonferenzen von KI. Heute ist sie überall. Sie schreibt E-Mails, hilft Menschen beim Lernen, analysiert Daten, erstellt Bilder und unterstützt sogar bei finanziellen Entscheidungen. Die Geschwindigkeit dieses Wandels ist unglaublich, und jeden Monat werden KI-Systeme leistungsfähiger als zuvor.

Aber während diese Technologie stärker wird, wird eine neue Frage wichtiger denn je. Können wir wirklich den Informationen vertrauen, die KI produziert?

Die meisten modernen KI-Modelle arbeiten mit Wahrscheinlichkeit. Sie analysieren riesige Datenmengen und versuchen, die wahrscheinlichste Antwort auf eine Frage vorherzusagen. Viele dieser Antworten sind oft hilfreich und genau. Allerdings erzeugen KI-Systeme manchmal Antworten, die selbstbewusst klingen, aber tatsächlich falsch sind. Diese Fehler werden oft als Halluzinationen bezeichnet. Das System kann Fakten erfinden, Quellen missverstehen oder Informationen auf eine Weise kombinieren, die etwas erzeugt, das wahr aussieht, aber nicht durch Beweise gestützt wird.

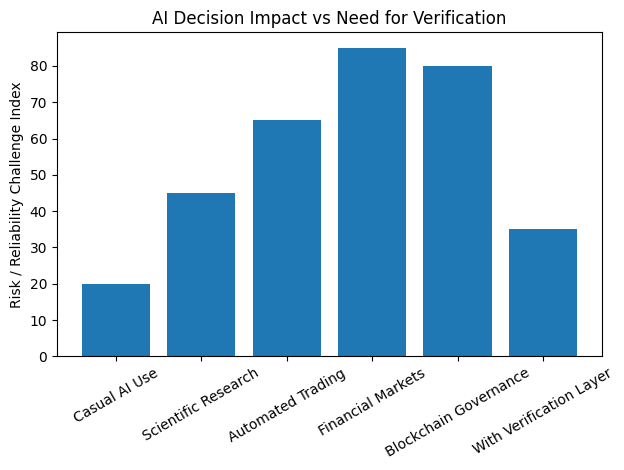

In einfachen Gesprächen könnte dies keine ernsthaften Probleme verursachen. Aber die Situation ändert sich, wenn KI beginnt, wichtige Entscheidungen zu beeinflussen. Stellen Sie sich vor, KI wird in Finanzmärkten, automatisierten Handelssystemen, wissenschaftlicher Forschung oder Blockchain-Governance eingesetzt. In diesen Umgebungen könnte selbst ein kleiner Fehler zu großen finanziellen Verlusten, schlechten Strategien oder beschädigtem Vertrauen führen. Deshalb wird Zuverlässigkeit eine der größten Herausforderungen in der Zukunft der künstlichen Intelligenz.

Hier führt Mira Network eine interessante Lösung ein.

Anstatt sich nur darauf zu konzentrieren, größere oder schnellere KI-Modelle zu bauen, konzentriert sich Mira Network auf etwas Tieferes. Das Projekt konzentriert sich auf Verifizierung. Sein Ziel ist es, KI-generierte Informationen in etwas zu transformieren, das überprüft, validiert und vertraut werden kann.

Die Art, wie Mira Network dieses Problem angeht, ist ziemlich innovativ. Wenn eine KI eine komplexe Antwort produziert, behandelt Mira sie nicht als ein einzelnes Stück Information. Stattdessen zerlegt das System diese Ausgabe in kleinere Ansprüche. Jeder dieser Ansprüche kann dann unabhängig analysiert werden.

Diese Ansprüche werden über ein Netzwerk unabhängiger Validatoren verteilt. Jeder Validator prüft den Anspruch und entscheidet, ob die Informationen genau sind. Da viele Validatoren an diesem Prozess teilnehmen, basiert das Endergebnis auf Konsens und nicht auf Vertrauen in ein Modell oder ein Unternehmen. Diese dezentrale Struktur hilft, Vorurteile zu reduzieren und die Zuverlässigkeit zu verbessern.

Die Blockchain-Technologie spielt auch eine wichtige Rolle in diesem Prozess. Sie ermöglicht es, Verifizierungsergebnisse transparent aufzuzeichnen und schafft eine überprüfbare Historie, wie Informationen validiert wurden. Diese Transparenz hilft, Vertrauen zwischen Entwicklern, Nutzern und Systemen aufzubauen, die auf die Daten angewiesen sind.

Ein weiteres wichtiges Element ist der Anreizmechanismus. Validatoren, die genaue Analysen bereitstellen, werden belohnt, während unehrliches Verhalten zu Strafen führen kann. Dies ermutigt die Teilnehmer, ehrlich beizutragen und stärkt die Zuverlässigkeit des Netzwerks.

Was dieses Konzept spannend macht, ist, wie es die Zukunft autonomer digitaler Systeme unterstützen könnte. In den kommenden Jahren könnten KI-Agenten direkt mit dezentralen Finanzplattformen, Smart Contracts und digitalen Ökonomien interagieren. Sie könnten Liquidität verwalten, Märkte analysieren oder automatisierte Strategien ausführen. In einem solchen Umfeld wird zuverlässige Information extrem wichtig.

Eine Verifizierungsschicht wie Mira Network könnte als schützendes System für diese intelligenten Agenten fungieren. Indem sie KI-Ausgaben überprüft, bevor sie in kritischen Entscheidungen verwendet werden, kann das Netzwerk helfen, Risiken zu reduzieren und das Vertrauen in automatisierte Systeme zu verbessern.

Während sich die künstliche Intelligenz weiterhin in immer mehr Bereiche der Technologie ausbreitet, wird Vertrauen eine der wertvollsten Ressourcen werden. Mächtige Algorithmen allein reichen nicht aus. Die Systeme, die auf lange Sicht erfolgreich sind, werden diejenigen sein, die beweisen können, dass ihre Informationen genau und zuverlässig sind.

Mira Network stellt einen frühen Schritt in diese Zukunft dar. Es zeigt, dass die nächste Phase der KI-Entwicklung nicht nur darin bestehen könnte, intelligentere Modelle zu schaffen, sondern auch Systeme zu entwickeln, die Intelligenz überprüfbar machen.

Wenn künstliche Intelligenz der Motor ist, der die digitale Zukunft antreibt, dann könnte die Verifizierung das Sicherheitssystem werden, das diesen Motor zuverlässig am Laufen hält.