Ich habe etwas bemerkt, nachdem ich eine Zeit lang mit KI-Systemen gearbeitet habe. Die Leute hinterfragen selten Antworten, die schnell kommen und selbstbewusst klingen. Es passiert überall. Jemand fragt ein Modell nach einem historischen Ereignis, einem medizinischen Thema oder sogar nach etwas Triviale wie wie viele Satelliten die Erde umkreisen. Die Antwort erscheint sofort, geschrieben in klaren Absätzen, oft mit Verweisen. Die meisten Leser gehen davon aus, dass es zuverlässig ist.

Und normalerweise… ist es das.

Aber nicht immer.

Ich erinnere mich, dass ich vor Monaten ein KI-Modell getestet habe, während ich ein technisches Thema recherchierte. Die Erklärung sah auf den ersten Blick perfekt aus. Flüssige Sprache. Logischer Fluss. Einige Zitate verstreut. Erst nachdem ich tiefer gegraben habe, wurde mir klar, dass eine der Kernbehauptungen einfach falsch war. Nicht böswillig falsch. Einfach… selbstbewusst falsch.

Dieser Moment blieb mir im Gedächtnis. Nicht, weil das Modell gescheitert ist. Modelle scheitern ständig. Was mir im Gedächtnis blieb, war, wie leicht sich der Fehler hätte ausbreiten können, wenn ihn niemand überprüft hätte.

Das ist der unbequeme Teil moderner KI-Systeme. Sie erzeugen Informationen extrem gut. Aber Erzeugung ist nicht dasselbe wie Verifizierung.

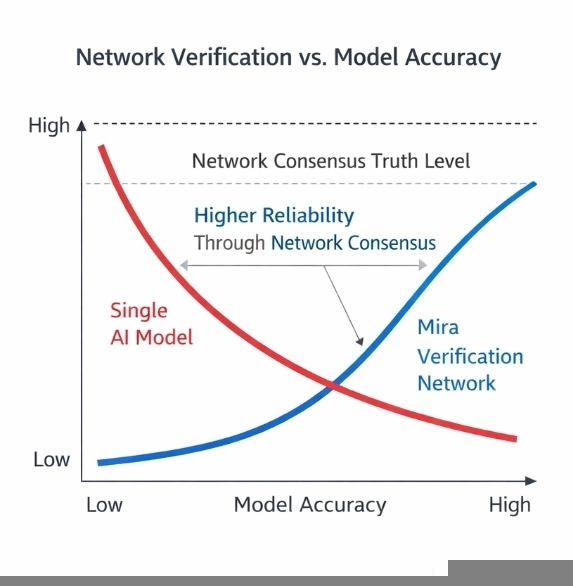

Jahrelang hat die Branche versucht, diese Lücke zu schließen, indem sie die Modelle selbst verbesserte. Größere Datensätze, besseres verstärkendes Lernen, stärkere Benchmarks. Jede Verbesserung half ein wenig. Dennoch blieb die zugrunde liegende Struktur die gleiche: Ein System produziert die Antwort und die Benutzer entscheiden, ob sie ihr vertrauen.

Je mehr ich darüber nachdenke, desto fragiler fühlt sich dieses Setup an.

Denn Zuverlässigkeit ist möglicherweise nicht etwas, das ein einzelnes Modell vollständig garantieren kann.

Hier wird die Design-Philosophie hinter dem Mira-Netzwerk interessant. Anstatt ein Modell zu bitten, seine eigene Genauigkeit zu beweisen, geht das System von etwas anderem aus: Wahrheit könnte aus einem Netzwerk entstehen, anstatt von einer einzelnen Maschine.

Zunächst klingt diese Idee theoretisch. Aber die Mechanik ist tatsächlich ziemlich praktisch.

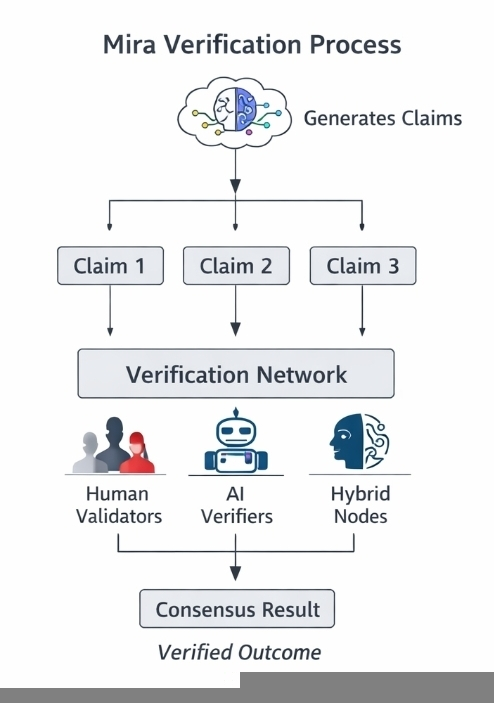

Stellen Sie sich ein KI-Modell vor, das auf eine komplexe Frage antwortet. Anstatt die Ausgabe als eine fertige Antwort zu behandeln, trennt das System sie in kleinere Ansprüche. Jeder Anspruch wird zu etwas, das für sich selbst bewertet werden kann. Eine Statistik. Eine faktische Aussage. Eine logische Schlussfolgerung.

Stellen Sie sich jetzt vor, wie diese Ansprüche durch eine Verifizierungsschicht fließen.

Mehrere Validierer prüfen sie. Einige könnten automatisierte Systeme sein, die Quellen gegenprüfen oder strukturierte Tests durchführen. Andere könnten Teilnehmer sein, die Tokens setzen und die Ansprüche sorgfältig überprüfen. Jeder Validierer erstellt eine Bewertung. Einigung beginnt sich zu bilden. Uneinigkeit tritt ebenfalls auf.

Schließlich erreicht das Netzwerk etwas wie Konsens.

Nicht perfekte Wahrheit. Sondern ein kollektives Urteil darüber, ob der Anspruch standhält.

Diese Idee erinnert mich ein wenig daran, wie Blockchains vor Jahren die Transaktionsverifizierung gelöst haben. Kein einzelner Knoten entscheidet, ob eine Transaktion gültig ist. Stattdessen prüfen unabhängige Validierer dieselben Informationen und kommen zu einem gemeinsamen Ergebnis.

Mira Network scheint ein ähnliches Koordinationsprinzip auf Informationen selbst anzuwenden.

Was dies von traditionellem Fact-Checking unterscheidet, ist die Anreizschicht. Verifizierung ist nicht nur freiwillige Arbeit oder zentrale Moderation. Teilnehmer im Netzwerk können Tokens setzen, wenn sie Ansprüche validieren. Wenn ihre Bewertungen konstant von genauen Ergebnissen abweichen, riskieren sie, einen Teil dieses Einsatzes zu verlieren.

Dieses Detail verändert das Verhalten.

Wenn Menschen etwas auf dem Spiel haben, neigen sie dazu, langsamer zu werden. Sie überprüfen Dinge doppelt. Nachlässige Validierung wird teuer.

Dennoch lösen Anreize allein nicht alles. Koordinationsprobleme verschwinden selten so leicht.

Eine Sorge, zu der ich immer wieder zurückkehre, ist der Maßstab. KI-Systeme erzeugen enorme Mengen an Informationen. Denken Sie an Suchmaschinen, Chat-Assistenten, automatisierte Forschungstools. Wenn jeder bedeutende Anspruch eine Verifizierung erfordern würde, müsste das Netzwerk einen enormen Datenstrom verarbeiten.

Das ist nicht trivial.

Eine weitere Sorge ist das soziale Verhalten innerhalb dezentraler Systeme. Validierer könnten anfangen, den Mehrheitsmeinungen zu folgen, anstatt Ansprüche unabhängig zu analysieren. Wir haben diese Dynamik in der Governance-Abstimmung in vielen Krypto-Netzwerken gesehen. Anreize drängen die Teilnehmer zur Sicherheit. Manchmal bedeutet das, sich mit der Masse zu alignieren.

Das System hängt also immer noch von einem empfindlichen Gleichgewicht ab. Genug Anreize, um ehrliche Verifizierung zu fördern. Genug Unabhängigkeit, um blinden Konsens zu verhindern.

Die Frage, die zu stellen ist, ist, ob ein dezentrales Netzwerk dieses Gleichgewicht über die Zeit aufrechterhalten kann.

Ich denke ständig darüber nach, wie sich das mit der Art und Weise vergleicht, wie Vertrauen im frühen Internet entstand. Damals kam die Glaubwürdigkeit von Institutionen. Universitäten, Fachzeitschriften, Medienorganisationen. Später verlagerte sich das auf Plattformen und Reputationssysteme. Bewertungen, Rezensionen, Follower-Zahlen.

KI bringt ein anderes Problem mit sich. Maschinen erzeugen jetzt enorme Mengen an Informationen schneller, als Menschen sie bewerten können.

Wenn dieser Trend anhält, wird sich das Verlassen auf institutionelle Verifizierung allein wahrscheinlich nicht skalieren lassen.

Hier beginnt der Ansatz des Mira-Netzwerks, konzeptionell Sinn zu machen. Anstatt sich auf eine einzige Autorität oder ein einzelnes Modell zu verlassen, verteilt es die Verifizierung über ein Netzwerk von Teilnehmern, die Ansprüche gemeinsam bewerten.

Genauigkeit wird etwas, das das Netzwerk gemeinsam erreicht.

Aber selbst während ich dies schreibe, bin ich mir bewusst, dass die Idee auf viele Arten entfaltet werden könnte. Systeme wie dieses sehen in der Theorie oft elegant aus und in der Praxis chaotisch. Ökonomische Anreize können seltsame Verhaltensweisen erzeugen. Verifikationsmärkte könnten Geschwindigkeit anstelle von sorgfältiger Analyse belohnen. Oder Entwickler könnten die Verifizierungsschicht ganz umgehen, wenn sie ihre Anwendungen verlangsamt.

All das ist möglich.

Dennoch fühlt sich der zugrunde liegende Perspektivwechsel wichtig an.

Lange Zeit konzentrierte sich die Diskussion über die Zuverlässigkeit von KI auf den Aufbau besserer Modelle. Mira Network scheint einen anderen Weg vorzuschlagen: den Aufbau besserer Verifizierungssysteme um diese Modelle herum.

Vielleicht ist das die echte Lektion hier.

KI-Modelle erzeugen Informationen. Netzwerke bewerten sie.

Und wenn diese Modell-Netzwerk-Beziehung in der Zukunft üblich wird, könnten die Systeme, die entscheiden, welche Informationen wir vertrauen, weniger wie Einzelmaschinen und mehr wie koordinierte Ökosysteme von Teilnehmern aussehen, die versuchen, manchmal unvollkommen zuzustimmen, was tatsächlich wahr ist.