@Mira - Trust Layer of AI Nachdem ich eine Weile beobachtet habe, wie künstliche Intelligenz in realen Situationen agiert, wird ein Muster langsam schwer zu ignorieren. Die Systeme klingen selbstbewusst. Manchmal fast überzeugend. Doch unter diesem Selbstbewusstsein gibt es etwas Fragiles, das alles zusammenhält.

Wahrscheinlichkeit.

Die meisten KI-Modelle heute arbeiten, indem sie Muster vorhersagen, anstatt etwas zu beweisen. Sie erzeugen Antworten, die korrekt aussehen, weil sie statistisch den richtigen Antworten ähneln. Für den gelegentlichen Gebrauch funktioniert das überraschend gut. Menschen stellen Fragen, erhalten Zusammenfassungen, entwerfen E-Mails. Die Maschine klingt ausreichend hilfreich.

Aber in dem Moment, in dem diese Ausgaben beginnen, näher an realen Entscheidungen zu driften, beginnt die Unsicherheit sichtbar zu werden.

Ein Handelsmodell interpretiert den Marktzusammenhang falsch. Ein Forschungsassistent fabriziert ein Zitat, das völlig plausibel aussieht. Manchmal ist der Fehler klein genug, dass er unbemerkt bleibt. Andere Male wird es offensichtlich, fast peinlich, als hätte das System leise den Rand dessen überschritten, was es tatsächlich weiß.

Nachdem ich das ein paar Mal gesehen habe, beginnt das Gespräch über die Zuverlässigkeit von AI, sich leicht fehlgerahmt anzufühlen. Das Problem dreht sich nicht nur darum, die Modellgenauigkeit zu verbessern. Etwas anderes fehlt.

Überprüfung.

Ein Mechanismus, der eine fundierte Vermutung von etwas trennt, das Vertrauen verdient.

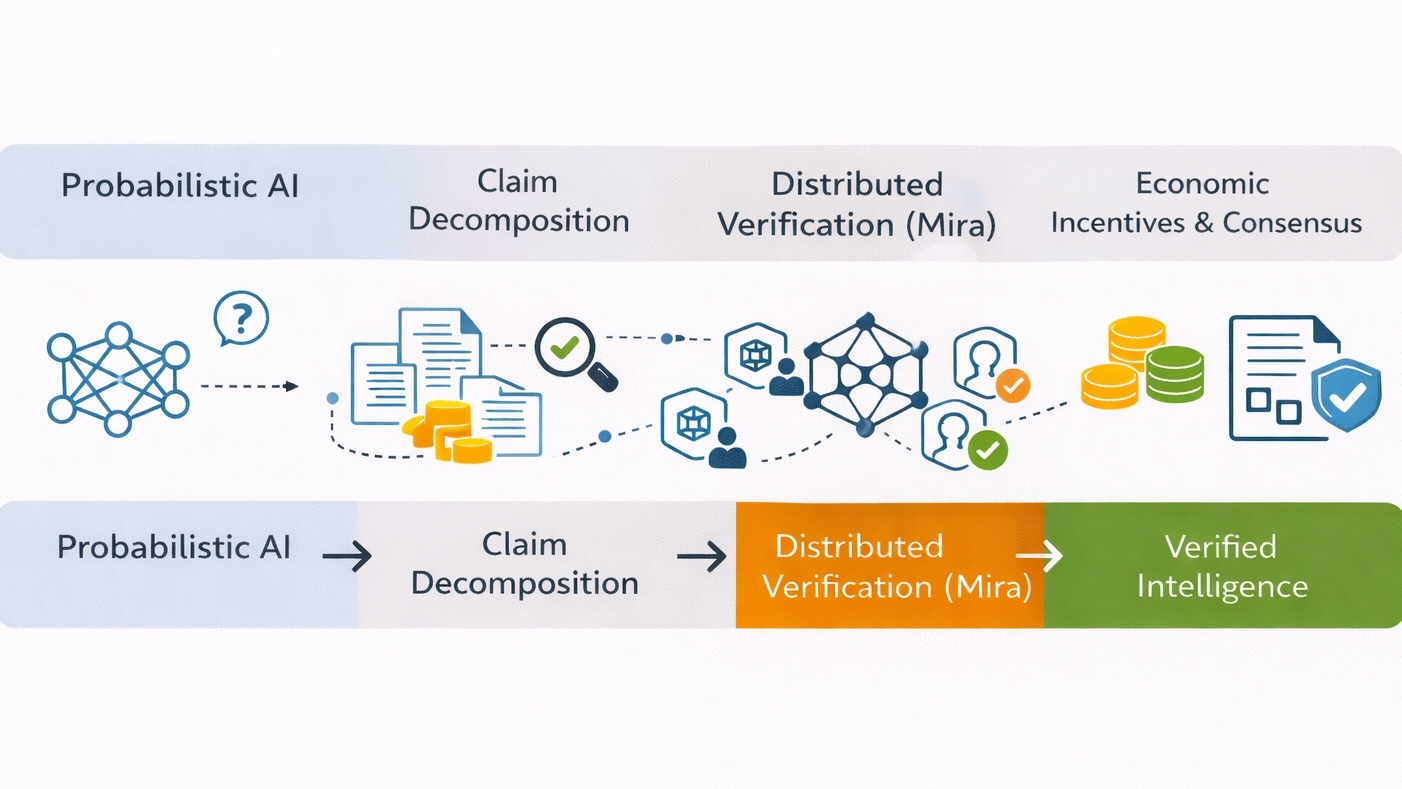

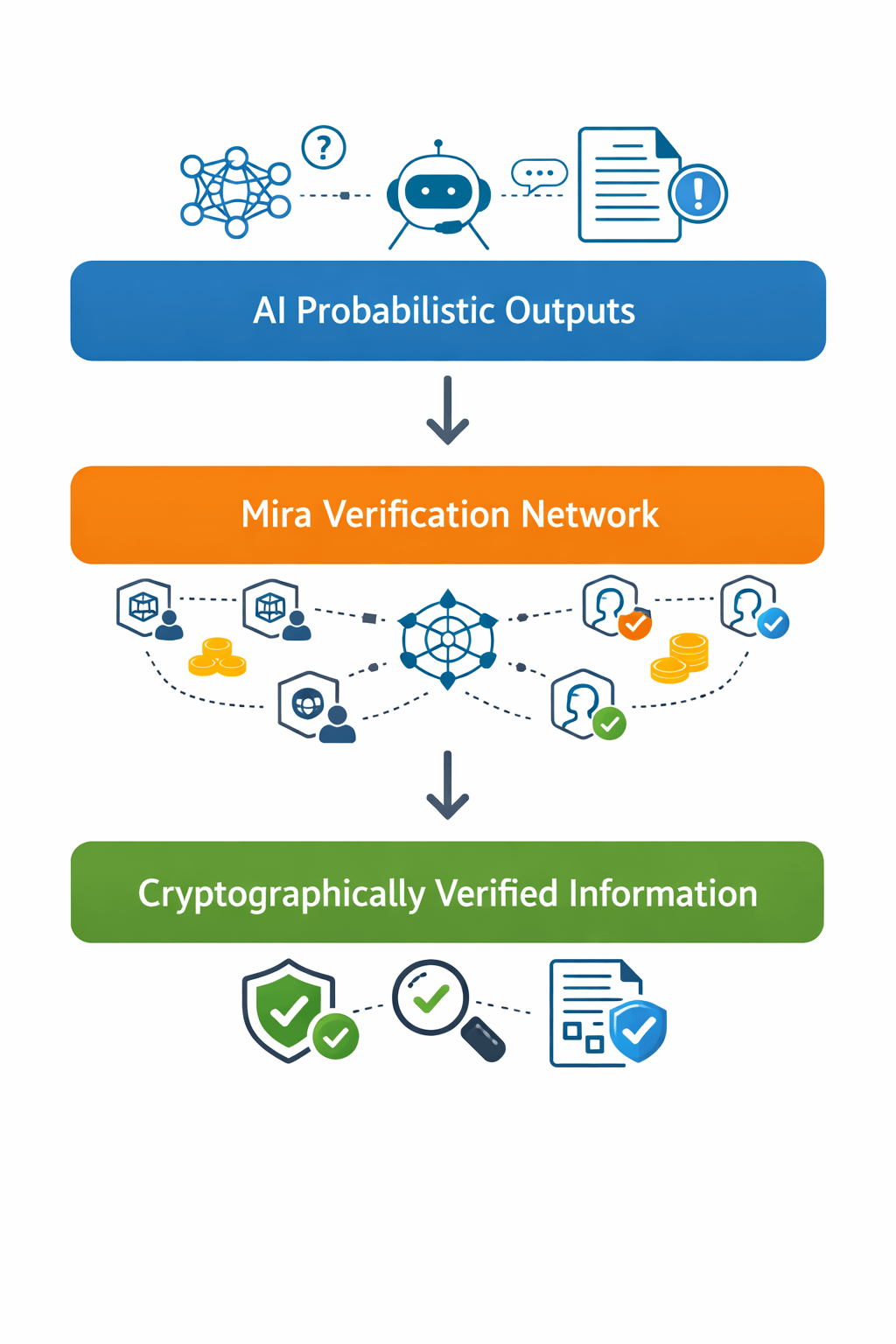

Hier beginnt Mira nicht als plötzlicher Durchbruch zu erscheinen, sondern als ein Versuch, das Problem leicht umzustellen. Anstatt zu fragen, ob AI bessere Antworten generieren kann, scheint das System eine ganz andere Frage zu stellen. Was, wenn AI-Ausgaben einen Überprüfungsprozess durchlaufen müssten, bevor jemand sich auf sie verlässt?

Als ich zum ersten Mal nachverfolgte, wie die Architektur funktioniert, fühlte es sich weniger wie das Lesen von Dokumentationen an und mehr wie das Beobachten eines seltsamen Überprüfungsprozesses.

Eine AI-Antwort bleibt nicht intakt. Sie wird zerlegt. Ansprüche, Fragmente von Argumentationen, kleine Informationsstücke. Diese Teile bewegen sich über ein Netzwerk, in dem andere Modelle sie unabhängig überprüfen.

Es verändert die Form der Ausgabe auf subtile Weise.

Anstatt sich wie eine abgeschlossene Aussage zu verhalten, beginnt die Antwort mehr wie ein Argument auszusehen, das durch eine Überprüfung geht. Verschiedene Modelle testen individuelle Ansprüche. Vereinbarungen beginnen sich in Fragmenten zu bilden. Schließlich setzt sich etwas, das einem Konsens ähnelt, im Netzwerk fest.

Nicht der Beweis im strengen mathematischen Sinne. Aber auch kein einzelnes Modell, das ins Leere spricht.

Etwas näher an strukturierter Prüfung.

Dennoch wirft das Design einige unangenehme Fragen auf, je länger man darüber nachdenkt.

Konsens ist ein mächtiges Koordinationstool. Blockchains haben das vor Jahren bewiesen. Aber Konsens produziert nicht automatisch Wahrheit. Ein Netzwerk kann sich auf etwas einigen und dennoch falsch liegen, insbesondere wenn die Teilnehmer ähnliche Trainingsverzerrungen oder Datenquellen teilen.

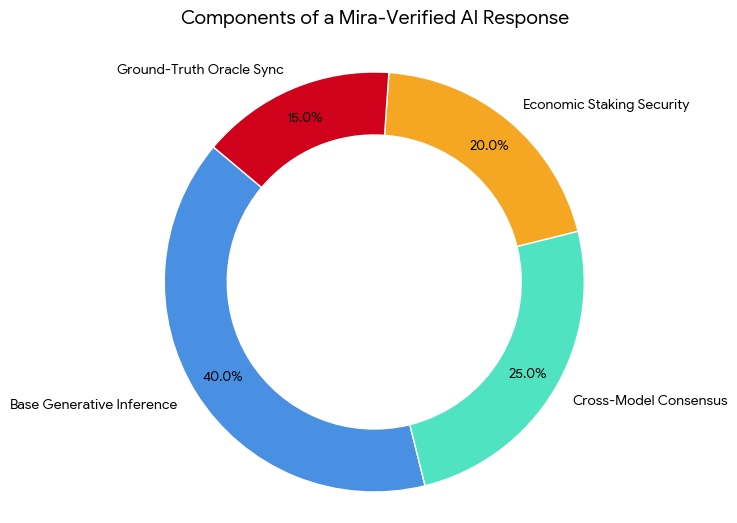

Dann kommen die wirtschaftlichen Aspekte ins Spiel, was die Dinge kompliziert.

Die Überprüfung in Mira hängt von Anreizen ab. Validatoren nehmen an der Bewertung von Ansprüchen teil, setzen Tokens ein und halten die Aktivität im Netzwerk aufrecht. In der Theorie schafft das Verantwortung. Wenn jemand falsche Informationen validiert, trägt er wirtschaftliches Risiko.

Aber Anreizsysteme bleiben selten für immer perfekt ausgerichtet. Märkte verschieben sich. Aufmerksamkeit schwindet. Teilnehmer reagieren schneller auf Renditen als auf Ideale zur Überprüfung.

Wenn diese Anreize schwächer werden, könnte die Qualität der Überprüfung mit ihnen schwächer werden. Es ist zumindest schwer vorstellbar, dass die beiden völlig getrennt sind.

Die breitere Krypto-Umgebung macht die Koordination ebenfalls nicht einfacher. Infrastrukturnetzwerke erscheinen oft während narrativer Zyklen, AI-Token für eine Weile, dann modulare Blockchains, dann etwas ganz anderes. Frühe Dynamik kann Validatoren schnell anziehen.

Sie dort zu halten, ist normalerweise schwieriger.

Überprüfungsnetzwerke bringen eine weitere subtile Herausforderung mit sich. Ihr Wert wird hauptsächlich sichtbar, wenn etwas ohne sie schiefgelaufen wäre. Ein irreführendes Ergebnis korrigiert. Ein halluzinierter Anspruch abgelehnt.

Eine solche Art von Schutz ist schwer in Echtzeit zu messen. Oder zumindest schwer zu schätzen, während alles zu funktionieren scheint.

Die Einführung bringt auch ihre eigene Reibung mit sich. Das Routing von AI-Ausgaben durch ein verteiltes Überprüfungsnetzwerk fügt Schritte zur Pipeline hinzu. Zusätzliche Koordination. Möglicherweise zusätzliche Latenz. Entwickler, die AI-Systeme integrieren, priorisieren oft Geschwindigkeit, Einfachheit und Durchsatz.

Überprüfungsschichten bewegen sich in die entgegengesetzte Richtung.

Doch gleichzeitig, während AI-Systeme beginnen, mit Finanzmärkten, Governance-Tools und autonomen Software-Agenten zu interagieren, wächst die Kosten unkontrollierter Fehler leise.

Diese Spannung hat sich noch nicht gelöst.

Für den Moment befindet sich Mira in einer interessanten Position. Nicht ganz Infrastruktur, von der jeder abhängt, aber auch nicht nur ein theoretischer Rahmen. Mehr wie ein fortlaufendes Experiment, ob verteilte Konsensbildung das Vertrauen in maschinelle Intelligenz umgestalten kann.

Und vielleicht ist der interessanteste Teil nicht, ob Mira AI-Ausgaben beweist.

Es ist die Möglichkeit, dass Systeme, die auf Wahrscheinlichkeiten basieren, irgendwann etwas wie dies benötigen – eine Struktur, die das Vertrauen der Maschine für einen Moment pausiert und fragt, ob jemand anderes zustimmt.