Wenn KI nicht einverstanden ist, entsteht Vertrauen:

Mira’s Multi-Model Accountability Revolution”

Neu definierten Artikel für maximalen Einfluss

@Mira - Trust Layer of AI #Mira

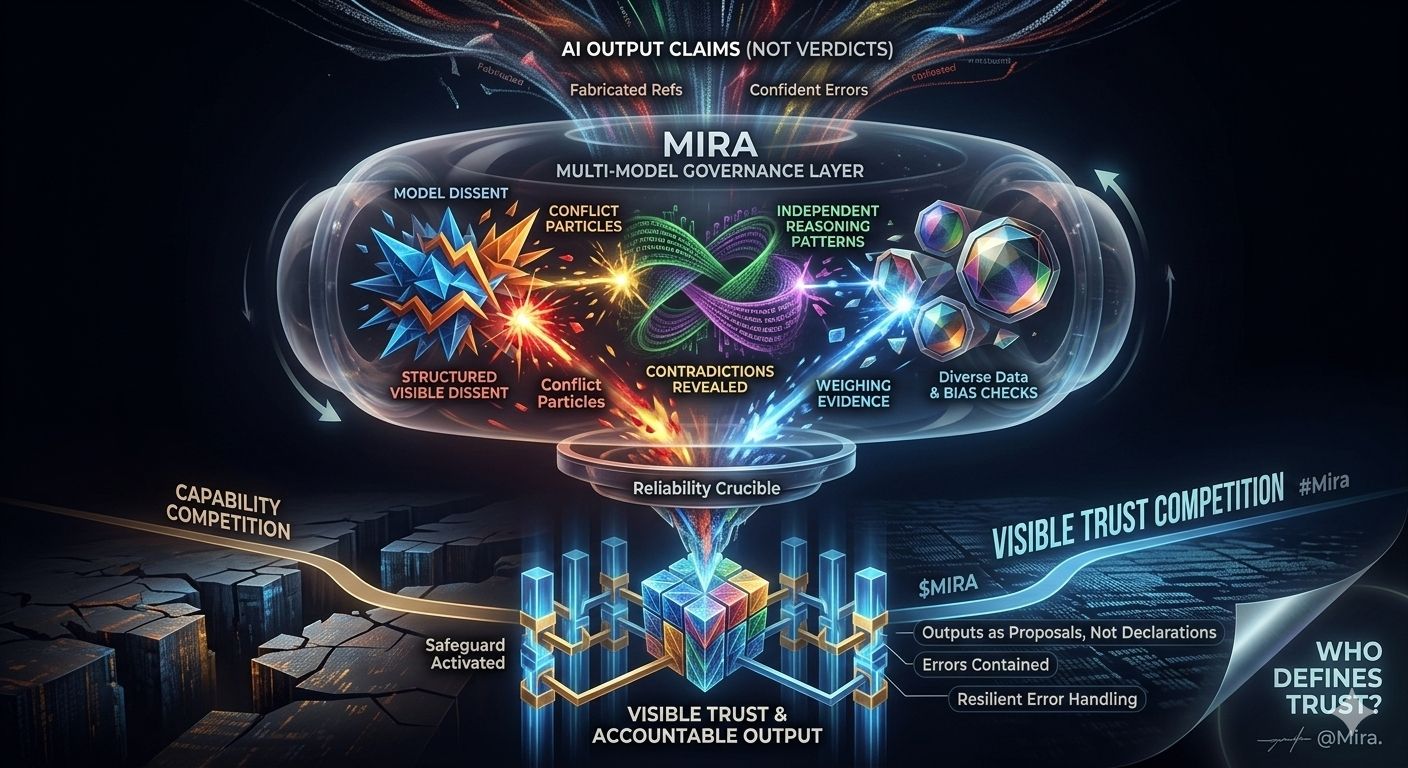

Zuverlässigkeit in der KI geht nicht um einstimmige Antworten – es geht darum, wie Systeme mit Dissens umgehen. Einigung mag beruhigend erscheinen, aber sie kann subtile Mängel verbergen: falsch verstandene Fakten, gefälschte Referenzen oder selbstbewusstes, aber wackeliges Denken. Wahres Vertrauen entsteht, wenn Dissens strukturiert, sichtbar und überprüfbar ist.

Die meisten KI-Fehler sind subtile Flüstern: eine falsch interpretierte Klausel, ein übersehener Kontext, eine selbstbewusste Ausgabe, die auf wackeligen Annahmen basiert. Die Selbstkorrektur eines einzelnen Modells verstärkt oft die gleichen Fehler. Mira kehrt dieses Paradigma um: jede KI-Ausgabe ist eine Behauptung, kein Urteil. Mehrere unabhängige Modelle untersuchen die Behauptung, wobei jedes unterschiedliche Daten, Denkweisen und architektonische Vorurteile einbringt. Überprüfung geht nicht um das lauteste Modell – es geht darum, wie Beweise gewichtet, Widersprüche aufgedeckt und Vertrauen quantifiziert wird.

Konsens ist nuanciert. Zwei Modelle können übereinstimmen, während eines widerspricht – erkennt der Außenseiter einen echten Fehler oder halluziniert er? Miras System identifiziert bedeutungsvolle Meinungsverschiedenheiten im Vergleich zu Lärm. Komplexe Ausgaben zerfallen in überprüfbare Aussagen: Finanzsummen werden überprüfbare Einsichten, rechtliche Argumente verwandeln sich in Ketten von Interpretationen. Modelle müssen nicht intelligenter sein – Ansprüche werden überprüfbar und verantwortbar.

Vertrauen verschiebt sich von Modellen zu Governance-Ebenen. Ausgaben sind glaubwürdig, nicht weil ein Modell dies gesagt hat, sondern weil unabhängige Systeme kompatible Schlussfolgerungen erreicht haben. Transparenz ist der Schlüssel: Überlappende Daten oder ähnliche Architekturen können den Konsens verzerren, daher ist Vielfalt ein Sicherheitsnetz für Zuverlässigkeit.

Überprüfung kostet – Latenz, Berechnung, menschliche Aufsicht. Anwendungen, die KI integrieren, werden jetzt zu Zuverlässigkeitsorchestratoren, die Abwägungen zwischen Geschwindigkeit und Sicherheit managen. Dies verändert die Wettbewerbslandschaft: KI wird nicht nur aufgrund von Fähigkeiten konkurrieren, sondern auch aufgrund von sichtbarem Vertrauen, strukturiertem Widerspruch und widerstandsfähiger Fehlerbehandlung.

Miras Multi-Modell-Governance ist mehr als ein Feature – es ist eine Verantwortungsebene. KI-Ausgaben werden zu Vorschlägen, nicht zu Erklärungen. Fehler sind unvermeidlich, aber das System enthält sie, bevor sie in Märkten, Entscheidungen oder öffentliche Diskussionen eskalieren.

Die entscheidende Frage: Wer definiert Vertrauen, wie wird Widerspruch interpretiert und welche Sicherheitsvorkehrungen werden aktiviert, wenn der Konsens wankt? Dort lebt die Zuverlässigkeit von KI wirklich.

$MIRA