"Das seltsame Muster, das ich beim Testen von KI-Tools bemerkte"

Heute früh experimentierte ich mit ein paar KI-Forschungstools, während ich ein Auge auf Binance Square hatte. Der Markt selbst war ruhig, also verbrachte ich mehr Zeit damit, die Beiträge der CreatorPad-Kampagne zu lesen, als die Charts zu betrachten.

Irgendwann bat ich eines der KI-Systeme, einen DeFi-Governance-Vorschlag zusammenzufassen, den ich studiert hatte. Die Antwort sah perfekt aus. Strukturiert. Selbstbewusst. Fast zu sauber.

Dann verglich ich es mit dem tatsächlichen Vorschlag.

Einige Details waren leicht falsch.

Nichts Dramatisches, aber genug, um mich innehalten zu lassen. Das Modell hatte eine überzeugende Erklärung produziert, die nicht ganz genau war. Und da kam mir der Gedanke: Wenn KI mit dezentralen Systemen interagieren soll, wer überprüft die Informationen, die sie generiert?

Diese Frage führte mich schließlich in das Mira-Kaninchenloch.

Die Infrastruktur-Lücke in KI-Systemen

Die meisten Gespräche über KI in Krypto konzentrieren sich auf Rechennetzwerke oder Modelltraining. Wir hören von dezentralisierten GPU-Clustern, Datenmarktplätzen und Inferenzschichten.

Aber oft fehlt etwas in dieser Diskussion.

KI-Modelle produzieren ständig Ausgaben – Analysen, Vorhersagen, Zusammenfassungen, Empfehlungen. In zentralisierten Plattformen fungieren Unternehmen als Gatekeeper, die diese Ausgaben filtern, bevor die Benutzer sie sehen.

Web3 hat nicht diesen Luxus.

Sobald KI-Agenten in dezentralen Umgebungen zu arbeiten beginnen – Marktanalysedaten analysieren, Governance-Aktionen vorschlagen oder mit Smart Contracts interagieren – können fehlerhafte Ausgaben schnell propagieren.

Was fehlt, ist eine unabhängige Überprüfungsebene.

Anstatt anzunehmen, dass Modelle korrekt sind, benötigen Netzwerke Mechanismen, die die Ergebnisse bestätigen, bevor sie vertraut werden.

Hier wird Miras Architektur interessant.

Miras Ansatz zur Überprüfung

Während ich einige Diskussionen auf CreatorPad und Community-Diagramme, die auf Binance Square geteilt wurden, durchlas, fiel mir auf, dass Mira die Überprüfung fast wie ein paralleles Netzwerk behandelt.

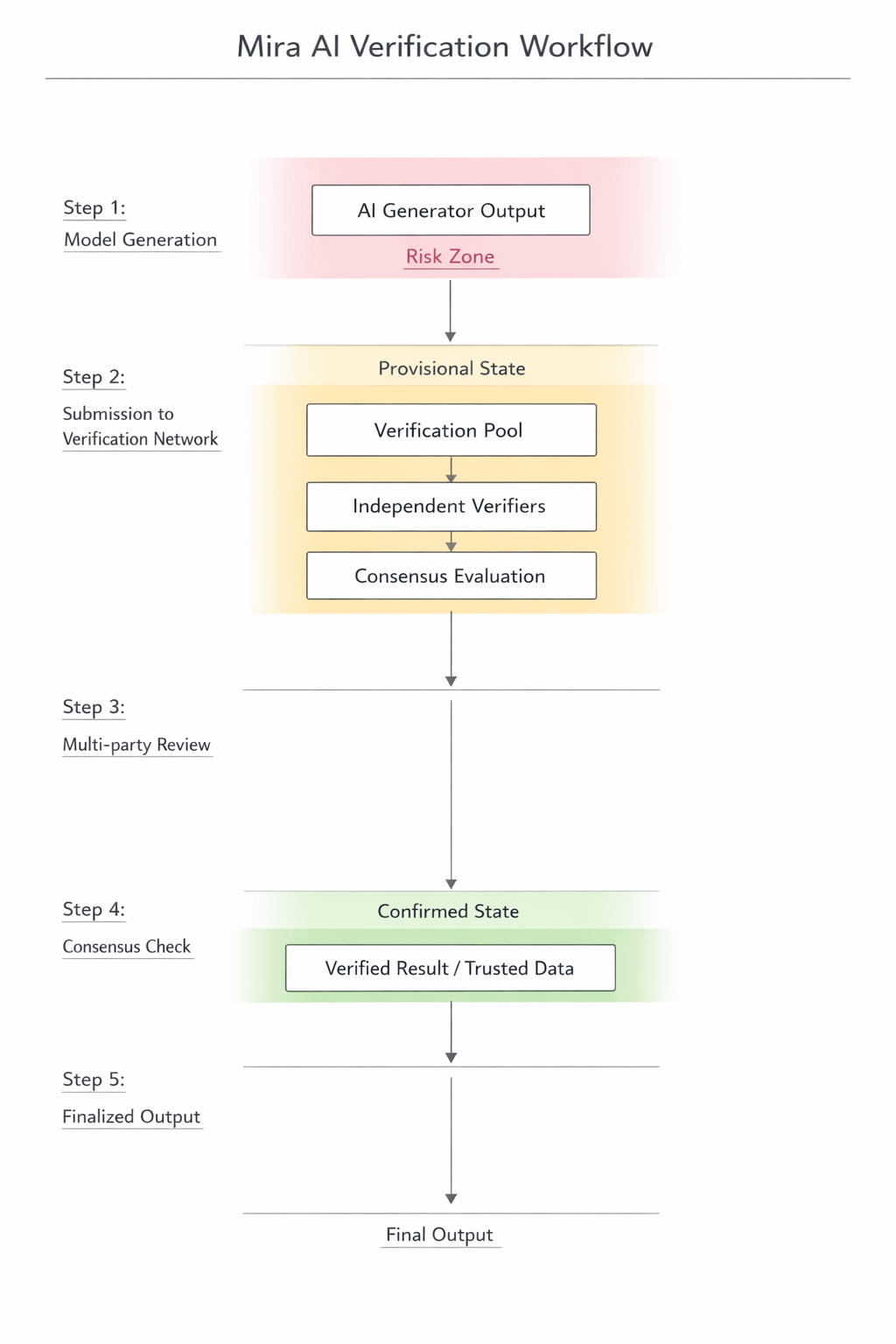

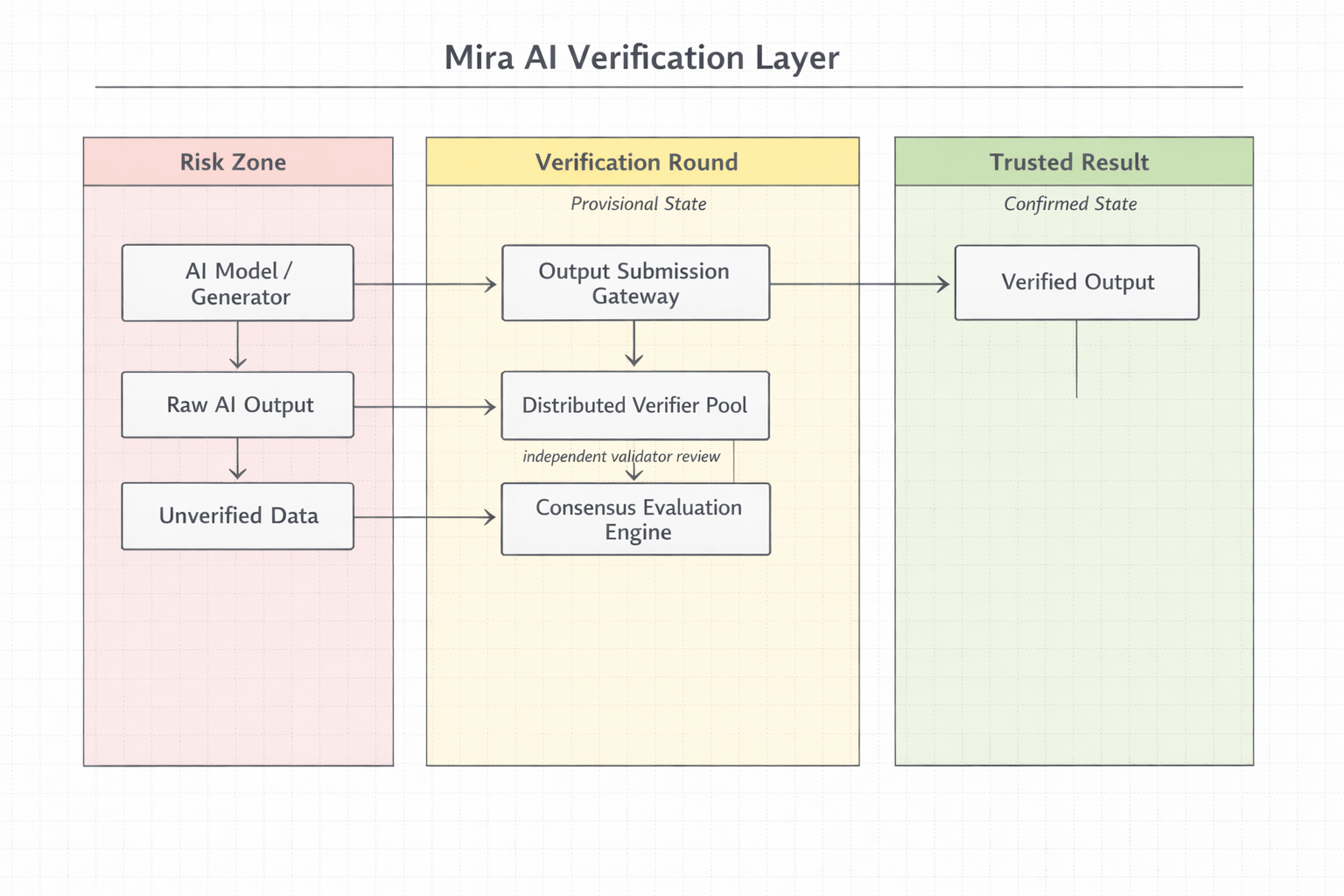

Das Protokoll trennt die KI-Pipeline in zwei verschiedene Rollen:

• Generatoren – KI-Modelle oder Systeme, die Ausgaben produzieren

• Überprüfer – unabhängige Teilnehmer, die diese Ausgaben validieren

Der Workflow ist recht unkompliziert, aber konzeptionell mächtig. Ein KI-Modell generiert eine Antwort oder Analyse. Diese Ausgabe wird nicht sofort zu vertrauenswürdigen Daten. Stattdessen tritt sie in eine Überprüfungsrunde ein, in der mehrere Teilnehmer das Ergebnis überprüfen.

Nur nach Konsens unter den Überprüfern wird die Ausgabe vom System akzeptiert.

Während ich versuchte, die Struktur zu verstehen, zeichnete ich tatsächlich eine kleine Workflow-Illustration in meinen Notizen:

KI-Ausgabe → Überprüfungs-Pool → Konsensbewertung → Überprüftes Ergebnis

Einfach ausgedrückt, wendet Mira eine blockchain-ähnliche Konsensidee auf Informationen anstatt auf Transaktionen an.

Warum dieses Design ein reales Problem löst

Der Grund, warum dies wichtig ist, wird klarer, wenn man darüber nachdenkt, wie KI in dezentrale Systeme integriert wird.

Betrachten Sie autonome Handelsagenten in DeFi. Diese Agenten analysieren die Marktbedingungen und führen Strategien automatisch aus. Wenn ihre Analyse fehlerhaft ist, könnte das System falsche Handelsgeschäfte durchführen.

Oder stellen Sie sich Governance-Assistenten vor, die Vorschläge für Token-Inhaber zusammenfassen. Eine irreführende Zusammenfassung könnte das Abstimmungsverhalten beeinflussen.

Ohne Überprüfung vertrauen dezentrale Systeme im Wesentlichen der Argumentation eines einzelnen KI-Modells.

Mira führt Redundanz ein.

Mehrere unabhängige Teilnehmer prüfen die Ausgabe, bevor sie zu vertrauenswürdigen Daten wird. Dies verringert das Risiko, dass eine fehlerhafte Modell-Ausgabe ein ganzes System beeinflusst.

Es ist ähnlich, wie Blockchains auf viele Validierer angewiesen sind, anstatt einem einzelnen Knoten zu vertrauen.

Eine neue Art von Anreizschicht

Ein weiteres interessantes Detail ist die wirtschaftliche Struktur hinter dem Netzwerk.

Überprüfer sind nicht einfach Freiwillige, die KI-Ausgaben überprüfen. Sie sind incentivierte Teilnehmer, die Belohnungen verdienen, indem sie Ergebnisse genau bewerten.

Das bedeutet, dass die Überprüfung selbst zu einem Dienst innerhalb des Ökosystems wird.

Einige Teilnehmer von CreatorPad haben Mira sogar als Aufbau einer Überprüfungswirtschaft beschrieben, in der die Validierung von maschinell generierten Informationen zu einem Markt wird.

Diese Idee fühlt sich seltsam ähnlich zu frühen Blockchain-Netzwerken an.

Damals fragten die Leute, ob überhaupt jemand an der Validierung von Transaktionen teilnehmen würde. Heute sichern Validierer ganze Finanzökosysteme.

Mira scheint zu erkunden, ob dasselbe Konzept auf KI-generierte Informationen angewendet werden kann.

Die Kompromisse, die noch gelöst werden müssen

Natürlich wirft das System ein paar komplizierte Fragen auf.

Überprüfung klingt einfach, bis man erkennt, dass nicht alle KI-Ausgaben leicht messbar sind. Einige Antworten sind faktisch, während andere Argumentation, Interpretation oder Vorhersagen beinhalten.

Wie beurteilen Überprüfer diese Ausgaben konsistent?

Eine weitere Herausforderung ist die Geschwindigkeit. KI-Systeme arbeiten schnell, während Überprüfungsebenen zusätzliche Schritte einführen. Wenn der Prozess zu langsam wird, könnten Echtzeitanwendungen Schwierigkeiten haben.

Es gibt auch das Koordinationsproblem. Überprüfer benötigen Anreize, die eine unabhängige Analyse fördern, anstatt einfach die Schlussfolgerungen anderer zu kopieren.

Diese Entwurf Herausforderungen werden wahrscheinlich bestimmen, ob Miras Modell in der Praxis funktioniert.

Warum die CreatorPad-Diskussionen über Mira anders erscheinen

Nachdem ich einige Stunden damit verbracht hatte, CreatorPad-Kampagnenbeiträge über das Projekt zu lesen, fiel mir etwas Interessantes auf.

Die meisten Krypto-Diskussionen drehen sich um Narrative und Spekulation. Mira-Gespräche konzentrieren sich tendenziell mehr auf das Systemdesign.

Die Leute stellen Fragen wie:

• Können dezentrale Netzwerke die Argumentation von KI überprüfen?

• Werden Validierungs-Marktplätze um maschinell generierte Daten entstehen?

• Könnten Überprüfungsebenen zur Standardinfrastruktur für KI-Agenten werden?

Das sind tiefere Fragen als typische Kampagnendiskussionen.

Warum die Überprüfungsebene langfristig wichtig sein könnte

Je mehr ich darüber nachdenke, desto mehr fühlt sich Miras Idee so an, als würde sie eine strukturelle Lücke in KI-Systemen ansprechen.

KI-Modelle werden unglaublich gut darin, Informationen zu generieren. Aber allein die Generierung reicht nicht aus.

Dezentrale Systeme benötigen einen Weg, um zu bestätigen, dass Informationen zuverlässig sind.

Blockchains haben das Vertrauen für finanzielle Transaktionen durch verteilten Konsens gelöst. Mira scheint ein ähnliches Konzept für maschinell generiertes Wissen zu erkunden.

Ob das Protokoll letztendlich erfolgreich ist oder nicht, das Problem, das es angeht, fühlt sich sehr real an.

Wenn KI-Agenten in Web3 verbreitet werden, müssen Netzwerke Wege finden, ihre Argumentation zu überprüfen, bevor diese Argumentation die On-Chain-Systeme beeinflusst.

Und diese fehlende Überprüfungsebene könnte sich als ebenso wichtig herausstellen wie die KI-Modelle selbst.

$MIRA #Mira @Mira - Trust Layer of AI

$BTR $DEGO #creatorpad #LearnWithFatima #TradingCommunity #TrendingTopic.