Die Diskussion über künstliche Intelligenz breitet sich schnell in der Technologiewelt aus. Jede Woche sehen wir neue Modelle, neue Fähigkeiten und neue Anwendungen, die entstehen. Aber neben diesem rasanten Fortschritt wächst eine weitere Frage: wie verifizieren wir die von KI-Systemen produzierten Ergebnisse?

Künstliche Intelligenz kann massive Datensätze analysieren, Erkenntnisse generieren und Prozesse schneller automatisieren als je zuvor. Geschwindigkeit allein garantiert jedoch keine Zuverlässigkeit. Da KI in kritische Systeme integriert wird, wird es zunehmend wichtig, sicherzustellen, dass die Ergebnisse vertrauenswürdig sind.

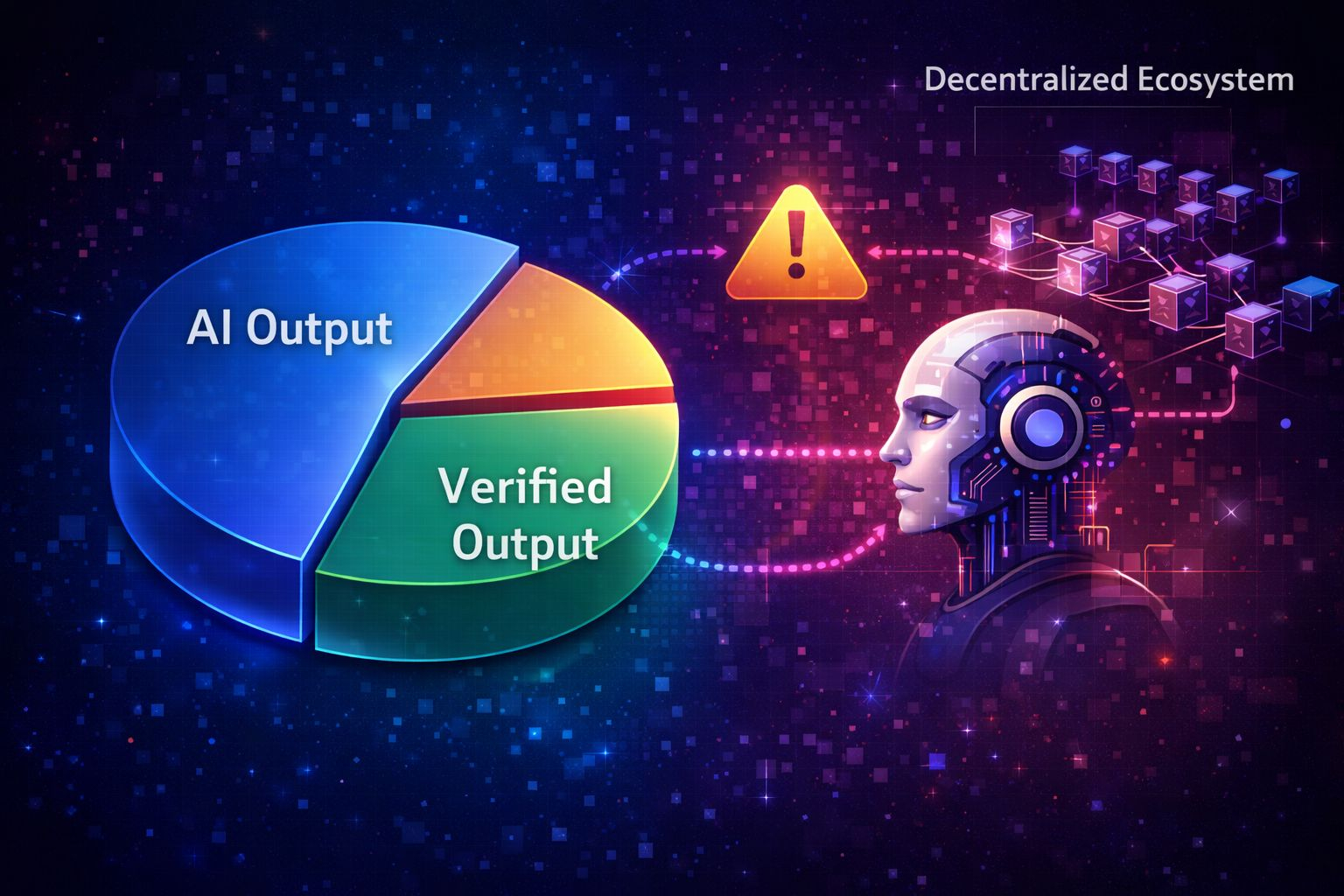

Diese Herausforderung wird in dezentralen Ökosystemen noch komplexer. In traditionellen zentralisierten Plattformen verlassen sich die Benutzer oft auf die Glaubwürdigkeit der Unternehmen, die das System betreiben. Aber in Web3-Umgebungen muss das Vertrauen aus transparenten Mechanismen und nicht aus zentraler Autorität kommen.

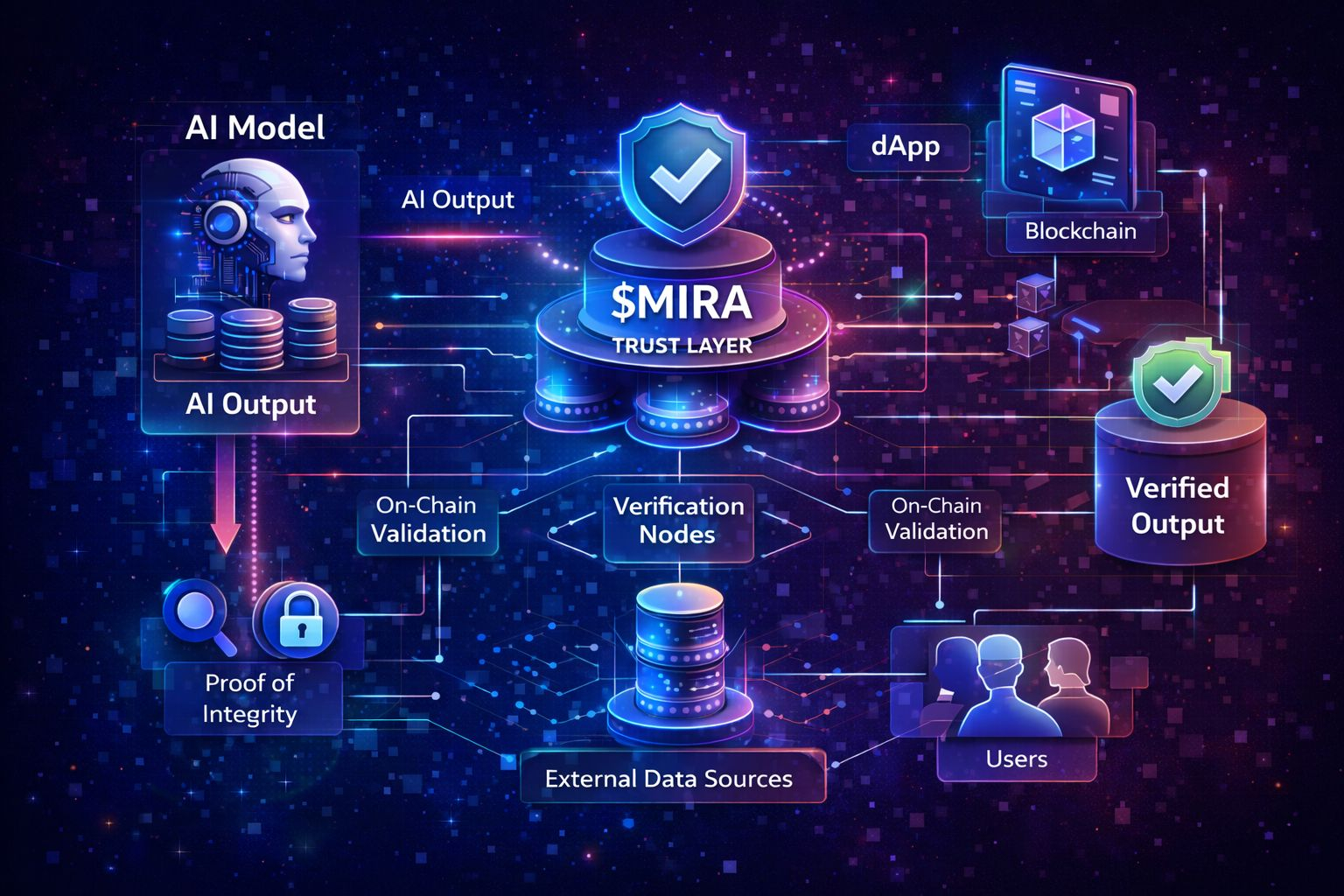

Das ist ein Grund, warum Projekte, die die Verifizierungsinfrastruktur erkunden, an Aufmerksamkeit gewinnen. Während ich verschiedene Ansätze recherchierte, begann ich, tiefer in die Idee hinter @mira_network einzutauchen und wie $MIRA darauf abzielt, das Konzept einer Vertrauensschicht für KI zu erkunden.

Die Idee ist interessant, weil KI-Ausgaben oft schwer schnell zu verifizieren sind. Ein KI-Modell kann in Sekundenschnelle eine Antwort erzeugen, aber die Verifizierung dieser Antwort kann Zeit, Fachwissen und Zugang zu zuverlässigen Datenquellen erfordern. Dieses Ungleichgewicht zwischen Generierung und Verifizierung schafft potenzielle Herausforderungen, da die KI-Adoption zunimmt.

Wenn dezentrale Anwendungen beginnen, auf KI-gesteuerte Erkenntnisse zu vertrauen, müssen Systeme existieren, um zu bestätigen, dass diese Erkenntnisse den Zuverlässigkeitsstandards entsprechen. Verifizierungsschichten könnten helfen, Transparenz und Vertrauen zu bieten, wenn KI-Systeme mit blockchain-basierten Anwendungen interagieren.

Ein weiterer Grund, warum dieses Thema wichtig ist, ist die wachsende Überschneidung zwischen KI und Web3. Blockchain-Netzwerke werden bereits für Finanzsysteme, digitales Eigentum, Governance-Mechanismen und verteilte Infrastruktur genutzt. Während KI-Tools sich mit diesen Umgebungen integrieren, wird die Sicherstellung zuverlässiger Ergebnisse zu einem kritischen Faktor.

Projekte wie @mira_network erkunden, wie dezentrale Infrastruktur möglicherweise KI-Verifizierungsprozesse unterstützen könnte. Das Konzept hinter $MIRA konzentriert sich darauf, Rahmenbedingungen zu schaffen, die es ermöglichen, KI-Ergebnisse zu validieren, anstatt sie blind zu akzeptieren.

Dieser Ansatz könnte potenziell helfen, die Zuverlässigkeit von KI-gestützten Anwendungen in Web3-Ökosystemen zu stärken. Ob in der Datenanalyse, dezentraler Governance oder automatisierten Prozessen, Verifizierungsmechanismen könnten zusätzliches Vertrauen für Benutzer bieten, die mit KI-Systemen interagieren.

Während der #Mira-Kampagne war es ziemlich interessant zu beobachten, wie die Community auf diese Ideen reagiert. Kampagnenzeiträume bringen oft neue Teilnehmer mit sich, die beginnen, die Vision des Projekts zu erkunden und die breiteren Implikationen der KI-Verifizierung zu diskutieren.

In vielerlei Hinsicht könnte die nächste Phase der KI-Entwicklung nicht nur auf Intelligenz, sondern auch auf Glaubwürdigkeit ausgerichtet sein. Systeme, die in der Lage sind, leistungsstarke Erkenntnisse zu generieren, müssen auch Möglichkeiten bieten, diese Erkenntnisse zu validieren.

Deshalb werden Gespräche über Vertrauensschichten, Verifizierungsrahmen und dezentrale KI-Infrastruktur zunehmend wichtig.

Zu beobachten, wie sich diese Ideen um @mira_network und $MIRA entwickeln, bietet einen interessanten Einblick, wie die Web3-Community über die zukünftige Beziehung zwischen KI und Vertrauen nachdenkt.