Als jemand, der viel Zeit damit verbringt, sich mit KI-Tools und -Infrastruktur zu beschäftigen, taucht ein Problem immer wieder auf - KI-Modelle sind leistungsstark, aber sie sind nicht immer zuverlässig. Jeder, der mit großen Sprachmodellen gearbeitet hat, weiß, dass Halluzinationen und falsche Ausgaben dennoch auftreten können.

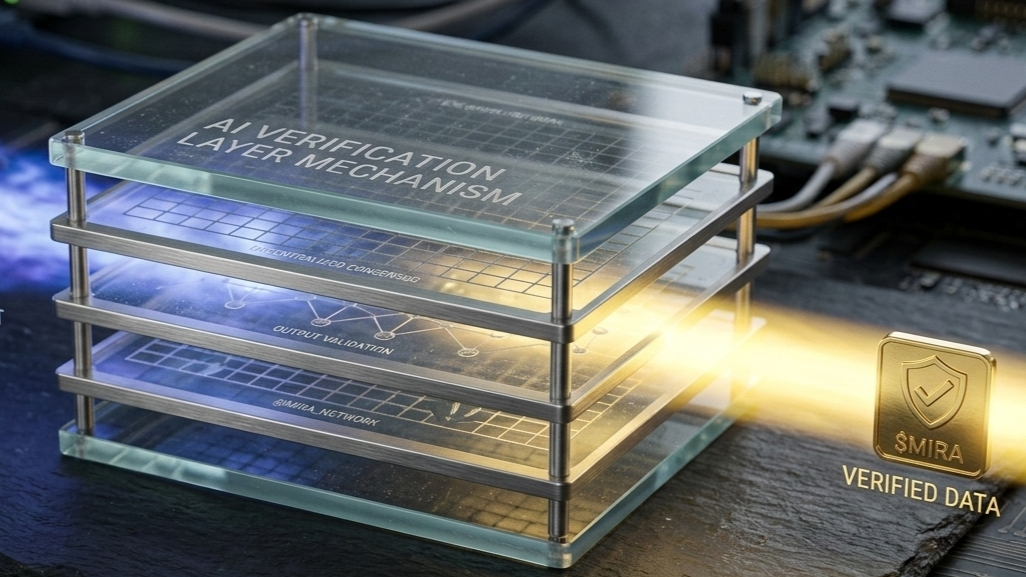

Deshalb hat mich der Ansatz, der von @Mira - Trust Layer of AI verfolgt wird, aufmerksam gemacht. Anstatt sich einfach auf schnellere Modelle oder größere Datensätze zu konzentrieren, arbeitet das Projekt an einer Verifizierungsschicht für KI-Ausgaben. Die Idee ist ziemlich einfach: Anstatt blind zu vertrauen, was ein KI-Modell produziert, kann das Netzwerk Antworten mithilfe dezentraler Verifikationsmechanismen validieren.

Aus der Sicht eines Entwicklers könnte dies äußerst nützlich sein. Da immer mehr Anwendungen beginnen, KI-Agenten, Automatisierungssysteme und On-Chain-Dienste zu nutzen, könnte die Möglichkeit, Ausgaben kryptografisch zu verifizieren, das Risiko reduzieren und das Vertrauen in automatisierte Prozesse verbessern.

Es öffnet auch die Tür für KI-Systeme, die direkt mit Blockchain-Umgebungen interagieren. Wenn Ausgaben von einem Netzwerk verifiziert werden können, können Entwickler zuverlässigere KI-gesteuerte Anwendungen erstellen, ohne von einem einzelnen vertrauenswürdigen Anbieter abhängig zu sein.

Deshalb behalte ich $MIRA genau im Auge. Wenn sich das Ökosystem rund um @Mira - Trust Layer of AI weiter entwickelt, könnte das Projekt ein wichtiger Bestandteil des aufkommenden KI+Krypto-Infrastruktur-Stacks werden.

Ich bin neugierig zu sehen, wie Entwickler in den nächsten Monaten damit experimentieren.