Der Tag, an dem ich etwas Kleines, aber seltsam Aufschlussreiches bemerkte. Ich stellte zwei KI-Tools die gleiche Frage zu einem technischen Thema. Beide produzierten Antworten. Beide klangen vernünftig.. Doch die Antworten waren in subtilen Wegen unterschiedlich. Nicht offensichtlich falsch. Nur leicht inkonsistent.

Dieser Moment blieb mir im Gedächtnis.

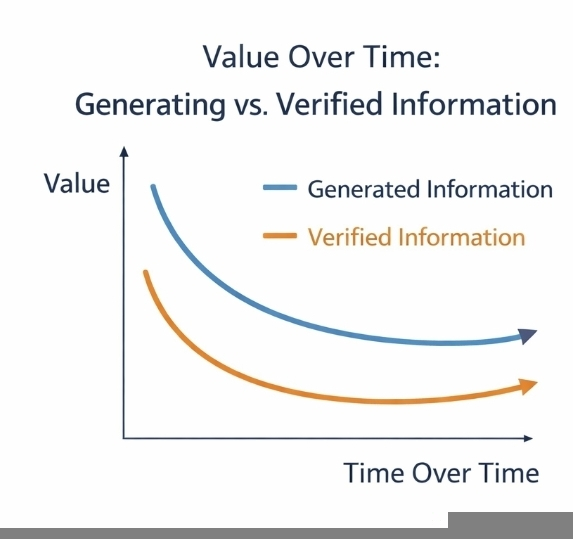

Es erinnerte mich daran, dass wir in eine Phase eintreten, in der das Generieren von Informationen sehr einfach wird. Fast trivial, tatsächlich. Große Modelle können Erklärungen, Zusammenfassungen, Code, Meinungen und alles innerhalb von Sekunden produzieren. Aber die Frage, die leise unter diesem Fortschritt schwingt, dreht sich nicht mehr um die Generierung. Es geht um Verifizierung.

Wie wissen wir, wann eine Antwort tatsächlich korrekt ist?

Hier beginnen Systeme wie Mira Network interessant zu werden, jedoch nicht aus dem Grund, den die Menschen zunächst annehmen.

Die meisten Diskussionen über KI-Infrastruktur konzentrieren sich weiterhin darauf, Modelle zu verbessern. Bessere Trainingsdaten. Größere Parameteranzahlen. Schnellere Inferenz. Effiziente Berechnung. Das macht Sinn. Generation war über Jahre hinweg das Zentrum der KI-Geschichte.

Es bildet sich ein weiteres Problem daneben. Ein Koordinationsproblem.

Wenn Tausende oder Millionen von KI-Systemen Ansprüche über die Welt, über Fakten, Vorhersagen, Erklärungen produzieren, muss es eine Möglichkeit geben, diese Ansprüche zu bewerten. Andernfalls wird die Informationsschicht laut. Nicht nutzlos, sondern instabil.

Ich denke ständig darüber nach, wie ähnlich dies etwas ist, was der Krypto-Raum bereits erlebt hat. Frühe Blockchains waren nicht darauf ausgelegt, Daten zu speichern. Sie dienten dazu, sich über die Gültigkeit dieser Daten zu einigen.

Konsens vor der Berechnung.

Mira scheint AI durch eine Linse zu betrachten. Nicht indem gefragt wird, wie Maschinen Antworten generieren können, sondern wie Netzwerke überprüfen können, welche Antworten bestehen, wenn sie herausgefordert werden.

Das klingt auf den ersten Blick einfach. In der Praxis wird es zu einem Koordinierungssystem.

Stellen Sie sich ein KI-Modell vor, das eine Aussage produziert: eine Behauptung über eine Statistik, ein Stück Code oder sogar eine medizinische Erklärung. Indem das System die Ausgabe als endgültig behandelt, betrachtet es sie als eine Behauptung, die von Teilnehmern in einem Verifizierungsnetzwerk bewertet werden kann.

Validatoren zu Teilnehmern, die Tokens einsetzen, um Glaubwürdigkeit zu signalisieren, können diese Ansprüche überprüfen oder herausfordern. Ihre Rolle besteht nicht darin, die Informationen zu produzieren, sondern zu bewerten, ob sie einer Prüfung standhalten.

Wenn eine Behauptung die Verifizierungsrunden übersteht, wird sie zur Ausgabe. Wenn sie scheitert, wird sie abgelehnt.

In gewisser Weise verlagert Mira das Schwerpunk von der Generation hin zur Bewertung.

Das verändert die Ökonomie.

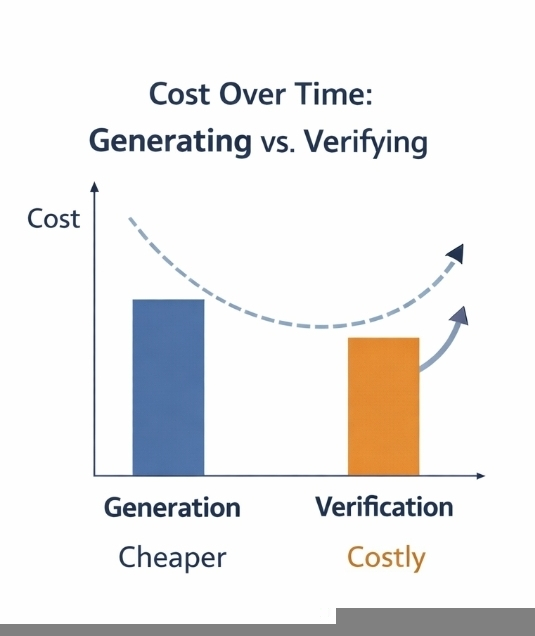

Der Teil, den die Menschen oft übersehen, ist, dass Generationen mit der Zeit tendenziell billiger werden. Wir sehen bereits dieses Muster. Modelle verbessern sich, Hardware beschleunigt sich, Open-Source-Architekturen verbreiten sich. Was einst Ressourcen erforderte, wird schließlich weit verbreitet zugänglich.

Die Verifizierung folgt jedoch nicht der Kurve.

Zu überprüfen, ob etwas korrekt ist, erfordert oft Aufmerksamkeit, Expertise und gegensätzliche Anreize. Es ist von Natur aus langsamer. Schwerer zu automatisieren.

Hier kommt ein tokenbasiertes Koordinierungssystem ins Spiel.

Teilnehmer im Netzwerk von Mira können Tokens einsetzen, um als Prüfer zu agieren. Staking bedeutet in diesem Sinne, Tokens als Sicherheiten zu sperren. Wenn ein Prüfer konsequent Ergebnisse unterstützt, verdient er Belohnungen. Wenn er Ansprüche unterstützt, riskiert er, einen Teil seines Einsatzes zu verlieren.

Die Idee ist nicht ganz neu. Krypto-Netzwerke verwenden bereits Strukturen, um Blockchains zu sichern. Validatoren setzen Tokens ein, um am Konsens teilzunehmen. Werden bestraft, wenn sie unehrlich handeln.

Diese Logik auf die Informationsverifizierung anzuwenden, verändert die Rolle des Netzwerks.

Das Netzwerk überprüft Wissensansprüche.

Hier wird es interessant.

Stellen Sie sich vor, eine KI-generierte Forschungszusammenfassung wird durch ein solches Netzwerk geleitet. Mehrere Validatoren überprüfen die Ansprüche. Einige stimmen zu. Andere stellen in Frage. Beweise werden präsentiert. Im Laufe der Zeit entsteht ein Konsens darüber, welche Teile der Informationen vertrauenswürdig sein können.

Die Ausgabe ist nicht mehr das Produkt eines Modells. Sie wird zum Ergebnis eines Verifizierungsmarktes.

Märkte haben eine seltsame Art, Signale über Glaubwürdigkeit zu erzeugen.

Dennoch frage ich mich weiterhin, ob dies das Problem löst.

Das ehrliche Argument gegen Systeme wie Mira ist, dass die Verifizierung selbst möglicherweise irgendwann automatisiert wird. Zukünftige KI-Modelle könnten gut genug im Selbst-Check sein, sodass menschliche oder netzwerkbasierte Verifizierung überflüssig wird.

Vielleicht.

Die Geschichte zeigt, dass die Verifizierung selten verschwindet. Sie bewegt sich einfach auf eine andere Ebene. Finanzmärkte benötigen immer noch Prüfer, auch wenn Buchhaltungssoftware existiert. Wissenschaftliche Arbeiten durchlaufen immer noch ein Peer-Review, auch wenn Datenanalysetools extrem fortgeschritten sind.

Vertrauenssysteme neigen dazu, bestehen zu bleiben.

Eine weitere Unsicherheit ist die Teilnahme. Ein Verifizierungsnetzwerk funktioniert nur, wenn genügend Akteure motiviert sind, Ansprüche zu überprüfen. Wenn die Anreize schlecht ausbalanciert sind, folgen die Teilnehmer möglicherweise einfach der Mehrheit oder jagen Belohnungen, ohne Prüfungen durchzuführen.

Die Gestaltung dieser Anreize ist schwieriger, als es klingt.

Selbst kleine Parameter sind Schwellenwerte für das Staking, die Verteilung von Belohnungen und Herausforderungszeiträume, die das Verhalten dramatisch beeinflussen können. Krypto-Netzwerke haben diese Lektion mehrfach gelernt.

Die Frage, die zu stellen ist, ist, ob die Struktur von Mira ein Gleichgewicht zwischen Offenheit und Zuverlässigkeit aufrechterhalten kann.

Wenige Validatoren und das System wird zentralisiert. Viele passive Teilnehmer und die Verifizierung wird oberflächlich.

Irgendwo zwischen diesen Extremen liegt das System, auf das sie anscheinend abzielen.

Wenn es funktioniert, gehen die Auswirkungen über die KI-Modelle selbst hinaus.

Es deutet auf eine Zukunft hin, in der Informationen nicht einfach generiert und konsumiert werden. Aktiv von dezentralen Systemen bewertet. Ansprüche werden zu Objekten, die durch Netzwerke wandern und an Glaubwürdigkeit gewinnen oder verlieren, während Teilnehmer sie überprüfen.

In diesem Sinne geht es bei Mira weniger um KI-Modelle und mehr um Informationsmärkte.

Ein Markt, in dem Wahrheit oder zumindest Glaubwürdigkeit entsteht, die aus Anreizen resultiert.

Ob dieses Modell skalierbar ist, ist noch eine Frage. Verifizierung kann langsam sein. Benutzer ziehen oft schnelle Antworten, über sorgfältig validierte vor. Das Internet hat uns bereits gezeigt, dass Bequemlichkeit dazu neigt, zu gewinnen.

Ich kehre immer wieder zu diesem kleinen Moment mit den beiden KI-Antworten zurück. Beide klangen überzeugend. Nur eine konnte korrekt sein.

Das Problem war nicht die Generation.

Es ging darum zu entscheiden, welche Ausgabe vertrauenswürdig war.

Dieses Problem könnte seltsamerweise eine der wertvollsten Schichten der KI-Wirtschaft werden.