@Mira - Trust Layer of AI Das erste, was mich an modernen KI-Systemen gestört hat, waren nicht ihre Fehler. Menschen machen ständig Fehler. Dieser Teil fühlte sich normal an. Was seltsamer erschien, war der Ton der Gewissheit, den diese Systeme oft tragen. Ein Modell kann eine Antwort produzieren, die strukturiert, sorgfältig und sogar autoritär klingt, während es heimlich echte Informationen mit etwas Erfundenem vermischt.

Die Maschine lügt nicht wirklich. Es ist mehr so, als würde sie.....Lücken füllen. Und das tut sie selbstbewusst.

Eine Zeit lang schien die Branche damit zufrieden zu sein, dies als vorübergehende Phase zu betrachten. Größere Modelle, bessere Trainingsschleifen, sauberere Datensätze. Die Erwartung war ziemlich intuitiv: verbesserte Intelligenz und Zuverlässigkeit sollten schließlich folgen. Diese Logik klingt vernünftig, wenn man sie schnell hört. Aber je mehr Zeit man damit verbringt, zuzusehen, wie sich diese Systeme in der Praxis verhalten, desto weniger offensichtlich erscheint die Verbindung.

Intelligenz erzeugt Sprache sehr gut. Verifizierung ist etwas ganz anderes.

Diese Lücke hat in kleinen Weisen im gesamten KI-Ökosystem begonnen, sich zu zeigen. Entwickler überprüfen Ausgaben doppelt. Forscher bauen Bewertungsebenen. Leise Versuche, Reibung in Systeme einzuführen, die ursprünglich darauf ausgelegt waren, Antworten so schnell wie möglich zu generieren.

Irgendwo in diesem wachsenden Gespräch sitzt Mira Network. Zunächst nahm ich an, es sei Teil des üblichen Musters, dass Krypto-Projekte sich an den KI-Narrativzyklus anhängen. Das passiert in jeder Marktphase. Neue Technologie erscheint, und Infrastruktur-Tokens beginnen, darum zu kreisen.

Aber Mira ist in der Betonung etwas anders. Der interessante Teil ist nicht die KI selbst. Es ist das, was passiert, nachdem die KI spricht.

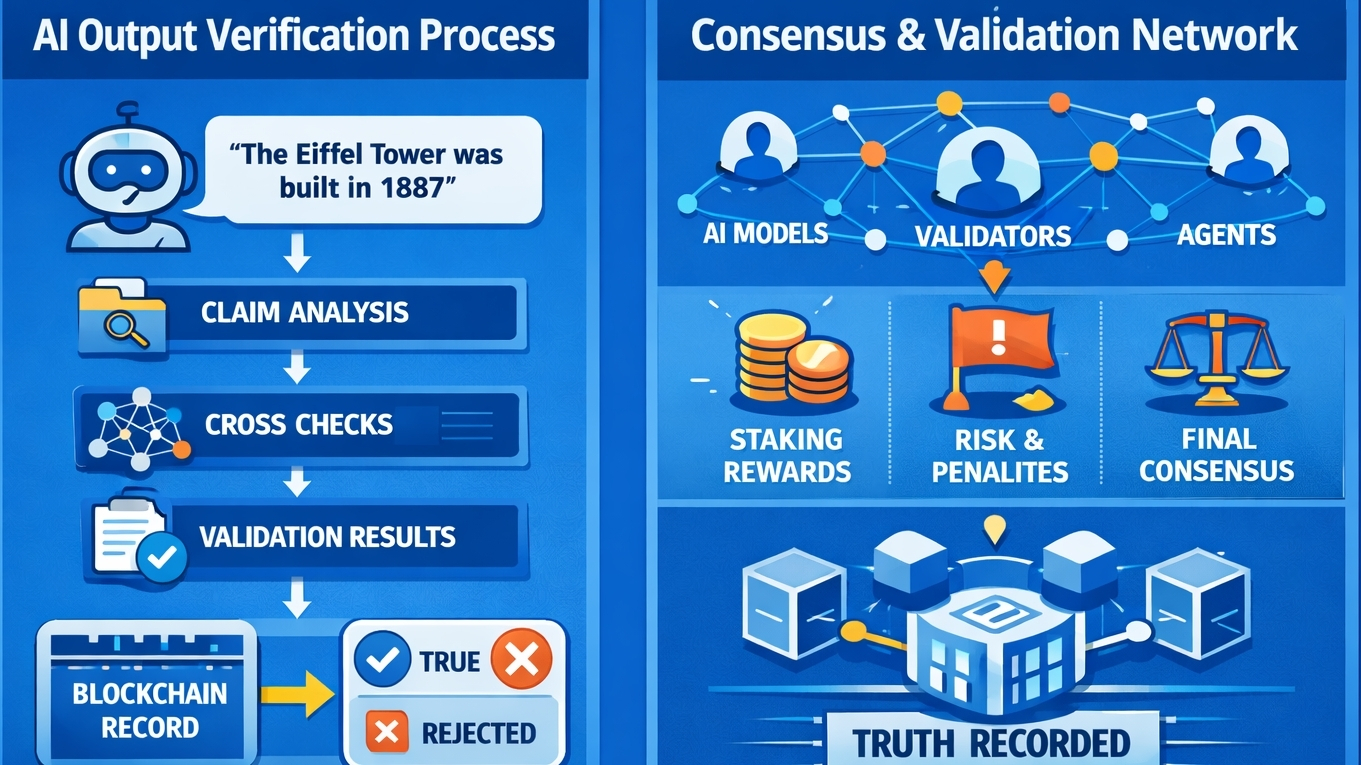

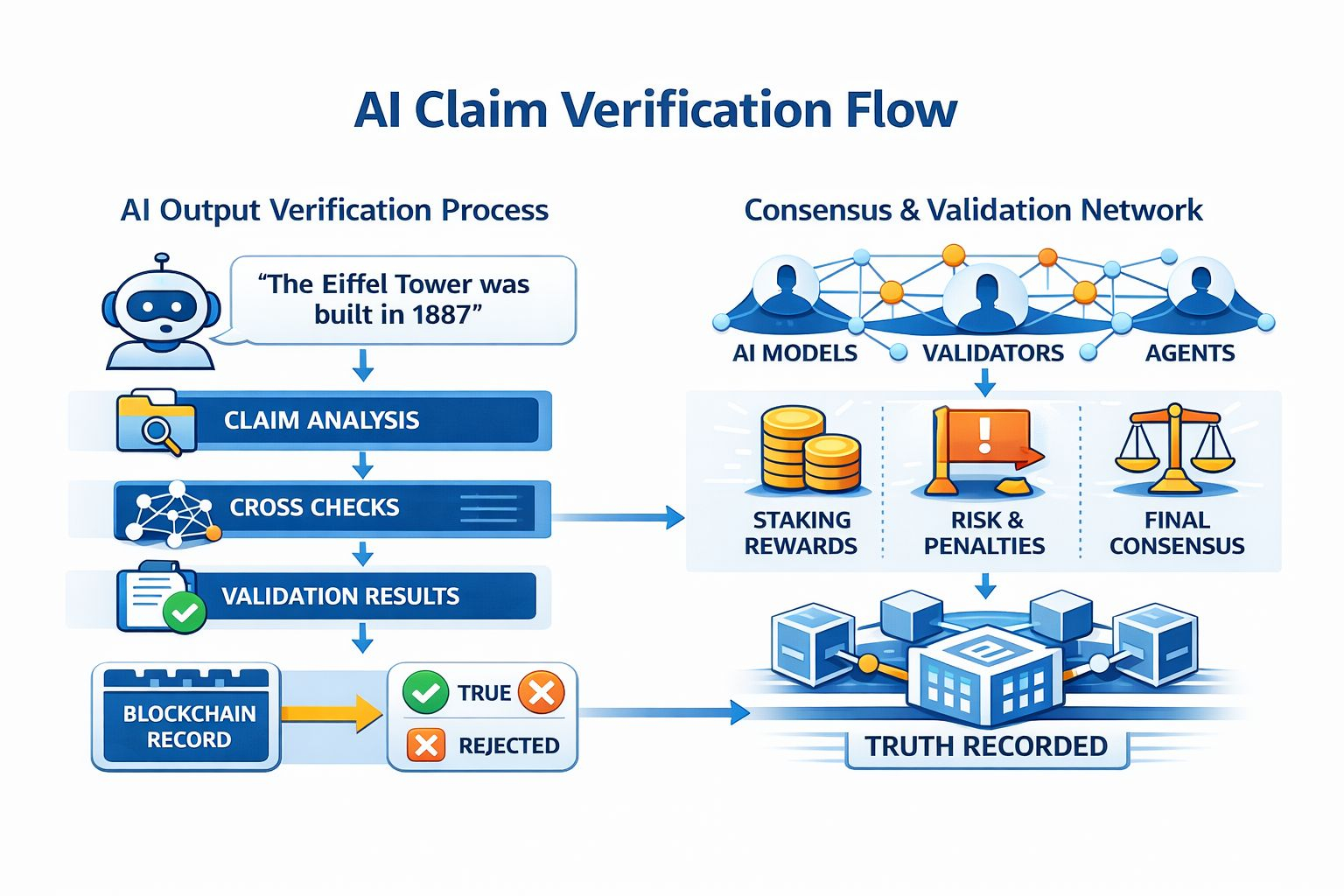

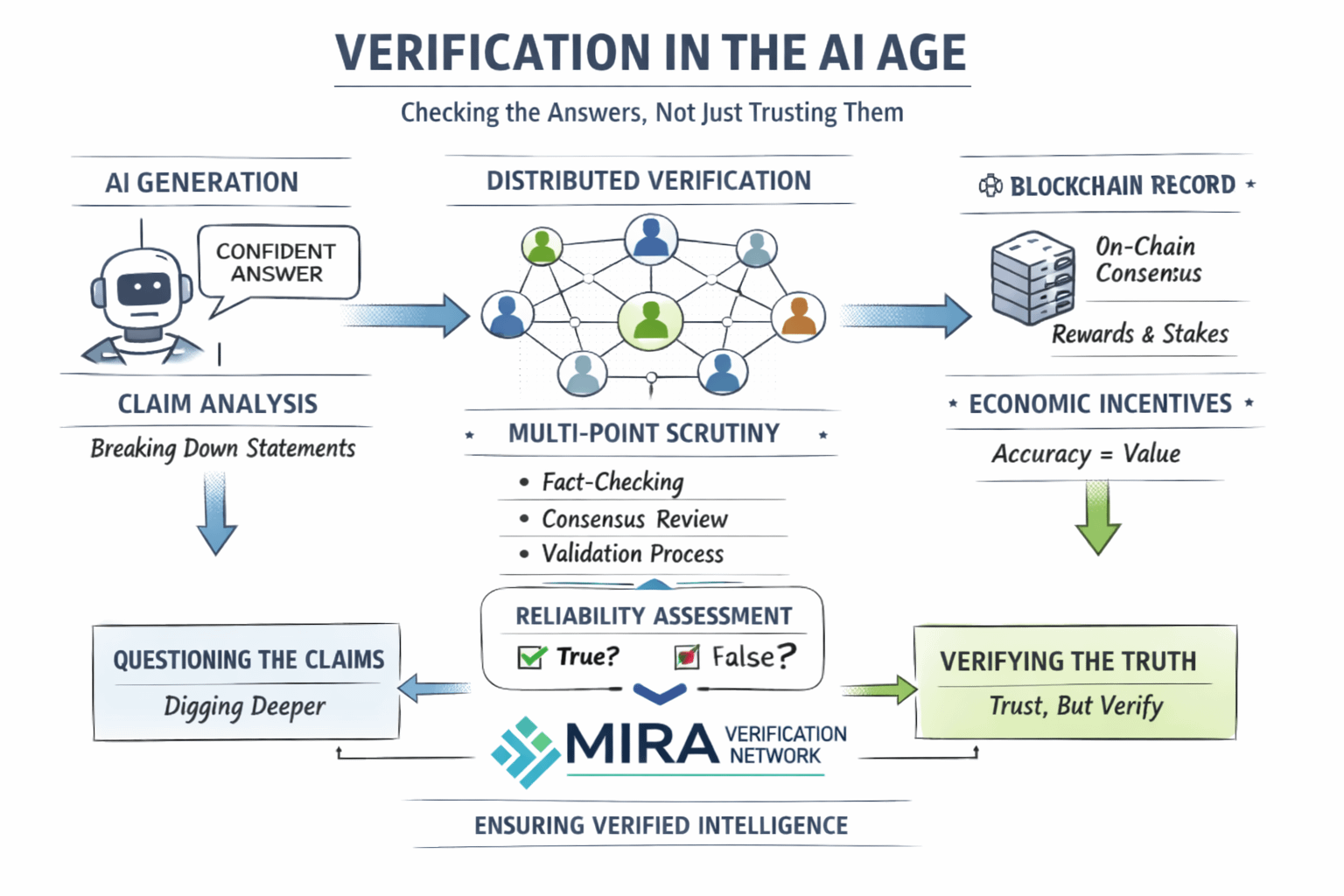

Wenn man sich das Design genau ansieht, bleibt die Ausgabe eines Modells nicht intakt. Sie wird auseinandergezogen. Einzelne Aussagen werden zum Fokus. Fast so, als würde jemand ein Gespräch mitten im Satz pausieren und eine Aussage isolieren: Dieser Teil – sind wir uns darüber wirklich sicher?

Diese Behauptungen bewegen sich durch ein verteiltes Netzwerk, in dem andere Modelle, Validatoren oder Agenten sie erneut prüfen. Nicht unbedingt das ursprüngliche Denken wiederholend. Nur überprüfen, ob die Aussage einer Prüfung aus mehreren Richtungen standhält. Während die Idee sich entfaltet, fühlt es sich weniger an wie die Interaktion mit einem Chatbot und mehr wie die Beobachtung eines ruhigen Prüfprozesses, der hinter den Kulissen stattfindet.

Letztendlich landen einige dieser Verifizierungsergebnisse auf einem Blockchain-Ledger. Konsens bildet sich darüber, ob eine Behauptung Bestand hat. Teilnehmer setzen Tokens ein, verdienen Belohnungen für Validierungsarbeiten und riskieren Strafen für nachlässige oder unehrliche Teilnahme. Genauigkeit wird zu etwas, das wirtschaftliches Gewicht hat.

Dennoch lässt das Design einige unangenehme Fragen im Hintergrund stehen.

Konsens hat sich gut für Buchhaltungssysteme bewährt. Blockchains sind hervorragend darin, sich über Salden, Eigentum und Transaktionsreihenfolgen einig zu werden. Aber die Wahrheit verhält sich anders. Wenn mehrere Modelle eine Aussage bestätigen, zeichnet das Netzwerk die Übereinstimmung auf, aber Übereinstimmung und Richtigkeit sind nicht immer dasselbe.

Und Anreize führen zu ihrer eigenen Instabilität. Märkte motivieren die Teilnahme, ja. Sie verändern sich auch schnell. Wenn die Belohnungen für Validatoren schrumpfen oder die Aufmerksamkeit woanders hingeht, könnte die Verifizierungsebene dünner werden. Es ist schwer zu wissen, wie langlebig diese Koordinationssysteme bleiben, wenn die anfängliche Begeisterung nachlässt.

Es gibt eine weitere praktische Komplikation. Verifizierung führt zu Reibung. Entwickler, die KI-Anwendungen bauen, priorisieren oft Geschwindigkeit, Reaktionsfähigkeit und minimale Latenz. Die Ausgaben durch eine dezentrale Verifizierungsebene zu leiten, bedeutet zusätzliche Schritte, zusätzliche Berechnungen, zusätzliche Koordination. Die Infrastruktur mag in der Theorie elegant sein und sich dennoch in der Praxis schwer anfühlen.

Deshalb erzeugen Systeme wie Mira eine interessante Spannung anstelle einer klaren Lösung.

Die KI hat heute das Problem, Antworten zu produzieren, weitgehend gelöst. Maschinen können Erklärungen schneller generieren, als die meisten Menschen sie hinterfragen können. Aber in dem Moment, in dem diese Antworten beginnen, finanzielle Entscheidungen, automatisierte Systeme oder Governance-Tools zu beeinflussen, wird das Fehlen von Verifizierung schwerer zu ignorieren.

Vielleicht wird die Zuverlässigkeit in der KI schließlich allein durch bessere Modelle kommen. Diese Möglichkeit besteht weiterhin. Aber die Beobachtung, dass sich diese Verifizierungsarchitekturen entwickeln, deutet auf eine andere Richtung hin. Intelligenz muss nicht perfekt zuverlässig werden, wenn Netzwerke sich um deren Überprüfung koordinieren können.

Ob diese Koordination über die Zeit Bestand hat, ist eine ganz andere Frage.

Im Moment ist es einfach eine Idee, die immer wieder auftaucht, wenn man das System genau beobachtet. KI spricht leicht. Zu beweisen, was sie sagt, erweist sich als ein viel langsamerer Prozess. Und es ist noch nicht offensichtlich, welcher Teil dieser Gleichung die nächste Phase der Maschinen-Systeme definieren wird.