Die Unterhaltung, die Mira für mich zum Klicken brachte

Früher in dieser Woche scrollte ich durch die Kampagnenbeiträge von CreatorPad auf Binance Square, während ich mit einem anderen Trader in den Kommentaren plauderte. Wir verglichen verschiedene KI-Projekte im Krypto-Bereich und machten hauptsächlich Witze darüber, wie jedes zweite Protokoll behauptet, „KI-Infrastruktur“ zu sein.

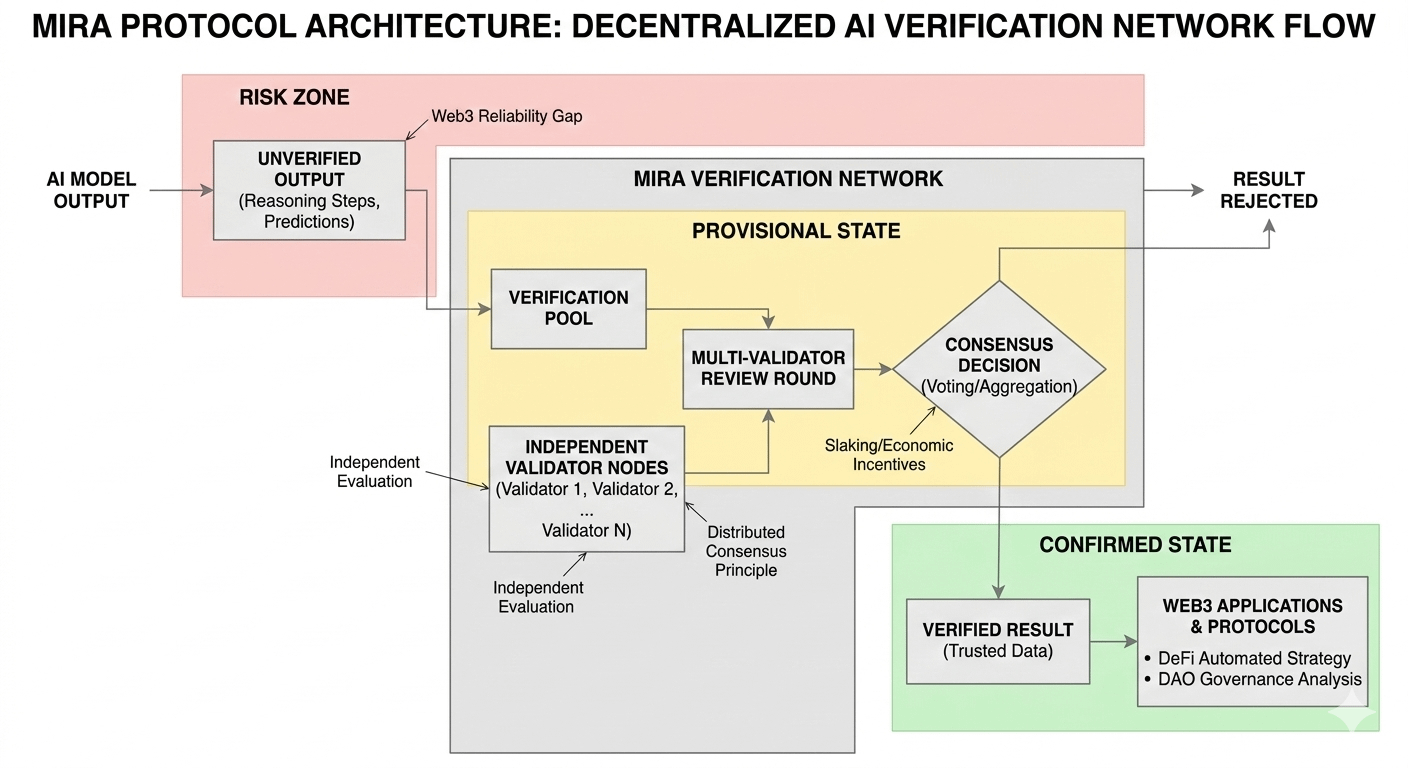

Irgendwann hat jemand ein Diagramm fallen lassen, das Miras Verifikationsnetzwerk erklärt.

Auf den ersten Blick sah es einfach aus. Aber nach ein paar Minuten des Starrens wurde mir etwas Interessantes klar: Mira versucht nicht wirklich, ein intelligenteres KI-Modell zu bauen. Es versucht, ein Netzwerk aufzubauen, das KI-Ausgaben verifiziert.

Diese Unterscheidung ist subtil, aber sie verändert vollständig, wie das Projekt in das Web3-Ökosystem passt.

Das Problem, das auftritt, wenn KI auf Web3 trifft

Jeder, der KI-Tools regelmäßig verwendet hat, kennt die seltsame Erfahrung, eine Antwort zu erhalten, die extrem zuversichtlich aussieht… aber nicht ganz korrekt ist.

In zentralisierten Plattformen erledigen Unternehmen dies intern. Sie überwachen Ergebnisse und verbessern Modelle im Hintergrund.

Dezentralisierte Systeme können sich nicht auf eine einzige Autorität verlassen, um das zu tun.

Wenn KI-Agenten beginnen, mit Web3-Protokollen zu interagieren – Märkte zu analysieren, Governance-Vorschläge zusammenzufassen oder automatisierte Strategien auszuführen – könnten falsche Ausgaben echte finanzielle oder Governance-Entscheidungen beeinflussen.

Die Frage wird also offensichtlich:

Die Frage wird also offensichtlich:

Wer überprüft die maschinell erzeugten Informationen, bevor das Netzwerk ihnen vertraut?

Das ist die Infrastruktur-Lücke, die Mira zu adressieren scheint.

Überprüfung in ein Netzwerk verwandeln

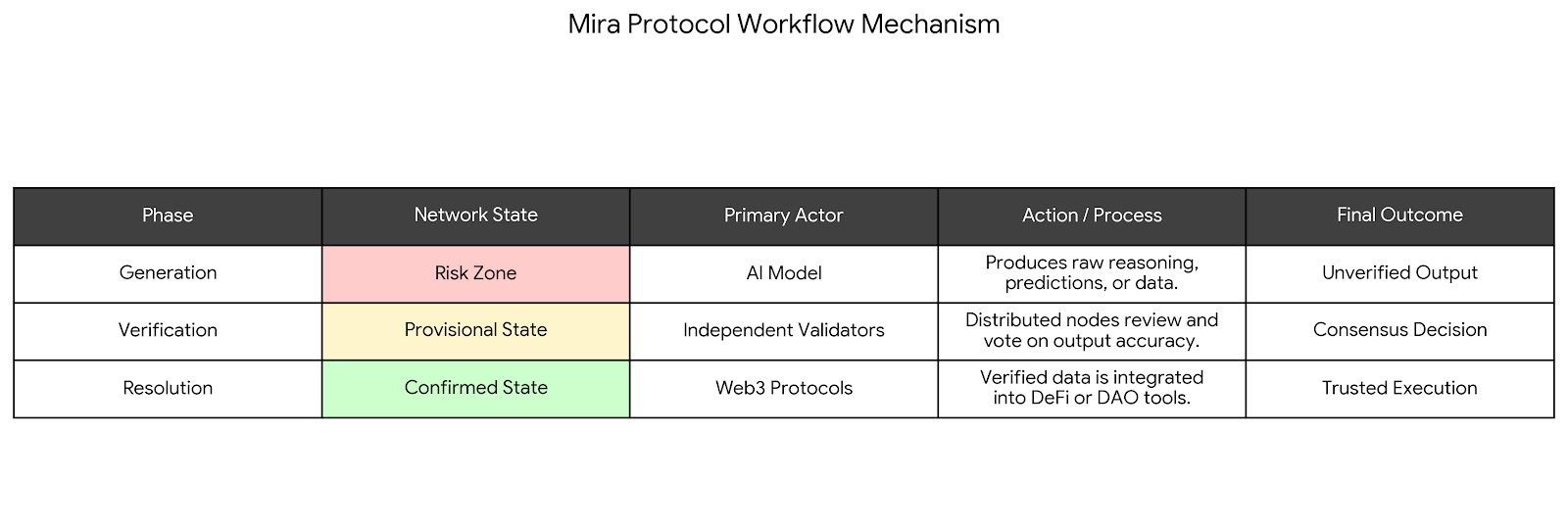

Aus Dokumentationssnippets und CreatorPad-Diskussionen habe ich entnommen, dass Miras Architektur darauf abzielt, den KI-Arbeitsablauf in zwei separate Rollen zu unterteilen.

Die erste Rolle ist die Generierung. KI-Modelle produzieren Ausgaben wie Argumentationsschritte, Vorhersagen oder strukturierte Antworten.

Die zweite Rolle ist die Überprüfung. Unabhängige Teilnehmer bewerten diese Ausgaben, bevor sie als gültige Ergebnisse akzeptiert werden.

Anstatt dem Modell direkt zu vertrauen, leitet das System Ausgaben über einen verteilten Überprüfungsprozess.

Als ich versuchte, das Design zu visualisieren, skizzierte ich einen groben Prozessablauf in meinen Notizen:

KI-Ausgabe → Überprüfungs-Pool → Multi-Validator-Überprüfung → Konsensentscheidung → Verifiziertes Ergebnis

Die Struktur ähnelt tatsächlich der Validierung von Blockchain-Transaktionen, mit dem Unterschied, dass das Netzwerk Informationen anstelle von finanziellen Überweisungen validiert.

Diese Designwahl lässt Mira weniger wie eine KI-Anwendung und mehr wie eine Zuverlässigkeitsinfrastrukturschicht erscheinen.

Warum die Dezentralisierung der Überprüfung wichtig ist

Ein Detail, das mir beim Lesen der Community-Threads auffiel, ist die Betonung mehrerer unabhängiger Validatoren.

Wenn ein einzelner Teilnehmer ein KI-Ergebnis überprüft, könnte diese Bewertung voreingenommen oder fehlerhaft sein. Aber wenn mehrere Teilnehmer dasselbe Ergebnis überprüfen, verringert sich die Wahrscheinlichkeit einer falschen Akzeptanz.

Das ist im Wesentlichen die Anwendung desselben Prinzips, das Blockchains sichert: verteilte Konsens.

Der Unterschied besteht darin, dass das Netzwerk anstelle von Transaktionsblöcken die von Maschinen erzeugte Argumentation überprüft.

Wenn das Modelloutput die Überprüfungsrunden besteht, wird es zu vertrauenswürdigen Daten, auf die Anwendungen sich verlassen können.

Wenn es fehlschlägt, wird die Ausgabe abgelehnt.

Ein praktisches Beispiel: KI-Agenten in DeFi

Während ich CreatorPad-Posts über Mira las, dachte ich ständig an automatisierte Handelsagenten.

Stellen Sie sich ein KI-Modell vor, das Liquiditätspools analysiert und Portfolioanpassungen vorschlägt. Ohne Überprüfung könnte dieses Ergebnis direkt Handelsgeschäfte auslösen.

Wenn die Argumentation fehlerhaft ist, könnte die Strategie zu schlechten Entscheidungen führen.

Mit Miras Struktur könnte die KI-Ausgabe zunächst in eine Überprüfungsrunde eintreten, in der unabhängige Teilnehmer die Argumentation überprüfen, bevor sie die Anwendung beeinflusst.

Es ist ein kleiner zusätzlicher Schritt, aber er führt Verantwortung in automatisierte Entscheidungssysteme ein.

Und während mehr DeFi-Tools mit KI-Agenten experimentieren, könnte diese Zuverlässigkeitsschicht zunehmend wichtig werden.

Die Wirtschaft hinter dem Netzwerk

Ein weiterer interessanter Aspekt von Miras Design ist das Anreizmodell.

Überprüfer überprüfen nicht einfach aus Neugier die Ausgaben. Sie werden wirtschaftlich belohnt, wenn sie die Ergebnisse genau bewerten.

Das verwandelt die Überprüfung in eine produktive Aktivität innerhalb des Ökosystems.

KI-Entwickler erzeugen Ausgaben.

Überprüfer validieren diese Ausgaben.

Anwendungen konsumieren die verifizierten Ergebnisse.

Diese dreieckige Beziehung schafft das, was einige CreatorPad-Teilnehmer als eine Verifizierungswirtschaft zu bezeichnen begonnen haben, in der Vertrauen selbst zu einem dezentralen Dienst wird.

Die Herausforderungen, mit denen das System noch konfrontiert ist

Die Herausforderungen, mit denen das System noch konfrontiert ist

Obwohl das Konzept überzeugend ist, gibt es mehrere Fragen, die das Netzwerk lösen muss.

Zuerst ist die Evaluierungskomplexität. Einige KI-Ausgaben sind leicht zu überprüfen, insbesondere faktische Ansprüche. Andere beinhalten Argumentation oder Interpretation, was die Validierung erschwert.

Zweitens ist die Geschwindigkeit. Überprüfungsrunden führen zu Latenz, während viele KI-Anwendungen schnelle Antworten erwarten.

Drittens ist die Koordination. Das System muss sicherstellen, dass Überprüfer unabhängige Bewertungen durchführen, anstatt einfach Konsenssignale zu kopieren.

Diese Herausforderungen mindern nicht das Konzept, aber sie heben die Schwierigkeit hervor, dezentrale Vertrauensschichten für KI aufzubauen.

Warum die Idee immer wieder in CreatorPad-Diskussionen auftaucht

Nachdem ich Zeit damit verbracht habe, die Threads der CreatorPad-Kampagne zu lesen, fiel mir auf, dass die Diskussionen über Mira tendenziell weniger auf Token-Spekulation und mehr auf Architektur fokussiert sind.

Das ist normalerweise ein Signal dafür, dass ein Projekt ein tiefergehendes Infrastrukturproblem angeht.

Blockchains schaffen dezentralen Konsens für finanzielle Transaktionen. Aber KI-Systeme produzieren etwas anderes – Informationen und Argumentation.

Wenn dezentrale Anwendungen beginnen, sich auf maschinell erzeugte Analysen zu verlassen, werden Netzwerke Mechanismen benötigen, um zu bestätigen, dass diese Ausgaben vertrauenswürdig sind.

Miras Experiment dreht sich im Wesentlichen darum, ob die KI-Überprüfung selbst zu einem dezentralen Netzwerk werden kann.

Es ist noch früh, und es gibt viele Designherausforderungen. Aber die Frage, die das Protokoll erforscht, fühlt sich überraschend grundlegend für die zukünftige Schnittstelle zwischen KI und Web3 an.

Wenn Maschinen die Antworten generieren, wird jemand – oder besser gesagt, ein Netzwerk – sie überprüfen müssen.

$HANA $DEGO #Mira

@Mira - Trust Layer of AI $MIRA