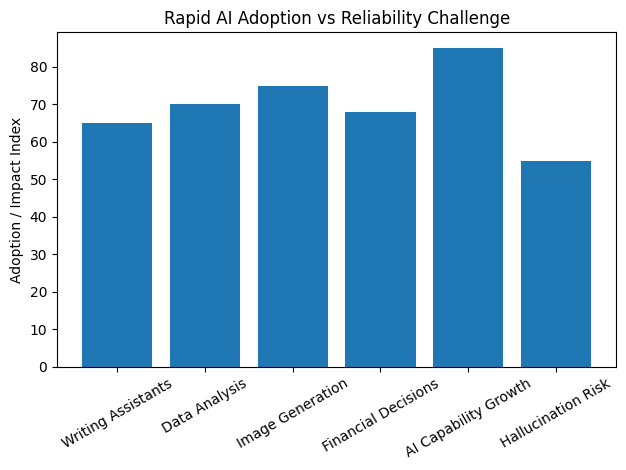

Ich denke oft darüber nach, wie schnell sich die Technologie um uns herum verändert. Künstliche Intelligenz, die einst wie etwas Fernes und Experimentelles erschien, ist schnell Teil unserer täglichen Routinen geworden. Wir sehen sie in Schreibassistenten, Datenanalysetools, Bildgenerierungsplattformen und sogar in finanziellen Entscheidungssystemen. Was einst Teams von Experten erforderte, kann jetzt von einem KI-Modell innerhalb von Sekunden erledigt werden.

Dieser schnelle Fortschritt ist aufregend, wirft aber auch eine wichtige Frage auf. Da wir zunehmend auf KI angewiesen sind, wie wissen wir, dass die Informationen, die sie liefert, tatsächlich korrekt sind?

Viele KI-Systeme heute arbeiten, indem sie große Datensätze analysieren und die wahrscheinlichste Antwort auf eine Frage vorhersagen. Diese Systeme sind unglaublich leistungsstark, aber sie sind nicht perfekt. Manchmal erzeugen sie Antworten, die selbstbewusst und logisch klingen, aber Fehler oder völlig erfundene Informationen enthalten. Dieses Problem, oft als KI-Halluzination bezeichnet, hebt eine der größten Schwächen der modernen künstlichen Intelligenz hervor.

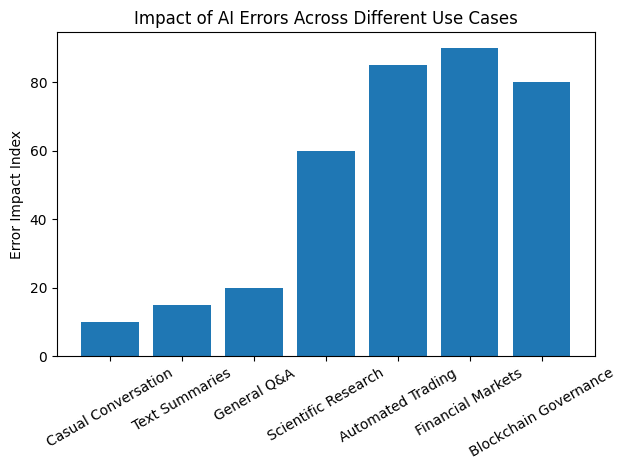

Bei einfachen Aufgaben oder beiläufigen Gesprächen könnten diese Fehler keine großen Probleme verursachen. Wenn eine KI einen kleinen Fehler beim Zusammenfassen eines Textes oder beim Beantworten einer allgemeinen Frage macht, sind die Konsequenzen normalerweise minimal. Die Situation wird jedoch viel ernster, wenn KI beginnt, wichtige Entscheidungen zu beeinflussen.

Stellen Sie sich vor, dass KI in den Finanzmärkten eingesetzt wird, um Trends zu analysieren und Investitionen zu leiten. Denken Sie an automatisierte Handelssysteme, die auf KI-Vorhersagen basieren, um Transaktionen auszuführen. Denken Sie an wissenschaftliche Forschung, bei der KI-Modelle helfen, Daten zu interpretieren, oder an Blockchain-Governance-Systeme, bei denen automatisierte Agenten helfen, digitale Ökonomien zu verwalten. In diesen Situationen kann selbst ein kleiner Fehler große Konsequenzen haben.

Eine falsche Annahme in einem Handelsalgorithmus könnte große finanzielle Verluste auslösen. Eine falsche Interpretation von Forschungsdaten könnte den wissenschaftlichen Fortschritt verlangsamen. In dezentralen Netzwerken könnte unzuverlässige Information das Vertrauen schädigen und ganze Ökosysteme stören. Während künstliche Intelligenz in diese hochwirksamen Umgebungen vordringt, wird Zuverlässigkeit wichtiger denn je.

Hier bringt Mira Network eine überzeugende Idee ein.

Statt sich nur darauf zu konzentrieren, größere und leistungsstärkere KI-Modelle zu bauen, konzentriert sich Mira Network darauf, sicherzustellen, dass KI-Ausgaben überprüfbar sind. Das Projekt nähert sich der künstlichen Intelligenz aus einer anderen Perspektive. Anstatt zu fragen, wie schnell oder komplex KI werden kann, fragt Mira, wie vertrauenswürdig ihre Informationen sein können.

Das Konzept hinter Mira Network ist auf Verifizierung ausgerichtet. Wenn ein KI-System Informationen generiert, akzeptiert Mira die Ausgabe nicht einfach als ein Stück Wahrheit. Stattdessen zerlegt das System diese Informationen in kleinere Ansprüche. Jeder Anspruch kann dann unabhängig überprüft und validiert werden.

Diese Ansprüche werden über ein Netzwerk unabhängiger Validierer verteilt. Jeder Teilnehmer überprüft die Informationen und bewertet deren Genauigkeit. Da mehrere Validierer an dem Prozess teilnehmen, wird das Endergebnis durch dezentralen Konsens bestimmt, anstatt sich auf eine einzige Autorität zu verlassen.

Dieser Ansatz reduziert das Risiko von Voreingenommenheit oder Fehlern, die von einem Modell oder einer Organisation ausgehen. Er schafft auch ein System, in dem Informationen kontinuierlich vom Netzwerk selbst überprüft und verifiziert werden.

Die Blockchain-Technologie spielt eine wichtige Rolle bei der Unterstützung dieses Prozesses. Überprüfungsergebnisse können in transparenten und auditierbaren Protokollen aufgezeichnet werden, die es Entwicklern und Nutzern ermöglichen, nachzuvollziehen, wie Informationen validiert wurden. Diese Transparenz hilft, Vertrauen in Systeme aufzubauen, die auf zuverlässigen Daten basieren.

Ein weiteres Schlüsselelement ist der Anreizmechanismus. Teilnehmer, die genaue Verifizierungen beitragen, werden belohnt, während unehrliche oder nachlässige Handlungen zu Strafen führen können. Dieses System fördert ehrliche Teilnahme und stärkt die Integrität des Netzwerks.

Da künstliche Intelligenz weiterhin in Finanzen, Forschung und dezentrale Technologie vordringt, wird die Bedeutung zuverlässiger Informationen nur zunehmen. Systeme, die auf KI angewiesen sind, benötigen Mechanismen, die bestätigen, ob die Daten, die sie verwenden, genau und vertrauenswürdig sind.

Mira Network stellt einen Schritt in diese Zukunft dar. Durch den Fokus auf Verifizierung und dezentrale Validierung zielt das Projekt darauf ab, eine Umgebung zu schaffen, in der KI-generierte Informationen nicht nur leistungsstark, sondern auch zuverlässig sind.

Langfristig wird der Erfolg der künstlichen Intelligenz nicht nur davon abhängen, wie intelligent diese Systeme werden. Er wird davon abhängen, wie sehr wir ihnen vertrauen können. Verifizierte Intelligenz könnte das Fundament werden, das es KI ermöglicht, die nächste Generation digitaler Systeme sicher zu betreiben.