In den letzten Wochen habe ich mehr Zeit damit verbracht, Projekte zu betrachten, die an der Schnittstelle von KI und Krypto stehen. Es gibt jetzt viele davon. Fast jede Woche erscheint ein weiteres Projekt, das behauptet, Agenten, Automatisierung oder eine neue Form von intelligenter Infrastruktur zu betreiben.

Auf den ersten Blick klingen viele von ihnen beeindruckend. Schnellere Modelle, autonome Agenten, KI-gestützte Entscheidungssysteme. Die Sprache ist immer ehrgeizig. Aber je länger ich diesen Sektor beobachte, desto mehr habe ich das Gefühl, dass die meisten Diskussionen auf dasselbe abzielen: Antworten zu generieren.

Und seltsamerweise konzentrieren sich sehr wenige Gespräche darauf, sie zu verifizieren.

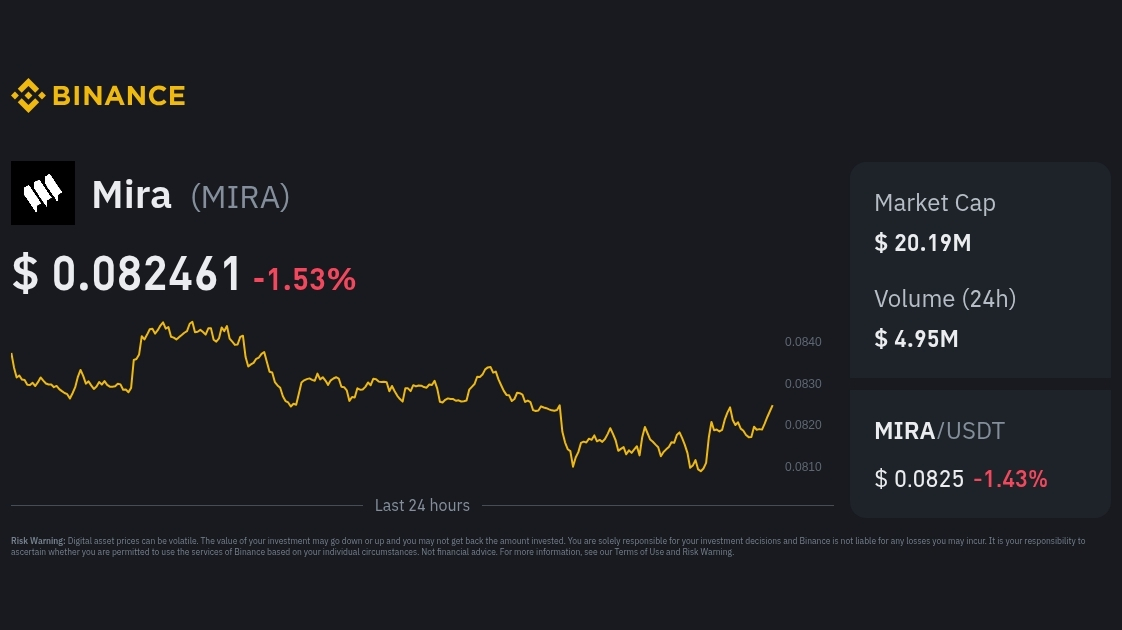

Diese Lücke ist es, was mich zögern ließ und MIRA näher betrachtete.

Was meine Aufmerksamkeit erregte, war nicht einfach die Idee, KI mit Blockchain-Systemen zu verbinden. Viele Projekte versuchen das bereits. Was hier anders war, ist die Richtung, in die MIRA scheint, um Verifizierung herum zu gehen. Anstatt sich ausschließlich darauf zu konzentrieren, Ausgaben zu produzieren, scheint das Projekt eine Schicht zu bauen, die überprüfen kann, ob diese Ausgaben tatsächlich zuverlässig sind.

Und ich denke, dass dieses Problem wichtiger wird, als viele Menschen realisieren.

Jeder, der moderne KI-Tools regelmäßig verwendet hat, kennt bereits das seltsame Gefühl, das sie erzeugen können. Die Antworten klingen oft überzeugend. Die Formulierungen sind flüssig. Die Argumentation erscheint strukturiert. Doch manchmal ist das Ergebnis immer noch falsch.

Das Modell liefert Vertrauen, aber Vertrauen ist nicht dasselbe wie Wahrheit.

Diese Unterscheidung wird viel ernster, sobald KI-Systeme mit realen Systemen interagieren. Wenn KI an Automatisierung, finanzieller Koordination, dezentralen Diensten oder infrastruktureller Entscheidungsfindung teilnehmen soll, dann reicht es nicht aus, einfach Antworten zu generieren. Es muss irgendeine Möglichkeit geben, diese Antworten zu verifizieren.

Das ist der Teil der Diskussion, wo MIRA sich zu positionieren scheint.

Der Klok-Verifizierungsrollout ist für mich interessant, weil es sich anfühlt wie der Moment, in dem das Projekt von der Theorie in die Demonstration übergeht. Es ist eine Sache, über Verifizierung in einem Whitepaper zu sprechen. Es ist etwas ganz anderes, ein System zu zeigen, das es tatsächlich unter realen Bedingungen durchführt.

Dieser Wandel verändert, wie die Leute das Projekt bewerten.

Bevor Live-Systeme existieren, bleibt die Diskussion weitgehend konzeptionell. Die Leute fragen, ob die Idee interessant klingt. Sie debattieren, ob die Architektur Sinn macht. Aber sobald Verifizierungsmetriken öffentlich erscheinen, wird die Diskussion viel praktischer.

An diesem Punkt ändert sich die Frage.

Anstatt zu fragen, ob das Konzept vielversprechend klingt, beginnen die Menschen zu fragen, ob das System tatsächlich funktioniert.

Für Entwickler ist diese Frage alles.

Bauer kümmern sich normalerweise viel weniger um Erzählungen, als der Markt annimmt. Was sie beobachten, sind Signale. Sie wollen wissen, ob die Infrastruktur zuverlässig läuft. Sie wollen sehen, ob die Leistung messbar ist. Sie wollen verstehen, ob das System stabil genug ist, um darauf aufzubauen.

Deshalb könnten Verifizierungsmesswerte ein kritischer Teil dieser Phase für MIRA werden.

Wenn Klok beginnt, nützliche reale Daten wie Verifizierungslatenz, Erfolgsquoten von Beweisen, Durchsatzkapazität oder Zuverlässigkeit unter Last anzuzeigen, haben Entwickler plötzlich etwas Greifbares, um zu bewerten. Zahlen ändern, wie Projekte wahrgenommen werden. Daten ersetzen Spekulation.

In vielerlei Hinsicht ist das der Punkt, an dem Projekte entweder ihre Glaubwürdigkeit stärken oder kämpfen, um Aufmerksamkeit zu behalten.

Krypto-Geschichte ist voller ehrgeiziger Ideen, die mächtig klangen, aber sich nie in der Praxis bewiesen haben. Sobald ein System echte Betriebsmetriken offenlegt, kann der Markt endlich beurteilen, ob die Technologie funktioniert.

Deshalb sehe ich diesen Rollout als eine wichtige Phase für MIRA.

Das Projekt nähert sich dem Punkt, an dem seine Kernthese testbar wird. Wenn die Verifizierungsschicht gut funktioniert, könnte sie MIRA als Infrastruktur positionieren, anstatt nur ein weiteres KI-Erzähltoken zu sein. Wenn die Leistung leidet oder die Transparenz unklar bleibt, wird die Akzeptanz wahrscheinlich viel langsamer voranschreiten.

Das mag hart klingen, aber es ist auch der normale Prozess für aufstrebende Infrastrukturen.

Timing spielt hier auch eine Rolle. Der breitere KI-Sektor zieht weiterhin Aufmerksamkeit auf sich, aber die Diskussion darüber wird langsam reifer. Vor einem Jahr reichte es oft aus, KI in einer Projektbeschreibung zu erwähnen, um Aufregung zu erzeugen. Dieser Effekt lässt nach. Entwickler und Benutzer beginnen, tiefer zu schauen.

Sie wollen sehen, dass Systeme echte technische Probleme lösen.

Verifizierung ist eines dieser Probleme.

Die Fähigkeiten zur KI-Generierung haben sich bereits schnell entwickelt. Modelle können Code schreiben, komplexe Themen zusammenfassen, erklärungsähnliche Erklärungen produzieren und Argumentationen simulieren. Aber die Herausforderung, diese Ausgaben zu verifizieren, bleibt in vielen Kontexten ungelöst.

Deshalb könnte eine Verifizierungsschicht wertvoll werden, wenn sie sich als zuverlässig erweist.

Anstatt mit Dutzenden von Projekten zu konkurrieren, die versuchen, den leistungsstärksten KI-Agenten oder das komplexeste Automatisierungssystem zu bauen, scheint MIRA sich auf einen schmaleren Teil des Stacks zu konzentrieren. Es zielt auf die Schicht ab, die dafür verantwortlich ist, zu überprüfen, ob KI-Ausgaben tatsächlich vertrauenswürdig sind.

In der Infrastrukturgestaltung werden diese grundlegenden Schichten oft zu den wichtigsten.

Wenn das Verifizierungssystem gut funktioniert, könnten Entwickler allmählich beginnen, damit zu experimentieren. Ökosysteme wachsen selten über Nacht. Was normalerweise passiert, ist eine langsamere Abfolge von Schritten.

Zuerst zieht der Rollout Aufmerksamkeit an.

Dann beginnen die Leute, die Systemmetriken zu beobachten.

Einige Entwickler testen die Infrastruktur.

Frühe Experimente erscheinen.

Im Laufe der Zeit, wenn das System weiterhin zuverlässig arbeitet, beginnt sich ein kleines Ökosystem um es zu bilden.

Dieser Fortschritt ist viel realistischer als plötzlicher explosiver Wachstum.

Für jetzt ist die wichtigste Frage, ob der Klok-Rollout glaubwürdige Daten liefert. Entwickler, die mit KI-Systemen arbeiten, sind in der Regel sehr analytisch. Ihnen liegt viel an Zuverlässigkeit, Kosteneffizienz und Systemleistung. Wenn die Verifizierung zu langsam, zu teuer oder zu kompliziert wird, um integriert zu werden, könnte die Akzeptanz ins Stocken geraten.

Aber wenn das System zeigt, dass die Verifizierung schnell und konsistent arbeiten kann, ändert sich die Gleichung.

Plötzlich wird das Projekt mehr als nur ein Konzept.

Es wird ein Werkzeug.

Diese Unterscheidung ist es, die oft langfristige Infrastruktur von temporären Erzählungen im Krypto-Raum trennt. Konzepte erzeugen Aufmerksamkeit. Werkzeuge erzeugen Ökosysteme.

Natürlich garantiert nichts davon den Erfolg. Verifizierungssysteme sind schwer zu skalieren. Die Geschwindigkeit zu halten, während komplexe KI-Ausgaben validiert werden, ist keine triviale Ingenieurherausforderung. Selbst wenn die technische Architektur solide ist, zählt auch die Erfahrung der Entwickler. Wenn die Integration schwierig ist, könnten Entwickler zögern, zu experimentieren.

Das sind die Arten von Hürden, denen sich jedes Infrastrukturprojekt letztendlich gegenübersieht.

Dennoch denke ich, dass diese Entwicklungsphase die ist, in der das echte Signal zu entstehen beginnt.

Wenn ein Projekt aufhört zu beschreiben, was es hofft zu erreichen, und beginnt zu demonstrieren, was seine Systeme tatsächlich tun können, wird die Diskussion geerdeter. Der Markt beginnt, seinen Fokus von Erzählungen zu messbarer Leistung zu verschieben.

Und das scheint die Phase zu sein, in die MIRA jetzt eintritt.

Der Klok-Rollout wird möglicherweise nicht sofort ändern, wie jeder das Projekt sieht. Viele Menschen im Markt werden weiterhin auf Preisbewegungen oder kurzfristige Nachrichtenzyklen achten. Aber Entwickler beobachten oft etwas anderes.

Sie beobachten den Beweis.

Wenn die Verifizierungsmesswerte beginnen zu zeigen, dass das System konsistent funktioniert, könnte es langsam Vertrauen bei Entwicklern aufbauen, die KI-integrierte Infrastrukturen erkunden. Diese Art von Vertrauen ist normalerweise die Grundlage langfristiger Ökosysteme.

Gerade jetzt ist das der Teil, der mich am meisten interessiert.

Nicht das Marketing.

Nicht die Erzählung.

Der Beweis.

Denn eine Antwort zu produzieren ist nicht mehr der schwierige Teil der KI-Systeme.

Die echte Herausforderung besteht darin, zu beweisen, dass die Antwort tatsächlich vertrauenswürdig ist.

Und welche Projekte dieses Problem zuerst lösen, könnten am Ende einige der wichtigsten Infrastrukturen in der nächsten Phase der KI-Entwicklung aufbauen.

Titel: Die fehlende Schicht zwischen KI und Vertrauen

In letzter Zeit habe ich mehr über die Richtung nachgedacht, in die KI und Blockchain zu konvergieren beginnen. Die Diskussion über diesen Raum wird lauter, aber je mehr ich verschiedene Projekte durchlese, desto mehr fällt mir auf, dass die meisten von ihnen sich auf dasselbe Versprechen konzentrieren.

Sie wollen, dass KI mehr tut.

Mehr Automatisierung.

Mehr Intelligenz.

Mehr Entscheidungsfindung.

Aber es gibt eine Frage, die mir jedes Mal, wenn ich KI-Tools benutze oder diese Systeme beobachte, immer wieder kommt.

Wie wissen wir tatsächlich, wann eine KI-Antwort korrekt ist?

KI-Modelle sind heute unglaublich gut darin, Informationen zu produzieren. Sie können Texte generieren, Probleme lösen, Konzepte erklären und sogar komplexen Code schreiben. Die Geschwindigkeit und Qualität dieser Ausgaben verbessern sich jedes Jahr.

Aber Zuverlässigkeit ist immer noch eine andere Herausforderung.

Manchmal sieht eine KI-Antwort perfekt strukturiert und logisch aus und ist trotzdem ungenau. Es bedeutet nicht immer, dass das Modell kaputt ist. Es bedeutet einfach, dass Generierung und Verifizierung zwei sehr unterschiedliche Probleme sind.

Das ist der Punkt, an dem MIRA für mich herausstach.

Anstatt sich nur darauf zu konzentrieren, intelligentere KI-Systeme zu bauen, scheint das Projekt sich auf etwas zu konzentrieren, das im Laufe der Zeit möglicherweise sogar wichtiger werden könnte – Verifizierung. Die Idee, dass KI-Ausgaben überprüft und validiert werden sollten, bevor sie innerhalb größerer Systeme vertraut werden.

Hier wird der Klok-Rollout interessant.

Für mich fühlt sich Klok wie die Bühne an, auf der MIRA beginnt zu zeigen, wie sich sein Verifizierungsmodell außerhalb der Theorie verhält. Viele Projekte beschreiben ehrgeizige Architekturen in Whitepapers, aber der echte Test findet immer statt, wenn diese Ideen in Live-Umgebungen übergehen.

Sobald ein System beginnt, echte Leistungsmetriken zu produzieren, ändert sich die Diskussion.

Die Menschen hören auf, darüber zu debattieren, ob das Konzept vielversprechend klingt, und beginnen, messbare Ergebnisse zu betrachten. Das ist normalerweise der Moment, in dem Entwickler anfangen, genauer hinzuschauen.

Bauer verpflichten sich selten zur Infrastruktur allein aufgrund von Marketing. Was sie sehen möchten, sind Signale, dass das System stabil und funktional ist. Sie wollen wissen, ob die Technologie effizient läuft und ob sie echte Nutzung bewältigen kann.

Wenn Klok beginnt, klare Verifizierungsdaten anzuzeigen, Dinge wie Reaktionsvalidierungsgeschwindigkeit, Beweiszuverlässigkeit oder Systemdurchsatz, könnte das ein wichtiges Signal für das Ökosystem werden.

Zahlen geben Entwicklern etwas Reales, um zu bewerten.

In vielerlei Hinsicht ist dies der Punkt, an dem Projekte von Erzählungen zu Infrastrukturen übergehen. Krypto war schon immer voller ehrgeiziger Visionen, aber nur eine kleinere Anzahl dieser Visionen wird schließlich zu Systemen, auf die Entwickler angewiesen sind.

Der Unterschied liegt normalerweise in der Leistung.

Deshalb fühlt sich dieser Rollout wie ein wichtiger Kontrollpunkt für MIRA an. Das Projekt nähert sich dem Moment, in dem seine Hauptidee beginnen kann, sich in der Praxis zu beweisen. Wenn die Verifizierung effizient und konsistent funktioniert, stärkt das das Argument, dass MIRA ein echtes Problem löst.

Und Verifizierung ist definitiv ein echtes Problem.

Wenn KI-Systeme zunehmend in digitale Plattformen, Automatisierungstools und dezentrale Dienste integriert werden, wird der Bedarf an Vertrauen in diese Ausgaben viel ernster. Es ist eine Sache, wenn ein KI-Modell hilft, eine E-Mail zu entwerfen oder ein Dokument zusammenzufassen.

Es ist etwas ganz anderes, wenn dasselbe Modell in finanziellen Entscheidungen, Smart Contracts oder automatisierter Koordination zwischen Maschinen beteiligt ist.

In diesen Umgebungen sind Genauigkeit und Zuverlässigkeit nicht optional.

Deshalb ist die Idee einer Verifizierungsschicht interessant. Anstatt mit den vielen Projekten zu konkurrieren, die versuchen, den leistungsstärksten KI-Agenten zu bauen, scheint MIRA sich auf einer anderen Ebene des Stacks zu positionieren.

Es versucht sicherzustellen, dass KI-Ausgaben überprüft werden können, bevor man sich auf sie verlässt.

Manchmal ist die wichtigste Infrastruktur nicht das System, das Informationen erzeugt, sondern das System, das sie validiert.

Wenn dieser Ansatz funktioniert, könnte er allmählich Entwickler anziehen, die Anwendungen rund um KI-basierte Entscheidungssysteme aufbauen. Die Akzeptanz würde wahrscheinlich nicht über Nacht geschehen. Infrastruktur verbreitet sich selten so schnell.

In der Regel beginnt es mit Neugier.

Entwickler bemerken die Technologie.

Sie überwachen, wie das System funktioniert.

Einige Entwickler beginnen, mit ihm zu experimentieren.

Kleine Anwendungen beginnen zu erscheinen.

Im Laufe der Zeit, wenn die zugrunde liegende Infrastruktur zuverlässig bleibt, wächst dieses Experimentieren langsam zu einem Ökosystem.

Das ist die Art von Fortschritt, die ich hier ebenfalls erwarten würde.

Natürlich garantiert der Rollout selbst keinen Erfolg. Verifizierungssysteme bringen ihre eigenen Herausforderungen mit sich. Geschwindigkeit, Skalierbarkeit und Kosteneffizienz spielen alle wichtige Rollen. Wenn die Validierung zu lange dauert oder zu teuer wird, könnten Entwickler zögern, sich darauf zu verlassen.

Selbst starke technische Konzepte haben manchmal Schwierigkeiten, weil die Werkzeuge rund um sie schwer zu bedienen sind.

Aber genau deshalb sind reale Metriken so wichtig.

Sobald ein System öffentlich arbeitet, muss der Markt nicht mehr auf Annahmen angewiesen sein. Leistungsdaten beginnen, die Geschichte für sich selbst zu erzählen. Diese Transparenz bestimmt oft, ob Entwickler genug Vertrauen entwickeln, um auf einer Plattform aufzubauen.

Die breitere KI-Landschaft verändert sich ebenfalls auf eine Weise, die diese Art von Infrastruktur relevanter macht. Frühere Phasen des KI-Booms konzentrierten sich hauptsächlich auf die Fähigkeit. Die Menschen waren begeistert von dem, was Modelle produzieren konnten.

Jetzt wird die Diskussion langsam praktischer.

Benutzer und Entwickler beginnen, tiefere Fragen zu Zuverlässigkeit, Verantwortlichkeit und Vertrauen zu stellen. Wenn KI-Systeme zunehmend in digitale Infrastrukturen eingebettet werden, werden diese Fragen nur wichtiger.

Verifizierung steht im Zentrum dieser Diskussion.

Deshalb denke ich, dass der Klok-Rollout mehr als nur ein weiteres Produkt-Update darstellt. Es fühlt sich an wie ein Schritt in Richtung Prüfung, ob MIRA’s Kernthese unter realen Bedingungen operieren kann.

Wenn das System starke Leistung zeigt, könnte es die Idee stärken, dass KI spezielle Verifizierungsschichten benötigt. Und wenn Entwickler beginnen, konsistenten Beweis zu sehen, dass die Infrastruktur funktioniert, könnte die Position des Projekts innerhalb des KI-Ökosystems viel klarer werden.

Für jetzt ist das Wichtigste, wie sich das System verhält, sobald es offen läuft.

Nicht die Ankündigungen.

Nicht die Erzählungen.

Die Daten.

Denn in der heutigen KI-Umgebung wird es jeden Tag einfacher, Antworten zu generieren.

Die echte Herausforderung besteht darin, Systeme zu bauen, die diese Antworten vertrauenswürdig machen.

#Mira @Mira - Trust Layer of AI $MIRA