Künstliche Intelligenz zieht in jede Ecke der digitalen Welt ein. Von der Inhaltserstellung und Handelssystemen bis hin zu Forschung und Entscheidungsfindung wird KI zu einer mächtigen Kraft hinter der Art und Weise, wie Informationen und Werte online bewegt werden. Doch während der Einfluss der KI wächst, beginnt eine tiefere Frage an die Oberfläche zu treten: Können wir den Entscheidungen, die diese Systeme treffen, tatsächlich vertrauen? Dies ist der Moment, in dem die Idee hinter Mira hervorsticht.

Mira führt ein Konzept ein, das als die Vertrauensebene der KI bezeichnet wird. Anstatt sich nur darauf zu konzentrieren, die KI schneller oder leistungsfähiger zu machen, konzentriert sich das Projekt darauf, KI verantwortungsbewusst, transparent und überprüfbar zu machen. In einer Welt, in der Algorithmen Geld bewegen, Daten generieren und Entscheidungen beeinflussen können, wird das Bedürfnis nach Vertrauen ebenso wichtig wie die Technologie selbst. Mira versucht, ein System zu schaffen, in dem Menschen nicht einfach blind auf KI vertrauen, sondern tatsächlich inspizieren und verstehen können, wie Entscheidungen getroffen werden.

Denken Sie darüber nach, wie viel Verantwortung künstliche Intelligenz bereits heute trägt. Handelsalgorithmen führen Finanzaufträge in Millisekunden aus. KI-Tools schreiben Berichte und analysieren Märkte, und intelligente Systeme verwalten enorme Datenmengen. Diese Systeme arbeiten unglaublich schnell, aber die Gründe für ihr Handeln sind oft verborgen. Die meiste Zeit sehen die Benutzer nur das Ergebnis. Sie sehen selten die Logik, die Datenquellen oder die Argumentationskette, die zu diesem Ergebnis führten.

Dieser Mangel an Transparenz schafft eine Lücke zwischen Innovation und Vertrauen. Mira konzentriert sich darauf, diese Lücke zu schließen, indem sie eine Infrastruktur aufbaut, die es ermöglicht, KI-Entscheidungen zu untersuchen und zu verifizieren. Anstatt KI-Ausgaben als mysteriöse Ergebnisse zu behandeln, führt die Trust-Schicht von KI Mechanismen ein, die aufzeichnen, wie diese Ergebnisse erzeugt wurden. Das bedeutet, dass jede Aktion potenziell auf ihre Gründe und die Informationen, die sie beeinflussten, zurückverfolgt werden kann.

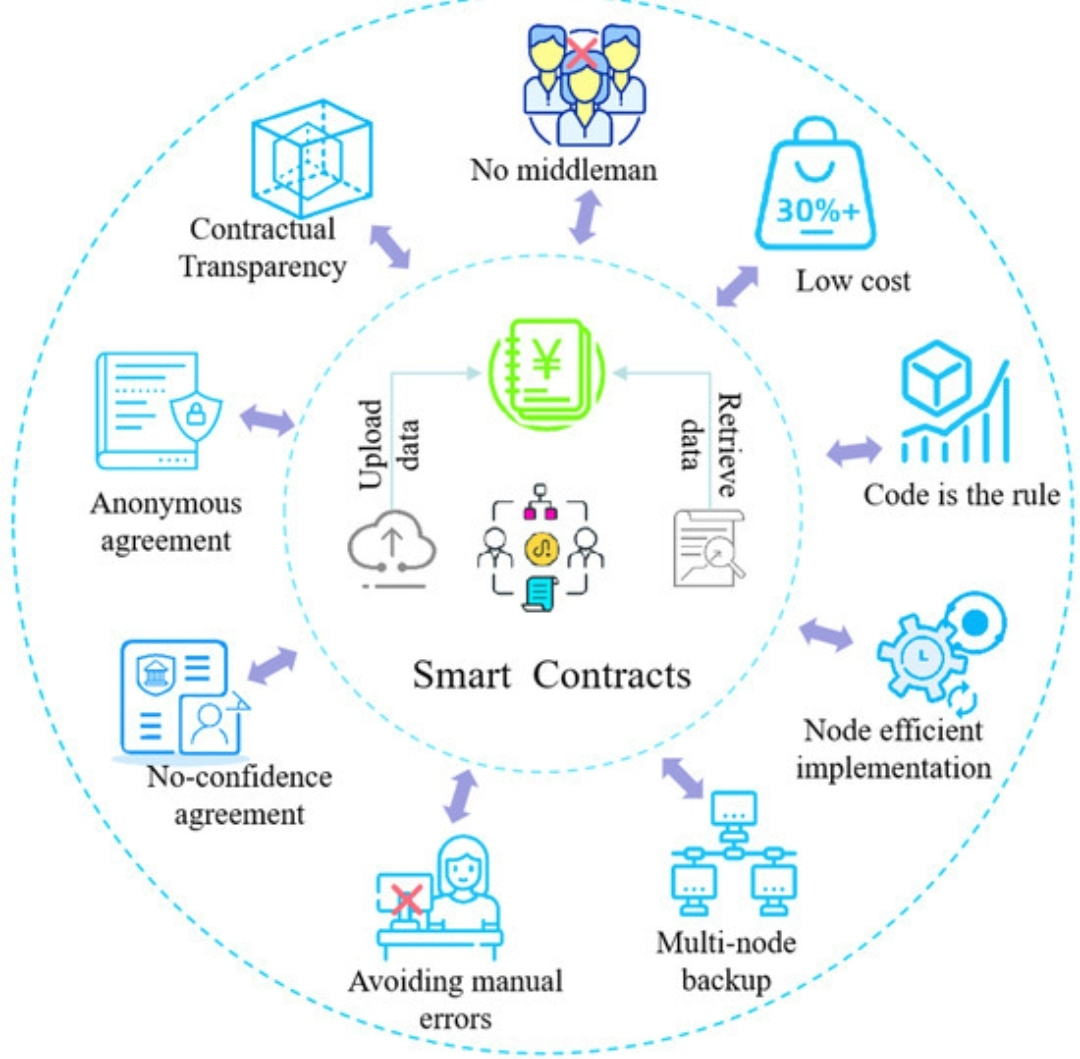

Die Bedeutung dieser Idee wird noch klarer, wenn die Blockchain-Technologie ins Gespräch kommt. Die Blockchain bietet bereits eine der sichersten Möglichkeiten, digitale Transaktionen aufzuzeichnen. Jede Übertragung wird dokumentiert, jede Aktion wird aufgezeichnet, und jeder Schritt wird extrem schwierig zu ändern. Aber obwohl die Blockchain genau zeigt, was passiert ist, erklärt sie selten, warum die Aktion passiert ist.

Zum Beispiel, stellen Sie sich einen KI-Agenten vor, der Gelder von einer Brieftasche in eine andere überträgt. Die Blockchain wird die Transaktion perfekt aufzeichnen. Jeder kann den Betrag, die Brieftaschenadressen und die Zeit der Übertragung sehen. Aber die tiefere Frage bleibt unbeantwortet. Warum hat die KI entschieden, diesen Schritt zu machen? Welche Daten hat sie analysiert? Welche Argumentation führte zu dieser Entscheidung? Diese fehlende Erklärungsebene ist genau das, was Mira zu lösen versucht.

Die Trust-Schicht von KI führt Systeme ein, die es ermöglichen, die Gründe hinter den KI-Handlungen zu untersuchen. Durch die Kombination von Verifikationsmechanismen mit dezentraler Infrastruktur versucht Mira, einen Logikdatensatz neben dem Transaktionsdatensatz zu erstellen. Einfach ausgedrückt zeigt die Blockchain, was passiert ist, während die Trust-Schicht erklärt, warum es passiert ist.

Dieser Ansatz hat enorme Implikationen für die Zukunft dezentraler Technologien. Da KI-Agenten autonomer werden, werden sie ohne direkte menschliche Kontrolle mit Finanznetzwerken, Datensystemen und digitalen Diensten interagieren. Dieses Maß an Automatisierung erfordert einen Rahmen, der Verantwortlichkeit aufrechterhalten kann. Ohne Transparenz könnten Menschen zögern, sich auf Systeme zu verlassen, die sie nicht verstehen.

Mira erkennt diese Herausforderung und geht sie aus einer einzigartigen Perspektive an. Anstatt die Benutzer zu zwingen, zentralen Unternehmen oder geschlossenen Algorithmen zu vertrauen, konzentriert sich das Projekt auf dezentrale Verifikation. Die Gemeinschaft und das Netzwerk selbst können eine Rolle bei der Validierung der Datenquellen, der Argumentationsprozesse und der Ergebnisse spielen, die von KI-Systemen erzeugt werden.

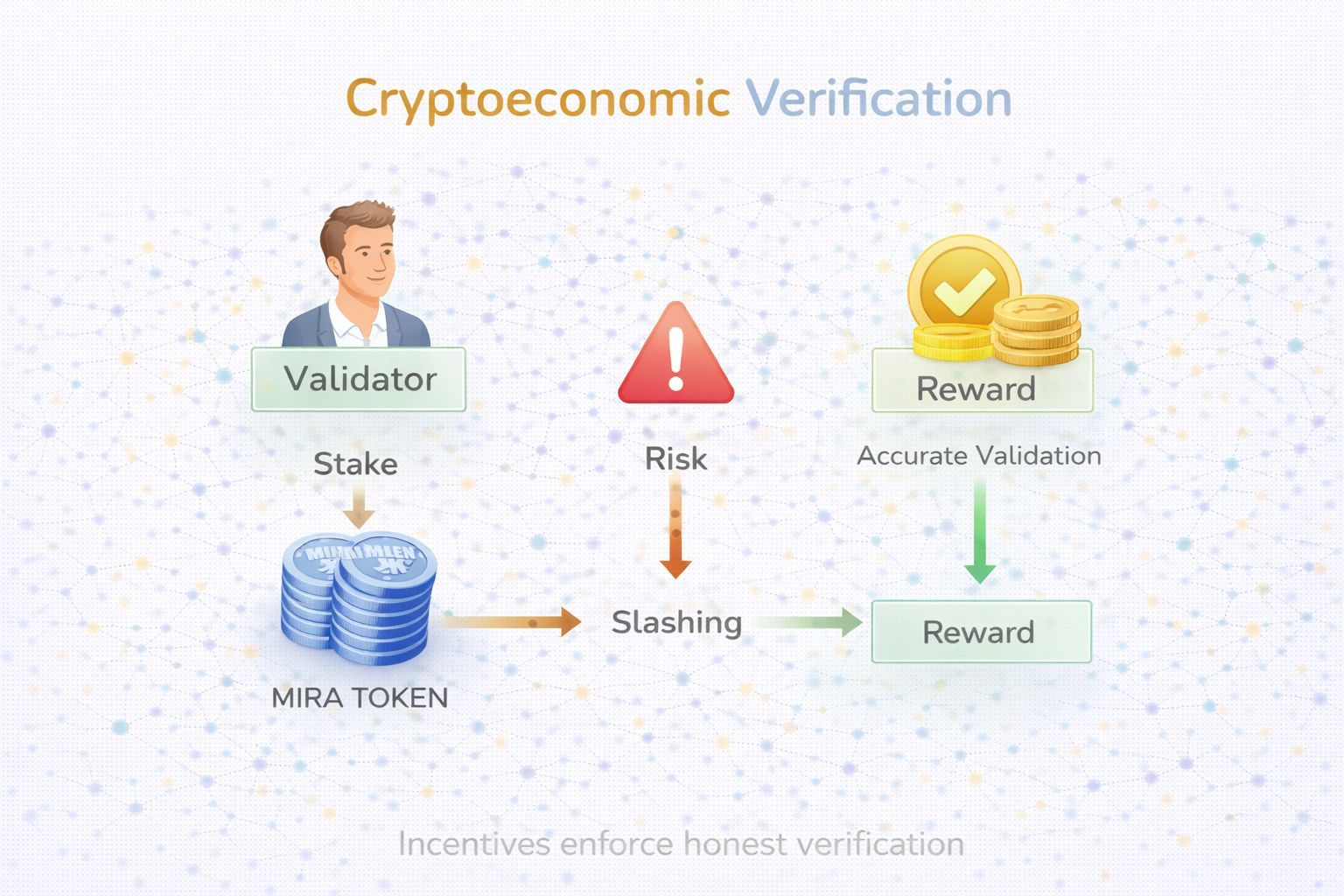

Ein weiteres interessantes Element im Mira-Ökosystem ist die Rolle des MIRA-Tokens. Anstatt nur als handelbares digitales Asset zu existieren, fungiert es als funktionale Komponente, die das Netzwerk unterstützt. Der Token kann für Teilnahme, Governance und Anreize verwendet werden, die ehrliche Verifikation im gesamten Ökosystem fördern. Diese Struktur hilft, ein Umfeld zu schaffen, in dem Vertrauen kollektiv aufrechterhalten wird, anstatt von einer einzigen Autorität kontrolliert zu werden.

Aus einer breiteren Perspektive scheint das Timing dieser Idee unglaublich wichtig zu sein. Künstliche Intelligenz tritt in eine Phase ein, in der sie nicht nur Menschen unterstützt, sondern auch unabhängig handelt. Autonome Agenten können Märkte analysieren, auf Ereignisse reagieren und sogar mit Smart Contracts interagieren. Die Geschwindigkeit und das Ausmaß dieser Aktionen machen Transparenz wichtiger als je zuvor.

Gleichzeitig wächst das öffentliche Bewusstsein für KI. Die Menschen beginnen zu hinterfragen, wie Algorithmen ihre finanziellen Entscheidungen, ihre Online-Erfahrungen und sogar die Informationen, die sie konsumieren, beeinflussen. Dieses Bewusstsein zwingt die Technologiebranche dazu, ernster über Verantwortlichkeit nachzudenken. Mira spiegelt diesen Wandel wider, indem sie überprüfbare KI priorisiert, anstatt einfach nur leistungsstarke KI.

Für Entwickler und Erbauer eröffnet dieses Konzept neue Möglichkeiten. Anwendungen, die künstliche Intelligenz integrieren, könnten Mechanismen beinhalten, die zeigen, wie Entscheidungen getroffen wurden. Datenquellen könnten validiert, Argumentationsschritte dokumentiert und Benutzer könnten ein klareres Verständnis dafür gewinnen, wie automatisierte Systeme arbeiten. Diese Art von Transparenz kann das Vertrauen zwischen Technologie und den Menschen, die sie nutzen, erheblich stärken.

Inhalte-Ersteller und Analysten im Kryptobereich beginnen ebenfalls, die Bedeutung dieser Idee zu erkennen. Die Schnittstelle zwischen Blockchain und künstlicher Intelligenz stellt eine der aufregendsten Grenzen der modernen Technologie dar. Blockchain bietet Sicherheit und Transparenz, während KI Intelligenz und Automatisierung bereitstellt. Diese beiden Elemente verantwortungsbewusst zu kombinieren, könnte die nächste Generation digitaler Infrastruktur gestalten.

Mira steht genau an dieser Schnittstelle. Das Projekt untersucht nicht nur, wie KI mit Blockchain arbeiten kann, sondern auch, wie Vertrauen direkt in diese Beziehung eingebaut werden kann. Diese Perspektive lenkt das Gespräch von Hype weg und hin zu langfristiger Nachhaltigkeit. Denn je leistungsfähiger die Technologie wird, desto mehr wird die Gesellschaft Systeme verlangen, die sich selbst erklären können.

Ein weiterer Faktor, der oft den Erfolg aufstrebender Technologien bestimmt, ist das Engagement der Gemeinschaft. Innovative Ideen gewinnen an Schwung, wenn Entwickler, Forscher, Kreatoren und Unterstützer zum Ökosystem beitragen. Mira hat begonnen, Aufmerksamkeit von Personen zu erregen, die glauben, dass vertrauenswürdige KI eine der wichtigsten Säulen der zukünftigen digitalen Wirtschaft werden wird.

Diese Gespräche prägen allmählich eine größere Erzählung. Die nächste Phase der künstlichen Intelligenz wird nicht nur durch intelligentere Modelle oder schnellere Algorithmen definiert. Sie wird auch durch die Fähigkeit der Systeme definiert, Zuverlässigkeit und Verantwortlichkeit zu demonstrieren. Die Fähigkeit, KI-Entscheidungen zu verifizieren, könnte eine Standarderwartung werden, anstatt ein Luxusmerkmal.

Mira stellt einen frühen Versuch dar, dieses Fundament zu schaffen. Durch die Einführung der Trust-Schicht von KI schlägt das Projekt vor, dass Transparenz nicht später hinzugefügt werden sollte, sondern von Anfang an in das System integriert werden sollte. Wenn Argumentationsprozesse untersucht werden können, Daten validiert werden können und Aktionen dokumentiert werden können, gewinnen die Benutzer Vertrauen in die Technologie, die ihr digitales Leben steuert.

Wenn man vorausblickt, erstreckt sich die potenzielle Auswirkung dieses Ansatzes weit über die Kryptomärkte hinaus. KI-Systeme könnten Lieferketten verwalten, medizinische Forschung unterstützen, dezentrale Organisationen koordinieren und massive wissenschaftliche Datensätze analysieren. In jedem dieser Bereiche könnte die Fähigkeit, Entscheidungsprozesse nachzuvollziehen, extrem wertvoll werden.

Am Ende ist die Kernidee hinter Mira überraschend einfach. Technologie bewegt sich schnell, aber Vertrauen bewegt sich vorsichtig. Innovation kann mächtige Werkzeuge schaffen, aber Transparenz stellt sicher, dass diese Werkzeuge verantwortungsvoll eingesetzt werden. Indem sie sich auf die Trust-Schicht konzentriert, hebt Mira eine Wahrheit hervor, die viele Menschen zu erkennen beginnen. Die Zukunft der künstlichen Intelligenz wird nicht nur davon abhängen, wie intelligent Maschinen werden, sondern auch davon, wie sehr wir ihnen vertrauen können.

Während sich die digitale Welt weiterentwickelt, könnte das Vorhandensein von Systemen, die KI-Entscheidungen verifizieren, erklären und dokumentieren, beeinflussen, wie wohl sich die Gesellschaft mit Automatisierung fühlt. Mira erkundet diesen Weg, indem sie eine Infrastruktur aufbaut, die Intelligenz mit Verantwortlichkeit verbindet. In einer Landschaft voller ehrgeiziger Projekte könnte der Fokus auf Vertrauen letztendlich eine der wichtigsten Innovationen von allen darstellen.#Mira @Mira - Trust Layer of AI