Heute früh habe ich einige Notizen zu verschiedenen KI-Projekten durchgesehen, und mir kam immer wieder etwas in den Sinn: KI wird unglaublich mächtig. Man stellt eine komplexe Frage, und sie antwortet sofort. Aber es gibt immer noch eine Lücke.

Wir vertrauen den Antworten mehr, als dass wir sie überprüfen.

Das ist die Herausforderung, die das Mira-Netzwerk anscheinend angeht. MIRA

KI-Antworten wie Ansprüche behandeln

Eine Sache, die mir bei Mira wirklich aufgefallen ist, ist, wie sie "KI-Ausgaben" behandeln. Anstatt die Antwort von einer KI einfach als endgültige Antwort zu sehen, betrachtet Mira sie eher als einen Anspruch, der überprüft werden muss.

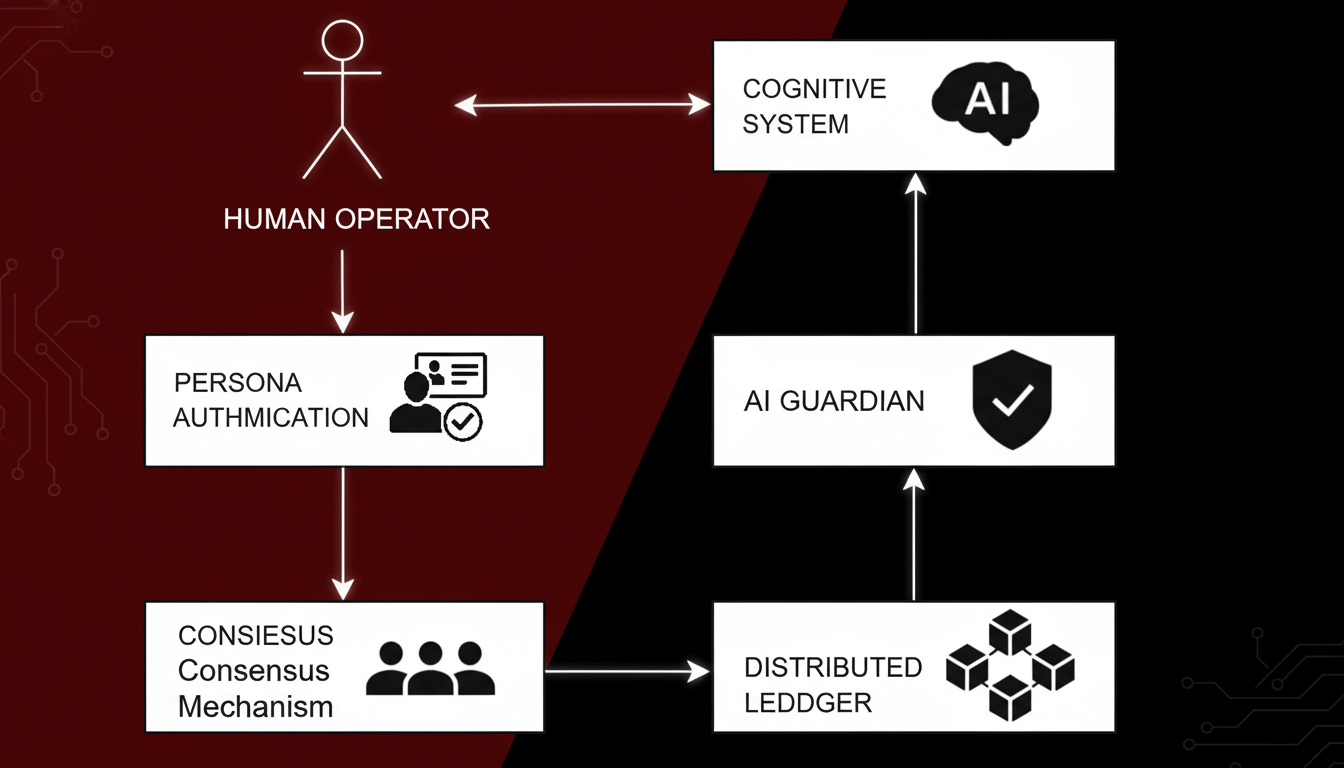

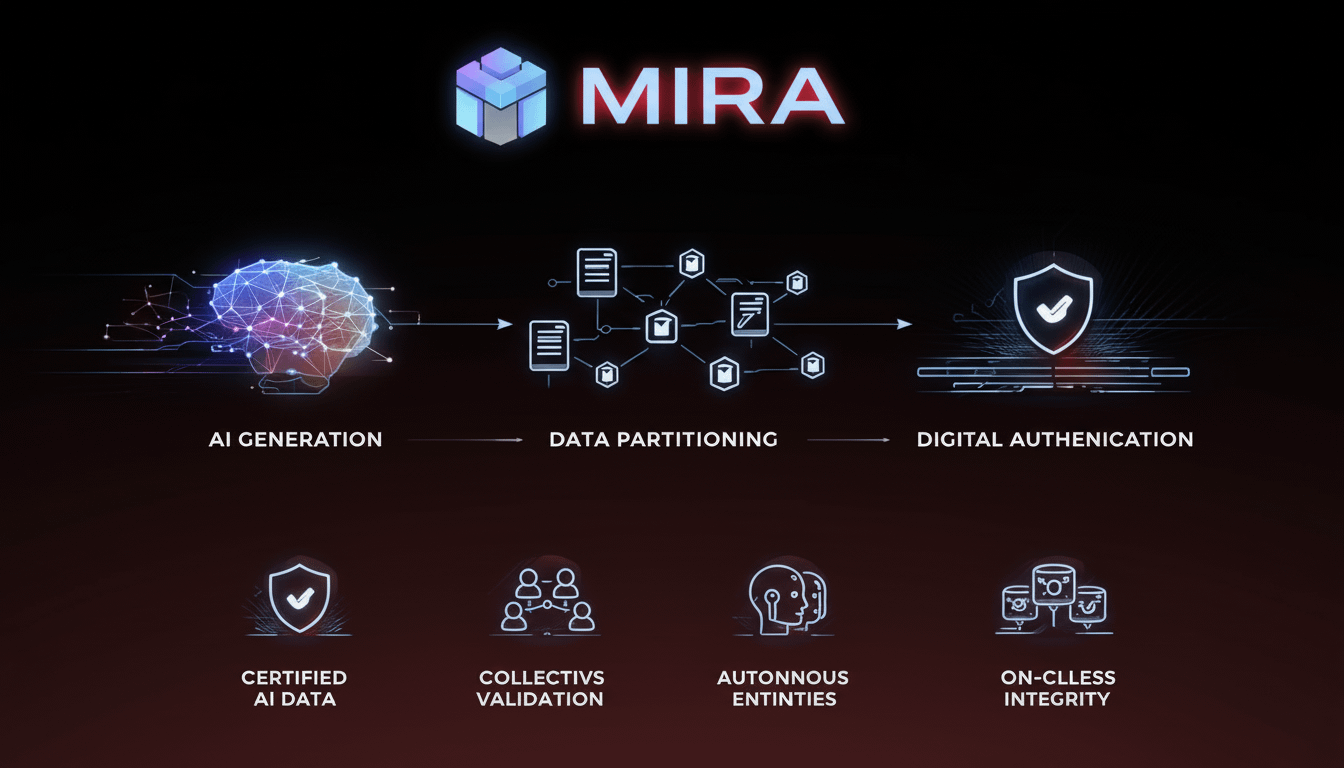

Dieser kleine Wandel verändert wirklich, wie die Dinge funktionieren. Wenn eine KI eine detaillierte Antwort generiert, zerlegt Mira sie in kleinere Ansprüche. Jeder dieser Ansprüche wird dann unabhängig von verschiedenen Modellen oder Validatoren im Netzwerk überprüft. $MIRA

Das bedeutet, dass man anstatt sich auf ein System zu verlassen, mehrere Prüfungen der gleichen Informationen erhält.

Warum es wichtig ist

Wenn Sie KI-Tools lange genug verwendet haben, haben Sie dies wahrscheinlich selbst erlebt. Manchmal sind die Antworten genau richtig. Andere Male klingen sie großartig, entpuppen sich aber als völlig falsch.

Das ist der seltsame Teil an der KI jetzt – sie liefert Antworten mit solch einer Überzeugung, aber das bedeutet nicht immer, dass sie richtig sind.

Woran Mira arbeitet, ist sicherzustellen, dass die Antworten der KI nicht sofort als Wahrheit akzeptiert werden. Stattdessen durchlaufen sie einen Verifizierungsprozess von mehreren verschiedenen Quellen. $MIRA

Die Infrastrukturseite

Ein weiterer interessanter Aspekt von Mira ist, wie sie den Verifizierungsprozess transparent aufzeichnen. Anstatt hinter den Kulissen zu geschehen, erstellt das Netzwerk eine Prüfspur, die genau zeigt, wie ein Anspruch überprüft und bestätigt wurde.

In Bereichen wie Finanzen, Forschung oder Recht könnte dieses Maß an Transparenz unglaublich wichtig werden. Es geht nicht darum, KI zu ersetzen, sondern sicherzustellen, dass wir dem, was sie sagt, vertrauen können.

Eine neue Art, über KI nachzudenken

Was mir an diesem Ansatz wirklich gefällt, ist, dass er die Diskussion über KI verändert. Die meisten KI-Projekte konzentrieren sich darauf, die Modelle intelligenter zu machen. Mira stellt eine andere Frage:

Was, wenn der nächste große Schritt nicht darin besteht, eine intelligentere KI zu bauen… sondern sie verifizierbar zu machen?

Wenn Miras Ansatz im größeren Maßstab funktioniert, könnten wir am Ende mit einer Welt dastehen, in der KI nicht nur Informationen schnell generiert – sie beweist auch, dass sie vertrauenswürdig ist.