@Mira - Trust Layer of AI #Mira $MIRA

Das erste Mal, dass ich wirklich darauf geachtet habe, wie sich Verifizierungssysteme verhalten, war nicht wegen eines dramatischen technischen Durchbruchs. Es war ein ruhigerer Moment. Ich sah zu, wie ein KI-Modell eine Antwort produzierte, die sicher, detailliert und sofort war. Wie die meisten KI-Ausgaben heute kam sie mit diesem vertrauten Ton der Sicherheit.

Und doch fühlte sich etwas daran unvollständig an.

Nicht unbedingt falsch. Einfach…...ungetestet.

Dieser Moment ließ mich etwas erkennen, worüber ich vorher nicht nachgedacht hatte. KI-Systeme werden extrem gut darin, Informationen zu produzieren, aber die wirkliche Frage ist, was passiert, nachdem die Informationen erscheinen. Wer überprüft sie? Wer bestätigt, dass sie vertrauenswürdig sind? Und vielleicht noch wichtiger, was macht ein System mit diesen Informationen, sobald sie verifiziert wurden?

Diese Fragen führten mich langsam dazu, zu beobachten, wie Verifizierungsprotokolle wie Mira tatsächlich funktionieren.

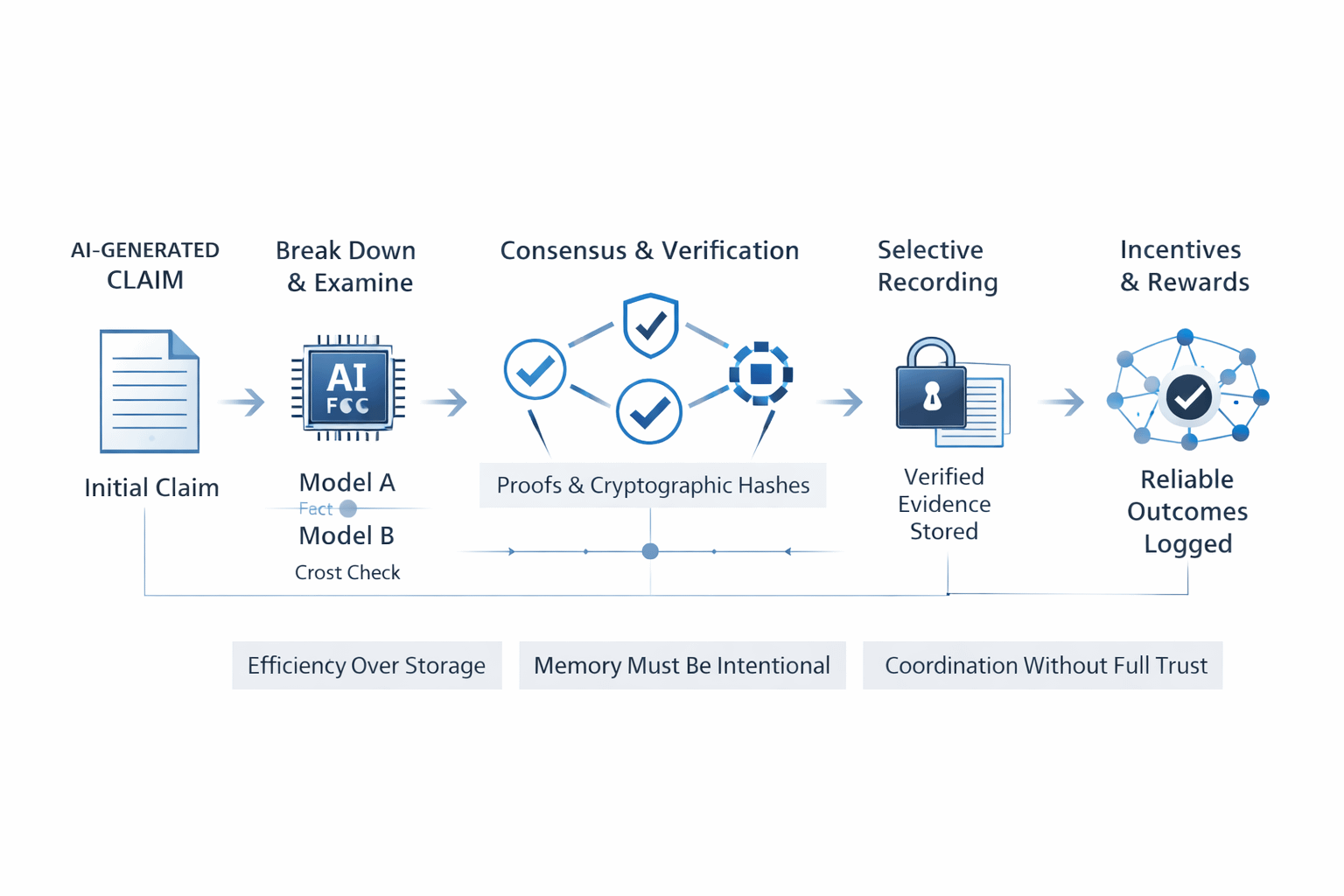

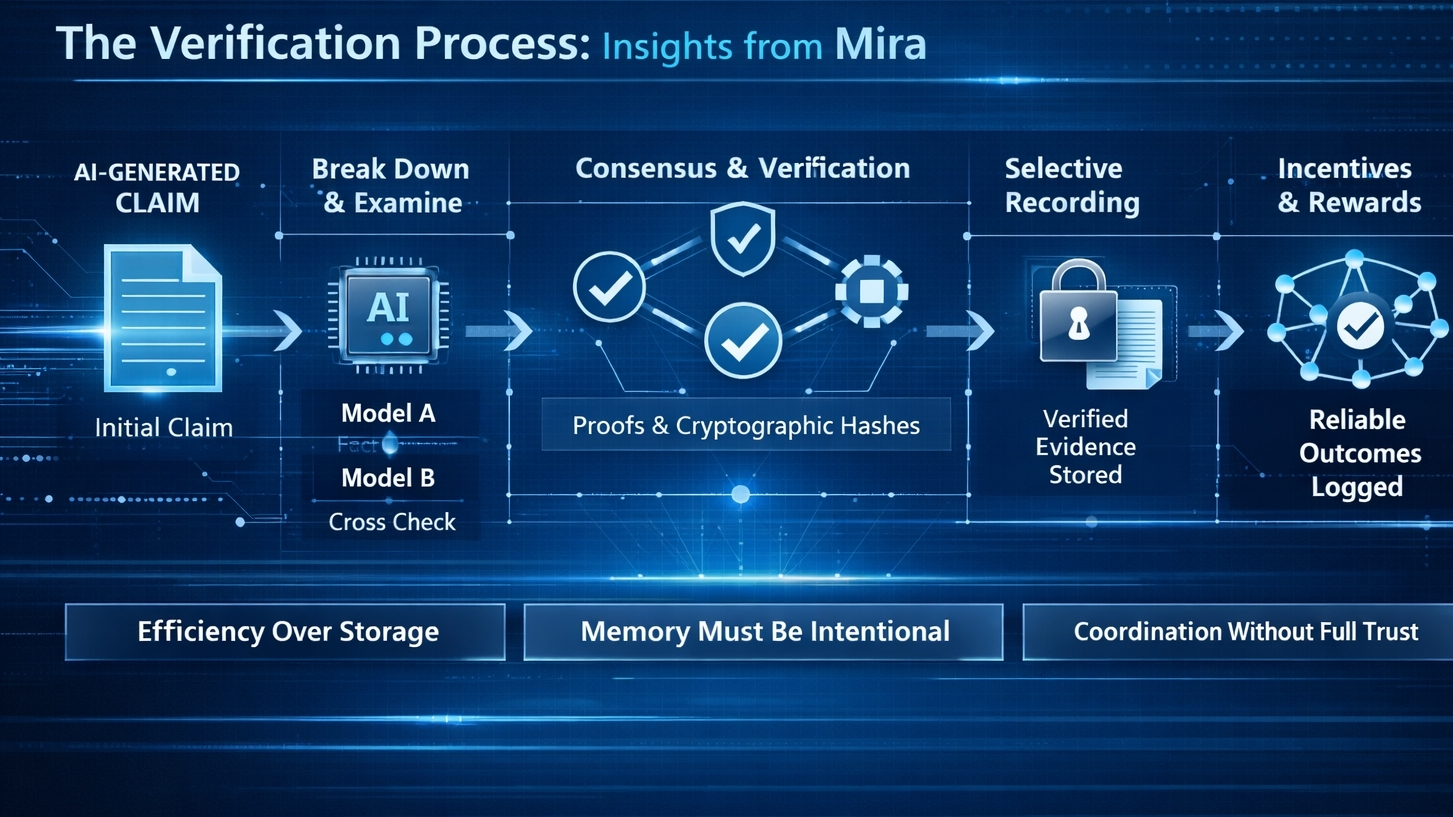

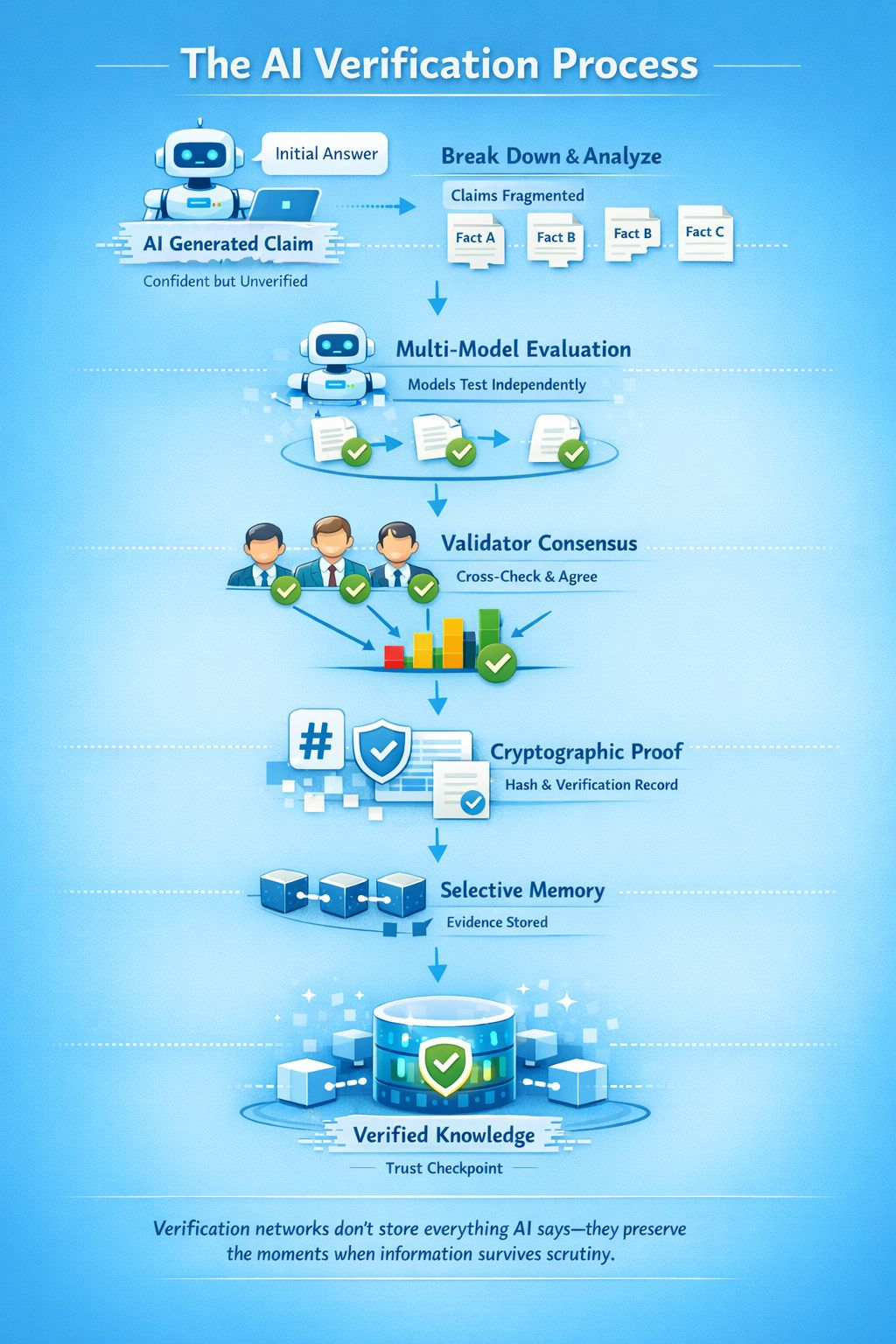

Auf den ersten Blick sieht der Prozess technisch, fast mechanisch aus. Ansprüche, die von KI-Systemen generiert werden, treten in das Netzwerk ein und beginnen, einen Verifizierungsprozess zu durchlaufen. Aber je länger ich zusah, desto weniger fühlte es sich wie Maschinenbetrieb an und desto mehr fühlte es sich wie ein sorgfältiges Gespräch an, das sich zwischen Teilnehmern entfaltet, die einander nicht sofort vertrauen.

Ein Anspruch bleibt selten lange ganz. Er wird in kleinere Teile zerlegt, einzelne Aussagen, die unabhängig untersucht werden können. Ein Modell prüft einen Teil davon. Ein anderes Modell betrachtet denselben Anspruch aus einem anderen Blickwinkel. Das System drängt nicht auf eine Einigung. Wenn überhaupt, scheint es so gestaltet zu sein, dass es die Dinge gerade genug verlangsamt, damit eine genauere Prüfung stattfinden kann.

Was mich am meisten beeindruckte, war die Zurückhaltung, die in diesen Prozess eingebaut ist.

In vielen technologischen Systemen besteht der Instinkt darin, alles zu sammeln. Jedes Ergebnis, jeden Datensatz, jedes Aktivitätsstück. Speicherung wird zu einer Art stiller Ansammlung. Aber bei Verifizierungsnetzwerken, insbesondere solchen, die auf Blockchain-Infrastruktur arbeiten, stößt dieser Instinkt schnell auf die Realität.

Speicherung ist teuer. Beständigkeit hat Gewicht.

Wenn jeder von KI generierte Anspruch vollständig gespeichert werden müsste, würde das Netzwerk schließlich von seiner eigenen Geschichte überwältigt werden. Das Volumen der von modernen KI-Modellen produzierten Sprache ist enorm. Alles zu behalten würde die Verifizierungsinfrastruktur in etwas verwandeln, das näher an einem Archiv als an einem funktionierenden System ist.

Die Architektur von Mira hat mir bewusst gemacht, dass die Protokolle unterschiedlich mit dem Gedächtnis umgehen.

Anstatt gesamte Antworten zu speichern, bewahrt das Netzwerk Beweise dafür, dass eine Verifizierung stattgefunden hat. Kryptographische Hashes, Konsensnachweise, kompakte Aufzeichnungen, die zeigen, dass mehrere Modelle einen Anspruch untersucht und eine Schlussfolgerung darüber erreicht haben. Die vollständigen Daten können weiterhin anderswo existieren; verteilte Speicherschichten können die umfangreicheren Informationen halten, aber die zentrale Verifizierungsschicht bleibt selektiv.

In praktischen Begriffen erinnert sich das System an den Moment der Verifizierung, nicht unbedingt an das gesamte Gespräch, das es hervorgebracht hat.

Ich fand diese Designentscheidung überraschend durchdacht.

Menschliche Wissenssysteme haben sich in eine ähnliche Richtung entwickelt. Wissenschaftliche Zeitschriften dokumentieren Ergebnisse, anstatt jedes Experiment, das auf dem Weg fehlgeschlagen ist, festzuhalten. Gerichte bewahren Urteile auf, während ein Großteil der Debatte darum in die Geschichte verblasst. Im Laufe der Zeit lernen Systeme, die Wissen verwalten, eine wichtige Lektion: Gedächtnis muss absichtlich sein.

Andernfalls wird es zu Lärm.

Eine weitere Ebene zeigt sich, wenn man Anreize betrachtet. In dezentralen Verifizierungsnetzwerken wird das Verhalten weniger durch Anweisungen und mehr durch ökonomische Signale geprägt. Validatoren achten darauf, weil Genauigkeit belohnt wird. Nachlässigkeit birgt Risiken. Das Speichern unnötiger Informationen wird unattraktiv, weil die Speicherung selbst Kosten verursacht.

Das System verlangt nicht direkt nach Disziplin. Es ermutigt sie stillschweigend.

Der Druck schafft etwas Interessantes: ein Netzwerk, in dem die Teilnehmer um die Verifizierung koordinieren, ohne einander vollständig vertrauen zu müssen. Jeder verifizierte Anspruch wird zu einem kleinen Punkt der Glaubwürdigkeit. Im Laufe der Zeit akkumulieren sich diese Punkte zu einem gemeinsamen Gedächtnis dessen, was tatsächlich untersucht wurde.

Natürlich ist kein System wie dieses ohne Unsicherheit. Anreize können sich verschieben. Teilnehmer könnten weniger aufmerksam werden. Verteilte Speicherschichten könnten fragmentieren oder sich auf unerwartete Weise entwickeln. Verifizierungsnetzwerke operieren in einem Umfeld, in dem technisches Design und menschliches Verhalten sich ständig gegenseitig beeinflussen.

Dennoch hinterlässt die Beobachtung des Systems über die Zeit einen besonderen Eindruck.

Es fühlt sich nicht wie eine Maschine an, die versucht, alles festzuhalten, was KI produziert. Die Architektur scheint vorsichtiger zu sein. Stattdessen verhält sie sich wie ein Netzwerk, das langsam lernt, welche Momente genug Bedeutung haben, um sie zu bewahren.

Nicht jeder Anspruch.

Nur die, die sorgfältiger Aufmerksamkeit überstehen.