*Der Moment, in dem eine KI-Antwort mich innehalten ließ*

Heute früh habe ich ein DeFi-Dashboard überprüft, während ich einigen Diskussionen über die CreatorPad-Kampagne auf Binance Square folgte. Ich hatte einen KI-Assistenten gebeten, die Liquiditätsaktivität über einige Pools zusammenzufassen, die ich beobachtet habe. Die Antwort sah auf den ersten Blick großartig aus. Strukturierte Analyse, klare Argumentation, sogar eine kleine Prognose darüber, wohin sich die Liquidität als nächstes bewegen könnte. Dann überprüfte ich die Rohdaten. Eine der Annahmen, die die KI getroffen hatte, war leicht falsch. Nicht dramatisch falsch, aber genug, dass ihre Schlussfolgerung über die Marktrichtung nicht wirklich stimmte. Dieser Moment erinnerte mich an etwas Unangenehmes über KI-Systeme: Sie sind extrem gut darin, Antworten zu produzieren, die vertrauenswürdig klingen, selbst wenn die Logik dahinter nicht perfekt ist. Und genau das ist die Art von Problem, die Mira zu lösen versucht. Das echte Vertrauensproblem hinter KI-Ausgaben. In der Krypto-Welt verbringen wir viel Zeit damit, über Dezentralisierung und Vertrauensminimierung zu sprechen. Blockchains haben das Transaktionsproblem gelöst, indem sie Vertrauen durch verteilten Konsens ersetzt haben. Aber KI-Systeme operieren immer noch größtenteils in einer vertrauensintensiven Umgebung. Wenn ein Modell ein Stück Information generiert – eine Analyse, Empfehlung oder Zusammenfassung – vertrauen die Nutzer in der Regel diesem Output ohne einen Verifizierungsprozess. In zentralisierten Systemen fungiert das Unternehmen, das das Modell betreibt, als die Autorität hinter diesem Vertrauen. Sobald KI anfängt, mit dezentralen Systemen zu interagieren, wird es komplizierter. Stellen Sie sich KI-Agenten vor, die DeFi-Märkte analysieren, Governance-Vorschläge zusammenfassen oder Signale für automatisierte Handelsstrategien generieren. Wenn diese Ausgaben falsch sind, könnten die Konsequenzen durch dezentrale Anwendungen hindurchreichen. Hier wird die Architektur von Mira interessant. Anstatt anzunehmen, dass KI-Ausgaben zuverlässig sind, führt sie eine Verifizierungsschicht zwischen Generierung und Vertrauen ein.

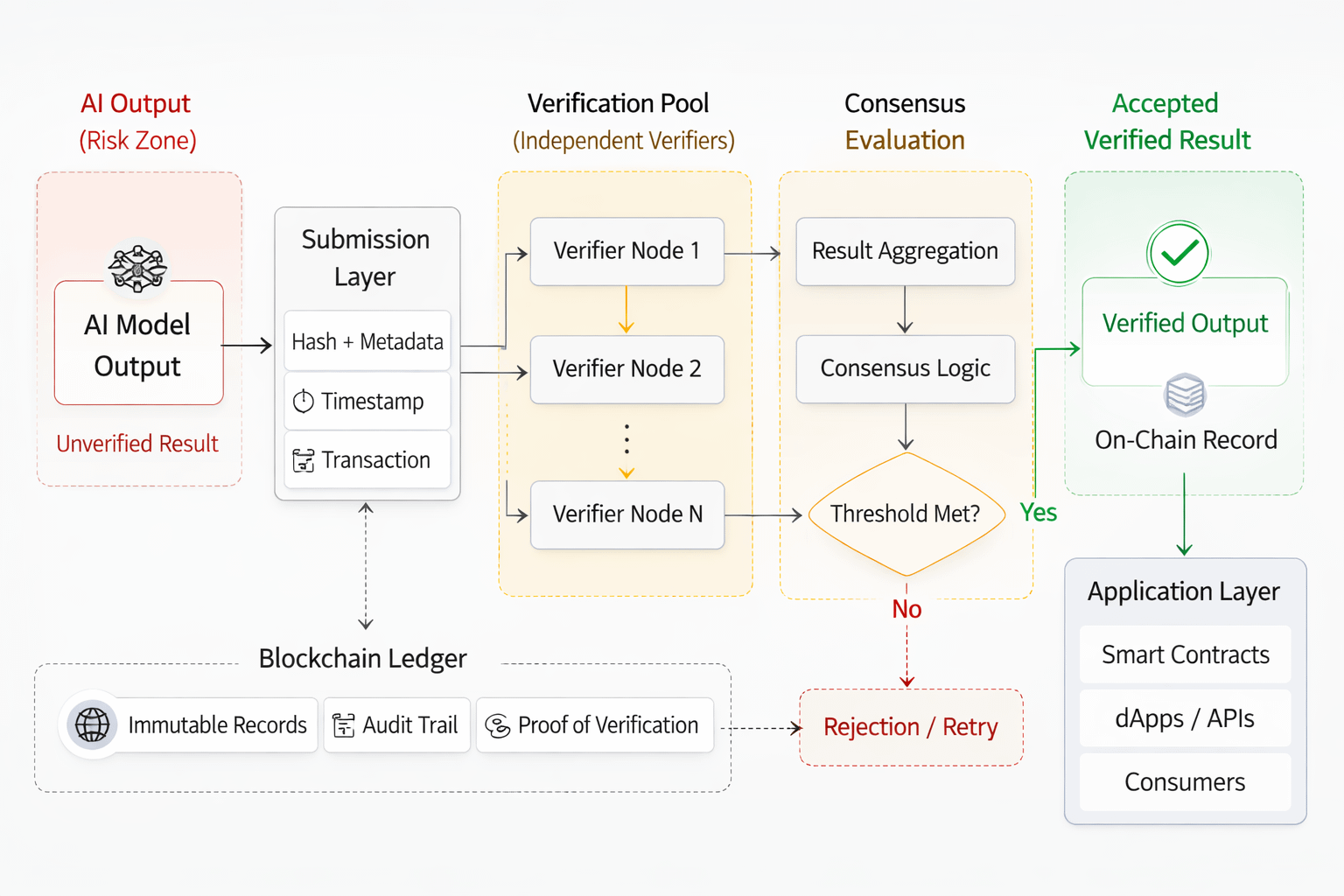

Miras Kernmechanismus: Trennung von Ausgabe und Akzeptanz. Aus dem Lesen von CreatorPad-Beiträgen und dem Durchforsten von Dokumentationsreferenzen, die in den Binance Square-Threads geteilt wurden, funktioniert Miras System, indem es den Prozess in zwei Phasen unterteilt. Die erste Phase ist unkompliziert: KI-Modelle erzeugen Ausgaben. Aber diese Ausgaben werden nicht sofort vom Netzwerk akzeptiert. Stattdessen treten sie in eine Überprüfungsphase ein, in der unabhängige Teilnehmer das Ergebnis bewerten, bevor es zu vertrauenswürdigen Informationen wird. Der Ablauf sieht ungefähr so aus:

AI-Ausgabe → Überprüfungsrunde → Validatorenvereinbarung → Akzeptiertes Ergebnis

Während ich das Design studierte, zeichnete ich tatsächlich ein kleines Workflow-Diagramm, um es zu verstehen. Die Struktur erinnerte mich an Blockchain-Validierungspipelines, nur dass das Netzwerk Informationen anstelle von Transaktionen überprüft. Diese kleine Designänderung könnte sich als ziemlich bedeutend herausstellen. Die Überprüfung in ein dezentrales Netzwerk verwandeln. Eines der Details, das in Miras Modell hervorsticht, ist die Abhängigkeit von mehreren unabhängigen Prüfern. Anstatt einer einzelnen Einheit zu vertrauen, die KI-Ausgaben bewertet, verteilt das Netzwerk diese Verantwortung auf die Teilnehmer. Jeder Prüfer überprüft die Ausgabe und reicht eine Bewertung ein. Wenn genügend Teilnehmer zustimmen, dass die Informationen gültig sind, akzeptiert das Netzwerk sie. Andernfalls wird die Ausgabe abgelehnt oder markiert. Im Wesentlichen wendet Mira dasselbe Prinzip an, das Blockchains sichert – verteilten Konsens – auf die Bewertung von maschinell generierten Informationen an. Und dieser Ansatz könnte das blinde Vertrauen in KI-Ausgaben dramatisch reduzieren. Wo dies in realen Anwendungen von Bedeutung sein könnte. Während ich die Diskussionen über CreatorPad-Kampagnen las, dachte ich ständig an KI-Agenten, die in DeFi-Systemen operieren. Einige Protokolle experimentieren bereits mit KI-gestützten Analysetools, die Portfolioallokationen oder Liquiditätsstrategien empfehlen. Wenn diese Werkzeuge falsche Schlussfolgerungen ziehen, könnten Benutzer finanzielle Entscheidungen auf der Grundlage fehlerhafter Informationen treffen. Mit Miras Überprüfungsschicht könnten diese Ausgaben von mehreren Teilnehmern bewertet werden, bevor sie Anwendungen beeinflussen. Anstatt dem Modell direkt zu vertrauen, bestätigt das Netzwerk, ob die Argumentation standhält. Dieser zusätzliche Schritt mag klein erscheinen, aber in Finanzsystemen könnte er das Risiko erheblich reduzieren. Die wirtschaftliche Seite des Vertrauens. Ein weiterer Aspekt von Miras Design, der meine Aufmerksamkeit erregte, ist das Anreizmodell. Teilnehmer, die KI-Ausgaben überprüfen, führen nicht nur eine technische Aufgabe aus. Sie werden wirtschaftlich für genaue Bewertungen belohnt. Das schafft ein System, in dem Vertrauen selbst zu einem Netzwerkdienst wird. KI-Entwickler erzeugen Informationen. Prüfer bewerten diese Informationen. Anwendungen konsumieren die verifizierten Ergebnisse. Einige Contributor von CreatorPad haben begonnen, diese Struktur als eine Überprüfungsökonomie zu bezeichnen, in der die Validierung von maschinell generiertem Wissen zu einer produktiven Tätigkeit wird. Wenn KI-generierte Inhalte weiterhin in Web3-Ökosystemen expandieren, könnte eine solche wirtschaftliche Schicht überraschend wertvoll werden.

Herausforderungen, die das System lösen muss. Natürlich wirft die Architektur einige wichtige Fragen auf. Die Überprüfung ist nicht immer unkompliziert. Einige AI-Ausgaben beinhalten faktische Behauptungen, die leicht überprüft werden können, während andere Argumentation oder Interpretation beinhalten. Das Protokoll benötigt zuverlässige Bewertungsrahmen, um die Prüfer zu leiten. Geschwindigkeit ist ein weiteres Anliegen. KI-Anwendungen arbeiten oft schnell, während Überprüfungsschichten zusätzliche Schritte einführen, bevor Ausgaben akzeptiert werden. Es besteht auch das Risiko von Koordinationsproblemen, wenn Prüfer einfach die Antworten der anderen kopieren, anstatt unabhängige Bewertungen durchzuführen. Dies sind schwierige Designherausforderungen, aber sie sind auch ähnlich den Koordinationsproblemen, mit denen frühe Blockchain-Netzwerke konfrontiert waren, als sie Konsenssysteme aufbauten. Warum Mira in Diskussionen auf CreatorPad immer wieder auftaucht. Nachdem ich Zeit damit verbracht habe, die Kampagnenbeiträge auf CreatorPad auf Binance Square zu lesen, ist mir aufgefallen, dass Mira-Diskussionen oft tiefer gehen als typische Token-Gespräche. Die Leute fragen nicht nur nach der Preisentwicklung. Sie diskutieren, wie dezentrale Systeme möglicherweise KI-generierte Informationen im großen Maßstab überprüfen könnten. Das ist eine ganz andere Art von Gespräch. Die größere Frage hinter Miras Design. Blockchains haben Finanzsysteme transformiert, indem sie die Notwendigkeit beseitigt haben, zentralen Intermediären zu vertrauen. KI-Systeme hingegen sind nach wie vor stark auf Vertrauen angewiesen. Benutzer vertrauen dem Modellanbieter, den Trainingsdaten und der Infrastruktur, die die Ausgaben erzeugt. Miras Architektur deutet auf eine andere Möglichkeit hin. Anstatt KI blind zu vertrauen, könnten Netzwerke maschinell generierte Informationen kollektiv überprüfen, bevor sie akzeptiert werden. Wenn KI weiterhin in dezentrale Ökosysteme integriert wird – von DeFi-Analysen bis zu Governance-Tools – könnte eine solche Überprüfungsschicht unerlässlich werden. Und wenn das passiert, werden Projekte wie Mira nicht nur KI-Experimente sein. Sie könnten Teil der Infrastruktur werden, die definiert, wie Vertrauen im Zeitalter des maschinell generierten Wissens funktioniert.

$ARIA $UAI $MIRA #Mira @Mira - Trust Layer of AI

#creatorpad #LearnWithFatima

#TrendingTopic #Market_Update