@Mira - Trust Layer of AI Als ich zum ersten Mal hörte, wie Menschen Blockchain als etwas beschrieben, das letztendlich Wissen verifizieren könnte, nicht nur Geld bewegen, hielt ich einen Moment inne. Nicht, weil die Idee unmöglich klang. Mehr, weil Blockchain mehr als ein Jahrzehnt damit verbracht hat, etwas viel Einfacheres zu tun und es dabei vernünftig gut zu machen.

Transaktionen abwickeln. Eigentum aufzeichnen. Sicherstellen, dass zwei Parteien sich auf ein Hauptbuch einigen können, ohne einem zentralen Vermittler zu vertrauen.

Diese Geschichte war eng, aber sie war klar.

Die Idee, dass die gleiche Art von Infrastruktur eines Tages helfen könnte zu bestimmen, ob Informationen selbst zuverlässig sind, fühlt sich ganz nach einer anderen Kategorie von Problemen an. Zumindest auf den ersten Blick.

Aber die Frage begann weniger abstrakt zu erscheinen, je mehr ich darauf achtete, wie künstliche Intelligenz heute tatsächlich genutzt wird. KI-Systeme schreiben jetzt Forschungsergebnisse, produzieren Marktanalysen, generieren Softwarecode und unterstützen sogar bei der rechtlichen Erstellung. Einige der Ergebnisse sind wirklich beeindruckend. Die Sprache fließt natürlich. Die Antworten klingen oft selbstbewusst.

Und dieses Vertrauen ist genau der Punkt, an dem die Unruhe beginnt.

Verbringt man genug Zeit mit diesen Systemen, beginnt man, die kleinen Inkonsistenzen zu bemerken. Eine Statistik erscheint, die niemand genau zurückverfolgen kann. Ein Zitat verweist auf eine Quelle, die nicht existiert. Ein Absatz liest sich überzeugend, beruht jedoch auf einem subtilen Missverständnis des zugrunde liegenden Materials.

Nichts Dramatisches. Aber auch nicht ganz solide.

KI produziert heute Informationen schneller, als wir sie bequem verifizieren können.

Das könnte nur eine vorübergehende Phase sein. Jede Generation von KI-Tools tendiert dazu, sich schnell zu verbessern, sobald Schwächen offensichtlich werden. Dennoch ist die Lücke zwischen der Generierung von Antworten und deren Bestätigung noch nicht verschwunden. In den meisten professionellen Umgebungen ist die Umgehung einfach: Menschen überprüfen die Arbeit.

Analysten überprüfen die Schlussfolgerungen. Ingenieure inspizieren den generierten Code. Forscher überprüfen die Referenzen.

Es funktioniert, obwohl es auch einschränkt, wie autonom diese Systeme werden können. Wenn jede Ausgabe ein zweites Paar menschlicher Augen erfordert, bleibt die Maschine ein Helfer und kein unabhängiger Akteur.

Schließlich führt diese Denkweise zu Systemen wie Mira.

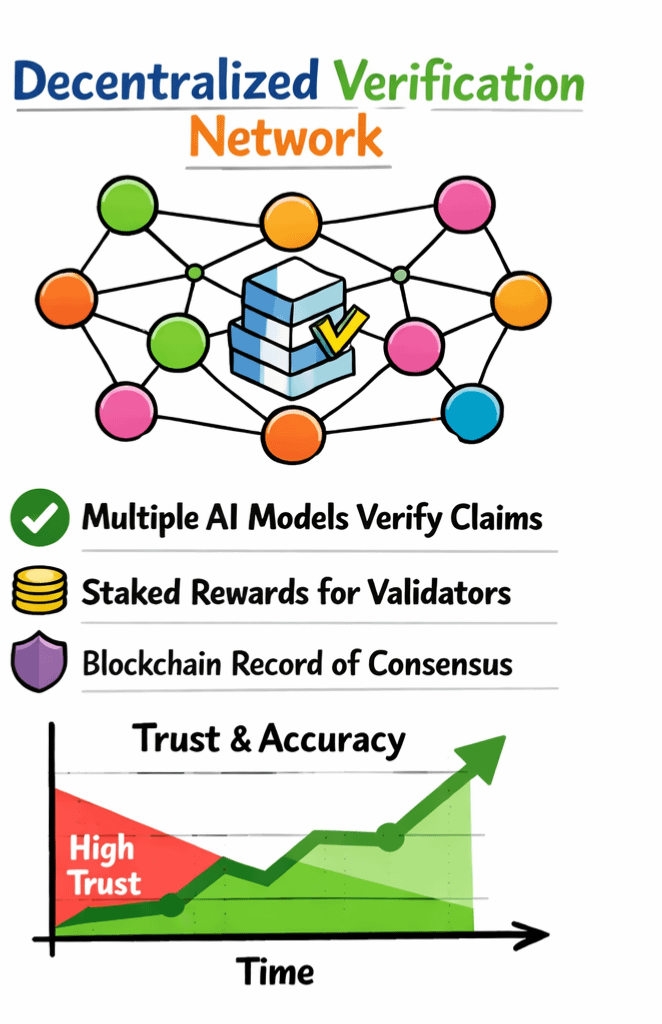

Der Mechanismus, wenn man ihn genau betrachtet, versucht nicht, ein fehlerfreies KI-Modell zu erstellen. Stattdessen behandelt das System die Verifizierung als einen gemeinsamen Prozess. Wenn eine KI eine Antwort generiert, kann die Ausgabe in kleinere Ansprüche unterteilt werden. Diese Ansprüche bewegen sich über ein Netzwerk, in dem andere Modelle sie unabhängig bewerten. Miras Ansatz setzt auf mehrere unabhängige Modelle, die dieselbe Aussage aus verschiedenen Richtungen untersuchen, bevor etwas akzeptiert wird.

Eine Übereinstimmung im Netzwerk wird zu einem Signal, dass der Anspruch wahrscheinlich zuverlässig ist.

Aber Übereinstimmung ist nicht dasselbe wie Wahrheit.

Blockchain in diesem Setup speichert nicht das Wissen selbst. Es verhält sich eher wie eine Koordinationsschicht. Das Ledger verfolgt, welche Teilnehmer welche Ansprüche bewerten, zeichnet die Ergebnisse auf und verteilt wirtschaftliche Belohnungen für die Beitragsverifizierung. Teilnehmer setzen Ressourcen ein, führen Bewertungsaufgaben aus, und das Netzwerk erstellt allmählich einen Bericht darüber, welche Ansprüche die Prüfung überstanden haben.

Angeblich verschiebt diese Struktur die Last des Vertrauens.

Anstatt anzunehmen, dass ein Modell immer richtig sein muss, scheint das System jede Antwort als etwas zu behandeln, das von anderen in Frage gestellt werden sollte, bevor es akzeptiert wird.

Konsens unter Modellen ist nicht automatisch gleich Wahrheit. Wenn viele Systeme auf ähnlichen Daten trainiert werden oder dieselben konzeptionellen blinden Flecken erben, können sie zu demselben fehlerhaften Schluss kommen. Verteilte Übereinstimmung kann die Genauigkeit verstärken, aber sie kann auch gemeinsame Fehler verstärken.

Verifizierungsschichten führen zu Reibungen. Entwickler, die schnelle KI-Pipelines bauen, zögern möglicherweise, zusätzliche Rechenlast hinzuzufügen, selbst wenn dies die Zuverlässigkeit verbessert. Geschwindigkeit hat in technologischen Systemen oft die Gewohnheit, Vorsicht zu übertreffen.

Die wirtschaftliche Seite von Netzwerken wie diesem ist ebenfalls schwieriger zu durchdenken. Verifizierung erfordert Teilnehmer, die bereit sind, Bewertungsmodelle auszuführen, Token zu setzen und kontinuierlich Ansprüche zu verarbeiten, die durch das System fließen. Anreize können das Verhalten eine Zeit lang ausrichten, insbesondere in frühen Krypto-Netzwerken, in denen die Teilnahme belohnt wird. Aber diese Anreizstrukturen können sich schnell ändern, wenn die Liquidität versiegt oder die Aufmerksamkeit woanders hingeht.

Frühe Infrastrukturnetzwerke sind oft empfindlich.

Dennoch ist die architektonische Idee schwer vollständig abzulehnen. Wenn KI-Systeme weiterhin in Bereiche wie finanzielle Entscheidungsfindung, automatisierte Forschung, Logistikkoordination oder autonome Dienstleistungen expandieren, könnte der echte Engpass nicht die Berechnung sein. Es könnte das Vertrauen in die Ausgaben dieser Systeme sein.

Ein Netzwerk, das darauf ausgelegt ist, maschinengenerierte Ansprüche zu überprüfen, könnte eine nützliche Schicht zwischen Erzeugung und Handlung werden.

Nützliche Ideen und weit verbreitete Systeme sind nicht immer dasselbe. Die Integration von Verifizierung in reale Arbeitsabläufe führt zu zusätzlichen Kosten, Koordinationskomplexität und neuen wirtschaftlichen Abhängigkeiten. Unternehmen priorisieren in der Regel Geschwindigkeit und Einfachheit vor Verifizierungsschichten.

Die echte Herausforderung für Systeme wie Mira könnte also nicht darin bestehen, ob die Architektur theoretisch funktioniert.

Es kann sein, dass die Welt bereit ist, die zusätzliche Komplexität zu tolerieren, die erforderlich ist, um maschinelles Wissen in großem Maßstab zu verifizieren.

Im Moment befindet sich die Idee irgendwo zwischen Experiment und Infrastruktur. Blockchain hat sich einst von einem Nischenexperiment in digitalem Geld zu einem breiteren Koordinationssystem für verteilte Netzwerke entwickelt.

Ob die Verifizierung von maschinengeneriertem Wissen die nächste Stufe dieser Entwicklung wird, ist noch ungewiss. Es könnte länger dauern, als die Menschen erwarten.

\u003cc-70/\u003e \u003ct-72/\u003e