Miras Idee für eine praktische Zukunft der offenen KI beginnt mit einer kleinen Peinlichkeit, die sie nicht zu verbergen versucht. Ein Jahr zuvor hatte ihr Team eine „offene“ Assistenzintegration veröffentlicht, die in einer Demo wunderbar funktionierte und dann in der Produktion merkwürdig verhielt. Nicht gefährlich, nicht skandalös. Nur inkonsistent. Die gleiche Frage, die zweimal gestellt wurde, kam mit zwei unterschiedlichen Vorsichtslevels zurück. Eine sichere Antwort wurde nach einer Leistungsanpassung zu einer riskanten. Als Kunden fragten, warum, konnte das Team nur auf einen Haufen möglicher Ursachen deuten – Eingabebearbeitungen, Abrufänderungen, ein Update des Anbieter-Endpunkts, das leise Abdriften von Daten.

Nach dieser Woche hörte Mira auf, Offenheit als Marke zu akzeptieren. Sie wollte, dass es eine Methode ist.

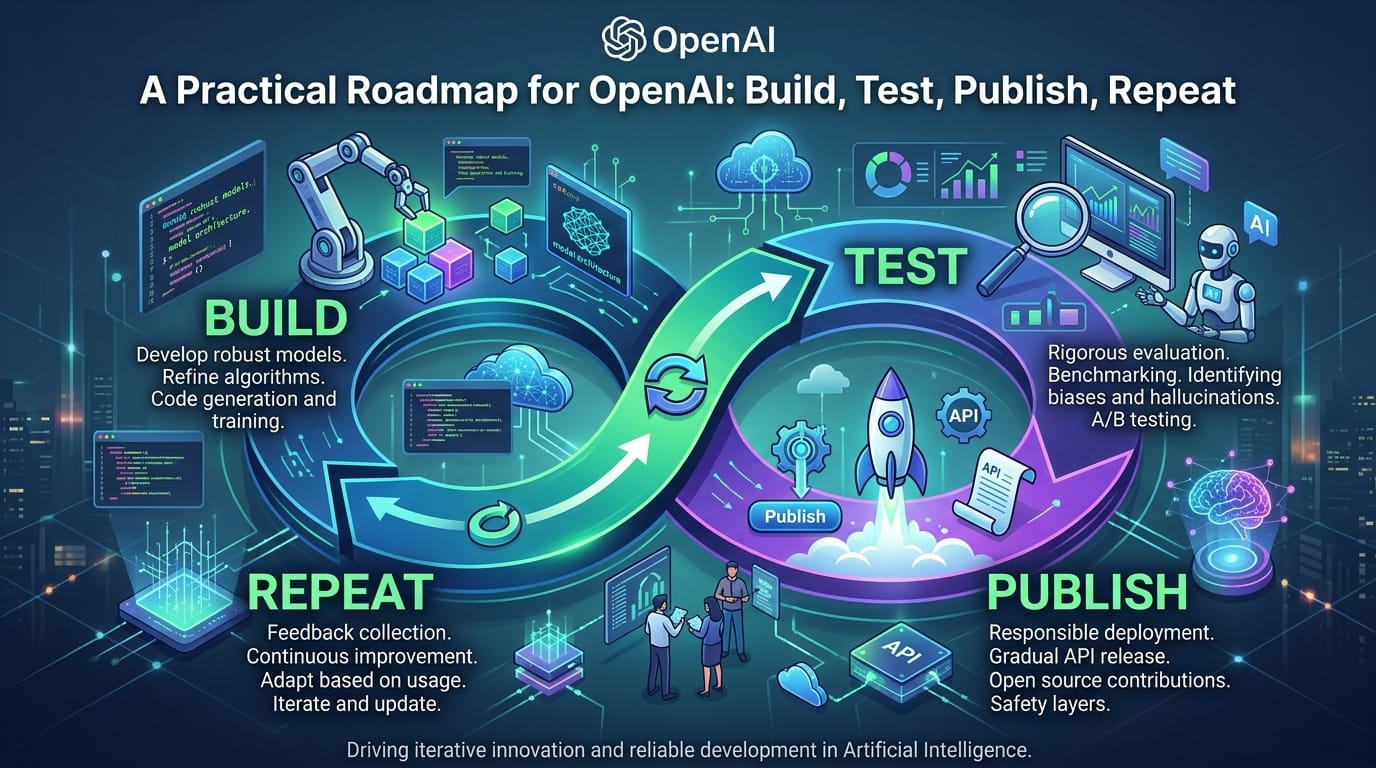

In ihrer Welt beginnt „bauen“, bevor das Modell jemals läuft. Es beginnt mit einem Repository, das geklont werden kann, einer Abhängigkeitsliste, die reproduziert werden kann, und einer Umgebungsdatei, die nicht durch Stammesgedächtnis zusammengehalten wird. Es beginnt mit einer Frage, die klar geschrieben ist: Was darf dieses System tun, und was darf es niemals tun, selbst wenn es unter Last steht? Diese Einschränkungen leben nicht in einem Präsentationsdeck. Sie leben als Tests und Leitplanken, die laut versagen, denn stille Fehler sind es, wie Systeme einen Ruf für Unzuverlässigkeit verdienen.

Bauen ist auch der Ort, an dem die ersten Kompromisse getroffen werden. Offene Systeme wollen schnell vorankommen, aber schnell zieht Abkürzungen an. Mira besteht darauf, dass Eingabeaufforderungen wie Code behandelt werden – versioniert, überprüft und an ein Release gebunden. Jemand kann immer noch um 2 Uhr morgens während eines Vorfalls einen Hotfix durchführen, aber der Hotfix muss ein Protokoll hinterlassen und muss ablaufen, es sei denn, er wird verlängert. Diese Ablauffrist klingt bürokratisch, bis du versucht hast, die „vorübergehende“ Änderung zu finden, die das Verhalten vier Monate lang geprägt hat.

Cion, der näher am Maschinenraum lebt als Mira, hilft, das Prinzip in etwas zu übersetzen, dem Ingenieure tatsächlich folgen werden. Er fügt eine Vor-Merge-Prüfung hinzu, die sich weigert zu deployen, es sei denn, eine Eingabeaufforderungsänderung verweist auf einen Evaluierungsdurchlauf. Nicht eine perfekte Evaluation. Eine echte, aufgezeichnete und wiederholbare, mit dem Commit-Hash angehängt. Es zwingt zu einer kurzen Pause, gerade lang genug, um die Leute dazu zu bringen, sich anzusehen, was sie tun.

Dann kommt „Test“, der in Miras Version der Punkt ist, an dem die meisten offenen KI-Projekte entweder reifen oder in Lärm zerfallen. Testen bedeutet nicht nur Genauigkeit bei einem Benchmark, der dein Modell schmeichelt. Es ist ein Rahmen, der die chaotischen Eingaben umfasst, die du tatsächlich sehen wirst: halb-fertige Kundenmeldungen, gescannte Dokumente mit OCR-Fehlern, Produktnamen, die wie Obszönitäten aussehen, Adressen, die falsche Schwärzungen auslösen, Grenzfälle, die wichtig sind, weil sie jemandem im schlechtesten Moment passieren. Es ist eine Suite, die nicht nur auf dem primären Modell läuft, sondern auch auf dem Fallback-Modell, das leise den Verkehr bedient, wenn die GPU-Warteschlangen ansteigen.

Mira hat einen Ordner mit dem Titel „Schlechte Tage“. Ein Ticket, bei dem der Assistent fälschlicherweise vorgeschlagen hat, die Identitätsüberprüfung zu umgehen. Einmal erfand es eine Richtlinie, die nicht existierte. Ein Moment, in dem es ein internes Tag an einen Kunden zurückgab. Das sind keine abstrakten Risiken. Das sind Dinge, die passiert sind. Die Tests sind ein Versprechen an ihr zukünftiges Ich, dass sie nicht wieder auf die gleiche Weise passieren, ohne dass der Build fehlschlägt.

Sie testet auch das Verhalten unter Stress, denn dann zeigen Systeme, was sie wirklich sind. Wenn die Abfrage zeitlich ausläuft, gibt der Assistent dann Unsicherheit zu oder improvisiert er? Wenn die Schwärzung fehlschlägt, schlägt sie dann geschlossen fehl und gibt nichts zurück, oder schlägt sie offen fehl und leakt? Wenn das System zu einem kleineren Modell wechselt, ändert sich der Ton auf eine Weise, die ein Benutzer spüren kann? Die Testsuite eliminiert diese Kompromisse nicht. Sie macht sie sichtbar und messbar.

„Veröffentlichen“ ist der Schritt, der Miras Ansatz vom gängigen Muster der offenen KI als einmaligem Dump trennt. Veröffentlichen bedeutet für sie nicht nur, Code in ein öffentliches Repository zu pushen und es Transparenz zu nennen. Es bedeutet, die Beweise zu paketieren, dass das System von jemandem verstanden werden kann, der es nicht gebaut hat.

Das bedeutet, dass ein Release die Artefakte umfasst, die die Leute vermeiden, weil sie mühsam sind: eine Modellkarte, die in groben Zügen angibt, welche Daten verwendet wurden und welche Daten ausdrücklich ausgeschlossen wurden; ein Änderungsprotokoll, das nicht nur Funktionen auflistet, sondern auch Verhaltensänderungen; eine Reihe von Bewertungsergebnissen mit genügend Kontext, dass eine dritte Partei sie reproduzieren kann; eine Beschreibung der Fehlermodi, die das Team beobachtet hat, nicht nur der Erfolge, auf die sie stolz sind. Wenn es einen Sicherheitsvorfall gab, ist eine sanitärisierte Nachbesprechung Teil der Geschichte. Keine Beichte. Ein Protokoll.

Miras Team veröffentlicht auch die operativen Knöpfe, denn offene Infrastruktur, die nicht betrieben werden kann, ist nur ein Hobbyprojekt mit guter Dokumentation. Sie veröffentlichen Standardlimits, Timeout-Einstellungen und die Gründe dafür. Sie veröffentlichen Richtlinien für Logging, die Rückverfolgbarkeit mit Datenschutz in Einklang bringen, einschließlich dessen, was niemals im Klartext protokolliert werden sollte. Sie veröffentlichen Erwartungen an die Schlüsselrotation und Zugriffsmuster, denn offene Systeme scheitern am häufigsten aufgrund vernachlässigter Berechtigungen und veralteter Geheimnisse, nicht aufgrund mangelnder cleverer Modellierung.

Diese Art des Veröffentlichens macht einige Menschen nervös. Das sollte es auch. Wenn du beschreibst, wie dein System funktioniert, beschreibst du auch, wie es missbraucht werden kann. Miras Antwort ist nicht, sich in Geheimhaltung zurückzuziehen. Es ist, Offenlegung als Ingenieurdiziplin zu behandeln. Sensible Details werden zurückgehalten. Angriffsflächen werden anerkannt. Milderungen werden dokumentiert. Wenn eine Schwachstelle gefunden wird, verschickt das Team einen Fix, veröffentlicht einen Hinweis und schreibt auf, was sie gelernt haben, ohne vorzugeben, dass sie es kommen sahen.

Dann kommt „wiederholen“, der am wenigsten romantische und wichtigste Teil. Offene KI ist nicht stabil, weil ein Modell stabil ist. Sie ist stabil, weil die Schleife stabil ist. Bauen, testen, veröffentlichen, wiederholen. Die Schleife ist das, was verhindert, dass Abweichungen zu einem Rätsel werden.

Wiederholen bedeutet, mit den Kosten zu leben. Die Speicherkosten steigen, weil du Spuren und Datensätze lange genug aufbewahrst, um Fehler zu beheben. Releases verlangsamen sich, weil die Überprüfungen unbequeme Fragen aufwerfen. Ingenieure beklagen Reibung, insbesondere wenn Konkurrenten schneller ausliefern. Mira weist das nicht zurück. Sie benennt es. Die Spannung zwischen Geschwindigkeit und Nachweis geht niemals weg. Du verwaltest es, indem du Reibung dort platzierst, wo es am günstigsten ist: vor der Produktion, vor der Skalierung, bevor das Vertrauen eines Kunden zu dem wird, was du ausgibst.

Die Schleife erzwingt auch Demut. Manchmal zeigen die veröffentlichten Bewertungen einen Rückgang, und das Team muss das zugeben. Manchmal führt eine Änderung, die die Genauigkeit verbessert, zu schädlichem Vertrauen. Manchmal reduziert ein Sicherheitsfilter das Risiko, macht das Tool jedoch weniger nützlich, und die Benutzerbasis umgeht es. „Wiederholen“ bedeutet, dass du keine dieser Ergebnisse als persönliches Versagen betrachtest. Du betrachtest sie als die Kosten für den Aufbau von Systemen, die mit Menschen und der Welt interagieren.

Miras praktische Zukunft für offene KI ist nicht utopisch. Sie geht nicht von gutem Glauben oder perfekten Anreizen aus. Sie geht davon aus, dass Systeme unter Druck gepatcht werden, dass Anbieter ihre APIs ändern, dass Entwickler Fehler machen, dass Benutzer überraschende Dinge tun, dass Regulierungsbehörden schwierige Fragen stellen und dass jemand letztendlich eine Erklärung benötigt, die nicht improvisiert werden kann.

Also baut sie eine Zukunft, in der Erklärungen Teil des Produkts sind. Nicht in Form von Slogans, sondern in Form von Quittungen: versionierte Eingabeaufforderungen, reproduzierbare Builds, gemessenes Verhalten, veröffentlichte Fehler und eine Schleife, die sich weiter dreht, selbst wenn niemand zusieht. So sieht „offen“ aus, wenn es erwachsen ist. Es ist keine Enthüllung. Es ist eine Praxis.