Künstliche Intelligenz bewegt sich schnell. Schneller als die meisten Menschen erwartet haben.

KI schreibt Code, entwirft Verträge, analysiert Finanzmärkte und hilft sogar bei medizinischen Diagnosen. Aber es gibt ein stilles Problem unter diesem technologischen Boom:

KI ist mächtig – aber nicht immer zuverlässig.

Große Sprachmodelle können halluzinieren. Bildgeneratoren können Daten fabrizieren. Autonome Agenten können Entscheidungen auf der Grundlage fehlerhafter Annahmen treffen. In risikobehafteten Umfeldern wie Finanzen, Gesundheitswesen und Regierungsführung ist „wahrscheinlich richtig“ nicht gut genug.

Hier entsteht eine neue Kategorie von Infrastruktur – KI-Überprüfungsschichten.

Eines der interessantesten Projekte, das diese Schicht aufbaut, ist MIRA von Mira Network, das versucht, eines der größten ungelösten Probleme in der KI-Wirtschaft zu lösen:

Wie beweisen wir, dass KI-Ausgaben tatsächlich korrekt sind?

Die Vertrauenslücke in der KI

Das heutige KI-Ökosystem hat eine strukturelle Schwäche.

Die meisten KI-Systeme funktionieren wie Black Boxes. Ein Benutzer gibt einen Prompt ein, das Modell produziert eine Antwort, und das System geht einfach davon aus, dass sie gültig ist.

Aber je tiefer KI in die Gesellschaft integriert wird, desto gefährlicher wird diese Annahme.

Stellen Sie sich drei Szenarien vor.

Szenario 1: Finanz-KI

Ein Handelsagent empfiehlt eine Portfolioallokation basierend auf Marktanalysen.

Wenn seine Argumentation einen Fehler enthält, könnten Millionen von Dollar falsch zugewiesen werden.

Szenario 2: Gesundheits-KI

Ein KI-Assistent schlägt eine Medikamentendosierung basierend auf Patientendaten vor.

Wenn das Modell eine Richtlinie halluziniert, könnten die Folgen katastrophal sein.

Szenario 3: Autonome KI-Agenten

Ein KI-Agent führt automatisch Blockchain-Transaktionen über Smart Contracts durch.

Eine fehlerhafte Ausgabe könnte irreversible On-Chain-Aktionen auslösen.

Das Problem ist nicht, dass KI nutzlos ist.

Das Problem ist, dass KI weiterhin Vertrauen benötigt.

Und Vertrauen skaliert nicht.

Die Kernidee von Mira Network: Überprüfbare Intelligenz

Mira Network führt einen radikalen Wandel in der Funktionsweise von KI-Systemen ein.

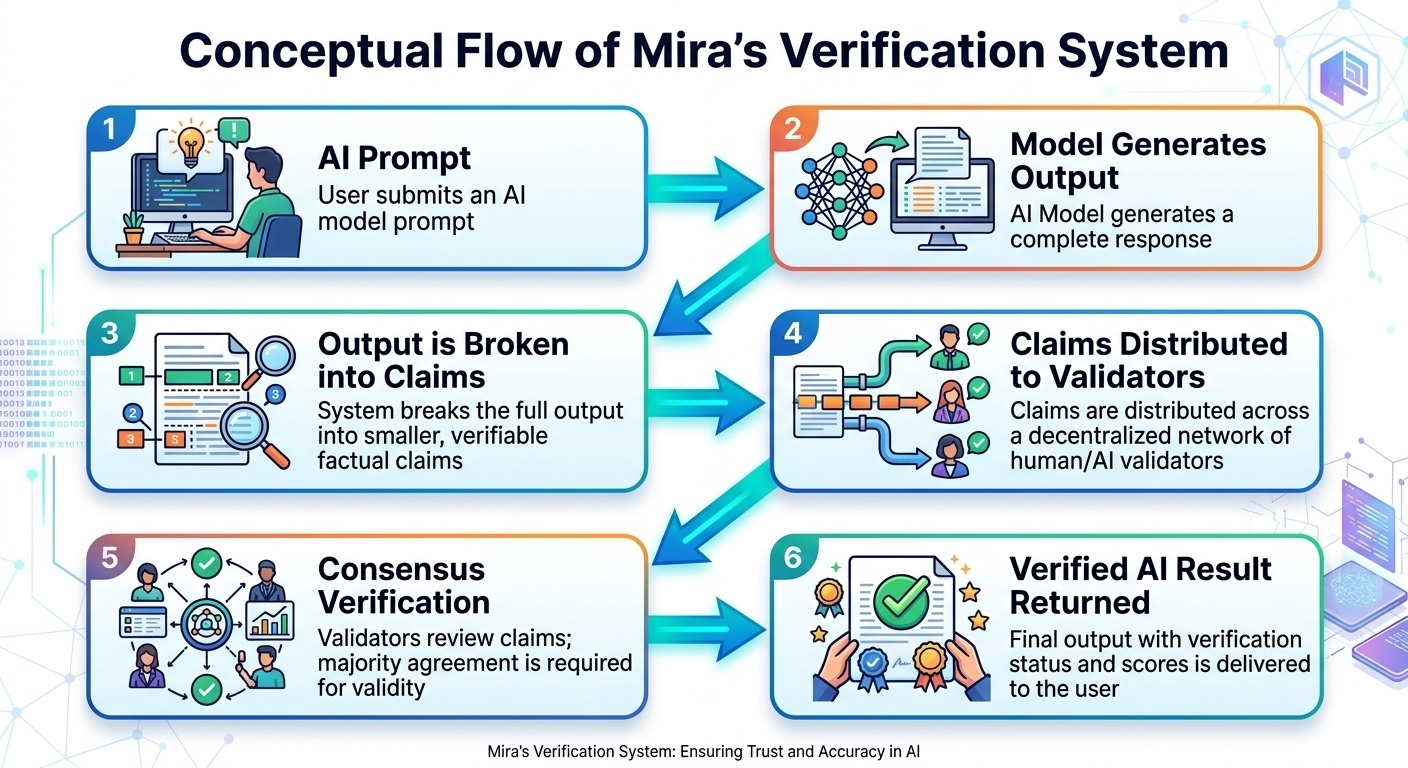

Anstatt einem einzelnen Modell zu vertrauen, zerlegt Mira jede KI-Antwort in strukturierte Ansprüche und überprüft sie durch ein verteiltes Netzwerk von Validatoren.

Dies schafft etwas Neues im KI-Stack:

Eine kryptografische Überprüfungsschicht für KI-Ausgaben.

Die Idee ist einfach, aber mächtig:

Wenn Blockchain finanzielle Transaktionen ohne Vertrauen überprüfen kann,

warum kann ein Netzwerk KI-Ergebnisse nicht auf die gleiche Weise überprüfen?

Wie Mira tatsächlich KI überprüft

Auf technischer Ebene verwandelt Mira KI-Antworten in überprüfbare Ansprüche.

Diese Ansprüche werden dann von unabhängigen Validatoren im Netzwerk bewertet.

Anstatt einem Modell zu vertrauen, bestätigen mehrere Modelle und Knoten unabhängig, ob das Ergebnis gültig ist.

Dies reduziert dramatisch Halluzinationen und Vorurteile, da jede Behauptung die verteilte Überprüfung überstehen muss.

Konzeptioneller Fluss von Miras Überprüfungssystem

Dieser Mechanismus ähnelt der Art und Weise, wie Blockchains Transaktionen validieren – außer, dass hier das Netzwerk Wissen statt finanzieller Transfers validiert.

Das Netzwerk funktioniert bereits in großem Maßstab

Diese Idee ist nicht theoretisch.

Das Mira-Ökosystem ist bereits schnell gewachsen:

• Über 2,5 Millionen Nutzer

• Rund 2 Milliarden Tokens täglich über Anwendungen verarbeitet

• Millionen von KI-Anfragen jede Woche überprüft

Um das ins rechte Licht zu rücken:

Die Verarbeitung von Milliarden von Tokens pro Tag entspricht der Analyse riesiger Mengen von Text, Bildern und Medien – vergleichbar mit großen Teilen des Informationsflusses im Internet.

Dies zeigt, dass die Nachfrage nach vertrauenswürdiger KI-Infrastruktur real ist.

Wesentliche Produktmerkmale, die Mira definieren

1. Anspruchsüberprüfung

Traditionelle KI-Systeme liefern eine Antwort.

Mira wandelt Antworten in überprüfbare atomare Ansprüche um, sodass das Netzwerk jedes Stück einzeln überprüfen kann.

Dies erhöht dramatisch die Zuverlässigkeit.

2. Verteilte KI-Konsens

Mehrere Validatoren überprüfen Ausgaben anstatt sich auf ein einzelnes Modell zu verlassen.

Dies reduziert:

• Halluzinationen

• Modellvorurteile

• Manipulationsrisiko

Das Ergebnis ist konsensvalidierte Intelligenz.

3. Entwickler-APIs für überprüfte KI

Mira bietet eine Suite von APIs, einschließlich:

• Erzeugen

• Überprüfen

• Überprüft Erzeugen

Diese Tools ermöglichen es Entwicklern, überprüfte KI direkt in ihre Anwendungen zu integrieren.

In einfachen Worten:

Entwickler können KI-Produkte erstellen, bei denen Vertrauen in die Architektur eingebaut ist.

4. Wirtschaftliche Sicherheit durch $MIRA

Der native Token MIRA treibt die Überprüfungswirtschaft an.

Teilnehmer können:

• Tokens einsetzen, um Validatoren zu werden

• Belohnungen für genaue Überprüfung verdienen

• An Governance-Entscheidungen teilnehmen

Dies stimmt die Anreize so ab, dass das Netzwerk Korrektheit belohnt.

Warum das für die Zukunft der KI wichtig ist

Die KI-Industrie betritt eine neue Phase.

Die erste Phase drehte sich um die Fähigkeit.

Die zweite Phase dreht sich um die Zuverlässigkeit.

Ohne Überprüfung wird KI in sensiblen Sektoren wie diesen eingeschränkt bleiben:

• Finanzen

• Gesundheitswesen

• Gesetz

• autonome Systeme

Miras Vision ist es, die Vertrauensschicht für KI zu werden, die es Maschinen ermöglicht, autonom ohne menschliche Aufsicht zu operieren und dabei überprüfbare Korrektheit aufrechtzuerhalten.

Mit anderen Worten:

KI wird nicht global skalieren, bis das Vertrauen mit ihr skaliert.

Die größere Erzählung: Crypto + KI-Infrastruktur

Die aufregendsten Krypto-Projekte heute sind nicht nur Währungen.

Sie sind Infrastrukturschichten.

Beispiele sind:

• Rechen-Netzwerke

• Datenmärkte

• dezentrale GPU-Clouds

• KI-Überprüfungssysteme

Mira fügt sich direkt in diesen neuen Stack ein.

Genau wie Blockchains finanzielle Wahrheit überprüften,

zielt Mira darauf ab, informative Wahrheit zu überprüfen.

Wenn erfolgreich, könnte es eine grundlegende Schicht für die nächste Generation autonomer KI-Systeme werden.

Ein Gedankenexperiment

Stellen Sie sich eine KI-Wirtschaft vor, in der:

• KI-Agenten handeln mit Vermögenswerten

• autonome Systeme verwalten Lieferketten

• KI-Forscher generieren neue wissenschaftliche Hypothesen

Stellen Sie sich vor, dass jede KI-Ausgabe in diesem System kryptografisch überprüft wird, bevor sie als vertrauenswürdig gilt.

Das ist die Zukunft, die Mira zu schaffen versucht.

Und wenn die KI-Wirtschaft so groß wird, wie viele erwarten, könnte die Überprüfungsschicht eines ihrer wertvollsten Komponenten werden.

Letzter Gedanke

Die größte Frage in der KI ist nicht länger:

„Was kann KI tun?“

Die eigentliche Frage ist:

„Wie wissen wir, wann KI richtig ist?“

Mira Network versucht, diese Frage mit Kryptographie, verteiltem Konsens und wirtschaftlichen Anreizen zu beantworten.

Wenn KI das Gehirn der digitalen Welt wird,

könnten Überprüfungsnetzwerke wie Mira zu ihrem Immunsystem werden.

💬 Diskussion für die Gemeinschaft

Wenn KI-Agenten Finanztransaktionen durchführen, Verträge schreiben oder medizinische Empfehlungen aussprechen – sollten ihre Ergebnisse immer eine dezentrale Überprüfung erfordern? Oder werden zentrale KI-Unternehmen die vertrauenswürdige Autorität bleiben?

@Mira - Trust Layer of AI #Mira #mira $MIRA