Was wäre, wenn Sie Ihren eigenen KI-Assistenten erstellen könnten, der auf Ihrem Rechner läuft, sich mit Telegram verbindet und bei der Krypto-Forschung, der Erstellung von Inhalten und der Unterstützung der Gemeinschaft hilft?

Das ist genau das, was ich mit OpenClaw getestet habe.

Anstatt KI nur über eine normale Chat-App zu verwenden, wollte ich etwas Nützlicheres schaffen: einen echten Assistenten, der in seiner eigenen Umgebung leben, organisiert bleiben und schließlich zu einem ernsthaften Workflow-Tool für Binance Square-Inhalte, Krypto-Ausbildung und Automatisierung heranwachsen könnte.

In diesem Leitfaden werde ich Ihnen zeigen:

• was OpenClaw ist

• warum ich ein VMware-Ubuntu-Setup gewählt habe

• der Unterschied zwischen lokaler Maschine, VM und VPS

• und die genauen Schritte, die ich verwendet habe, um einen Live-Telegram-KI-Bot zum Laufen zu bringen

Wenn Sie vom KI-Nutzer zum KI-Builder wechseln möchten, ist dies ein großartiger Ort, um zu beginnen.

Was ist OpenClaw?

OpenClaw ist ein KI-Assistenten-Rahmen, der Ihnen hilft, Ihren eigenen Assistenten zu erstellen und ihn mit echten Tools, Workflows und Chatkanälen zu verbinden.

Anstatt nur mit KI zu chatten, ermöglicht OpenClaw, etwas Strukturierteres zu erstellen, wie:

• ein Telegram-KI-Bot

• ein Discord-Assistent

• ein Krypto-Forschungscopilot

• ein Content-Workflow-Assistent

• ein Community-Support-Bot

• ein zukünftiger, fähigkeitsgestützter Binance-Assistent

Was OpenClaw interessant macht, ist, dass es nicht nur um Antworten geht. Es geht darum, eine echte Assistenten-Umgebung aufzubauen, die Sie kontrollieren.

Anwendungsfälle für OpenClaw

Hier sind einige praktische Beispiele:

• Krypto-Bildungsassistent

Erklären Sie Bitcoin, Wallets, Binance-Produkte, Risikomanagement und Lernpfade für Anfänger.

• Content-Assistent

Entwerfen Sie Binance Square-Beiträge, Telegram-Inhalte, Bildungsstränge und Kampagnenideen.

• Community-Copilot

Helfen Sie dabei, Fragen zu beantworten, Benutzer einzuarbeiten und Krypto-Communities zu unterstützen.

• Forschungs-Workflow-Tool

Ideen sammeln, Notizen organisieren und Forschung in nützliche Ergebnisse umwandeln.

Für Kreatoren und Betreiber kann OpenClaw Teil eines echten Workflowsystems werden.

Lokale Maschine vs VM vs VPS

Vor dem Aufbau hatte ich eine wichtige Frage:

Wo sollte ich meinen Assistenten betreiben?

1) Lokale Maschine

Das bedeutet, OpenClaw direkt auf Ihrem Laptop oder Desktop-Benutzerkonto zu installieren.

Am besten für:

• schnelles Testen

• Lernen

• einfache Experimente

Vorteile:

• einfach zu starten

• keine zusätzlichen Kosten

• gut für schnelle Entwicklungen

Nachteile:

• stoppt, wenn Ihr Computer in den Schlafmodus wechselt oder heruntergefahren wird

• weniger sauber, wenn es mit Ihrer täglichen Umgebung gemischt ist

2) VMware / Virtuelle Maschine

Das bedeutet, eine dedizierte Ubuntu-Umgebung auf Ihrem Computer zu erstellen.

Am besten für:

• sauberere lokale Entwicklung

• sichereres Testen

• Lernen eines serverähnlichen Workflows

Vorteile:

• isoliertes Setup

• einfacher zu organisieren

• näher an einer echten Bereitstellungsumgebung

• großartig für Snapshots und Rollbacks

Nachteile:

• hängt immer noch davon ab, dass Ihr Computer eingeschaltet ist

• verwendet mehr Systemressourcen als eine direkte lokale Installation

3) VPS

Ein VPS ist am besten, wenn Sie möchten, dass Ihr Assistent die ganze Zeit online ist.

Am besten für:

• Produktionsbots

• 24/7 Automatisierung

• langfristige öffentliche Nutzung

Vorteile:

• immer online

• stabil

• später einfacher zu skalieren

Nachteile:

• monatliche Kosten

• mehr Wartungs- und Sicherheitsarbeit

Meine Empfehlung

Der klügste Weg für die meisten Menschen ist:

Lokal oder in einer VM starten → die Einrichtung lernen → später zu VPS wechseln

Deshalb habe ich zuerst Ubuntu Server in VMware verwendet. Es gab mir eine saubere Umgebung, ohne sofort in das vollständige Produktionshosting zu gehen.

👉Mein Build-Setup👀

Hier ist die Konfiguration, die ich verwendet habe:

• Host-Maschine: Windows

• Virtualisierung: VMware

• Gast-OS: Ubuntu Server 24.04

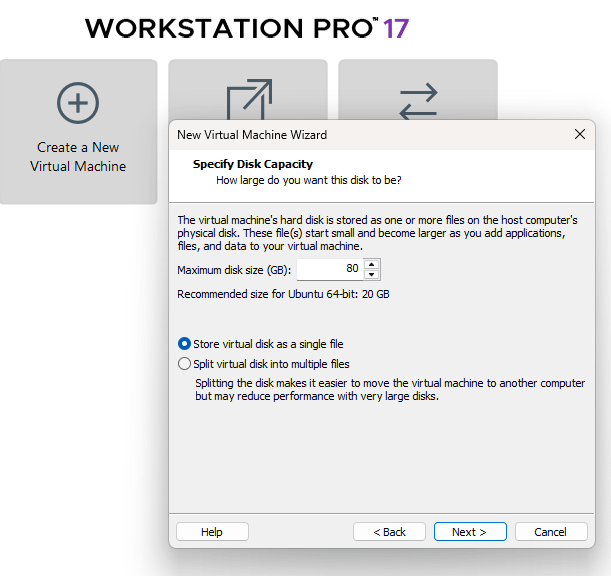

• VM-Spezifikation: 4 vCPU, 8 GB RAM, 80 GB Festplatte

• Netzwerk: bridged

• Ziel: OpenClaw + Telegram-Bot

• Anwendungsfall: eine echte KI-Assistenten-Umgebung für zukünftige Krypto-Bildung und Content-Workflows erstellen

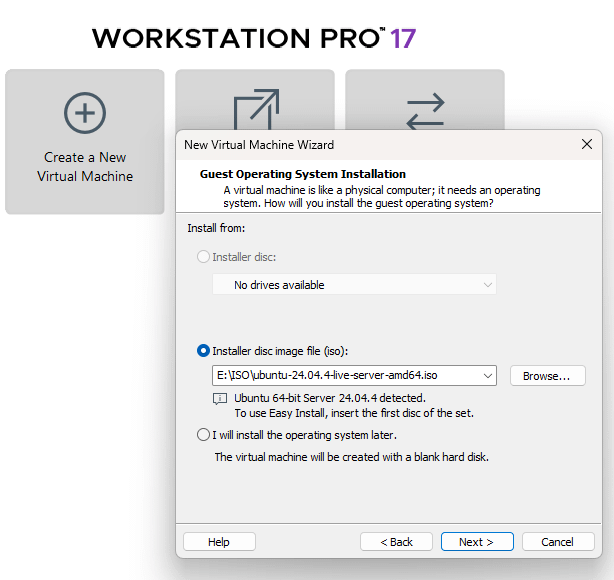

Schritt 1: Ubuntu Server in VMware installieren

Ich habe eine neue VM mit:

• 4 Kerne

• 8 GB RAM

• 80 GB Festplatte

• Ubuntu Server 24.04

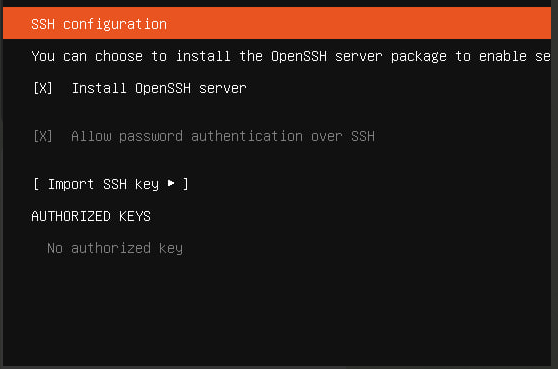

Während der Installation wählte ich:

• Verwenden Sie die gesamte Festplatte

• LVM aktiviert

• OpenSSH-Server aktiviert

• optionale Paketbündel übersprungen

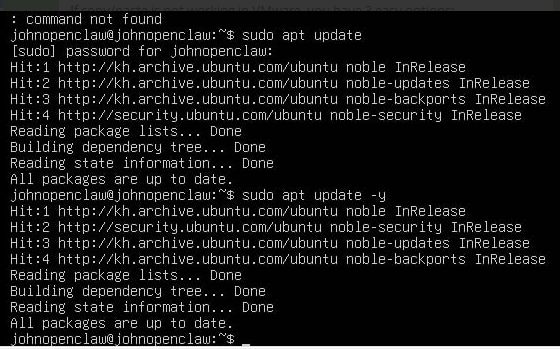

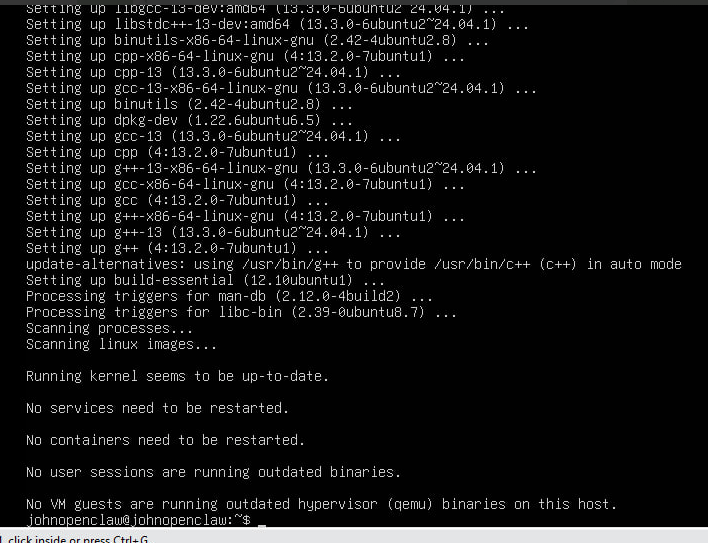

Schritt 2: Aktualisieren Sie das System

Nachdem ich mich bei Ubuntu angemeldet hatte, aktualisierte ich die Pakete:

sudo apt update

sudo apt upgrade -y

sudo apt install -y curl git build-essential tmux

Das bereitet die VM für den Rest der Einrichtung vor.

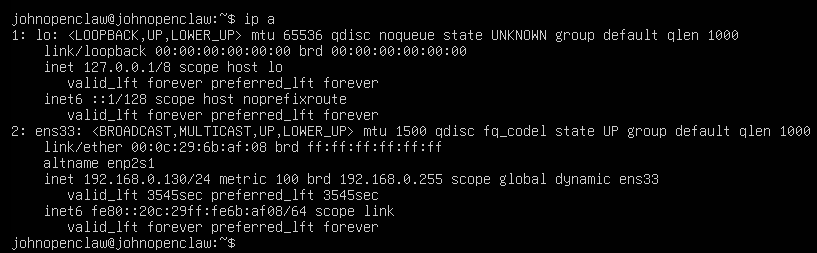

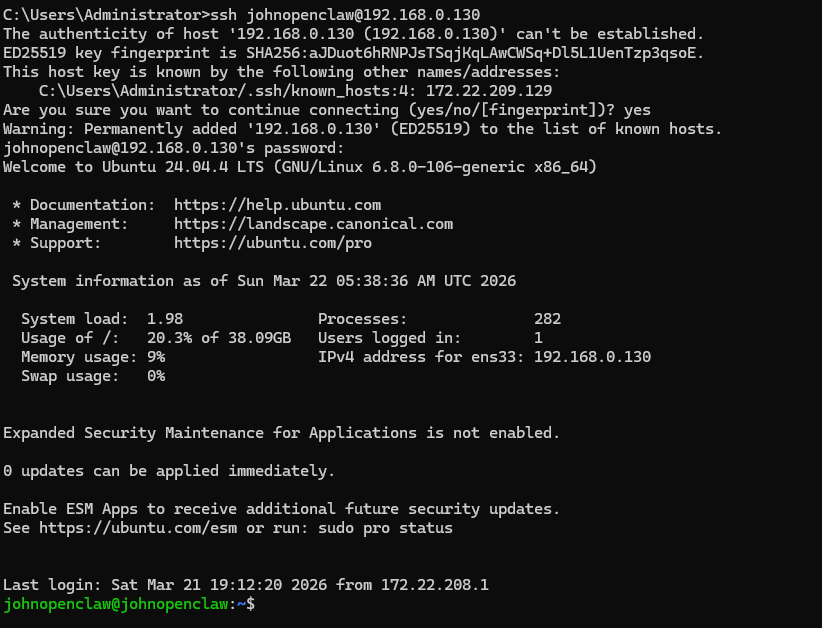

Schritt 3: Mit SSH von Windows verbinden

Direkt in der VMware-Konsole zu tippen war unpraktisch, also wechselte ich zu SSH von Windows.

Zuerst fand ich die VM-IP:

ip a

Dann von Windows PowerShell:

ssh IhrBenutzername@IHRE-VM-IP

Das machte Copy/Paste viel einfacher und verbesserte sofort den Workflow.

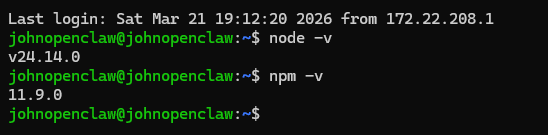

Schritt 4: Installieren Sie Node.js mit nvm

Dann installierte ich nvm und verwendete es, um Node 24 zu installieren:

curl -o- https://raw.githubusercontent.com/nvm-sh/nvm/v0.40.3/install.sh | bash

source ~/.bashrc

nvm install 24

nvm use 24

nvm alias default 24

node -v

npm -v

Sobald Node und npm funktionierten, war die Umgebung bereit für OpenClaw.

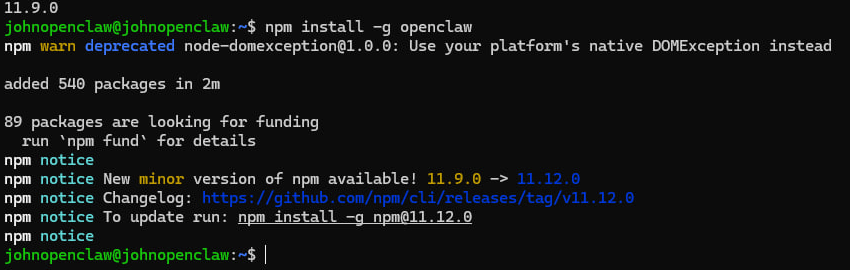

Schritt 5: OpenClaw installieren

Als nächstes installierte ich OpenClaw global:

npm install -g openclaw

Dann überprüfte ich es:

openclaw --help

openclaw status

An diesem Punkt war OpenClaw installiert, aber das Gateway war noch nicht vollständig konfiguriert.

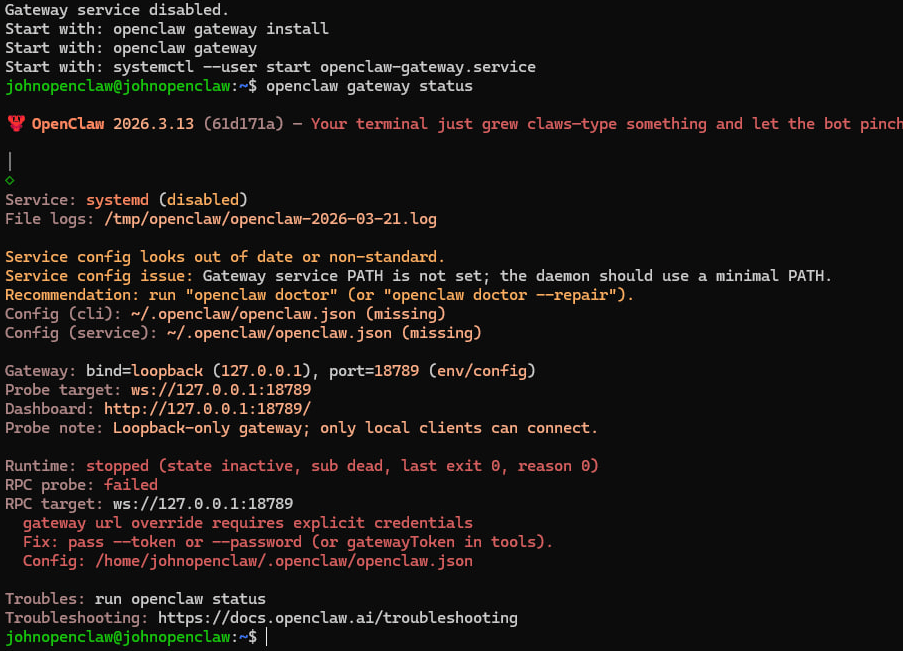

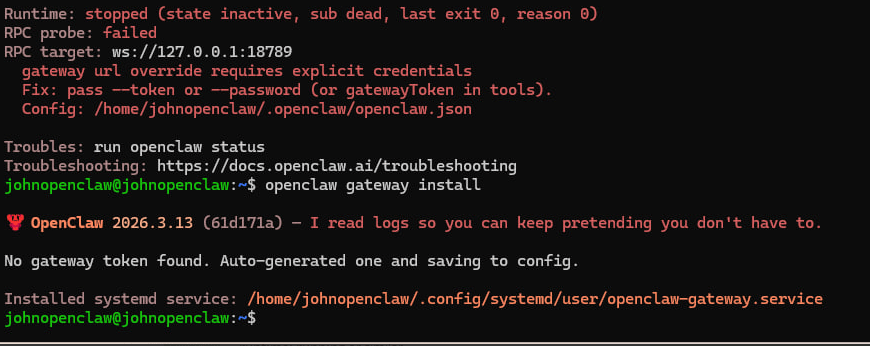

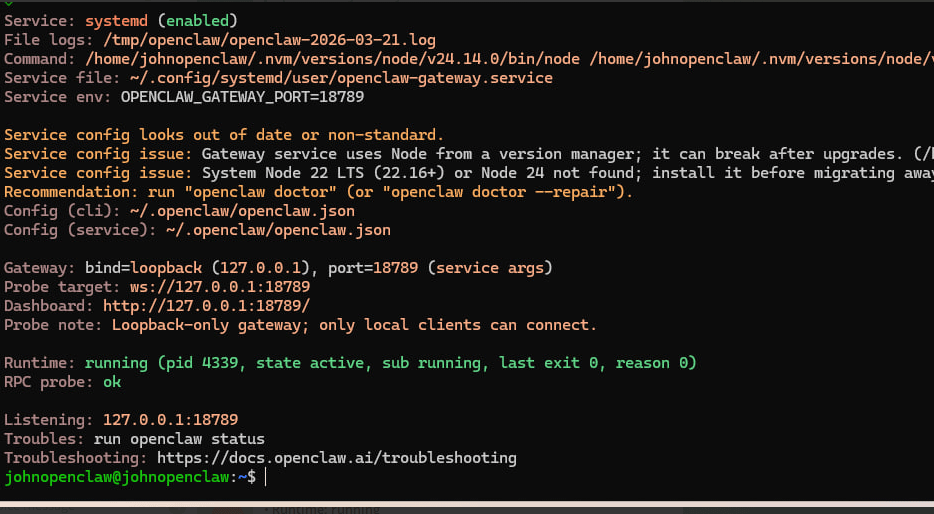

Schritt 6: Gateway installieren und starten

Um den Dienst zum Laufen zu bringen:

openclaw gateway installieren

openclaw gateway starten

openclaw gateway status

Zuerst hatte ich ein Problem: Der Gateway-Dienst existierte, jedoch hörte der tatsächliche Gateway-Prozess nicht korrekt.

Also überprüfte ich die Protokolle und fand die Ursache.

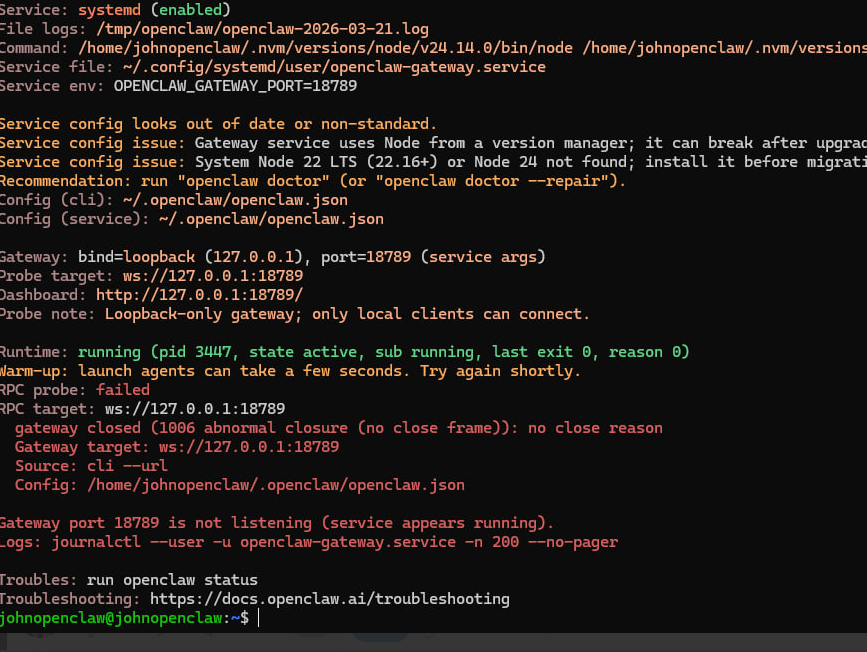

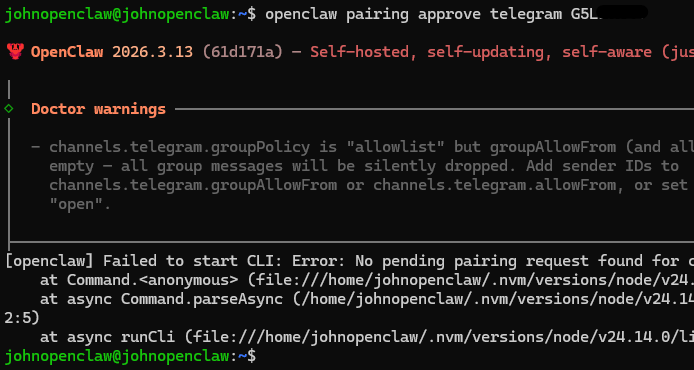

Schritt 7: Beheben Sie das Gateway-Problem

Das Hauptproblem war:

Gateway-Start blockiert: gateway.mode=local setzen

Also habe ich es mit folgender Lösung behoben:

openclaw config set gateway.mode local

openclaw gateway neu starten

openclaw gateway status

Danach war das Gateway gesund und hörte korrekt.

Das war der Wendepunkt. Sobald das Gateway live war, wurde die Assistenten-Umgebung real.

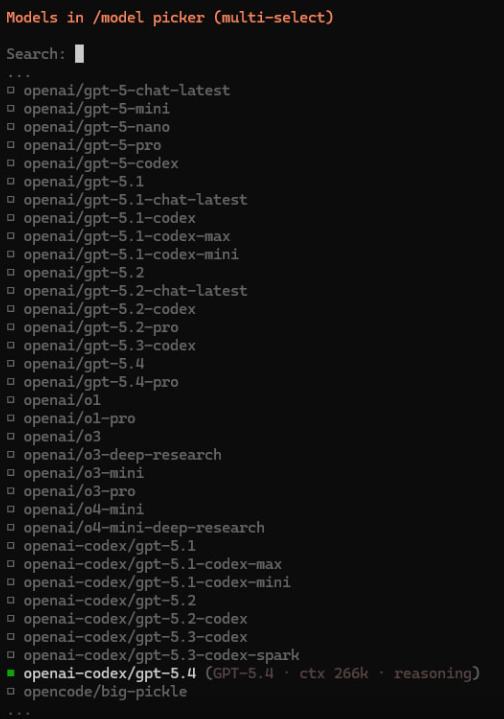

Schritt 8: Modell und Kanäle konfigurieren

Dann führte ich aus:

openclaw konfigurieren

Innerhalb des Setups konfiguriert ich:

• der Arbeitsbereich

• das Modell

• der Telegram-Kanal

Für das Modell wählte ich:

• openai-codex/gpt-5.4

Für Telegram verwendete ich ein Bot-Token, das über @BotFather erstellt wurde.

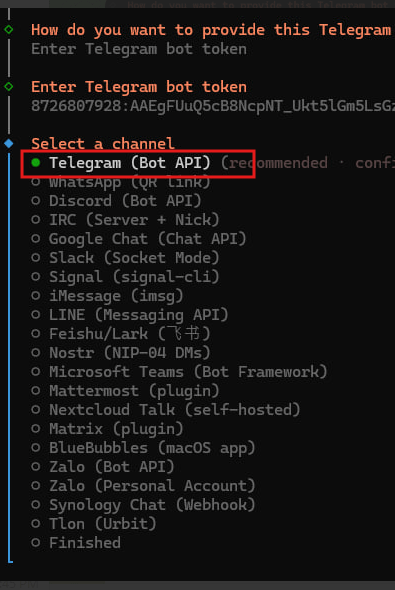

Schritt 9: Erstellen und verbinden Sie den Telegram-Bot

Um Telegram zu konfigurieren, erstellte ich zuerst einen Bot mit @BotFather und kopierte das Token.

Innerhalb des OpenClaw-Setups wählte ich:

• Kanäle

• Konfigurieren/verbinden

• Telegram (Bot-API)

• Geben Sie das Telegram-Bot-Token ein

Nach dem Speichern dieser Konfiguration war der Bot bereit zur Paarung.

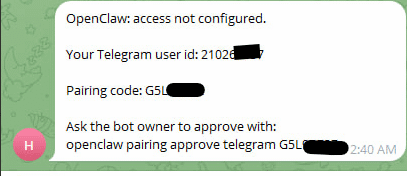

Schritt 10: Telegram-Konto paaren

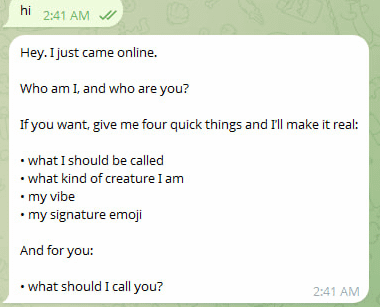

Als ich eine Nachricht an den Bot sendete, gab mir OpenClaw einen Paarungscode. Dann genehmigte ich es in der VM:

openclaw pairing approve telegram IHRECODE

Danach habe ich eine weitere Nachricht in Telegram gesendet, und der Bot antwortete erfolgreich.

Das war der echte „es funktioniert“-Moment.

😍Das Ergebnis😎

Ich testete den Bot erneut von einem anderen Netzwerk, und er funktionierte immer noch perfekt.

Das bewies etwas Wichtiges:

Das war nicht mehr nur ein lokales Experiment.

Es war jetzt eine echte funktionierende KI-Assistenten-Setup.

Und das öffnet die Tür für viel größere Anwendungsfälle:

• Krypto-Bildungsbot

• Binance Square Content-Assistent

• Telegram-Community-Helfer

• Forschungs-Copilot

• Workflow-Automatisierungstool

Warum ist das wichtig für Kreatoren

Für Kreatoren ist der Wert nicht nur "KI zu haben."

Der wahre Wert besteht darin, ein System zu bauen, das Ihnen hilft:

• schneller bewegen

• konsequent bleiben

• Ideen organisieren

• intelligenter antworten

• Forschung in Inhalte umwandeln

• Unterstützen Sie Ihr Publikum auf verschiedenen Plattformen

Ein Setup wie dieses kann sich entwickeln zu:

• ein Binance-Lernassistent

• ein Content-Drafting-Copilot

• ein Community-Betriebsassistent

• ein Krypto-Workflow-System

Deshalb denke ich, dass dies wichtig ist: Sobald Sie sehen, dass Ihr eigener KI-Assistent live funktioniert, ändert sich Ihre Denkweise vom Verbraucher zum Builder.

Lektionen, die ich gelernt habe

Einige praktische Lektionen aus diesem Build:

• VMware ist ein großartiges lokales Labor

• SSH macht die Einrichtung viel einfacher

• Die Installation von OpenClaw ist unkompliziert

• die Gateway-Konfiguration ist sehr wichtig

• Telegram-Paarung ist einfach, sobald die grundlegende Einrichtung gesund ist

• Tests von einem anderen Netzwerk sind eine großartige Vertrauensprüfung

Wenn ich dieses Setup später verbessere, wären meine nächsten Schritte:

• Rotieren Sie das Bot-Token

• die Node/Gateway-Umgebung für langfristige Stabilität bereinigen

• die Identität und Eingabeaufforderungen des Assistenten gestalten

• zukünftige Fähigkeiten und Workflow-Automatisierung hinzufügen

Schlussfolgerung

Wenn Sie Ihren eigenen KI-Assistenten erstellen möchten, müssen Sie nicht mit einem perfekten Cloud-Setup beginnen.

Beginnen Sie mit dem, was Sie haben:

• Ihr Computer

• eine VM

• Ubuntu

• Telegram

• ein praktisches Ziel

Das reicht aus, um etwas Reales zu bauen.

Und sobald Ihr Assistent live zum ersten Mal antwortet, werden Sie verstehen, warum dies mehr ist als nur ein technisches Experiment. Es ist der Beginn Ihrer eigenen KI-Infrastruktur.

🤯Wenn Sie darüber nachgedacht haben, Ihren eigenen KI-Assistenten zu erstellen, ist mein Rat einfach:

👉Jetzt starten. Klein anfangen. Eine funktionierende Version erstellen.

Versuchen Sie es in einer VM, verbinden Sie Telegram und bringen Sie Ihren ersten Live-Assistenten online. Danach können Sie verbessern, erweitern und schließlich zu einem VPS für ein vollständiges Produktionssetup wechseln.

Wenn Sie möchten, kann ich auch einen Folgeleitfaden zu:

• wie man die Identität des Assistenten verbessert

• wie man von VM zu VPS wechselt

• wie man es in einen Krypto-Inhalts- und Forschungs-Copilot umwandelt

🙏Wenn Sie Ihre eigene Version erstellen, teilen Sie Ihr Ergebnis in den Kommentaren – ich würde es gerne sehen.

Wenn dies nützlich war, teilen Sie es erneut, um mehr Menschen zu helfen, mit KI zu beginnen. Und sagen Sie mir, was Sie als Nächstes möchten: VPS-Bereitstellung, Telegram-Workflows, Eingabeaufforderungsdesign oder Binance-Fähigkeitsintegration?

#OPENCLAW #AIAssistant #BuildWithYou