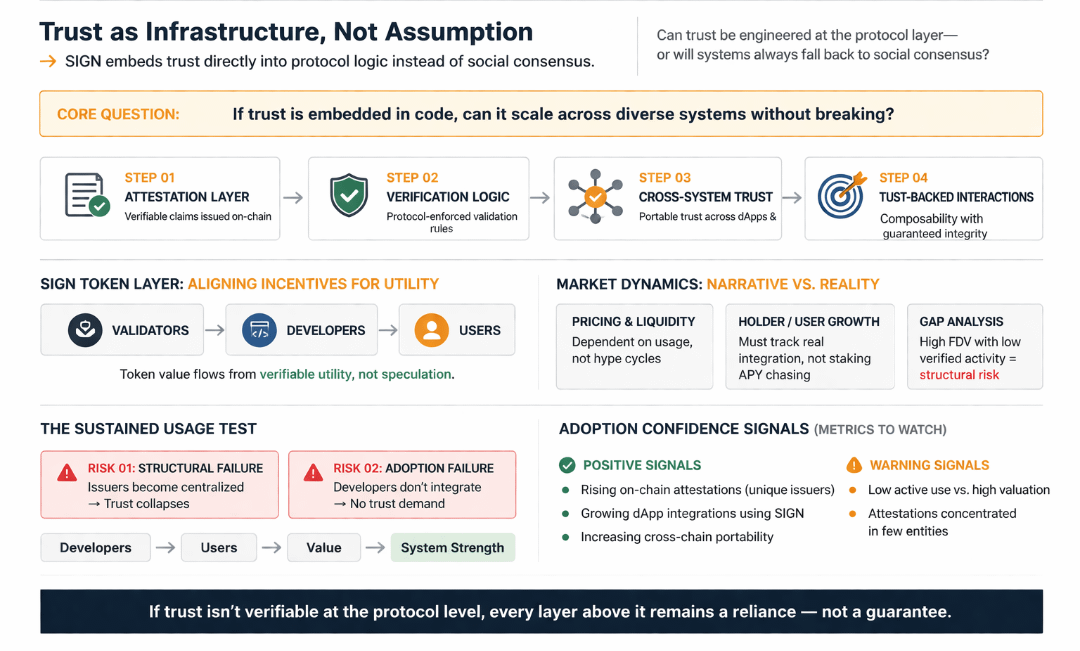

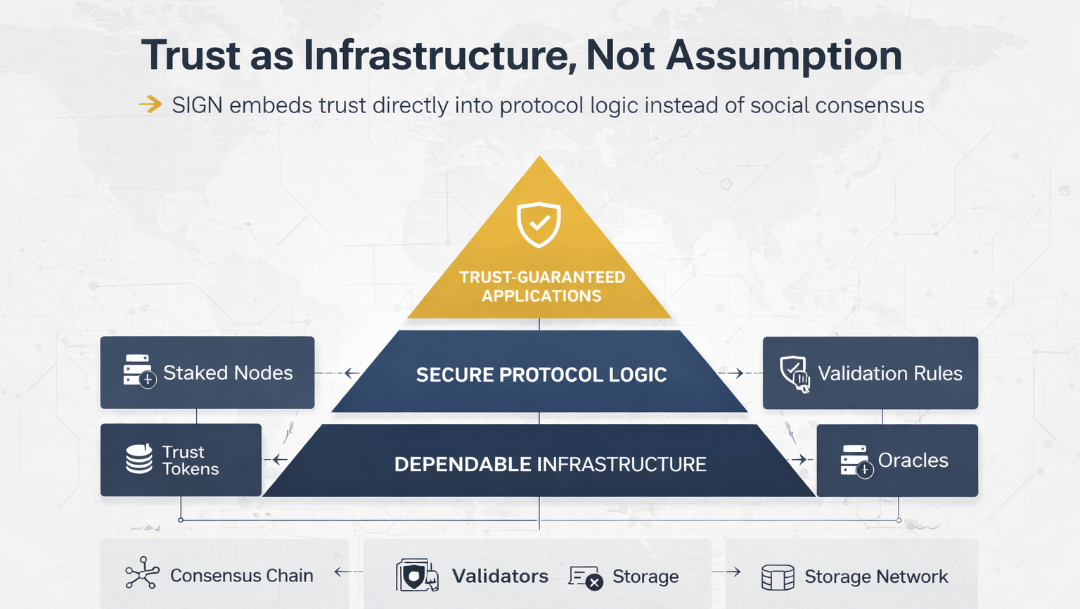

Vertrauen als Infrastruktur, nicht als Annahme

→ SIGN bettet Vertrauen direkt in die Protokolllogik einstatt von sozialem Konsens

Heyy Binancians,, Guten Abend von @Gajendra BlackrocK Die meisten Systeme haben tatsächlich kein Vertrauen, sie leihen es sich. Man merkt es nur nicht, bis etwas kaputtgeht. Eine DAO-Abstimmung wird überrannt, ein Rufwert wird manipuliert oder ein „vertrauenswürdiger“ Teilnehmer verschwindet über Nacht. Plötzlich versucht jeder herauszufinden, wer oder was ursprünglich zuverlässig sein sollte.

Heyy Binancians,, Guten Abend von @Gajendra BlackrocK Die meisten Systeme haben tatsächlich kein Vertrauen, sie leihen es sich. Man merkt es nur nicht, bis etwas kaputtgeht. Eine DAO-Abstimmung wird überrannt, ein Rufwert wird manipuliert oder ein „vertrauenswürdiger“ Teilnehmer verschwindet über Nacht. Plötzlich versucht jeder herauszufinden, wer oder was ursprünglich zuverlässig sein sollte.

Das ist der unangenehme Teil: In den meisten digitalen Systemen ist Vertrauen nicht in die Struktur eingebaut, es wird obenauf geschichtet, wie eine soziale Vereinbarung, die alle vorgeben, durchsetzbar zu sein.

Denk an etwas Einfaches wie Online-Bewertungen. Die Plattform weiß nicht, ob eine Bewertung ehrlich ist. Sie aggregiert einfach Signale und hofft, dass Manipulation unter einem bestimmten Schwellenwert bleibt. Dasselbe gilt für die meisten Krypto-Governance. Wallet = Identität. Token = Einfluss. Und wir stimmen kollektiv zu, es nicht zu missbrauchen. Das funktioniert… bis es nicht mehr funktioniert.

Das Problem ist nicht, dass Menschen unehrlich sind. Es ist, dass das System keinen nativen Weg hat, um zu überprüfen, was „ehrlich“ überhaupt bedeutet.

Hier beginnt $SIGN anders zu wirken und ehrlich gesagt, ein bisschen unangenehm, wenn du an lockerere Systeme gewöhnt bist.

Statt anzunehmen, dass Vertrauen über Zeit aus Verhalten entsteht, versucht SIGN, es auf Protokollebene durch Bestätigungen zu kodieren. Nicht vage Reputation, nicht Follower-Zahlen – tatsächliche unterzeichnete Aussagen, die mit überprüfbaren Handlungen oder Credentials verknüpft sind.

Ein Mechanismus, der heraussticht, ist, wie Bestätigungen als tragbare, on-chain Ansprüche strukturiert sind. Wenn eine Entität etwas über dich verifiziert – sagen wir, du hast an einem Governance-Prozess teilgenommen oder zu einem Datensatz beigetragen – bleibt dieser Anspruch nicht nur auf einer Plattform. Er wird zu einem wiederverwendbaren Kontextstück. Es ist, als würdest du deine Erfolgsgeschichte bei dir tragen, aber auf eine Weise, die programmatisch überprüft werden kann, nicht nur sozial interpretiert wird.

Ein weiterer Aspekt ist, wie diese Bestätigungen zusammengesetzt werden können. Statt eines einzelnen „Vertrauensscores“ erhält man geschichtete Signale. Zum Beispiel:

Eine Bestätigung könnte die Einzigartigkeit der Identität bestätigen.

Ein anderer könnte die Beitragsgeschichte bestätigen.

Ein dritter könnte spezifische Fachkenntnisse im Bereich bestätigen.

Einzeln bedeuten sie nicht viel. Zusammen beginnen sie, etwas zu bilden, das näher an strukturiertem Vertrauen ist – nicht perfekt, aber zumindest explizit.

Was interessant ist, ist, dass dies verschiebt, wo Vertrauen tatsächlich lebt. Es ist nicht mehr in der Wahrnehmung der Menge oder dem internen Algorithmus einer Plattform. Es ist in der Logik, die bestimmt, welche Bestätigungen wichtig sind und wie sie interagieren.

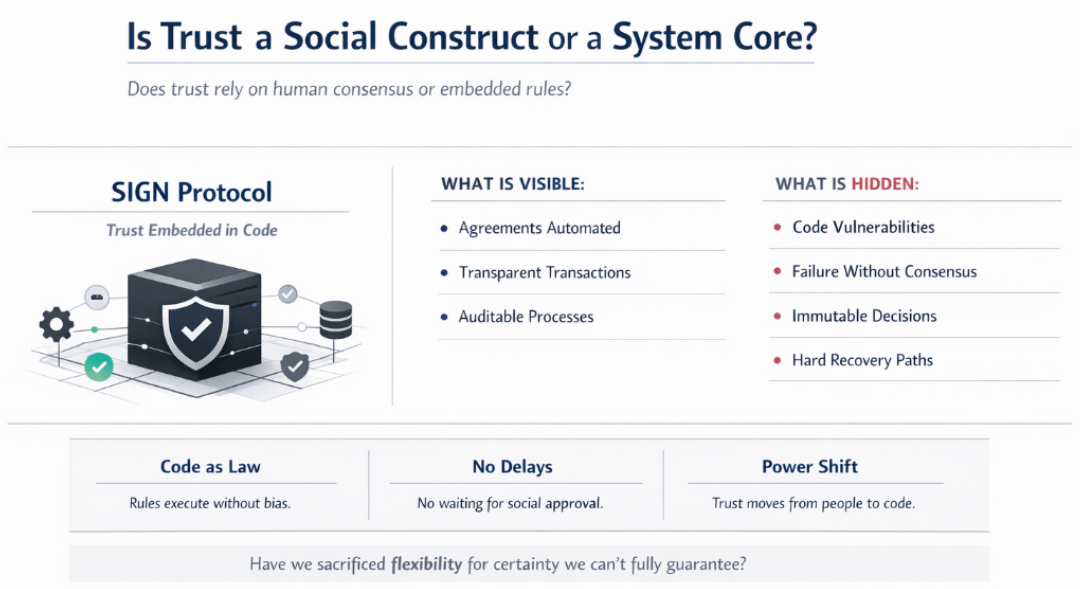

Das klingt sauber. Ist es nicht.

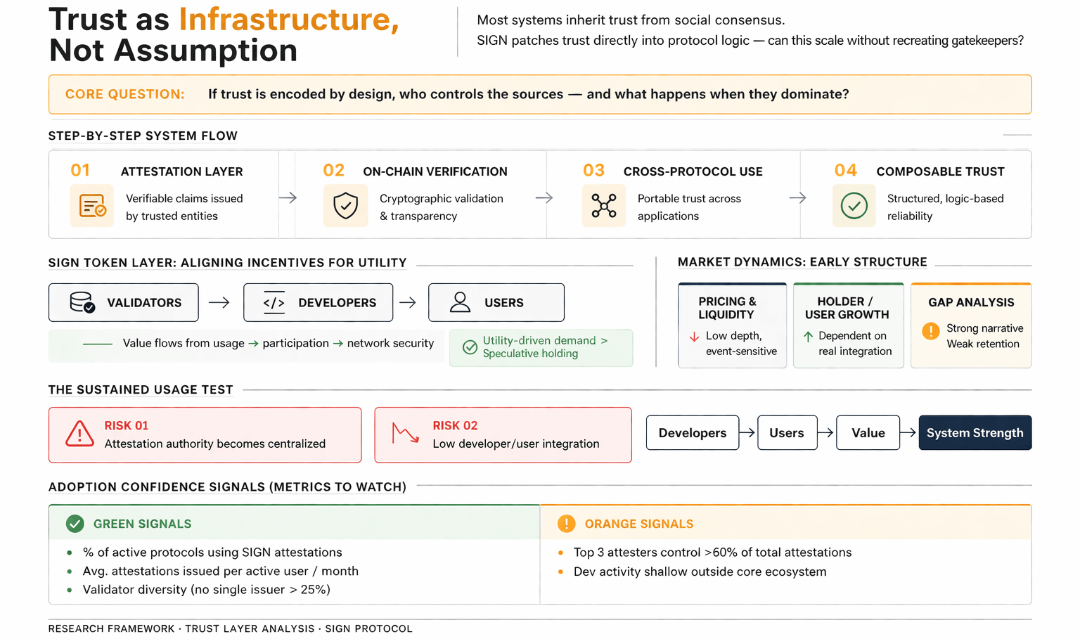

Denn sobald du Vertrauen in die Protokolllogik einbettest, bist du gezwungen, unangenehme Fragen im Voraus zu beantworten. Wer darf Bestätigungen ausstellen? Warum sollten ihre Ansprüche Gewicht haben? Was passiert, wenn zwei Bestätigungen in Konflikt stehen?

In traditionellen Systemen verschwommen diese Fragen. In SIGN sind sie offenbart.

Eine gute Möglichkeit, darüber nachzudenken, ist, von „gefühltem Vertrauen“ zu „beschränkungsbasiertem Vertrauen“ überzugehen. Früher, wenn etwas glaubwürdig erschien, gingen die Menschen damit einher. Jetzt muss Glaubwürdigkeit durch vordefinierte Strukturen hindurchgehen. Es ist weniger flexibel, aber auch weniger mehrdeutig.

Hier gibt es einen subtilen Kompromiss, über den die Leute nicht genug sprechen.

Wenn Vertrauen programmierbar wird, wird es auch starr. Du kannst Nuancen, Kontext oder Sonderfälle nicht leicht berücksichtigen. Ein System könnte erkennen, dass du 100 Mal beigetragen hast, aber es weiß nicht, ob diese Beiträge bedeutungsvoll waren oder nur optimiert, um Überprüfungsgrenzen zu bestehen.

Mit anderen Worten, du riskierst, soziale Manipulation durch mechanische Optimierung zu ersetzen.

Und die Menschen sind sehr gut darin, Systeme zu optimieren.

Ein weiterer Reibungspunkt ist die Bestätigungsautorität. Wenn eine kleine Gruppe von Entitäten dominierende Aussteller von „vertrauenswürdigen“ Ansprüchen wird, dezentralisierst du das Vertrauen nicht wirklich – du formalisierst nur die Torwächter. Der Unterschied ist, dass ihr Einfluss jetzt kodiert und schwerer anfechtbar ist.

Es erinnert mich an Kreditbewertungen. Sie begannen als ein Weg, die Vertrauenswürdigkeit im finanziellen Verhalten zu quantifizieren. Im Laufe der Zeit wurden sie zu etwas, wofür die Menschen optimieren, manchmal auf Kosten der tatsächlichen finanziellen Gesundheit. Du wirst nicht vertrauenswürdig – du wirst für das System lesbar.

SIGN könnte einen ähnlichen Weg einschlagen, wenn das Ökosystem zu stark auf spezifische Bestätigungsstandards konvergiert.

Dennoch gibt es hier etwas, das notwendig erscheint.

Denn die Alternative, weiterhin auf lose, sozial durchgesetzte Vertrauensbasis zu setzen, funktioniert nicht gut im großen Maßstab. Je komplexer und globaler diese Systeme werden, desto weniger tragfähig ist es, sich auf kollektive Intuition zu verlassen.

Was SIGN wirklich testet, ist nicht nur eine neue Funktionalität. Es ist eine andere Annahme: dass Vertrauen nicht zufällig aus Interaktionen entstehen sollte, sondern absichtlich als Teil des Fundaments des Systems konstruiert werden sollte.

Das ist ein großer Wandel, Leute.

Und es wirft eine Frage auf, die keine einfache Antwort hat: Wenn Vertrauen vollständig in die Protokolllogik eingebettet ist, machen wir die Systeme dann zuverlässiger… oder nur vorhersehbarer, wie sie ausgenutzt werden können?

#SignDigitalSovereignInfra @SignOfficial $SIGN