Früher glaubte ich, dass, sobald digitales Geld ein bestimmtes Niveau technischer Reife erreicht, die Akzeptanz fast automatisch folgen würde. Diese Annahme schien vernünftig, wenn Systeme schneller, transparenter und effizienter sind, werden Menschen und Institutionen sich natürlich zu ihnen hin bewegen.

Aber im Laufe der Zeit begann dieser Glaube zu bröckeln.

Ich begann zu bemerken, dass viele Systeme, die dazu entworfen wurden, Finanzen neu zu definieren, selten in tatsächliche Arbeitsabläufe integriert wurden. Sie wurden diskutiert, analysiert, sogar gefeiert, aber nicht konsequent genutzt. Die Lücke lag nicht in der Vision. Sie lag darin, wie diese Systeme in Verhalten übersetzt wurden.

Diese Erkenntnis führte zu einer Art Reibung in meinem Denken. Sie deutete darauf hin, dass der Bau finanzieller Infrastruktur nicht nur davon abhängt, was ein System tun kann, sondern ob es sich still in die Art und Weise integriert, wie Entscheidungen bereits getroffen werden.

Als ich tiefer in CBDCs und öffentliche Blockchain-Ökosysteme eintauchte, wurde die Fragmentierung offensichtlicher.

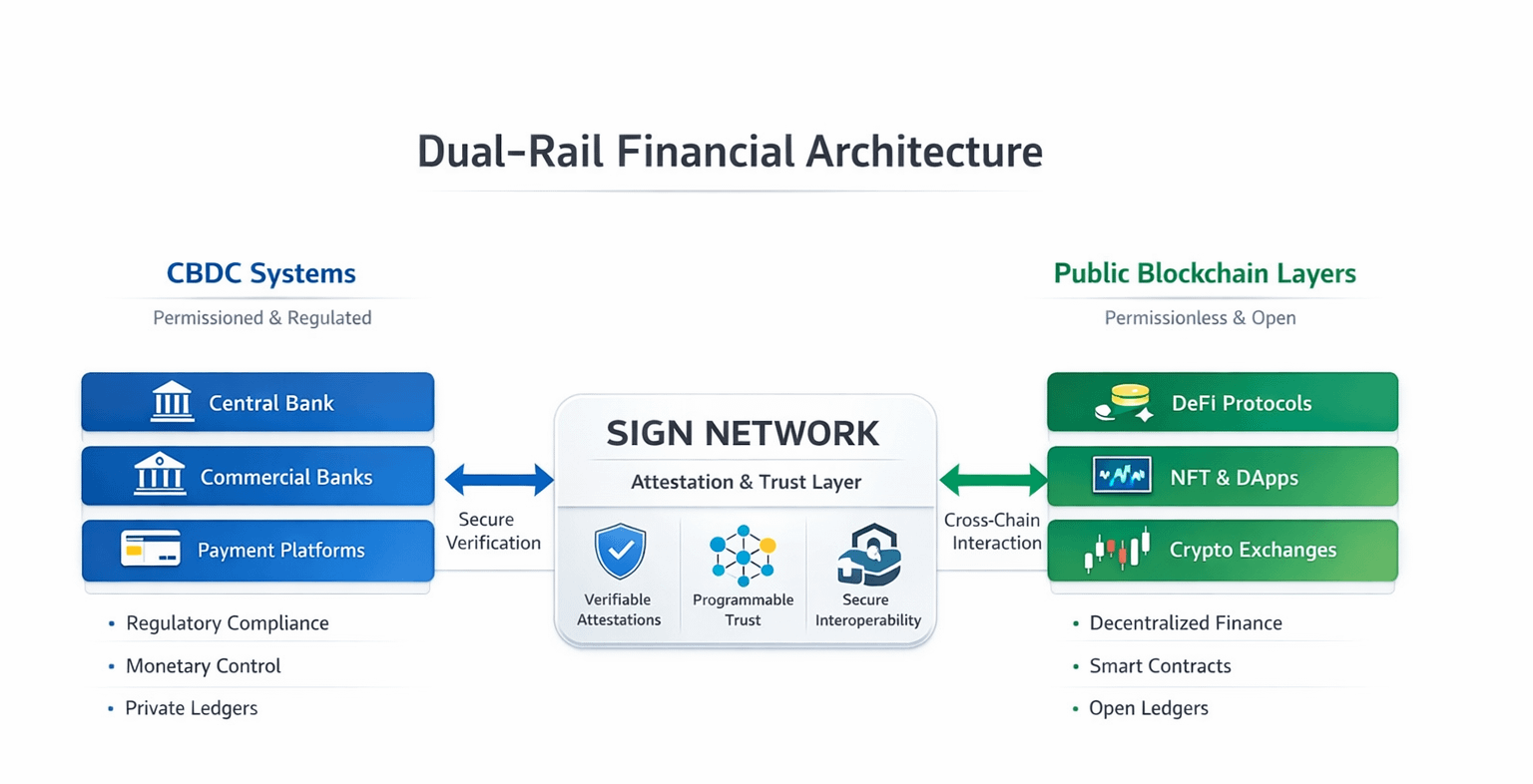

Einerseits werden CBDCs für Kontrolle, Compliance und monetäre Souveränität entworfen. Andererseits priorisieren öffentliche Blockchains Offenheit, Komponierbarkeit und Liquidität. Beide Systeme entwickeln sich, jedoch parallel und selten in Koordination.

Die gängige Erzählung ist, dass Interoperabilität sie letztendlich verbinden wird. Aber in der Praxis behandeln die meisten Ansätze Interoperabilität als eine oberflächliche Brücke.

Was ich stattdessen immer wieder bemerkte, waren tiefere strukturelle Probleme.

Zentralisierung, verborgen unter dem Anspruch auf Offenheit.

Benutzererfahrungen, die zu viel Bewusstsein und Aufwand erforderten.

Und Systeme, die vollständig erschienen, aber wiederholte, bedeutungsvolle Nutzung vermissten.

Ideen klangen wichtig, aber sie übersetzten sich nicht in die Praxis.

Was sich seltsam anfühlte, war nicht die Ambition, sondern das Fehlen einer gemeinsamen Schicht, in der Vertrauen fließen kann, ohne dass eines der Systeme Kompromisse eingehen muss.

Irgendwann hörte ich auf zu fragen, was Systeme versprechen, und begann zu beobachten, was sie aufrechterhalten.

Mein Denken wechselte von Konzept zu Ausführung. Von Erzählungen zu Benutzerfreundlichkeit.

Ich begann, Infrastruktur anders zu sehen, nicht als etwas Sichtbares, sondern als etwas, das in den Hintergrund tritt. Die effektivsten Systeme erfordern keine ständige Aufmerksamkeit. Sie arbeiten leise und werden Teil des Arbeitsablaufs selbst.

Und dieser Wandel machte mich sensibler für eine bestimmte Art von Design, Systeme, die Komplexität reduzieren, ohne Vertrauen zu verringern.

Als ich zum ersten Mal auf die Idee der dualen Schieneninteroperabilität stieß, die CBDCs mit öffentlichen Blockchain-Ökosystemen verbindet, fühlte es sich nicht sofort überzeugend an.

Zunächst schien es wie ein weiterer Versuch, Systeme zu vereinen, die grundsätzlich inkompatibel waren.

Aber bei genauerer Betrachtung fiel nicht die Ambition auf. Es war die Zurückhaltung.

Anstatt Konvergenz zu erzwingen, akzeptiert das Modell, dass unterschiedliche Systeme unterschiedliche Zwecke erfüllen. CBDCs operieren in kontrollierten Umgebungen. Öffentliche Blockchains operieren in offenen.

Das Ziel ist nicht, sie zu fusionieren, sondern ihnen zu erlauben, zu interagieren, ohne ihre definierten Eigenschaften zu verlieren.

Dies ist der Punkt, an dem @SignOfficial einen bodenständigeren Ansatz einführt.

Die tiefere Frage für mich wurde weniger über Technologie und mehr über Koordination:

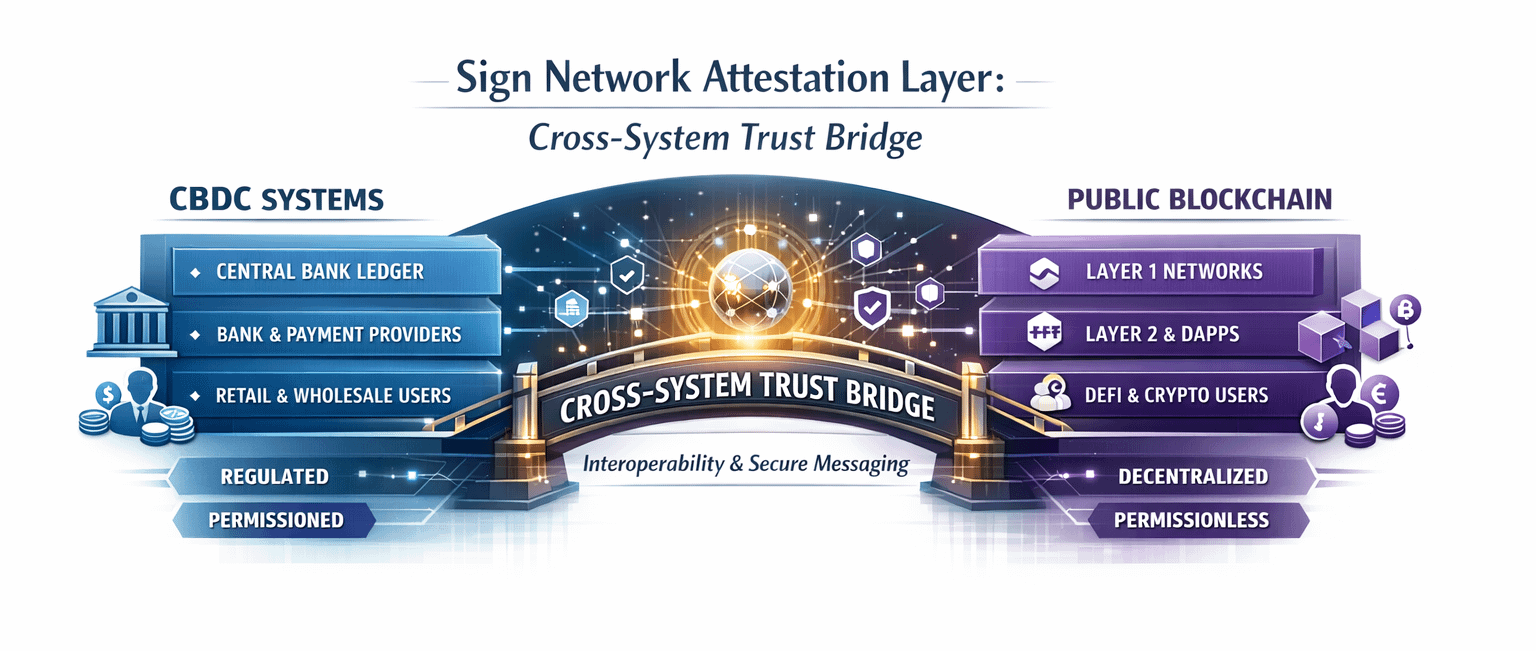

Kann ein System souveräne, konforme Finanzinfrastruktur ermöglichen, um mit offenen Netzwerken zu interagieren, ohne sensible Daten offenzulegen oder bestehende Arbeitsabläufe zu stören?

Denn Interoperabilität geht nicht nur um die Bewegung von Vermögenswerten. Es geht darum, Vertrauen, Anreize und Verifizierung über grundlegend unterschiedliche Umgebungen hinweg auszurichten.

Und dort scheitern die meisten Lösungen.

Sie verbinden Systeme technisch, aber nicht verhaltensbezogen.

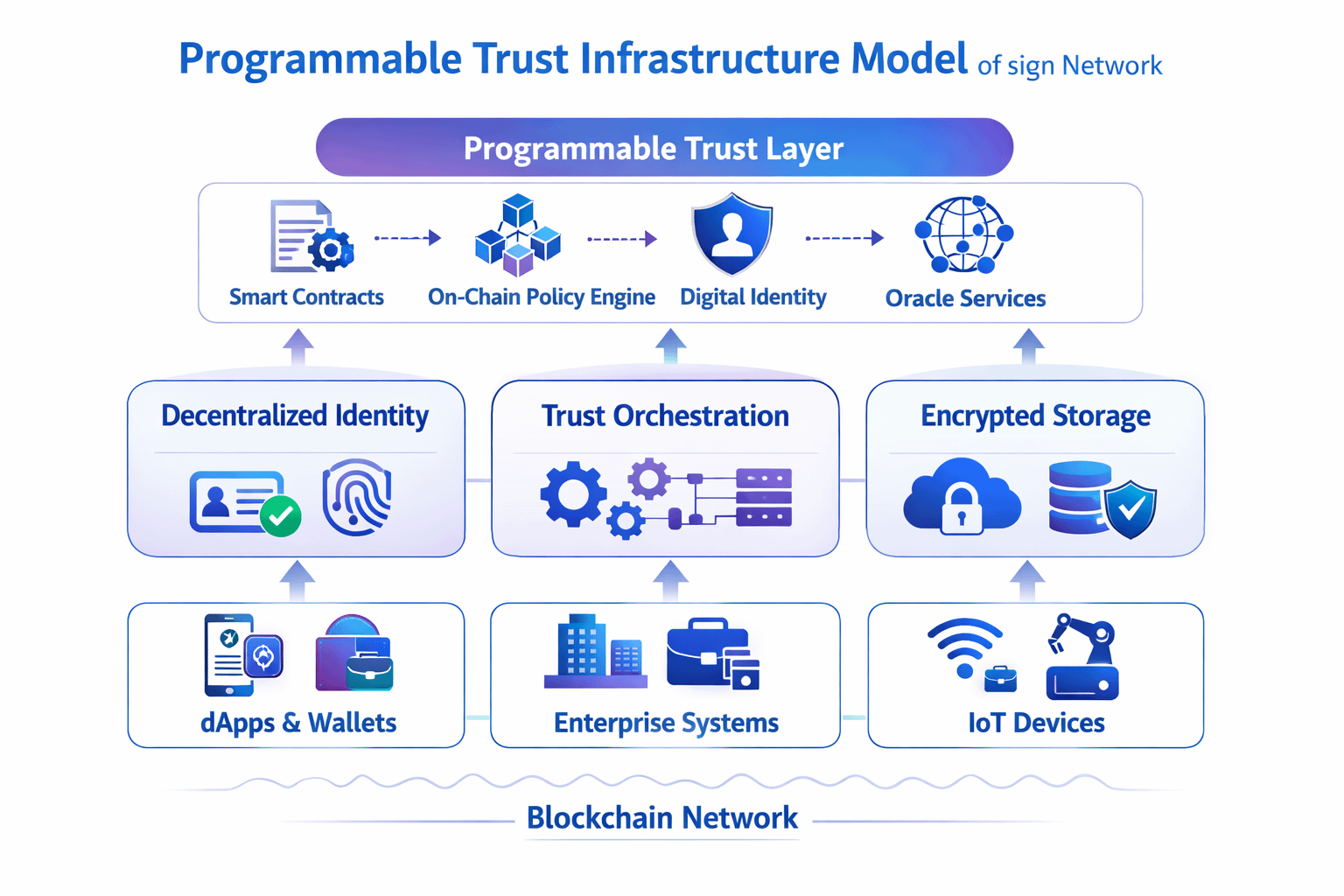

Was $SIGN Netzwerk unterscheidet, ist, wie es die Verifizierung behandelt, nicht als Funktion, sondern als grundlegende Schicht.

Im Kern dreht sich das System um Bestätigungen. Diese sind nicht nur Aufzeichnungen oder Nachrichten, sondern verifizierbare, programmierbare Ansprüche, die in verschiedenen Umgebungen ausgegeben, validiert und wiederverwendet werden können.

Dies verlagert den Fokus vom Bewegen von Vermögenswerten hin zur Strukturierung von Vertrauen.

Anstatt Systeme zu verlangen, dass sie interne Daten direkt integrieren oder offenlegen, #SignDigitalSovereignInfra ermöglicht es ihnen, Nachweise von Bedingungen auszutauschen.

Ein CBDC-System muss keine transaktionalen Details offenlegen. Es kann eine Bestätigung ausstellen, dass eine Bedingung erfüllt wurde. Eine öffentliche Blockchain-Anwendung kann dann auf diese Bestätigung reagieren, ohne tiefergehenden Zugang zu benötigen.

Dies ist der Punkt, an dem die Idee des programmierbaren Vertrauens praktisch wird.

Vertrauen ist nicht mehr statisch oder isoliert. Es wird über Anwendungen hinweg komponierbar, in verschiedenen Kontexten wiederverwendbar und ohne direkte Exposition verifizierbar.

In vielerlei Hinsicht ähnelt dies, wie finanzielle Nachrichtensysteme zwischen Banken koordinieren, jedoch mit einem entscheidenden Unterschied. Die Verifizierung hier ist dezentralisiert, programmierbar und in die Anwendungslogik eingebettet.

Innerhalb dieses Systems erfüllt der Sign-Token einen strukturellen Zweck.

Es stimmt Anreize zwischen den Teilnehmern ab, die die Integrität der Bestätigungen validieren und aufrechterhalten. Validierer verarbeiten nicht nur Transaktionen, sie sichern die Glaubwürdigkeit von Ansprüchen, von denen andere Systeme abhängen.

Dies schafft einen Rückkopplungskreis.

Da immer mehr Anwendungen auf Bestätigungen angewiesen sind, wird die Teilnahme von Validierern bedeutungsvoller. Wenn die Validierung robuster wird, steigt das Vertrauen in das System.

Der Token ist in diesem Sinne nicht nur eine Einheit des Wertes. Er ist Teil des Koordinationsmechanismus, der es ermöglicht, dass dezentrale Verifizierung skaliert.

Im weiteren Kontext spiegelt dieser Ansatz einen tieferen Wandel darin wider, wie digitale Systeme gestaltet werden.

Wir bewegen uns von Umgebungen, in denen Vertrauen angenommen wird, zu Umgebungen, in denen Vertrauen kontinuierlich verifiziert werden muss.

Institutionen werden vorsichtiger.

Benutzer werden selektiver.

Und Systeme werden erwartet, Beweise zu liefern, nicht nur Funktionalität.

In Regionen, in denen die digitale Infrastruktur schnell in Teilen des Nahen Ostens und Asiens expandiert, wird dies noch relevanter. Unterschiedliche regulatorische Rahmenbedingungen, wirtschaftliche Bedingungen und Benutzererwartungen erfordern Systeme, die flexibel operieren können, ohne Einheitlichkeit zu erzwingen.

Eine programmierbare Vertrauensschicht ermöglicht diese Flexibilität.

Es ermöglicht Interaktionen, ohne dass eine Abstimmung auf jeder Ebene erforderlich ist.

Ein Muster, dessen ich mir bewusster geworden bin, ist, wie leicht Aufmerksamkeit mit Adoption verwechselt wird.

Märkte neigen dazu, auf Sichtbarkeit, Preisbewegungen, Ankündigungen, Erzählungen zu reagieren. Aber Infrastruktur reift nicht durch Aufmerksamkeit. Sie reift durch Nutzung.

Und Nutzung hat eine andere Signatur.

Es zeigt sich in wiederholten Interaktionen.

In Systemen, die voneinander abhängen.

In Arbeitsabläufen, die ohne eine bestimmte Schicht nicht funktionieren.

Hier liegt die echte Prüfung.

Nicht ob Interoperabilität diskutiert wird, sondern ob sie notwendig wird.

Selbst mit starkem Design stehen Systeme wie dieses vor einer grundlegenden Herausforderung.

Sie müssen eine bestimmte Schwelle der Nutzung überschreiten, bevor sie selbsttragend werden.

Wenn Bestätigungen nicht tief in Anwendungen integriert sind, bleiben sie optional.

Wenn Benutzer ihnen nicht wiederholt begegnen, bleiben sie unbekannt.

Wenn die Aktivität von Validierern inkonsistent ist, schwächt sich das Vertrauen.

Diese "Nutzungsgrenze" wird nicht durch bessere Technologie gelöst. Sie wird durch bessere Integration in das Verhalten der realen Welt gelöst.

Und dort kämpfen die meisten Systeme, nicht auf der Ebene des Designs, sondern auf der Ebene der Akzeptanz.

Irgendwann begann ich, Interoperabilität weniger als technisches Problem und mehr als menschliches zu sehen.

Es geht darum, wie viel Komplexität Benutzer bereit sind zu tolerieren.

Wie viel Kontrolle Institutionen bereit sind aufzugeben.

Und wie Systeme diese beiden Kräfte ausbalancieren, ohne zu zerbrechen.

Denn am Ende funktioniert Infrastruktur nur, wenn sie mit Verhalten übereinstimmt, nicht wenn sie versucht, es zu ersetzen.

Wenn ich hier nach echten Fortschrittssignalen suchen würde, würden sie nicht aus Ankündigungen kommen.

Sie würden aus Mustern kommen.

Anwendungen, die Bestätigungen als Teil ihrer Kernlogik erfordern.

Benutzer, die mit diesen Systemen interagieren, ohne sie verstehen zu müssen.

Validierer, die teilnehmen, weil die Nachfrage konstant ist, nicht spekulativ.

Das ist der Zeitpunkt, an dem ein System von konzeptionell wichtig zu funktional notwendig übergeht.

Ich bin zu dem Schluss gekommen, dass der schwierigste Teil beim Bau finanzieller Systeme nicht das Design ist, sondern sie verschwinden zu lassen.

Denn der Unterschied zwischen einer Idee, die notwendig klingt, und einer Infrastruktur, die notwendig wird, ist Wiederholung.

Und Wiederholung geschieht nur, wenn Systeme aufhören, bemerkt zu werden, und anfangen, unmöglich zu vermeiden zu sein.