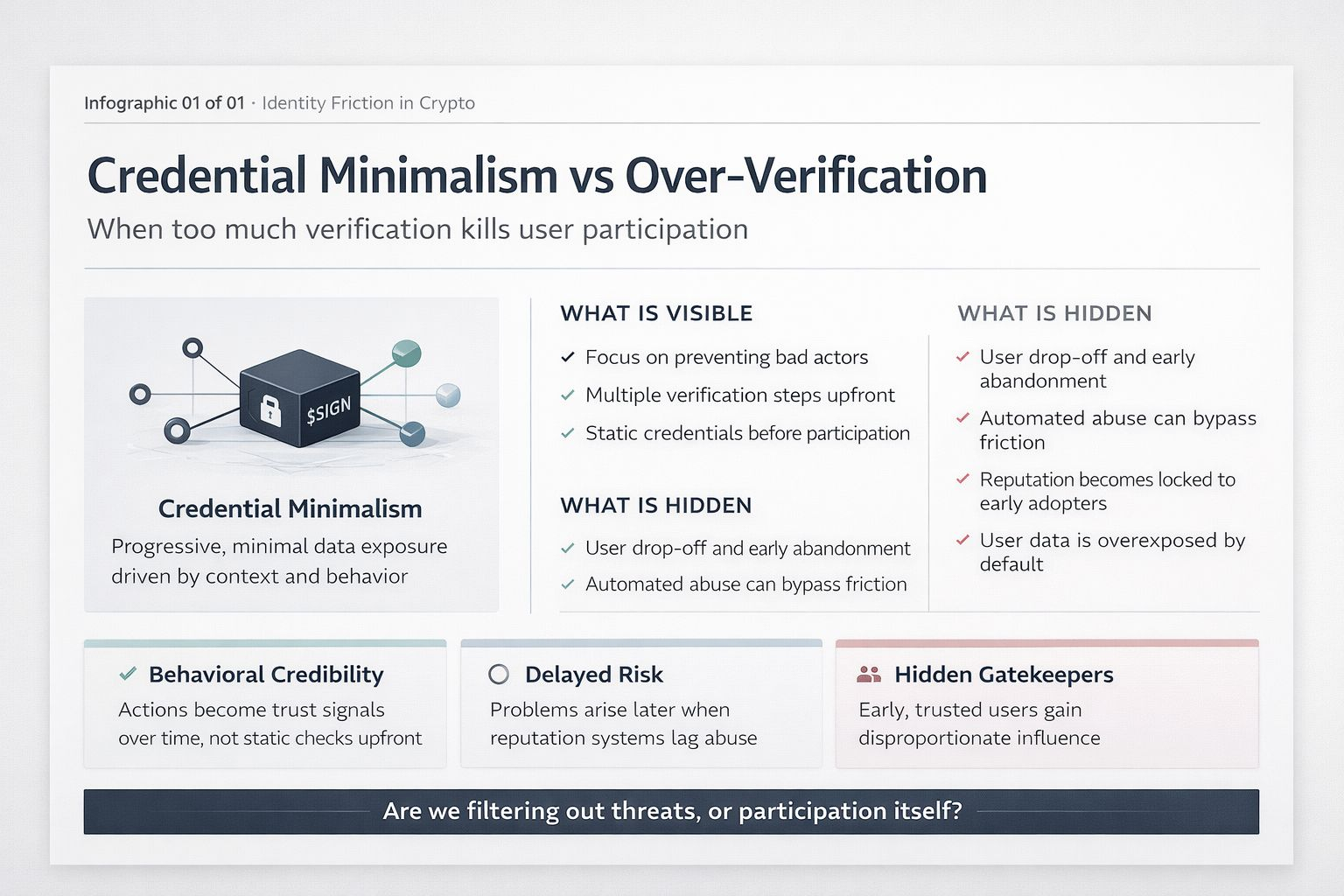

Credential Minimalismus vs Überprüfung über das nötige Maß

→ Wenn zu viel Überprüfung die Benutzerbeteiligung tötet

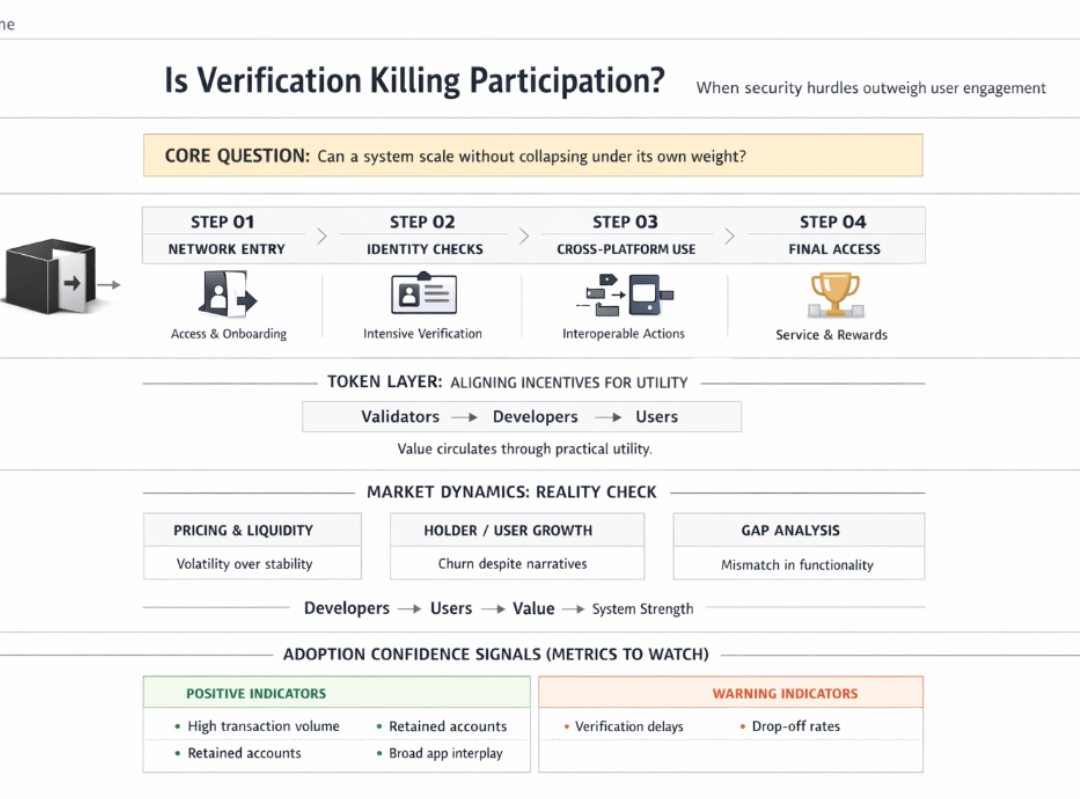

Guten Morgen Binancians, lassen Sie mich erzählen, was ich bemerkt habe. Es gibt diesen seltsamen Moment, den ich immer wieder in Web3-Apps bemerke, kurz bevor jemand tatsächlich anfängt, das Produkt zu nutzen, wird man mit einer Mauer von „beweise dich selbst“ konfrontiert. Wallet verbinden, soziale Netzwerke verifizieren, Nachrichten signieren, vielleicht sogar die Aktivitätsgeschichte verlinken. Und man kann fast in Echtzeit spüren, wie die Abbruchrate steigt. Nicht, weil die Leute nicht interessiert sind… sondern weil es plötzlich wie zu viel Arbeit für etwas erscheint, das ihre Mühe noch nicht verdient hat.

Das ist die unangenehme Wahrheit.. Überprüfung filtert keine schlechten Benutzer, sie filtert alle Benutzer.

Denk darüber nach, wie beim Betreten eines Cafés. Wenn der Besitzer nach einem Ausweis, einem Einkommensnachweis und einer Empfehlung fragt, bevor er dir erlaubt, Kaffee zu bestellen, denkst du nicht: „Wow, dieser Ort schätzt Qualität.“ Du verlässt den Ort. Die meisten Systeme von heute verwechseln Reibung mit Sicherheit. Sie nehmen an, dass mehr Kontrollen = bessere Teilnehmer sind. Aber was sie wirklich tun, ist, die Neugier an der Tür zu ersticken.

Und dies ist der Punkt, an dem die Idee hinter $SIGN interessant wird, nicht weil sie die Verifizierung entfernt, sondern weil sie hinterfragt, wie viel tatsächlich notwendig ist.

Was ich gesehen habe, ist, dass $SIGN in etwas näher an minimaler Anmeldedaten-Lehre tendiert. Anstatt Verifizierungsschichten im Voraus zu stapeln, verschiebt es sich hin zu leichten, kontextbasierten Signalen. Zwei Mechanismen stechen hervor.

Zuerst, selektive Offenlegung von Anmeldedaten. Du musst nicht deine gesamte Identität oder Aktivitätshistorie preisgeben, um teilzunehmen. Stattdessen zeigst du nur, was für diese spezifische Interaktion relevant ist. Es ist wie der Nachweis, dass du über 18 bist, ohne deinen vollständigen Reisepass zu übergeben. Kleines Detail, aber es verändert, wie bereit die Menschen sind, sich zu engagieren.

Zweitens, progressive Verifizierung. Anstatt die Benutzer durch einen aufwendigen Onboarding-Prozess zu zwingen, erlaubt das System ihnen, mit minimalem Nachweis zu beginnen und im Laufe der Zeit Glaubwürdigkeit aufzubauen. Deine Handlungen beginnen wichtiger zu werden als deine anfänglichen Anmeldedaten. Das kehrt das übliche Modell um, bei dem alles entschieden wird, bevor du überhaupt teilnimmst.

Auf den ersten Blick fühlt es sich fast zu nachsichtig an. Wie... sollten wir nicht mehr überprüfen, um Missbrauch zu verhindern?

Aber hier ist der Wandel: Überprüfung geht davon aus, dass böse Akteure durch Reibung gestoppt werden. Tun sie nicht. Sie automatisieren es. Sie umgehen es. In der Zwischenzeit bleiben echte Benutzer, insbesondere neue, im Prozess stecken. So wird das System für genau das Verhalten optimiert, das es zu vermeiden versucht.

Was $SIGN implizit wettet, ist, dass verhaltensbasierte Glaubwürdigkeit besser skalierbar ist als statische Verifizierung. Mit anderen Worten, was du im Laufe der Zeit tust, ist wichtiger als das, was du zu Beginn beweist.

Das ist eine subtile, aber kraftvolle Verschiebung.

Es führt auch zu einer anderen Art von Vertrauenskurve. Anstatt ein hartes Tor beim Eintritt zu haben, erhältst du eine allmähliche Steigung. Niedrige Barriere zum Start, höhere Erwartungen, je tiefer du gehst. Es spiegelt wider, wie Vertrauen im echten Leben funktioniert. Du fragst jemanden nicht nach seinem gesamten Hintergrund, bevor ein Gespräch stattfindet; du passt das Vertrauen an, während sich die Interaktion entfaltet.

Aber hier wird es chaotisch.

Minimale Anmeldedaten klingen großartig, bis du auf Randfälle triffst. Was passiert, wenn böse Akteure diese niedrige Eintrittsbarriere ausnutzen? Wenn die frühe Teilnahme zu einfach ist, kann Spam und qualitativ schlechtes Verhalten das System überschwemmen, bevor die Reputation-Mechanismen aufholen.

Und es gibt ein weiteres Thema, über das die Leute nicht genug sprechen: unsichtbare Vorurteile in progressiven Systemen.

Wenn Glaubwürdigkeit im Laufe der Zeit wächst, gewinnen frühe Anwender einen Vorteil. Sie akkumulieren schneller Vertrauen, prägen Normen und halten indirekt Neulinge in Schach, auch ohne ausdrückliche Regeln. Während das System also offen aussieht, kann es still und leise Einfluss um die ersten, die hineingekommen sind, oder die, die die Mechanik früh verstanden haben, zentralisieren.

Es ist nicht offensichtlich. Aber es ist da.

Es gibt auch einen psychologischen Aspekt. Wenn Benutzer wissen, dass die Verifizierung minimal ist, werden einige die Grenzen austesten. Nicht böswillig, nur aus Neugier. Das System muss dann zwischen Erkundung und Missbrauch unterscheiden, was nicht trivial ist. Zu streng, und du bist wieder bei Überprüfung. Zu locker, und die Qualität sinkt.

Es wird also zu einem Balanceakt, nicht zu einer Lösung.

Dennoch bleibt die Kernidee bei mir hängen: Vielleicht ist das Ziel nicht, schlechte Akteure von Anfang an zu eliminieren, sondern Systeme zu entwerfen, in denen gute Akteure im Laufe der Zeit von selbst herausstechen.

Das ist eine sehr andere Designphilosophie.

Die meisten Plattformen heute sind wie Flughäfen mit intensiver Sicherheitskontrolle vor dem Eintritt. SIGN fühlt sich näher an einem öffentlichen Park an. Leicht zu betreten, schwieriger, eine dauerhafte Präsenz ohne konsistentes Verhalten aufzubauen. Beide Modelle haben Risiken. Aber nur eines ermutigt die Menschen tatsächlich, hineinzugehen.

Und vielleicht ist das der Punkt, den die Leute immer wieder übersehen.

Teilnahme ist nicht nur eine Kennzahl, sondern ein Signal. Wenn dein System zu viel Nachweis benötigt, bevor überhaupt jemand anfängt, schützt du keinen Wert. Du verhinderst, dass er entsteht.

#SignDigitalSovereignInfra @SignOfficial