Wenn ich es auf das reduziere, was tatsächlich immer wieder bricht, dann ist es nicht die Überprüfung für sich und es ist nicht die Verteilung für sich, es ist der Raum dazwischen, der Moment, in dem ein System etwas akzeptieren muss, das es nicht erstellt hat, und entscheiden muss, ob es darauf reagieren soll. Das ist der Punkt, an dem die Dinge leise auseinanderfallen. Ein Benutzer beweist, dass er irgendwo berechtigt ist, ein Projekt zeichnet die Teilnahme auf, ein anderes System möchte dieses Verhalten belohnen, und plötzlich wird das, was einfach aussah, unsicher.

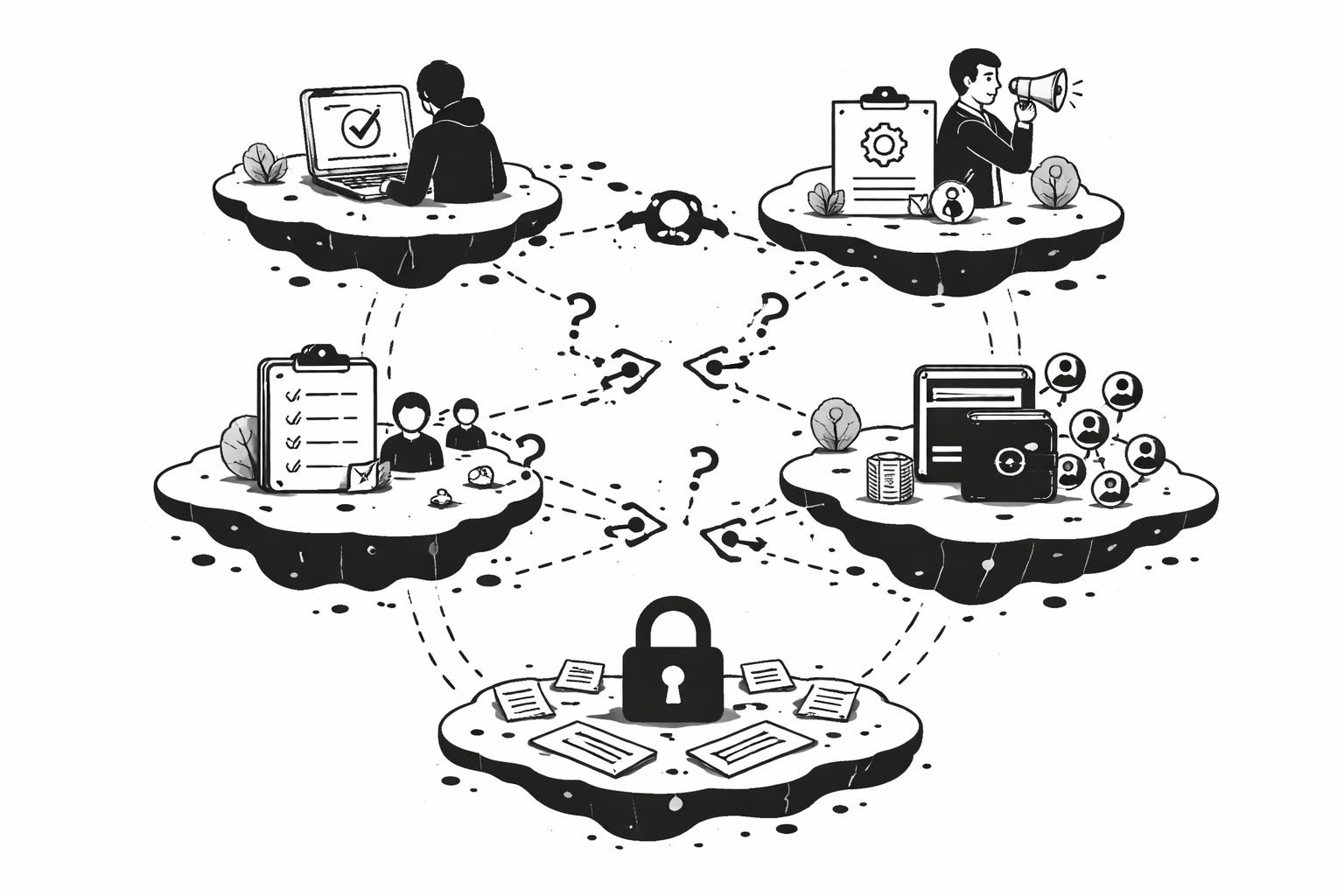

Nicht weil die Daten nicht existieren, sondern weil ihre Bedeutung sich nicht gut übertragen lässt. Wir haben ein Internet geschaffen, das unglaublich effizient darin ist, Aufzeichnungen, Berechtigungen, Geldbörsen, Geschichtenerzählungen und Reputation zu produzieren, aber seltsamerweise fragil ist, wenn diese Aufzeichnungen bewegt werden müssen. In dem Moment, in dem ein Anspruch seine ursprüngliche Umgebung verlässt, verliert er an Klarheit. Man fängt wieder an, grundlegende Fragen zu stellen: Wer hat das ausgestellt, warum sollte dieser Aussteller hier wichtig sein, hat sich etwas geändert, kann ich das überprüfen, ohne die Hälfte der Logik selbst neu zu erstellen. Diese Wiederholung ist nicht nur lästig, sie ist strukturell. Sie zeigt Ihnen, dass das System nicht koordiniert ist, sondern fragmentiert.

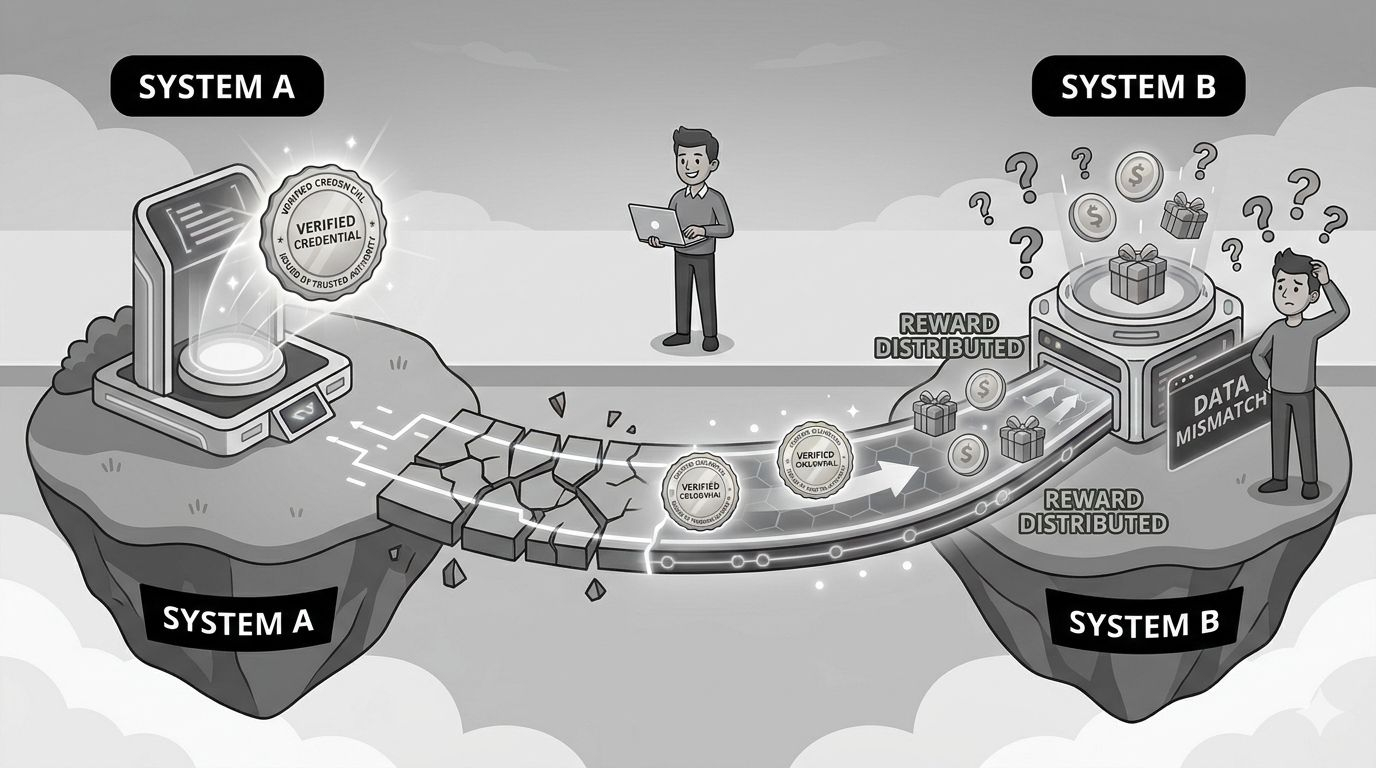

Und dieser gleiche Riss zeigt sich wieder, wenn Wert ins Spiel kommt. Die Tokenverteilung klingt mechanisch – einfach Vermögenswerte von einem Ort zum anderen senden – aber die wirkliche Komplexität sitzt, bevor der Transfer überhaupt geschieht. Warum diese Adresse, warum diese Gruppe, was qualifiziert sie, welcher Nachweis verbindet sie mit dem Ergebnis. Wenn dieses Nachdenken nicht klar, verifizierbar und wiederverwendbar ist, hängt jede Verteilung von interner Logik ab, die niemand sonst richtig prüfen oder wiederverwenden kann. An diesem Punkt wird „Fairness“ zu einer Erzählung, anstatt etwas Beobachtbares zu sein. Hier beginnt die Trennung zwischen Verifikation und Verteilung, künstlich zu erscheinen. Der eine definiert eine Bedingung, die vertraut werden kann, der andere führt basierend auf dieser Bedingung aus. Wenn sie nicht eng verbunden sind, hat man Systeme, die entweder Dinge beweisen oder Werte bewegen können, aber Schwierigkeiten haben, beides in einer Weise zu tun, die in verschiedenen Kontexten Bestand hat.

Was dies schwieriger macht, ist, dass das Problem nicht rein technischer Natur ist. Es ist interpretativ. Eine Anmeldeinformation funktioniert nur, wenn ein anderes System sie auf die gleiche Weise versteht, wie das ursprüngliche System beabsichtigt hat. Ohne gemeinsame Struktur, ohne eine Vereinbarung darüber, wie der Nachweis definiert und gelesen wird, fällt alles zurück in lokale Logik. Jede Plattform wird zu ihrer eigenen Insel der Wahrheit, und alles, was zwischen ihnen kreuzt, muss neu validiert, neu interpretiert oder einfach ohne Klarheit vertraut werden. Das ist der Grund, warum das Problem immer wieder auftritt, egal wie viel Infrastruktur aufgebaut wird. Uns fehlen keine Aufzeichnungen, uns fehlt die Kontinuität zwischen ihnen. Das Versagen geschieht nicht bei der Erstellung, sondern beim Übergang.

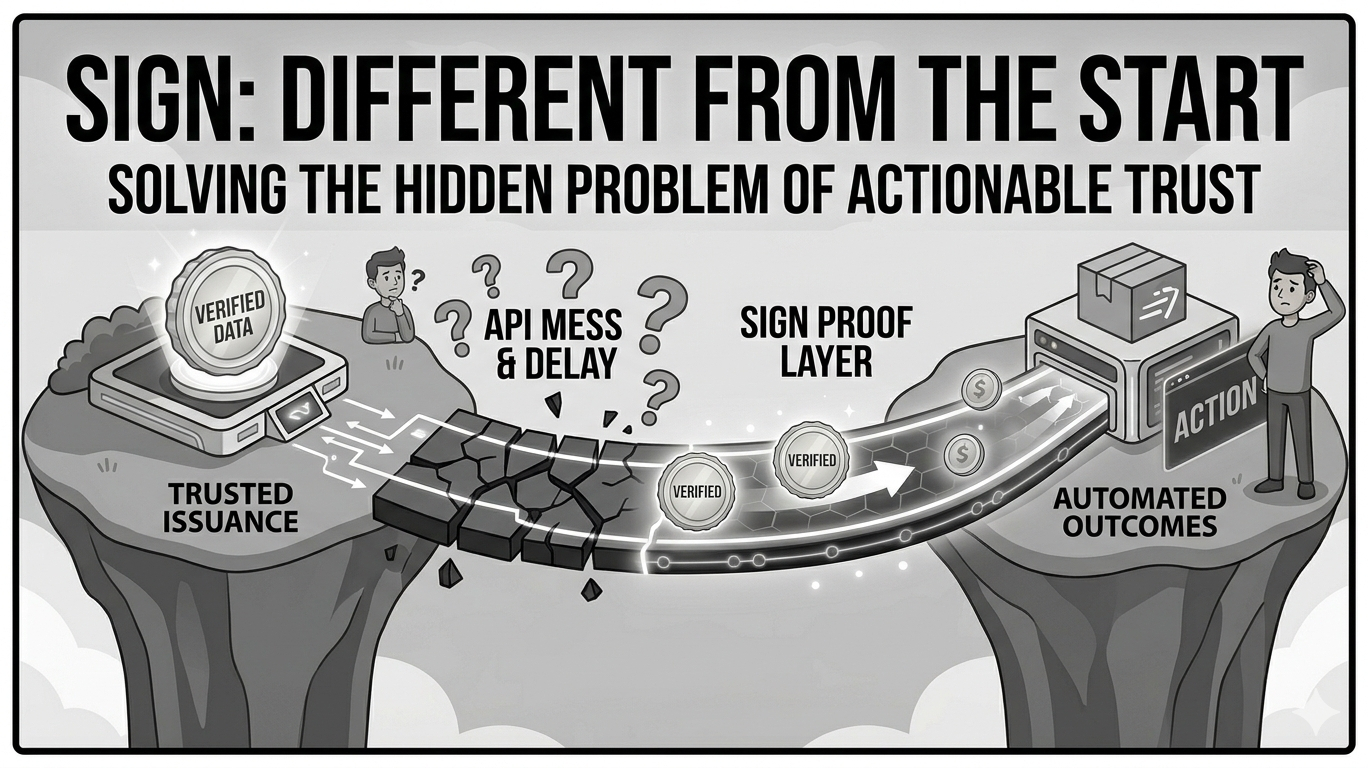

Aus diesem Blickwinkel fühlt sich das, was SIGN zu tun versucht, weniger wie das Hinzufügen einer weiteren Funktion an und mehr wie das Ansprechen dieser fehlenden Schicht. Nicht indem jedes System ersetzt wird, sondern indem der Teil, der definiert, was wahr ist – wer was getan hat, wer sich qualifiziert, was vertraut werden kann – weniger abhängig von isolierten Backends wird. Die Idee ist subtil, aber wichtig: Wenn der Nachweis so strukturiert werden kann, dass mehrere Systeme ihn lesen, verifizieren und darauf reagieren können, ohne Improvisation, dann hört die Koordination auf, fragil zu sein. Verteilung wird eine natürliche Erweiterung der Verifikation statt eines separaten Prozesses, der mit interner Logik zusammengenäht ist. Es löst nicht alles, und es beseitigt nicht die Notwendigkeit für einzelne Systeme, ihre eigene Komplexität zu managen, aber es verändert, wo das Vertrauen sitzt. Anstatt in jeder Anwendung eingeschlossen zu sein, beginnt es in einer Form zu existieren, die sich bewegen kann.

Diese Verschiebung kündigt sich nicht lautstark an. Sie zeigt sich in kleineren Weisen – weniger wiederholte Überprüfungen, weniger Abhängigkeit von Screenshots und manueller Validierung, klareres Nachdenken darüber, wer Zugang oder Belohnungen erhält. Im Laufe der Zeit summieren sich diese kleinen Verbesserungen zu etwas Bedeutenderem: Systeme, die nicht jedes Mal das Vertrauen neu verhandeln müssen, wenn sie interagieren. Und vielleicht ist das hier der eigentliche Punkt. Nicht ob Anmeldeinformationen erstellt oder Token verteilt werden können – das wissen wir bereits, dass sie es können – sondern ob Vertrauen die Reise zwischen den Systemen überstehen kann, ohne seine Form zu verlieren. Denn dort kämpft die meisten digitale Infrastruktur immer noch, und dort wahrscheinlich kommt die nächste Fortschrittsschicht her.