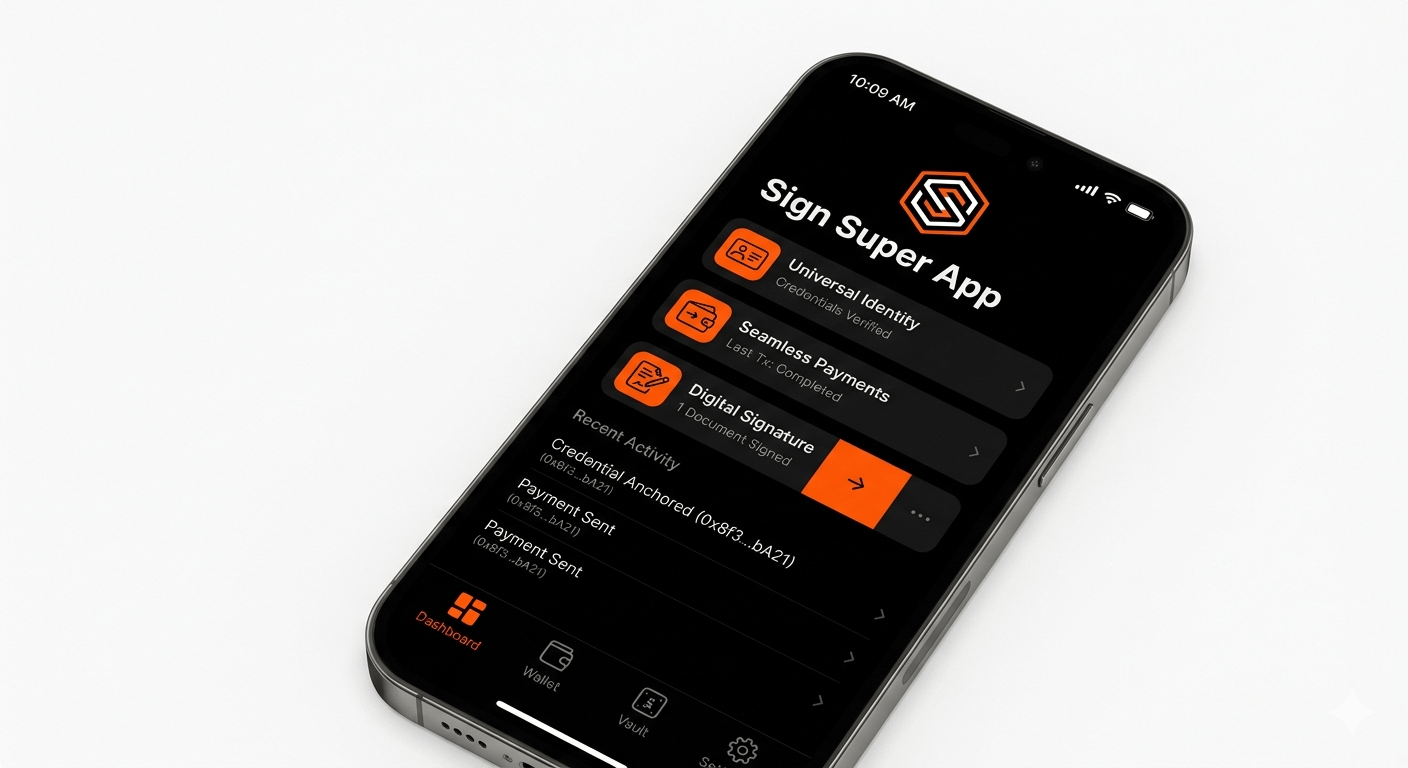

Gestern Nacht, nur Stunden nachdem ein ruhiger Snapshot-Zeitraum für eine Kampagne zur Verteilung von Berechtigungen geschlossen wurde, fand ich mich tief in der Dokumentation von @SignOfficial wieder und spielte eine Simulation nach, die sich nicht ganz so verhielt, wie es die Vision versprach. Die Idee selbst fühlt sich für mich immer noch unvermeidlich an: eine einheitliche Super-App, in der Identität, Zahlungssignaturen und Verteilung zu einer nahtlosen Schnittstelle verschmelzen. Es liest sich wie das Endspiel der Web3-Infrastruktur, etwas, um das wir seit Jahren kreisen, aber nie ganz erreichen. Und je tiefer ich ging, desto mehr begann diese Eleganz, Stressfrakturen auf der Ausführungsebene zu zeigen.

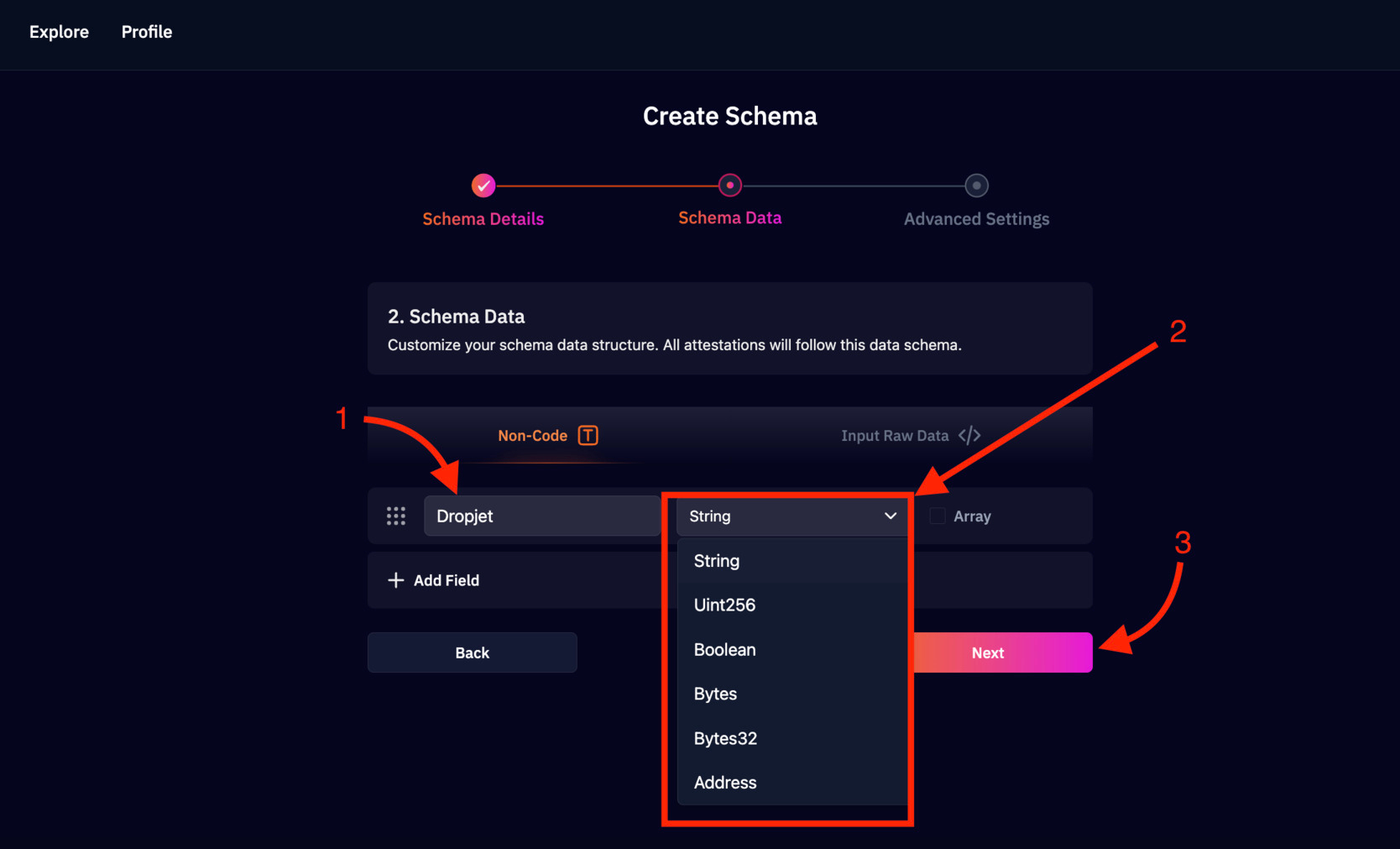

Ich verfolgte einen einfachen Credential-Angling-Fluss, der an einen Testvertrag gebunden war, etwas nicht Komplexes, nur ein zwei Megabyte großes Credential, das durch eine externe Speicher- schicht geschoben und dann on-chain gehasht wurde. Die Zahlen waren isoliert klein, aber im Kontext aufschlussreich. Etwa vierzig Cent, um extern zu pinnen, weitere dreißig Cent an Gas, selbst unter lockeren Testnetzbedingungen, was die Gesamtkosten auf fast einen Dollar für einen einzigen verifizierbaren Datensatz brachte. Das ist einmal vielleicht machbar, vielleicht sogar hundertmal, aber wenn ich es mental auf tausende von Benutzern, dynamische Credentials und Multi-Chain-Verteilungen hochrechnete, begann die Struktur schwerfällig zu wirken. Was mir blieb, war nicht nur die Kosten, es war die Wiederholung. Jedes Update bedeutete einen neuen Hash, einen neuen Anker, eine neue Zahlung. Nichts an diesem Zyklus fühlte sich nativ an für die fließende Natur von Identität oder Unternehmensdaten.

An einem Punkt während der Simulation stieß ich auf eine Pause, die ich nicht ignorieren konnte. Eine Transaktion schlug nicht fehl, kehrte nicht zurück, sie verweilte einfach. Die Indexierungsschicht hatte noch nicht aufgeholt, und für einen kurzen Moment erkannte das System seinen eigenen Zustand nicht vollständig. Es waren nur ein paar Sekunden, aber es erzeugte eine subtile Dissonanz. Die Vision der Super-App geht von Unmittelbarkeit aus, einer Art Echtzeitbewusstsein, in dem KI-Agenten lesen, entscheiden und sofort handeln können, während das zugrunde liegende System weiterhin mit asynchroner Zögerlichkeit agiert. Diese Kluft, auch wenn sie klein ist, führt zu einer Art kognitiver Reibung, die sich im großen Maßstab summiert.

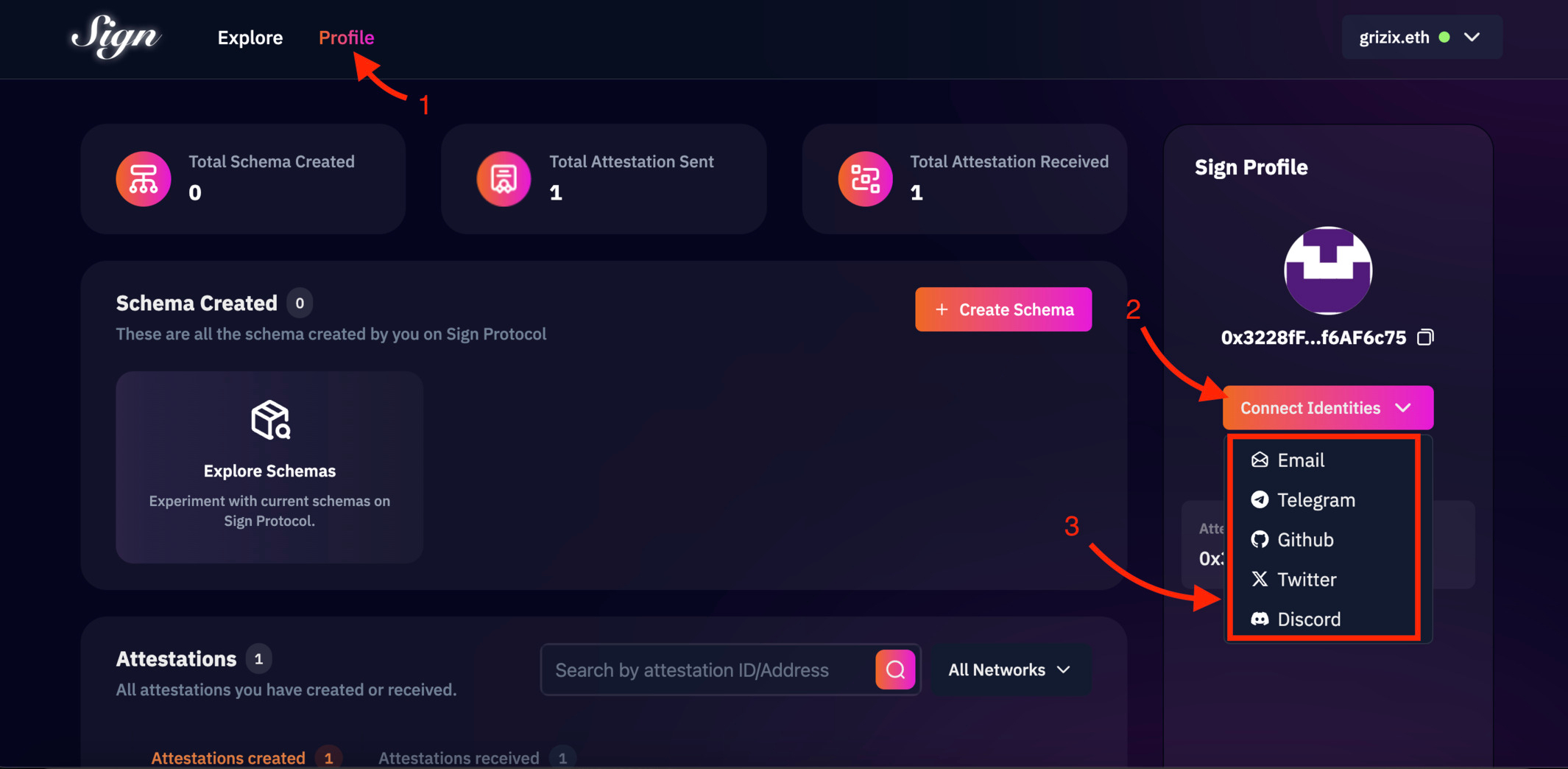

Während ich weiter durch die Architektur ging, wurde mir klar, dass dieses System nicht wirklich in Schichten operiert, wie wir es oft beschreiben. Die wirtschaftlichen, technischen und Identitätskomponenten stapeln sich nicht ordentlich; sie loopen ständig ineinander. Die wirtschaftliche Seite, mit einem erheblichen Teil des Token-Angebots, der reserviert ist, um die Akzeptanz zu fördern, zielt eindeutig darauf ab, Skalierung zu bootstrappen, aber jeder Nutzungsakt führt zu Kostendruck zurück. Das technische Design, das Daten zwischen on-chain Ankern und off-chain Speicherung aufteilt, ist logisch sinnvoll und weit akzeptiert, doch die Abrufschicht führt zu einer Latenz, die sich nicht mit den Erwartungen an KI-gesteuerte Systeme synchron anfühlt. Die Governance- und Identitätsschicht ist arguably der eleganteste Teil, mit programmierbaren Bestätigungen, die menschliche Vorurteile beseitigen und die Verifizierung automatisieren, aber die Identität selbst ist nicht statisch. Credentials laufen ab, Ruf verändert sich, Compliance-Regeln entwickeln sich, und jede dieser Veränderungen schiebt neue Daten durch denselben Kosten- und Indizierungskreislauf erneut.

Als ich dies kurz mit Systemen wie Fetch.ai oder Bittensor verglich, wurde der Kontrast in meinem Kopf schärfer. Diese Systeme wirken fokussierter, fast diszipliniert in ihren Optimierungszielen, sei es Agentenkoordination oder verteilte Intelligenz. Was das Sign Protocol versucht, fühlt sich breiter an, fast so, als würde eine gesamte digitale Wirtschaft in eine einzige Schnittstelle komprimiert. Diese Ambition macht es überzeugend, aber sie verstärkt auch jede Ineffizienz darunter.

Der ehrliche Teil, zu dem ich immer wieder zurückkehre, ist, dass die Anwendungsschicht sich bereits wie die Zukunft anfühlt. KI-unterstützte Compliance, automatisierte Verteilung, nahtlose Benutzererfahrungen, es liest sich alles wie etwas, das bereit ist, im großen Maßstab implementiert zu werden. Aber die Infrastruktur darunter fühlt sich weiterhin so an, als würde sie mit älteren Einschränkungen verhandeln, fragmentierter Speicherung, inkonsistenter Indizierung und Latenz, die nicht vollständig verschwindet. Es erzeugt dieses seltsame Gefühl eines hochentwickelten Systems, das auf einem Fundament ruht, das nicht vollständig mit seinen eigenen Ambitionen synchronisiert ist.

Und die Frage, die mich immer beschäftigt, ist nicht, ob dies funktionieren kann, sondern ob es unsichtbar funktionieren kann. Wenn das Sign Protocol erfolgreich alles davon abstrahieren kann, wenn die Super-App wirklich reibungslos wird, dann werden die meisten Entwickler die Komplexität darunter nie sehen. Sie werden einfach vertrauen, dass es funktioniert. Aber was passiert, wenn dieses Vertrauen in ein System gesetzt wird, bei dem Kosten, Latenz und Konsistenz des Zustands weiterhin variabel sind? Ich frage mich, ob die nächste Generation von Entwicklern durch diese Abstraktion ermächtigt oder leise eingeschränkt wird, indem sie auf Annahmen aufbaut, die nur die meiste Zeit wahr sind.