Ich erinnere mich, dass ich vor ein paar Jahren durch ein mittelgroßes Logistikbüro ging und zusah, wie zwei Teams über eine Sendung stritten, die technisch gesehen nicht existierte. Auf einem Bildschirm hatte das Paket bereits den Zoll passiert. Auf einem anderen war es weiterhin als "ausstehende Verifizierung" markiert. Beide Systeme waren in ihrem eigenen Kontext "korrekt". Beide hatten Zeitstempel, Unterschriften und Aufzeichnungen. Und doch konnte keiner überzeugend dem anderen beweisen, dass seine Version der Realität die vertrauenswürdige war.

Was mich überrascht hat, war nicht der Fehler selbst. Fehler passieren. Es war die stille Annahme, die allem zugrunde lag, dass die Verifizierung lokal, fragmentiert und ständig wiederholt ist. Jedes System versuchte, das Vertrauen von Grund auf neu aufzubauen, immer wieder. Es war kein Fehler der Datenbewegung. Die Daten waren da, bewegten sich schnell zwischen den Systemen. Es war ein Fehler der Vereinbarung.

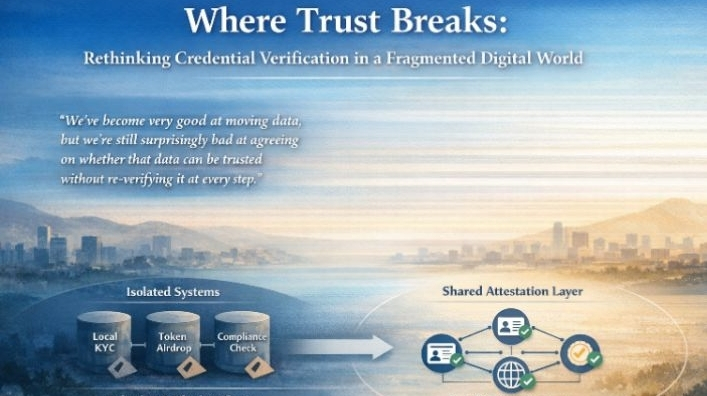

Im Laufe der Zeit habe ich begonnen zu bemerken, dass sich dieses Muster in verschiedenen Branchen wiederholt. Finanzsysteme, Gesundheitsakten, Identitätsplattformen, sogar Token-Verteilungsmechanismen in Krypto leiden alle unter demselben strukturellen Problem. Wir sind sehr gut darin geworden, Daten zu bewegen, aber wir sind immer noch überraschend schlecht darin, uns darauf zu einigen, ob diese Daten ohne erneute Verifizierung bei jedem Schritt vertraut werden können.

Die Überprüfung von Berechtigungen ist ein gutes Beispiel. Egal, ob es darum geht, Identität nachzuweisen, die Berechtigung für einen Token-Airdrop zu validieren oder die Einhaltung in einer regulierten Umgebung zu bestätigen, der Prozess ist in der Regel redundant und isoliert. Eine Plattform überprüft einen Benutzer, eine andere wiederholt denselben Prozess, und eine dritte erkennt möglicherweise nicht einmal die vorherige Verifizierung an. Jedes System funktioniert wie eine Insel, mit eigenen Regeln und Annahmen.

Die Token-Verteilung, insbesondere in Krypto, macht diese Schwäche noch deutlicher. Ich habe gesehen, wie Projekte mit Airdrops kämpften, nicht weil sie keine Tokens verteilen konnten, sondern weil sie nicht sicher bestimmen konnten, wer sie erhalten sollte. Sybil-Angriffe, doppelte Identitäten, inkonsistente Berechnungskriterien - das sind keine Randfälle mehr. Sie sind die Norm. Und die meisten Lösungen enden damit, dass sie mehr Prüfungen, mehr Datenbanken, mehr Reibung aufschichten, anstatt das zugrunde liegende Koordinationsproblem anzugehen.

Das ist der Kontext, in dem ich begann, auf Projekte zu achten, die versuchen, die Verifizierungsinfrastruktur auf einer grundlegenderen Ebene neu zu überdenken. Nicht als Anwendungsfunktion, sondern als gemeinsame Schicht, auf die mehrere Systeme angewiesen sein können. Ein solcher Versuch ist ein Projekt, das sich als eine Art globale Infrastruktur für die Verifizierung von Berechtigungen und die Verteilung von Tokens positioniert.

Ich sehe es nicht als fertige Lösung. Es fühlt sich eher wie ein Experiment an - ein Versuch, eine schwierige Frage zu beantworten: Wie würde es aussehen, wenn die Verifizierung selbst tragbar, wiederverwendbar und konsistent interpretierbar über Systeme hinweg würde?

Kern dieser Idee ist relativ einfach, auch wenn die Umsetzung nicht ist. Anstatt dass jede Plattform unabhängig Berechtigungen verifiziert und ihre eigenen isolierten Aufzeichnungen führt, führt das System eine gemeinsame Bestätigungsschicht ein. In diesem Modell wird ein Stück Information - sagen wir, dass ein Benutzer einen KYC-Check bestanden hat oder für eine spezifische Token-Verteilung berechtigt ist - als Bestätigung aufgezeichnet. Diese Bestätigung kann dann von anderen Systemen referenziert, wiederverwendet und validiert werden, ohne den gesamten Verifizierungsprozess wiederholen zu müssen.

Ich habe begonnen, es weniger als Datenbank und mehr als Koordinationsmechanismus zu betrachten. Das Ziel ist nicht nur, Informationen zu speichern, sondern einen gemeinsamen Bezugspunkt zu schaffen, auf den verschiedene Teilnehmer sich verlassen können. Wenn mehrere Systeme sich über die Gültigkeit einer Bestätigung einig sein können, beginnt der Bedarf an redundanter Verifizierung abzunehmen.

Das wird besonders relevant bei der Token-Verteilung. Anstatt dass jedes Projekt seine eigene Berechtigungslogik und Verifizierungs-Pipeline aufbaut, könnten sie theoretisch auf bestehende Bestätigungen vertrauen. Die Geschichte eines Benutzers in Bezug auf Teilnahme, Identitätsüberprüfung oder Beitrag könnte als eine Reihe von verifizierbaren Ansprüchen dargestellt werden. Die Verteilung wird dann weniger über Raten und mehr über Referenzen.

Was diesen Ansatz für mich interessant macht, ist, dass er nicht versucht, Komplexität vollständig zu beseitigen. Er erkennt an, dass verschiedene Systeme weiterhin unterschiedliche Anforderungen und Vertrauensannahmen haben werden. Aber er versucht zu standardisieren, wie diese Annahmen ausgedrückt und geteilt werden.

Es gibt auch einen subtilen Wandel in der Behandlung von Identität. Anstatt ein statisches Profil zu sein, das in einem einzigen System gespeichert ist, wird Identität etwas, das näher an einer Sammlung von Bestätigungen ist - modular, zusammensetzbar und kontextabhängig. Das stimmt näher überein, wie Vertrauen in der realen Welt tatsächlich funktioniert. Wir verlassen uns nicht auf ein einziges Credential für alles. Wir verlassen uns auf ein Netzwerk von Signalen, die jeweils ein gewisses Gewicht je nach Kontext tragen.

In praktischen Begriffen könnte dies die Reibung in Bereichen verringern, in denen die Verifizierung derzeit ein Engpass ist. Onboarding-Prozesse könnten schneller werden, wenn frühere Bestätigungen anerkannt werden. Die Token-Verteilungen könnten gezielter und weniger anfällig für Missbrauch werden. Sogar compliance-intensivere Umgebungen könnten davon profitieren, eine gemeinsame, überprüfbare Schicht der Verifizierung zu haben, anstatt ein Flickwerk interner Systeme.

Das gesagt, bin ich vorsichtig, wie weit das gehen kann.

Die größte Herausforderung ist nicht technischer Natur. Es ist die Koordination. Damit eine gemeinsame Bestätigungsschicht funktioniert, müssen mehrere unabhängige Akteure sich nicht nur über das Format der Daten einig sein, sondern auch über deren Bedeutung und Gültigkeit. Das ist nichts, was Technologie allein durchsetzen kann. Es erfordert eine Angleichung von Anreizen, Standards und bis zu einem gewissen Grad Governance.

Ich habe gesehen, wie ähnliche Ideen in der Vergangenheit gescheitert sind. Identitätssysteme, die Tragfähigkeit versprachen, endeten fragmentiert, weil verschiedene Plattformen einander nicht vertrauten Bestätigungen. Datenfreigabeinitiativen kamen zum Stillstand, weil die Teilnehmer zögerten, sich auf externe Wahrheitsquellen zu verlassen. Selbst innerhalb von Krypto, wo Interoperabilität oft betont wird, sind Koordinationsfehler häufig.

Es gibt auch die Frage der Vertrauensanker. Wer gibt die Bestätigungen aus? Warum sollten andere ihnen vertrauen? Wenn das System zu zentralisiert um einige wichtige Aussteller wird, riskiert es, die Probleme, die es zu lösen versucht, neu zu schaffen. Wenn es zu dezentralisiert ist, kann es schwierig werden, die Qualität und Zuverlässigkeit der Bestätigungen zu bewerten.

Leistung und Skalierbarkeit sind ein weiteres Anliegen. Verifizierungssysteme arbeiten oft unter Echtzeitbeschränkungen. Wenn das Referenzieren oder Validieren von Bestätigungen Latenz oder Komplexität einführt, könnte die Akzeptanz leiden. In vielen Fällen werden Organisationen ein weniger elegantes, aber vorhersehbares internes System einem gemeinsamen Infrastrukturansatz vorziehen, der Unsicherheit hinzufügt.

Und dann gibt es den menschlichen Faktor. Systeme wie dieses nehmen an, dass die Teilnehmer auf eine Weise handeln, die mit dem übergeordneten Ziel von wiederverwendbarem Vertrauen übereinstimmt. Aber in der Praxis können die Anreize nicht übereinstimmen. Einige Akteure profitieren davon, ihre Daten isoliert zu halten. Andere könnten das System ausnutzen, indem sie qualitativ minderwertige oder irreführende Bestätigungen ausstellen. Mechanismen zu entwerfen, um diese Verhaltensweisen zu mindern, ist nicht trivial.

Trotz dieser Bedenken denke ich, dass die Richtung es wert ist, Aufmerksamkeit zu schenken. Die Idee, Verifizierung als Infrastruktur und nicht als Funktion auf Anwendungsebene zu behandeln, spricht ein reales und anhaltendes Problem an. Sie verlagert den Fokus von der Schaffung besserer individueller Systeme auf die Verbesserung der Interaktion zwischen Systemen.

In Bezug auf reale Auswirkungen kann ich sehen, dass dies in Bereichen relevant sein könnte, in denen die Koordination zwischen den Entitäten unvermeidlich ist. Grenzüberschreitende Finanzen sind ein offensichtliches Beispiel, wo die Einhaltung und die Identitätsverifizierung sowohl kritisch als auch fragmentiert sind. Lieferketten, in denen mehrere Parteien sich über den Status und die Authentizität von Waren einig sein müssen, könnten ebenfalls profitieren. Selbst aufkommende Bereiche wie dezentrale Robotik oder Maschinen-zu-Maschinen-Wirtschaften könnten eine gemeinsame Schicht verifizierbarer Berechtigungen benötigen, um zuverlässig zu funktionieren.

Was ich am interessantesten finde, ist, dass, wenn so etwas funktioniert, es nicht besonders sichtbar sein wird. Es wird sich nicht wie ein Durchbruchsmoment anfühlen. Es wird keinen einzelnen Punkt geben, an dem sich alles plötzlich ändert. Stattdessen werden Prozesse, die früher langsam und repetitiv waren, etwas reibungsloser werden. Systeme, die früher nicht einig waren, werden sich häufiger angleichen. Reibung wird fast stillschweigend abnehmen.

So entwickelt sich in der Regel bedeutende Infrastruktur. Nicht durch dramatische Veränderungen, sondern durch inkrementelle Verbesserungen, die sich über die Zeit summieren.

Ich weiß nicht, ob dieser spezielle Ansatz erfolgreich sein wird. Es gibt zu viele Variablen - technische, soziale, wirtschaftliche - um fundierte Vorhersagen zu treffen. Aber das Problem, das er zu lösen versucht, ist real und wird nicht verschwinden. Je mehr Systeme miteinander verbunden werden, desto höher werden die Kosten für fragmentierte Verifizierung.

Wenn es hier ein Maß für den Erfolg gibt, wird es nicht daran liegen, wie weit verbreitet das System besprochen wird, sondern daran, wie wenig die Leute überhaupt über Verifizierung nachdenken müssen. Wenn es funktioniert, wird es sich weniger wie eine neue Schicht anfühlen und mehr wie etwas, das schon immer da sein sollte und leise die Dinge im Hintergrund zusammenhält.

@SignOfficial #SignDigitalSovereignInfra $SIGN