Ich habe mehr Zeit damit verbracht, als ich erwartet hatte, darüber nachzudenken, wie große Systeme tatsächlich koordinieren. Nicht die idealisierte Version, die Sie in Whitepapers sehen, sondern die chaotische Version – wo Abteilungen nicht übereinstimmen, Daten nicht sauber reisen und Vertrauen ständig verhandelt wird, anstatt vorausgesetzt zu werden. Das ist die Perspektive, die ich mitbrachte, als ich begann, mich mit dem SIGN-Rahmen zu befassen.

Auf den ersten Blick liest es sich wie viele andere Infrastrukturvorschläge: Interoperabilität, Effizienz, Cross-Chain-Fähigkeiten, Integration mit globalen Standards. Ich habe diese Ansprüche schon einmal gehört. Was mich zum Nachdenken brachte, war nicht das Ambitionsniveau, sondern wie viel vom Design zu akzeptieren scheint, dass die Dinge bereits fragmentiert sind – und wahrscheinlich noch eine Weile so bleiben werden.

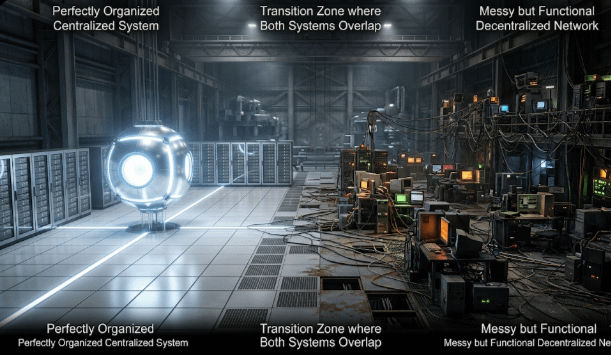

Eine Sache, zu der ich immer wieder zurückkomme, ist, wie Vertrauen gehandhabt wird. Die meisten Systeme versuchen, es zu zentralisieren. Eine Datenbank, eine Autorität, eine Identitätsschicht, von der alles abhängt. Es klingt sauber, aber es übersteht selten den Kontakt mit der Realität. Institutionen vertrauen einander nicht vollständig, und selbst innerhalb eines einzigen Systems haben unterschiedliche Akteure unterschiedliche Anreize. Was SIGN stattdessen zu tun scheint, ist, Vertrauen über mehrere Bestätigungen zu verteilen.

Das mag technisch klingen, fühlt sich aber in der Praxis vertraut an. Denken Sie an etwas wie ein Förderprogramm. Die Berechtigung wird nicht von einer einzigen Quelle bestätigt. Es gibt normalerweise eine Mischung – Dokumente, frühere Teilnahmeunterlagen, vielleicht sogar Empfehlungen oder Gemeinschaftsvalidierung. Es ist geschichtet, manchmal redundant, gelegentlich ineffizient – aber es funktioniert, weil kein einzelner Punkt das gesamte Gewicht trägt. SIGN scheint dieses bestehende Muster zu übernehmen und in etwas Strukturiertes und Tragbares zu formalizieren.

Ich finde diesen Ansatz realistischer, als zu versuchen, alles mit einem universellen Identitätssystem zu ersetzen. Denn die Wahrheit ist, dass Identität selten universell ist. Sie ist kontextabhängig. Sie könnten für ein Programm berechtigt sein und nicht für ein anderes, in einem Netzwerk vertrauenswürdig und in einem anderen unbekannt. Indem Sie die Verifizierung von mehreren Quellen zulassen, spiegelt das System diese Nuancen wider, anstatt sie zu verflachen.

Dennoch denke ich nicht, dass dies automatisch das tiefere Problem löst. Nur weil Sie mehrere Bestätigungen sammeln können, bedeutet das nicht, dass sie bedeutungsvoll sind. Jemand muss immer noch entscheiden, welche wichtig sind, wie sie gewichtet werden und was passiert, wenn sie in Konflikt geraten. Das ist weniger ein technisches Problem als eine Governance-Frage – und diese neigen dazu, schwieriger zu sein.

Ein weiterer Bereich, in dem der Rahmen geerdet wirkt, ist die Integration. Es gibt eine stille Anerkennung, dass veraltete Systeme nicht verschwinden werden. Regierungen und Institutionen haben zu viel in sie investiert, und alles auf einmal zu ersetzen, ist nicht nur teuer – es ist in einer Weise disruptiv, die essentielle Dienstleistungen gefährden kann.

Daher verlässt sich SIGN stattdessen auf APIs, Migrationswerkzeuge und hybride Bereitstellungsmodelle. Es ist keine aufregende Sprache, aber sie ist praktisch. Sie können sich ein Szenario vorstellen, in dem eine Abteilung mit einem Pilotprojekt beginnt – vielleicht einem eingeschränkten Service oder einer kleinen Benutzergruppe – während alles andere wie gewohnt weiterläuft. Im Laufe der Zeit wechseln mehr Teile, idealerweise ohne größere Unterbrechungen zu verursachen.

Ich habe genug gescheiterte "digitale Transformations"-Bemühungen gesehen, um zu wissen, dass dieser schrittweise Ansatz oft der einzige ist, der funktioniert. Aber er bringt auch seine eigene Komplexität mit sich. Parallelbetriebe bedeuten, die Konsistenz zwischen ihnen aufrechtzuerhalten. Daten müssen synchronisiert werden. Prozesse müssen übereinstimmen. Und wenn etwas schiefgeht, ist nicht immer klar, welche Schicht verantwortlich ist.

Der Interoperabilitätswinkel ist ein weiterer Bereich, in dem das Versprechen klar ist, die Ausführung jedoch unsicher erscheint. Die Verwaltung von Cross-Chain-Vermögenswerten zielt beispielsweise darauf ab, die Notwendigkeit manueller Abstimmungen zwischen Systemen zu beseitigen. Theoretisch reduziert das Kosten und beschleunigt die Abläufe. In der Praxis hängt es von mehreren Netzwerken ab, die vorhersehbar funktionieren und einander vertrauen.

Das Gleiche gilt für die internationale Koordination. Standards wie ISO 20022 sollen die finanzielle Kommunikation über Grenzen hinweg konsistenter gestalten. Die Integration mit ihnen sollte es den Systemen erleichtern, global zu interagieren. Aber Standards beseitigen nicht die Reibung – sie verringern sie nur. Institutionen haben immer noch ihre eigenen Regeln, Compliance-Anforderungen und politische Überlegungen. All das in Einklang zu bringen, ist ebenso sehr eine Frage der Verhandlung wie der Technologie.

Wo ich potenzielle Werte sehe, ist in der Reduzierung von Wiederholungen. Im Moment beinhalten viele Prozesse, immer wieder dasselbe zu beweisen. Sie verifizieren Ihre Identität auf einer Plattform und tun es dann woanders erneut. Sie stellen die Berechtigung in einem Programm fest und beginnen dann von vorne in einem anderen. Es ist ineffizient, aber es bleibt bestehen, weil Systeme kein Vertrauen teilen.

Wenn SIGN diese Nachweise wiederverwendbar machen kann, ohne alles in ein einziges zentrales System zu zwingen – das könnte einen spürbaren Unterschied machen. Keine dramatische Transformation, sondern eine stetige Verringerung der Reibung. Und manchmal ist das wertvoller als ein großer Sprung, der nie vollständig landet.

Ich habe auch über die Rolle automatisierter Agenten in all dem nachgedacht. Die Idee ist, dass sie Regeln durchsetzen, Transaktionen validieren und routinemäßige Prüfungen ohne menschliches Eingreifen durchführen können. Auf einer Ebene macht das Sinn. Es reduziert die manuelle Arbeitsbelastung und beschleunigt die Prozesse.

Aber es verschiebt auch, wo das Vertrauen sitzt. Anstatt einer Person oder einer Institution zu vertrauen, vertrauen Sie der Logik, die im System eingebettet ist. Das wirft Fragen zur Transparenz und Rechenschaftspflicht auf. Wenn ein automatisierter Prozess eine Transaktion ablehnt oder ein Problem kennzeichnet, wer überprüft diese Entscheidung? Wie einfach ist es, diese anzufechten oder zu überschreiben? Und wie oft scheitern diese Systeme auf Arten, die nicht sofort sichtbar sind?

Sicherheit ist eine weitere Schicht, die auf dem Papier solide aussieht. Mehrschichtige Schutzmaßnahmen, Audits, formale Überprüfungen, Bug-Bounties – es ist ein umfassender Ansatz. Aber Sicherheit geht nicht nur darum, Angriffe zu verhindern. Es geht auch darum, den Zugang zu verwalten, Fehler zu handhaben und sicherzustellen, dass das System unter Stress vorhersehbar funktioniert.

In Umgebungen mit mehreren Interessengruppen wird das noch komplizierter. Verschiedene Benutzer haben unterschiedliche Berechtigungen. Einige Aktionen sind automatisiert, andere manuell. Und wenn etwas schiefgeht, hängt die Reaktion oft von der Koordination zwischen Parteien ab, die nicht immer mit derselben Geschwindigkeit vorankommen.

Was ich schätze, ist die Betonung der phasenweisen Bereitstellung. Begonnen mit der Bewertung und Planung, über Pilotprogramme, dann allmählich erweitert. Es ist ein langsamer Prozess, aber er schafft Raum für Lernen und Anpassung. Anstatt sich von Anfang an vollständig zu engagieren, können Sie sehen, wie sich das System unter realen Bedingungen verhält.

Der damit verbundene Governance-Rahmen ist ebenso wichtig. Technische Governance zur Verwaltung von Aktualisierungen, betriebliche Governance für die tägliche Aufsicht, politische Governance, um alles mit den breiteren Zielen in Einklang zu halten. Es ist eine Erinnerung daran, dass Infrastruktur nicht nur Code ist – es ist auch Prozess und Entscheidungsfindung.

Selbst mit all dem bin ich immer noch vorsichtig. Nicht, weil die Ideen unrealistisch sind, sondern weil die Umsetzung dazu neigt, Herausforderungen zu offenbaren, die Designs nicht vollständig erfassen. Koordination zwischen Institutionen, Angleichung von Anreizen, Benutzerakzeptanz – das sind die Teile, die sich nicht so ordentlich skalieren wie Technologie.

Ich habe Projekte mit starken technischen Grundlagen gesehen, die gescheitert sind, weil sie unterschätzt haben, wie Menschen und Organisationen sich verhalten. Veränderungen sind langsam und manchmal wird ihnen widerstanden. Systeme, die von außen effizient aussehen, können für die Menschen, die sie nutzen sollen, kompliziert oder riskant erscheinen.

Gleichzeitig hat Untätigkeit ihre eigenen Kosten. Die aktuelle Landschaft – fragmentierte Systeme, wiederholte Verifizierung, langsame Koordination – funktioniert nicht gerade gut. Es funktioniert, aber mit viel eingebaute Ineffizienz.

Das ist, wo ich mit SIGN lande. Nicht als Durchbruch, der alles löst, sondern als ein Versuch, innerhalb der bereits bestehenden Einschränkungen zu arbeiten. Es versucht nicht, Komplexität zu beseitigen, sondern sie zu organisieren.

Wenn es erfolgreich ist, denke ich nicht, dass der Einfluss von einem einzigen Merkmal kommt. Er wird von kleinen Verbesserungen stammen – weniger Wiederholungen, reibungslosere Integration, etwas schnellere Koordination. Dinge, die keine Schlagzeilen machen, aber Systeme einfacher handhabbar machen.

Und wenn es nicht vollständig erfolgreich ist, wird es wahrscheinlich trotzdem nützliche Muster hinterlassen – Denkweisen über Vertrauen, Verifizierung und Interoperabilität, auf denen andere aufbauen können.

Für jetzt beobachte ich es mit vorsichtigem Optimismus. Keine Perfektion zu erwarten.

\u003cm-58/\u003e\u003ct-59/\u003e

\u003cc-65/\u003e