Ich habe diesen Bereich lange genug beobachtet, um ein Muster zu erkennen: Jeder Zyklus verspricht, etwas Fundamentales zu vereinfachen—Vertrauen, Eigentum, Koordination—und irgendwie fühlt es sich jedes Mal so an, als würden die Systeme, die entstehen, schwerer… Nicht immer sichtbar. Manchmal ist das Gewicht hinter besseren Schnittstellen, reibungsloserer Einarbeitung, klarerer Sprache verborgen. Aber es ist da, wenn man lange genug damit sitzt.

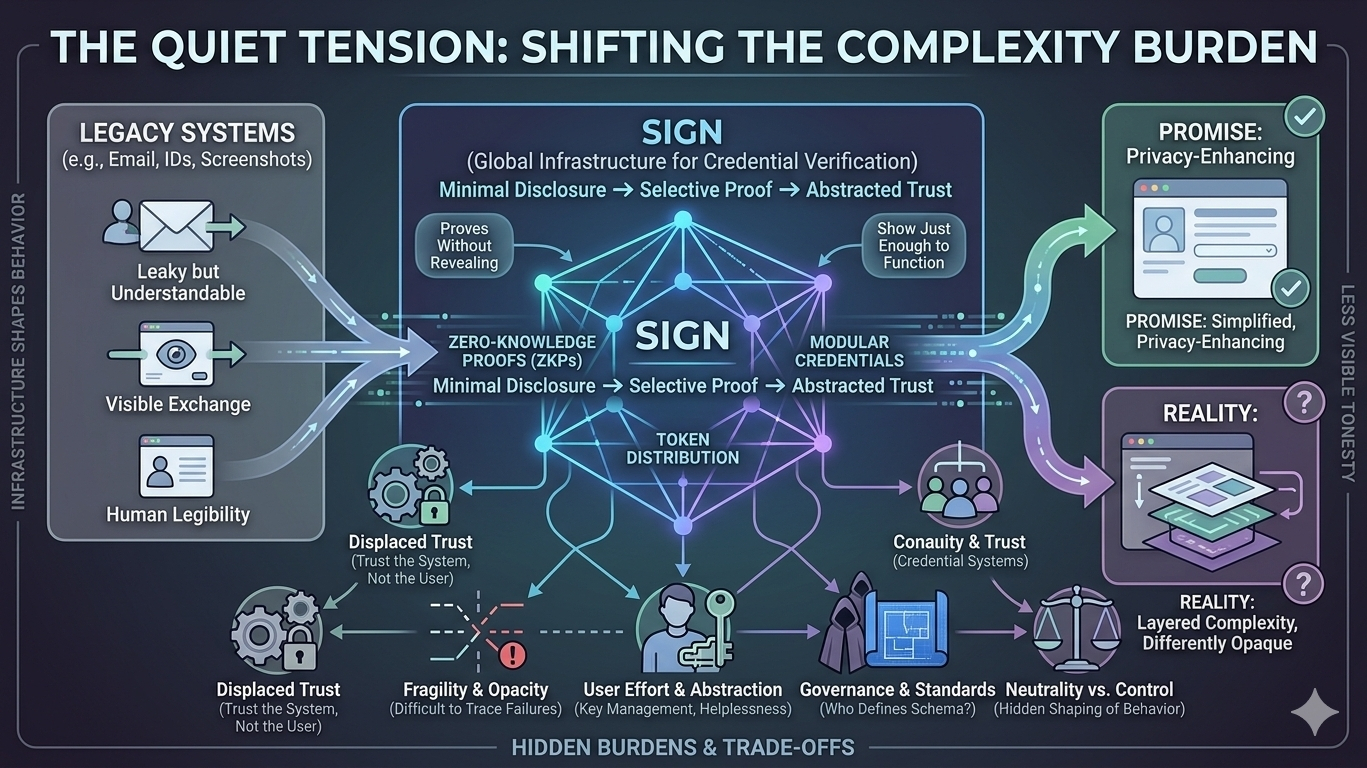

Systeme wie SIGN—diese Idee einer globalen Infrastruktur zur Überprüfung von Berechtigungen, verbunden mit Zero-Knowledge-Beweisen und Token-Verteilung—klingen auf den ersten Blick wie eine Art leise Korrektur. Weniger Lärm. Weniger Exposition. Eine Möglichkeit, etwas zu beweisen, ohne alles zu sagen. Es spricht einen sehr alten Instinkt an: Ich sollte in der Lage sein, gerade genug von mir zu zeigen, um zu funktionieren, ohne den Rest preiszugeben.

Und doch bin ich mir nicht sicher, ob es sich in der Praxis tatsächlich leichter anfühlt.

Denn was du an Privatsphäre gewinnst, verlierst du oft an Lesbarkeit.

Es gibt etwas seltsam Menschliches an dem Durcheinander der aktuellen Systeme. E-Mails, IDs, Screenshots, Unterschriften - unvollkommen, undicht, aber verständlich. Du weißt, wann du etwas übergeben hast. Du spürst es. Bei Zero-Knowledge-Systemen wird der Austausch abstrakter. Du beweist, dass du gehörst, oder qualifizierst dich, oder existierst auf eine bestimmte Weise ... aber der Mechanismus verschwindet hinter einer Mathematik, die die meisten Menschen nie sinnvoll erfassen werden.

Wir sagen „vertraue dem Beweis“, aber was wir wirklich meinen, ist „vertraue dem System, das den Beweis erzeugt hat“, was stillschweigend die Last woanders hin verschiebt. Nicht eliminiert - nur verlagert.

Und ich frage mich, wer tatsächlich diese Last trägt.

Denn minimale Offenlegung klingt zunächst klar positiv, bis du versuchst, es auf echtes Verhalten abzubilden. Menschen vergessen Schlüssel. Sie verwenden Anmeldedaten mehrfach. Sie klicken zu schnell auf Dinge. Sie delegieren Entscheidungen, die sie nicht verstehen. In einem System wie SIGN, wo Anmeldedaten modular und portabel werden, wo Identität in Beweise fragmentiert, die selektiv offenbart werden können, gibt es eine Art Eleganz - aber auch eine neue Fragilität.

Wenn etwas schiefgeht, wo schaust du dann überhaupt hin?

Nicht an den offensichtlichen Orten. Nicht in einer geleakten Datenbank oder einem kompromittierten Passwort. Die Fehlerquellen werden leiser, schwerer nachzuvollziehen. Ein hier widerrufenes Credential. Ein dort falsch konfigurierter Beweis. Eine Governance-Entscheidung, die irgendwo weiter oben getroffen wurde und subtil verändert, was als „gültig“ zählt. Und plötzlich verschwindet der Zugang - oder erscheint - ohne eine klare Erzählung, der jeder folgen kann.

Hier gibt es einen Kompromiss, über den nicht viel gesprochen wird: Privatsphäre kann nicht nur den Benutzer, sondern auch das System selbst verschleiern.

Und vielleicht ist das der Punkt. Oder vielleicht ist es nur eine Nebenwirkung, mit der wir uns noch nicht vollständig auseinandergesetzt haben.

Ich denke auch über Offenheit nach. Krypto, zumindest in seiner früheren Darstellung, setzte stark auf Transparenz - öffentliche Ledger, verifizierbare Aktionen, geteilte Sichtbarkeit. Es gab eine Art kollektive Prüfbarkeit, selbst wenn die meisten Menschen nicht aktiv daran teilnahmen. Man könnte theoretisch alles sehen.

Zero-Knowledge kehrt diesen Instinkt um. Jetzt ist das System weiterhin verifizierbar, aber nicht auf die gleiche Weise sichtbar. Die Wahrheit existiert, aber sie ist in Beweisen komprimiert, die bestätigen, ohne zu offenbaren. Es ist eine andere Art von Ehrlichkeit - eine, die selektiver erscheint.

Und ich bin mir nicht sicher, ob das das System vertrauenswürdiger macht oder einfach nur anders undurchsichtig.

Es gibt auch etwas leicht Unbehagliches daran, wie leicht sich Privatsphäre-Narrative in moralische Gewissheit verwandeln. „Benutzer verdienen Kontrolle.“ Natürlich tun sie das. „Datenexposition ist schädlich.“ Oft, ja. Aber Privatsphäre ist nicht neutral. Sie schützt, aber sie verbirgt auch. Sie ermächtigt Einzelpersonen, aber sie kann ebenso leicht Institutionen, Akteure oder Verhaltensweisen schützen, die davon profitieren, nicht klar gesehen zu werden.

In einem System wie SIGN, wo Anmeldedaten und Bestätigungen über Kontexte hinweg bewegt werden können, verifiziert, aber nicht vollständig sichtbar, geht es nicht nur darum, was bewiesen wird, sondern auch darum, was zusammen mit ihm verborgen wird.

Und wer entscheidet über diese Grenze?

Governance schleicht sich schließlich immer ein. Jemand definiert das Schema. Jemand bestimmt, was als gültige Anmeldedaten zählt, wer sie ausstellen kann, wie Streitigkeiten gelöst werden. Sogar in dezentralen Systemen entstehen diese Entscheidungen nicht aus dem Nichts. Sie werden von Menschen, kleinen Gruppen oder frühen Teilnehmern getroffen, die Standards setzen, die sich im Laufe der Zeit verfestigen.

Von außen kann es neutral aussehen. Nur Infrastruktur. Nur Schienen.

Aber Infrastruktur beeinflusst Verhalten auf Weisen, die nicht immer auf den ersten Blick offensichtlich sind.

Wenn SIGN zu einer Schicht wird, in der Anmeldedaten standardisiert und verteilt werden, dann beeinflusst jeder, der diese Standardisierung beeinflusst, auf leise Weise, wie Identität selbst ausgedrückt wird. Nicht nur technisch, sondern auch sozial - was wichtig ist, was nachweisbar ist, was anerkannt wird.

Und die meisten Benutzer werden diesen Prozess nicht sehen. Sie interagieren einfach mit den Ergebnissen.

Es gibt auch die Frage des Aufwands. Privatsphäresysteme verlangen oft mehr vom Benutzer, auch wenn sie versuchen, das zu vermeiden. Schlüsselverwaltung, Wallet-Interaktionen, verstehen, wann man was offenbaren sollte - das sind keine trivialen Aufgaben. Wir versuchen weiterhin, sie abzustraktieren, und manchmal gelingt uns das, aber Abstraktion hat auch ihren Preis: Sie distanziert die Menschen von den Konsequenzen ihres Handelns.

Du musst nicht verstehen, wie ein Beweis funktioniert, um ihn zu nutzen. Aber wenn etwas kaputt geht, wird dieses mangelnde Verständnis zu einer Art Hilflosigkeit.

Und vielleicht ist das die stille Spannung im Zentrum all dessen.

Wir bauen Systeme, die darauf abzielen, die Vertrauensanforderungen zu reduzieren, aber dabei schaffen wir oft neue Oberflächen, auf denen Vertrauen wieder auftaucht - nur weniger sichtbar. In der Mathematik, in den Schnittstellen, in der Governance, in den Annahmen, die in das Design eingebettet sind.

SIGN und Systeme wie es scheinen, als würden sie in eine wichtige Richtung zeigen. Es gibt etwas Unbestreitbares an der Idee, nur das Notwendige zu beweisen, ein bisschen Kontrolle darüber zurückzugewinnen, wie Identität geteilt und verifiziert wird.

Aber ich kann das Gefühl nicht abschütteln, dass wir auch eine Art von Komplexität gegen eine andere eintauschen.

Es geht nicht darum, es zu eliminieren. Nur darum, es irgendwohin zu verschieben, wo es schwerer zu sehen ist.

Und vielleicht ist das unvermeidlich. Oder vielleicht ist es einfach der Stand der Dinge - wir versuchen immer noch, die Idee der Privatsphäre mit der Realität menschlichen Verhaltens in Einklang zu bringen, schichten weiterhin Abstraktionen auf Systeme, die wir nicht vollständig verstehen, in der Hoffnung, dass dieses Mal die Balance hält.

Ich bin mir nicht sicher, ob es jemals wirklich zur Ruhe kommt.